¡Reuniendo excelentes proyectos de código abierto de inteligencia artificial en todo el mundo!

Inglés chino simplificado

¡Bienvenido a AI Resource Central ! Este almacén se centra en reunir excelentes proyectos de código abierto de inteligencia artificial (AI) de todo el mundo. Ya sea que esté buscando inspiración para comenzar su propio proyecto o desea aprender a usar las últimas tecnologías de IA, este es un gran punto de partida. Estamos comprometidos a proporcionar a desarrolladores, investigadores y entusiastas de la IA una plataforma para explorar, comunicar y compartir el código y la implementación de varios proyectos de IA.

Recursos de IA Central

Cuerpo inteligente

Ingeniería de palabras rápida

Interfaz de desarrollo de IA

Marco de desarrollo ágil

Modelo

Lista de IA

Optimización de razonamiento

Agregación de información

Asistente de código

Tutorial de AI

Automatización de flujo de trabajo

AI Robot

Modelo multimodal

Modelo multilingüe

Organización de datos

Servicios de IA

Base de datos vectorial

Educación de IA

Herramientas de desarrollo de IA

Entrenamiento modelo

Generación de imágenes de IA

Conjunto de datos

Evaluación del modelo

Gestión computacional

Escritura de IA

Monitoreo inteligente

Generación de videos

Gestión de datos

Aplicaciones de IA

Ingeniería de IA

Objetivo

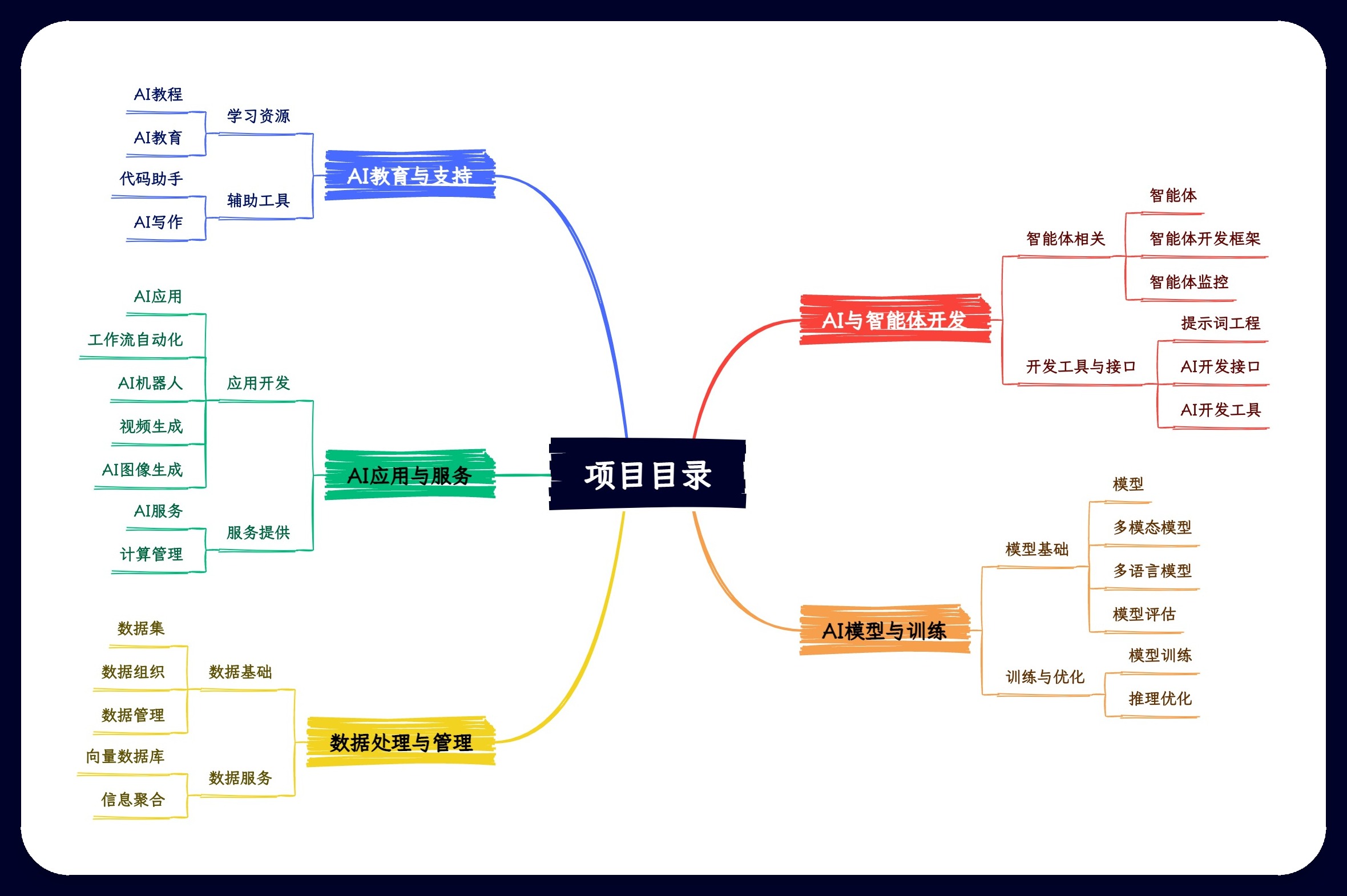

Catálogo de proyectos

Cómo contribuir

licencia

Nuestros objetivos principales son:

Establezca una biblioteca integral de proyectos de IA : proyectos que cubren una amplia gama de campos como el aprendizaje automático, el aprendizaje profundo y el procesamiento del lenguaje natural.

Promueva el espíritu de código abierto : al demostrar proyectos de código abierto de alta calidad, se alienta a más personas a participar en la comunidad de código abierto.

Promover la innovación tecnológica : proporcionar a los desarrolladores casos y soluciones prácticas, y acelere la aplicación y el desarrollo de la tecnología de IA.

Apoye el aprendizaje y el desarrollo : brinde oportunidades prácticas para que los alumnos de todos los niveles les ayuden a dominar las últimas herramientas y tecnologías de IA.

Aquí hay una lista de algunos de nuestros proyectos de IA seleccionados por diferentes campos:

Gravitas significativas/autogpt: AutoGPT está diseñado para permitir a todos usar y desarrollar inteligencia artificial. Su misión es proporcionar a las personas herramientas para centrarse en asuntos importantes.

GEEKAN/METAGPT: el marco de múltiples agentes de la primera compañía de software de IA está dirigido a la programación del lenguaje natural.

Microsoft/Autogen: un marco de programación para la inteligencia artificial autónoma con recursos relacionados en PYPI, Discord y Office Hour.

ReWorkd/AgentGPT - Ensamblar, configurar e implementar agentes de IA autónomos en el navegador.

Joaomdmoura/Crewai - Marco de carrocería de AI autónomo y jugador de roles. Permite a los agentes colaborar y manejar tareas complejas.

Microsoft/Jarvis: Jarvis es un sistema utilizado para conectar modelos de idiomas grandes (LLM) con la comunidad de aprendizaje automático (ML). (Documento: https://arxiv.org/pdf/2303.17580.pdf)

MEM0AI/MEM0: la capa de almacenamiento de aplicaciones de inteligencia artificial.

Microsoft/Semantic-Kernel: integre rápida y fácilmente la tecnología de modelo de lenguaje grande (LLM) de última generación en su aplicación.

Yoheinakajima/babyagi -

OPERAI/SWARM: un marco educativo de orquestación ergonómico y ligero de la orquestación múltiple de agente administrado por el equipo de soluciones de OpenAI.

Phidatahq/Phidata: construye agentes multimodales con memoria, conocimiento, herramientas y capacidades de razonamiento y chats a través de una hermosa interfaz de usuario de agente.

TransformerOptimus/Superagi - Superagi es un marco de proxy de inteligencia artificial autónomo de código abierto desarrollador primero que permite a los desarrolladores construir, administrar y ejecutar de manera rápida y confiable agentes autónomos útiles.

ComposioHQ/Composio - Composio equipa más de 100 integraciones de alta calidad para agentes de inteligencia artificial y modelos de idiomas grandes (LLM) a través de llamadas de funciones.

CPACKER/MEMGPT - Letta (anteriormente conocido como MEMGPT), un marco para crear servicios de modelo de idioma grande (LLM) con capacidades de memoria.

Google-DepMind/DeepMind-Research: este repositorio contiene código de implementación y código de muestra para publicaciones de DeepMind.

BotPress/BotPress: un centro de código abierto para construir e implementar agentes GPT/LLM.

OpenMoss/Moss: un modelo de lenguaje conversacional de código abierto desarrollado por la Universidad de Fudan y mejorado por herramientas.

SMOL -AI/desarrollador: la primera biblioteca que le permite incrustar a los agentes de desarrolladores en sus propias aplicaciones.

OpenBMB/Xagent: un agente modelo de lenguaje autónomo para resolver tareas complejas.

Langchain -AI/Langgraph - Construye agentes del lenguaje elástico en forma de gráficos.

E2B -DEV/E2B: tiempo de ejecución de Cloud de código abierto seguro para aplicaciones de IA y proxy.

ModelsCope/AgentsCope: más fácil de construir aplicaciones múltiples empoderadas por modelos de idiomas grandes (LLM).

HOMANP/SUPERAGENT - Ejecute un proxy AI a través de la API.

Aiwaves -CN/Agentes -

FRDEL/Agent -Zero - Marco de inteligencia artificial del Agente Zero.

Microsoft/Tinytroupe - Simulación de roles múltiples impulsada por modelos de idiomas grandes (LLM) para mejorar la imaginación y obtener información comercial.

QWENLM/QWEN -AGENT: un marco de proxy y una aplicación basada en Qwen≥2.0, con llamadas de funciones, intérprete de código, generación de mejora de recuperación (RAG) y funciones de extensión de Chrome.

OpenBMB/Agentverse: Agentverse está diseñado para implementar múltiples agentes basados en el modelo de idioma grande (LLM) en aplicaciones, principalmente proporcionando marcos de resolución y simulación de tareas.

Gravitas significativas/Auto-GPT-Plugins-complemento Auto-GPT.

Huggingface/Smolagents - Smolagents es una biblioteca básica para los agentes. Los agentes lo usan para escribir el código Python para la llamada de herramientas y el agente-orquestación.

IronClad/Rivet: un entorno de programación de inteligencia artificial visual de código abierto y un entorno de programación y biblioteca de mecanografiado.

GMPETROV/DATABERRY: una plataforma sin código para crear agentes de modelo de lenguaje grande personalizado (LLM).

OpenBMB/BMTools: solución de código abierto para el aprendizaje de herramientas de modelos grandes con el complemento ChatGPT.

Langroid/Langroid: use programación de múltiples agentes para controlar modelos de lenguaje grandes.

Muellerberndt/Mini -AGI - Miniagi es un agente autónomo universal simple que depende de la API de OpenAI.

Farama-Foundation/Pettingzoo: un estándar de interfaz del programa de aplicación de aprendizaje de refuerzo de múltiples agentes (API), incluidos entornos de referencia y utilidades de uso común.

Josh-XT/Agixt-Agixt es una plataforma de IA dinámica que utiliza memoria adaptativa, características inteligentes y sistemas de complemento para administrar instrucciones y realizar tareas entre múltiples proveedores de IA para proporcionar soluciones de IA eficientes.

JUNSCOMPUTER/MOA - El agente híbrido (MOA) logró 65.1% en la evaluación de Alpaca (Alpacaeval) utilizando modelos de software de código abierto.

Agenteps -AI/Agenteps - Kit de desarrollo de software de Python (SDK) para AI Agent Monitoring, gran modelo de lenguaje (LLM) Seguimiento de costos y evaluación comparativa. Se integra con una variedad de grandes modelos de idiomas y marcos proxy.

Noahshinn/Reflexion - [Neurips 2023] "Reflexión: Agentes del lenguaje basados en el aprendizaje de refuerzo del habla"

Scisharp/BotSharp - Marco de agilidad múltiple de inteligencia artificial en .NET.

dot -agent/nextpy -

iterativo/Datachain: extracción, transformación, carga (ETL), análisis y versiones de datos no estructurados.

Agiresearch/Openagi - Openagi: Encuentro de modelos de idiomas grandes (LLM) con expertos en dominios.

Internlm/Lagent: un marco liviano para crear proxy basado en modelos de idiomas grandes.

Minedojo/Minedojo: use el conocimiento a escala de Internet para construir cuerpos inteligentes encarnados abiertos.

Previsión -tecnologías/autochain: Autochain se utiliza para crear agentes livianos, escalables y probables del modelo de lenguaje grande (LLM).

Landing-AI/Vision-Agent-Agente visual.

BCG-X-Official/AgentKit: un kit de inicio para construir agentes restringidos que usan Nextjs, Fastapi y Langchain.

Jina -AI/Thinkgpt: una tecnología proxy para mejorar los modelos de idiomas grandes (LLM) y romper sus limitaciones.

farizrahman4u/loopgpt - un marco modular para auto - gpt.

Farama -Foundation/Chatarena - Chatarena es un entorno de juegos de idiomas múltiples para modelos de idiomas grandes (LLM) diseñado para desarrollar las capacidades de comunicación y colaboración de la inteligencia artificial.

Thudm/AgentTuning - Agent Tuning ofrece capacidades generales de agente a modelos de idiomas grandes.

YIFAN-SONG793/RESTGPT-Proxy autónomo basado en modelos de idiomas grandes controla aplicaciones del mundo real a través de API RESTFUL (interfaz del programa de aplicación de transferencia de estado de Denotative).

Link -AGI/Autoagents: en la Conferencia Internacional Conjunta de Inteligencia Artificial de 2024 (IJCAI), se generaron diferentes roles GPT para formar una entidad colaborativa para manejar tareas complejas.

AI-Engineer-Fundation/Agent-Protocol: esta es una interfaz común que interactúa con agentes de inteligencia artificial, independientemente de la pila de tecnología y puede usarse para cualquier marco de construcción de agentes.

Kenesskyp/IX: una plataforma proxy para GPT -4 autónomo.

F/Awesome-Chatgpt-ProMPts: esta biblioteca organiza palabras de inmediato para usar chatgpt para usar mejor chatgpt y otras herramientas de modelos de idiomas grandes (LLM).

Plexpt/Awesome-Chatgpt-ProMPts-Zh-Guía de entrenamiento chino Chatgpt. Guía para usar varios escenarios. Aprenda a hacer que siga sus instrucciones.

Dair-AI/Pront-Enteringing-Guide-Guías, documentos, conferencias, notas y recursos para solicitar ingeniería.

StanfordNLP/DSPY - DSPY: un marco para programar modelos de lenguaje de programación en lugar de solicitar.

Orientación -AI/Orientación: un lenguaje de arranque para controlar modelos de idiomas grandes.

Esquemas -dev/contornos - Generación de texto estructurada

MSHUMER/GPT-ProMPT-Engineer-

JXNL/Instructor - Salida estructurada de modelos de lenguaje grande (LLM).

BREXHQ/Ingeniería rápida: consejos y trucos para usar el GPT de OpenAI - 4 y otros modelos de idiomas grandes.

Louisshark/chatgpt_system_prompt: un conjunto de palabras de inmediato del sistema GPT y conocimiento sobre inyección/fuga de inmediato.

Microsoft/Typechat: Typechat es una biblioteca para construir interfaces de lenguaje natural con tipos.

SGL-Project/Sglang-Sglang es un marco de servicio rápido para modelos de idiomas grandes y modelos en idioma de visión.

MIT-Han-Lab/Streaming-LLM: un modelo de lenguaje de transmisión eficiente con convergencia de atención (sumideros de atención) propuesto en la Conferencia Internacional de Languinación de 2024 (ICLR).

Spdustin/ChatGPT-Autoexpert-Instrucción personalizada mejorada para ChatGPT (no codificación) y análisis de datos avanzados de ChatGPT (codificación).

Civitai/Civitai: un repositorio que contiene modelo e inversión de texto.

Moonvy/OpenPromptStudio - AIGC Aveño de palabras visuales |

Rockbenben/chatgpt -shortcut: maximice la eficiencia y la productividad con atajos de IA. Personalice, guarde y comparta consejos, y encuentre consejos para diferentes escenarios en la comunidad compartida.

Microsoft/Prompbase: todo relacionado con el proyecto rápido.

Prefecthq/Marvin: cree una interfaz AI agradable.

PromptFoo/PromptFoo - Pruebe palabras de inmediato, proxy y generación de mejora de la recuperación (RAG). Al mismo tiempo, las pruebas de equipo rojo, las pruebas de penetración y el escaneo de vulnerabilidades se realizan en grandes modelos de lenguaje (LLMS), compare el rendimiento de modelos de lenguaje grandes y la configuración simple a través de la línea de comandos y la integración continua/implementación continua (CI/CD) .

Princeton-NLP/Tree-of-theught-llm-Pensamiento sobre el uso de modelos de idiomas grandes para la resolución deliberada de problemas en la Conferencia del Sistema de Procesamiento de Información Neural 2023 (Neurips 2023).

Pydantic/Pydantic -AI: un marco proxy o populador para usar Pydantic en modelos de idiomas grandes (LLM).

1RGS/JSONFormer: una forma confiable de generar JSON estructurado a partir de un modelo de lenguaje.

ThunLP/OpenPrompt: un marco de código abierto para el aprendizaje rápido.

GuardRails -Ai/GuardRails: agregue restricciones de seguridad o restricciones a modelos de idiomas grandes.

ETH -SRI/LMQL: un lenguaje que programa de manera eficiente modelos de idiomas grandes (LLM) bajo guía de restricción.

Informar/indicar el control de la ingeniería y el control de versiones, utilizando GPT u otros modelos basados en el aviso para obtener una salida estructurada. Únase a Discord para la investigación relacionada.

Shreyashankar/GPT3-Sandbox: este proyecto está diseñado para permitir a los usuarios crear excelentes demostraciones web con algunas líneas de código Python utilizando la nueva API Operai GPT-3.

Hegelai/Prompttools: una herramienta de código abierto para solicitar pruebas/experimentos, admitiendo modelos de idiomas grandes (como OpenAI, LLAMA) y bases de datos de vectores (como Chroma, Weaviate, LancedB).

BigScience -Workshop/PrematSource: un conjunto de herramientas para indicaciones de lenguaje natural, incluida la creación, el intercambio y el uso.

Yival/Yival: su aplicación general de inteligencia artificial indica automáticamente al asistente de ingeniería.

Microsoft/Pront -Engine: una biblioteca que ayuda a los desarrolladores a crear indicaciones para modelos de idiomas grandes.

Ianarawjo/ChainForge: un entorno de código abierto para la programación visual para pruebas prácticas de consejos para grandes modelos de lenguaje (LLM).

SPCL/Graph-of-Thughts: la implementación oficial de "Mapa de pensamiento: resolución de problemas complejos con modelos de idiomas grandes".

Ysymyth/React - [ICLR 2023] "Reaccionar: combinar razonamiento y acción en modelos de lenguaje"

Microsoft/GenaIscript - Generación automática de guiones de inteligencia artificial (inteligencia artificial general).

JACKMPCOLLINS/MAGENTIC: integración ininterrumpida de modelos de idiomas grandes en funciones de Python.

Adieyal/SD -Dynamic -Prompts: un script personalizado escrito para automático1111/estable - difusión - webui para crear un lenguaje de plantilla pequeño para generar aleatoriamente palabras rápidas.

ZJUNLP/EasyEdit: un marco de edición de conocimiento fácil de usar para modelos de idiomas grandes (LLM) en la Conferencia de la Asociación Americana de Lingüística Computacional (ACL) 2024.

Microsoft/Aici - AICi: Solicitud como un programa websembly.

Zou -Group/TextGrad - TextGrad: utiliza modelos de lenguaje grandes para backpropropagate de los gradientes de texto a través de la "derivada" automática del texto.

Microsoft/Prompcraft -Robotics: una comunidad del uso de modelos de idiomas grandes (LLM) en el campo de la robótica y un simulador de robot integrado con ChatGPT.

Greshake/LLM -Security: una nueva forma de destruir modelos de idiomas grandes para aplicaciones integradas.

Noamgat/lm-format-cumplimiento: fortalezca el formato de salida del modelo de lenguaje (como el patrón JSON, expresiones regulares, etc.).

Ber666/LLM -Ronpersers: una biblioteca para un razonamiento complejo en modelos de idiomas grandes.

JUJUMILK3/FLOGE-SYSTEM-ProMPTS: una colección de indicaciones del sistema filtradas.

Laiyer-AI/LLM-Guard: un conjunto de herramientas de seguridad para interacciones de modelos de idiomas grandes.

HIYOUGA/FASTEDIT: edite rápidamente modelos de idiomas grandes en 10 segundos.

Timqian/OpenPrompt.co: cree, use y comparta los consejos de chatgpt.

Exploración/Spacy -LLM - Integrar modelos de lenguaje grande (LLM) en procesos estructurados de procesamiento de lenguaje natural (PNL).

Protecttai/Rebuff - Modelo de lenguaje grande (LLM) solicita el detector de inyección.

GetMetal/Motorhead: Motorhead es un servidor para modelos de idiomas grandes (LLM) para la recuperación de la memoria y la información.

Mirascope/Mirascope: un concepto abstracto de modelo de lenguaje grande (LLM) que no es obstructivo.

Cocacola -Lab/Chatie -

JMorganca/Ollama - Comience rápidamente con Llama 3.3, Mistral, Gemma 2 y otros modelos de idiomas grandes.

CHATGPTNEXTWEB/CHATGPT-NEXT-WEB-CHATGPT, GEMINI y otra interfaz de usuario multiplataforma (UI) le permite tener sus propias aplicaciones de modelo de idioma grande (LLM) de un solo clic.

Xtekky/GPT4Free: el repositorio oficial de GPT4Free contiene una variedad de modelos de lenguaje potentes.

OOBABOOGA/Text-Generation-Webui: una interfaz de usuario web de Gradio para modelos de lenguaje grandes que admiten backends de inferencias múltiples.

RVC-Boss/GPT-Sovits: se pueden usar un minuto de datos del habla para entrenar un buen modelo de síntesis de voz (TTS) (clon de discurso de muestra pequeña).

Gradio -App/Gradio: construya y comparte excelentes aplicaciones de aprendizaje automático de Python. Me gusta apoyar.

McKaywrigley/Chatbot -Ui: todos los modelos ofrecen capacidades de chat de IA.

Operai/OpenAi -Python - La Biblioteca Oficial de Python para Operai API.

Danny-Avila/Librechat: una versión mejorada de ChatGPT con varias características, como diferentes API, modelos y características de IA, y es un proyecto de código abierto autohostado activo.

Sunner/Chatall: chatear con múltiples chatbots (como chatgpt, chat bing, etc.) simultáneamente para encontrar la mejor respuesta.

Gaizhenbiao/Chuanhuchatgpt - Interfaz gráfica de usuario (GUI) para la API de CHATGPT y muchos modelos de idiomas grandes (LLM). Tiene varias funciones, como agentes y QA basados en archivos, y tiene una hermosa interfaz de usuario.

Copilotkit/Copilotkit - React UI e elegante infraestructura para una variedad de aplicaciones de inteligencia artificial como copilot, agente en la aplicación, chatbot y áreas de texto.

MLC-AI/Web-LLM-motor de inferencia de modelos de lenguaje grande (LLM) de alto rendimiento (LLM).

Jina-AI/Clip-As-Service: use un clip para realizar una incrustación escalable, razonamiento y clasificación de imágenes y oraciones.

Chathub-Dev/Chathub-Cliente de chatbot único.

Theramu/Fay - Fay es un marco humano digital de código abierto. Tiene diferentes versiones para diversas aplicaciones.

Sashabaranov/Go -Openai - GO WRAPPER para Operai Chatgpt, GPT - 3, GPT - 4, Dall · E y API Whisper.

SillyTavern/SillyTavern - front -end para usuarios avanzados en modelos de idiomas grandes (LLM).

OpenAI/OpenAI -Node: la biblioteca oficial JavaScript/TypeScript para OpenAI API.

Sebastianstarke/AI4Animation: use inteligencia de computadoras para dar vida a los personajes en la unidad.

xiangsx/gpt4free-ts-proporciona una API Operai GPT-4 gratuita en un proyecto de réplica de una versión de TypeScript de Xtekky/GPT4Free.

WZPAN/Wukong -Robot - Wukong Robot es un proyecto de conversación de voz de voz china simple, flexible y elegante. Admite el diálogo de múltiples ronda CHATGPT y puede ser el primer proyecto de altavoz inteligente de código abierto para admitir la interacción cerebral.

Yihong0618/xiaogpt - Reproducir chatgpt y otros modelos de idiomas grandes (LLM) con los altavoces inteligentes Xiaomi.

NAT/OpenPlayground: un patio de recreo de modelo de idioma grande (LLM) que puede funcionar en una computadora portátil.

PostgreML/Postgresml - Postgres (un sistema de gestión de bases de datos) con GPU para aplicaciones de aprendizaje automático e inteligencia artificial.

Shaunwei/Realchar: cree, personalice y tenga conversaciones en tiempo real con personajes/socios de IA. Use diversas tecnologías para lograr un diálogo de IA sin problemas en cualquier momento y en cualquier lugar.

Parisneo/Lollms -Webui: la interfaz de usuario web del maestro de modelos de idiomas grandes.

Zhayujie/Bot-on-Anything: un constructor de chatbot basado en grandes modelos puede integrar rápidamente modelos de inteligencia artificial como ChatGPT, Claude y Gemini en aplicaciones de software y sitios web como Telegram, Gmail, Slack.

Deanxv/Coze-Discord-Proxy-a través del diálogo de discordia proxy de Boze-Bot, solicite el modelo GPT4 a través de la API, proporcionando funciones como diálogo, gráficos generados por texto, búsqueda de texto y base de conocimiento generada por gráficos.

VOCODEDEV/VOCODE -PYTHON - CONSTRUIR UN AGENTE DE MODELO DE LENGUACIÓN (LLM) basado en voz, modular y código abierto.

Alexrudall/Ruby -Openai - API y Ruby de OpenAi.

Ahmadbilaldev/Langui - Interfaz de usuario de inteligencia artificial. Componentes de viento de cola de código abierto para proyectos GPT, inteligencia artificial generativa y modelos de lenguaje grande (LLM).

Ollama/Ollama -JS - Biblioteca Ollama JavaScript.

Xusenlinzy/API-for-Open-LLM-API de estilo OpenAI para modelos de lenguaje grande abierto. Admite varios modelos, como Llama, ChatGlm, etc.

ANSE -APP/ANSE - CHATGPT, DALL - E y los modelos de difusión estable son una súper experiencia.

MyLXSW/AIDEA-Merver-Aidea es una aplicación multifuncional que admite modelos de lenguaje a gran escala GPT, como Tongyi Qianwen y Wenxin Yiyan), así como utilizados en imágenes literarias y biográficas, imágenes biográficas, SDXL1.0 ,0, Difusión súper estable para resolución y coloración de imágenes.

AALLAM/OPERAI-KOTLIN-Cliente de API de Kotlin OpenAI que admite multiplataforma y coroutinas.

Guinmoon/LLMFarm - Use la biblioteca GGML para LLAMA y otros modelos de idiomas grandes fuera de línea en iOS y MacOS.

Ueo/chatDollkit - ChatDollkit le permite convertir sus propios modelos 3D en chatbots.

Langchain -AI/Langchain: cree una aplicación con capacidades de razonamiento de conciencia situacional.

NOMIC -AI/GPT4All - GPT4All puede ejecutar modelos locales de lenguaje grande (LLMS) en cualquier dispositivo. Es de código abierto y puede usarse con fines comerciales.

Comfyanonymous/COMFYUI: el modelo de difusión más potente y modular tiene interfaces de gráficos/nodos para interfaces gráficas de usuario (GUI), interfaces del programa de aplicaciones (API) y backends.

Langgenius/DiFy - DiFy es una plataforma de desarrollo de aplicaciones de modelos de lenguaje de código abierto (LLM) con una interfaz intuitiva y una variedad de funciones para realizar el proceso desde la producción rápida de prototipos hasta la producción.

LOBEHUB/LOBE -CHAT - LOBE CHAT es un marco de chat de inteligencia artificial de código abierto con diseño moderno. Admite múltiples proveedores de IA, bases de conocimiento y multimodales, y puede implementar aplicaciones de chat privadas de forma gratuita con un solo clic.

LogSpace-AI/Langflow-Langflow es un constructor de aplicaciones de bajo código de bajo código independiente del modelo basado en Python para RAG (generación de mejora de recuperación) y aplicaciones de IA de múltiples agentes. Puede funcionar junto con cualquier API o base de datos.

Run -Llama/Llama_Index - Llamaindex es un marco de datos para aplicaciones de modelo de idioma grande (LLM).

Flowiseai/Flowise: cree su proceso de modelo de lenguaje grande personalizado (LLM) utilizando una interfaz de usuario de arrastrar y soltar.

Chatchat-space/langchain-chatchat-langchain-chatchat (originalmente llamado langchain-chatglm) es una aplicación de generación (trapo) y agente (agente) mejorada por la búsqueda basada en langchain, chatglm, qwen, llama, etc. para el conocimiento local basada en el conocimiento local Modelo de lenguaje grande (LLM).

Go -Skynet/LocalAi: un proyecto de código abierto que puede reemplazar servicios como OpenAI y Claude. Puede ejecutarse en hardware del consumidor y realizar varias tareas, como generar diferentes tipos de medios.

Infiniflow/Ragflow - Ragflow es un motor de trapo de código abierto (generación de mejora de recuperación) para una comprensión profunda de documentos.

MindsDB/MindsDB - El motor de consultas de AGI es una plataforma para construir inteligencia artificial que pueda aprender y responder preguntas sobre datos federados.

Inbedchain/Inbedchain: la capa de almacenamiento de su aplicación de inteligencia artificial.

Songquanpeng/One -Api: este es un sistema de administración y redistribución de claves de OpenAI. Admite múltiples modelos de idiomas grandes (LLMS), tiene una interfaz de usuario inglesa (UI), se puede ejecutar en un solo archivo y tiene imágenes de Docker para una fácil implementación.

Cinnamon/Kotaemon: una herramienta de código abierto basada en la tecnología de generación de mejora de recuperación (RAG) que puede usarse para chatear con documentos.

Labring/FastGPT: FastGPT es una plataforma de conocimiento basada en modelos de idiomas grandes (LLM) que proporciona múltiples funciones para desarrollar e implementar fácilmente sistemas de preguntas y respuestas.

DeepSet -AI/Haystack: un marco de orquestación de inteligencia artificial para construir aplicaciones de modelo de idioma grande (LLM) para tareas como la generación de búsqueda de búsqueda (RAG) y chatbots con métodos de búsqueda avanzados.

Berriai/Litellm - Python SDK y Proxy Server (LLM Gateway) pueden llamar a más de 100 API de modelo de idioma grande (LLM) en formato OpenAI, incluidas API como Bedrock, Azure, etc.

Flairnlp/Flair: un marco muy básico para el procesamiento del lenguaje natural de alto nivel.

Langchain -AI/Langchainjs: crea una aplicación de razonamiento con conciencia de contexto.

Xenova/Transformers.js-La tecnología de aprendizaje automático de última generación para la red permite ejecutar los navegadores sin servidores.

Netease -youdao/Qanything - Preguntas y respuestas basadas en cualquier cosa.

H2OAI/H2OGPT - Chat privado con GPT local, documentos de apoyo, imágenes, videos y otro contenido. Es 100% privado, basado en el protocolo Apache 2.0, admite Ollama, MixTral, Llama.cpp, etc., y hay ejemplos en el enlace dado.

Pathwaycom/LLM-APP-Plantillas de nubes listas para usar para la generación mejorada de recuperación (RAG), tuberías de inteligencia artificial y búsqueda empresarial, pueden procesar datos en tiempo real, amigables con Docker y sincronizarse con diversas fuentes de datos.

Ludwig-Ai/Ludwig: un marco de bajo código para crear modelos de inteligencia artificiales personalizados como modelos de idiomas grandes (LLM) y redes neuronales.

VERCE/AI - CONSTRUCTA APLICACIONES POLVERADAS DE AI UTILIZANDO REACT, SVELTE, VUE Y SOLID.

Microsoft/Prompflow: construya aplicaciones de modelo de lenguaje grande de alta calidad (LLM) a través de prototipos, pruebas, implementación de producción y monitoreo.

No estructurado -io/no estructurado: bibliotecas de código abierto y API para crear tuberías de preprocesamiento personalizadas, como etiquetado, capacitación o tareas de producción en el aprendizaje automático.

DataLement/Bisheng - Bisheng es una plataforma de operación y mantenimiento de modelo de lenguaje grande (LLM) para aplicaciones de inteligencia artificial empresarial. Tiene funciones como el flujo de trabajo generativo de inteligencia artificial (Genai), la generación mejorada de recuperación (RAG) y otras funciones.

JuntasComputer/OpenChatkit -

LLMWARE-AI/LLMWARE-Un marco unificado para crear tuberías de generación de búsqueda (RAG) de búsqueda de búsqueda de nivel empresarial utilizando pequeños modelos dedicados.

Leptonai/search_with_lepton: cree rápidamente una demostración de búsqueda basada en la conversación usando Lepton AI.

DeepTrain-Community/Chatnio-Solución B/C-end de inteligencia artificial de próxima generación, que respalda una variedad de modelos y diversas funciones.

Cadena/fraillit: construya rápidamente la IA conversacional en minutos.

ModelsCope/ModelsCope: ModelsCope convierte el concepto de modelo como un servicio en realidad.

Deeppavlov/Deeppavlov: una biblioteca de código abierto para los sistemas de conversación y chatbots de conversación de extremo a extremo de aprendizaje profundo.

langchain -ai/opengpts -

TASKINGAI/TASKINGAI: una plataforma de código abierto para desarrollar aplicaciones de inteligencia artificial nativa.

WENDA-LLM/WENDA-Wenda es una plataforma de llamadas de modelo de lenguaje grande (LLM) diseñada para generar eficientemente contenido en un entorno específico, teniendo en cuenta las limitaciones de los recursos informáticos empresariales personales y pequeños y medianos, así como la seguridad del conocimiento y la privacidad asuntos.

Rustformers/LLM: un ecosistema de biblioteca de óxido sin mantenimiento para manejar modelos de idiomas grandes. Vea el archivo ReadMe para obtener más detalles.

Josstorer/RWKV -Runner: una herramienta de administración y administración de RWKV totalmente automática de 8MB con una interfaz compatible con la API de OpenAI. RWKV es un modelo de lenguaje grande que es de código abierto y está disponible comercialmente.

langchain4j/langchain4j - versión java de langchain.

OpenBMB/Toolbench: una plataforma abierta para capacitación, servicio y evaluación de modelos de idiomas grandes para el aprendizaje de herramientas (ICLR'24 Focus Paper).

Microsoft/Flaml: una biblioteca rápida para el aprendizaje automático automático (AUTOML) y el ajuste de los parámetros. También hay un enlace para unir a Discord (un software de chat).

Microsoft/LMOPS: una tecnología general para realizar capacidades de inteligencia artificial a través de modelos de idiomas grandes (LLM) y modelos de lenguaje grande (MLLMS) multimodales.

LLM-Workflow-Engine/LLM-Workflow-Engine-Power CLI y Workflow Manager para modelos de idiomas grandes (paquetes centrales).

Timescale/PGAI: un conjunto de herramientas para el desarrollo más fácil de la generación mejorada de búsqueda (RAG), búsqueda semántica y otras aplicaciones de IA utilizando PostgreSQL.

FreedomIntelligence/LLMZoo - LLM Zoo es un proyecto que proporciona datos, modelos y puntos de referencia de evaluación para modelos de idiomas grandes.

Casibase/Casibase - AI Cloud es una base de conocimiento de generación de recuperación de código abierto (RAG) similar a Langchain. Admite múltiples modelos y tiene charlas y demostraciones administrativas de interfaz de usuario (UI).

GetZep/Zep - Zep: la base de memoria de su pila de IA.

Leptonai/Leptonai - Un marco de Python para simplificar la construcción de servicios de inteligencia artificial.

Pezzolabs/Pezzo: una plataforma LLMOPS de código abierto y desarrollador para simplificar el trabajo en todos los aspectos, como el diseño rápido y la gestión de versiones.

Cheshire-Cat-AI/Core-Microservicios de proxy de inteligencia artificial.

Aurelio-Labs/Semantic Router: inteligencia artificial de ultra alta velocidad para la toma de decisiones de datos multimodales y procesamiento inteligente.

Install-AI/VDP: Instill Core es una herramienta de infraestructura de IA de pila completa para datos, modelos y orquestación de tuberías que simplifica el proceso de construir múltiples aplicaciones AI-primero.

Inteligencia/Intel-Extension-para transformadores: use tecnología de compresión de última generación para construir rápidamente sus chatbots en su dispositivo y ejecutar modelos de lenguaje grandes de manera eficiente en las plataformas Intel.

GRIPTAPE -AI/GRIPTAPE: un marco modular de Python para agentes de inteligencia artificiales y flujos de trabajo con razonamiento de cadena de pensamiento, herramientas y capacidades de memoria.

Run-Llama/LlamAindexts-Aplicaciones del marco de datos para el modelo de idioma grande (LLM) con un enfoque en soluciones del lado del servidor.

Agente -AI/Agente: una plataforma LLMOPS de código abierto que integra el patio de juegos de palabras rápidas, la gestión de palabras rápidas, la evaluación del modelo de lenguaje grande (LLM) y la observabilidad del modelo de lenguaje grande.

Marella/Ctransformers: la unión de Python proporcionó modelos de transformadores en C/C ++ a través de la biblioteca GGML.

Devflowinc/Trieve: una infraestructura basada en API que integra búsqueda, recomendación, generación de búsqueda de búsqueda (RAG) y análisis.

Yangling0818/RPG-DiffusionMaster-[ICML 2024] Juegos de juego de roles de difusión maestros de texto a imagen (RPG) a través de reubregados, planificación y generación de modelos de idiomas grandes (LLM) multimodales.

TryPromptly/LLMStack: un marco múltiple sin codificación para construir agentes, flujos de trabajo y aplicaciones de Modelo de lenguaje grande (LLM) que utilizan sus datos.

GetZep/Graphiti: construya y consulta gráficos de conocimiento dinámico con conciencia del tiempo.

Kimmeen/Time-LLM-Implementación oficial de "Time-LLM: Predicción de series de tiempo al reprogramarse modelos de idiomas grandes" en ICLR 2024.

Flonoum/Flonoum: modelo de inteligencia instantánea, controlable y artificial en el lenguaje de óxido de pre -entrenado localmente.

Jina-Ai/Langchain-Servicio-Aplicación Langchain producida con Jina y Fastapi.

Squeezeailab/LLMCompiler - LLM Compiler (LLMCompiler) propuesto en la Conferencia Internacional de Aprendizaje Machine (ICML) de 2024 es un compilador de modelo de idioma grande (LLM) para llamadas de funciones paralelas.

AndreibonDarev/Langchainrb - Cree una aplicación alimentada por un modelo de lenguaje grande (LLM) usando Ruby.

Psychic-API/Rag-stack: implementa una versión privada de la alternativa ChatGPT en una nube privada virtual (VPC), conéctese a la base de conocimiento de su organización y admite modelos de idiomas grandes de código abierto (LLMS).

DAGWORKS-INC/BURR: construya aplicaciones para la toma de decisiones, como los chatbots, y gestionarlas en su propia infraestructura.

Intellabs/Fastrag - Mejora de búsqueda eficiente y marco de generación.

SOBELIO/LLM-CHAIN-"LLM-CHAIN" es una potente caja de óxido (caja, que puede entenderse como una base de código) utilizada para construir cadenas en modelos de idiomas grandes, implementar el resumen de texto y la finalización de tareas complejas.

Microsoft/Windows-Ai-Studio-

Vercel/Modelfusion: una biblioteca TypeScript para crear aplicaciones de inteligencia artificial.

axflow/axflow: un marco de mecanografiado para el desarrollo de inteligencia artificial.

Gabrielchua/RagXplorer: una herramienta de código abierto para visualizar su generación de mejora de búsqueda (RAG).

Parthsarthi03/Raptor - Implementación oficial de Raptor (Raptor) para la recuperación de la organización similar a los árboles a través del procesamiento recursivo de abstracción.

Google/Generative-AI-Swift: la biblioteca oficial de Swift para Google Gemini API.

Pinecone -IO/Canopy - Recuperación de recuperación (RAG) Marco y contexto motor alimentado por Pinecone.

Safevideo/Autollm: lanza aplicaciones de red de modelo de idioma grande (LLM) basadas en la generación de búsqueda de búsqueda (RAG) en segundos.

OpenAI/Whisper: habilite el reconocimiento de voz robusto a través de una supervisión débil a gran escala.

CompVIS/Difusión estable: un modelo potencial de difusión de texto a imagen.

FacebookResearch/Llama - Código de inferencia para modelos de LLAMA.

XAI-ORG/GROK-1-Se lanzó la versión pública de Grok.

Estabilidad -AI/Establecido Infusión: síntesis de imagen de alta resolución utilizando modelos de difusión potencial.

Karpathy/Nanogpt: la biblioteca más fácil y rápida para el entrenamiento/ajuste de GPT de tamaño mediano.

TENCENTARC/GFPGAN - GFPGAN se centra en crear algoritmos prácticos para la reparación de la cara en escenarios de la vida real.

llyasviel/controlnet -

TATSU -LAB/STANFORD_ALPACA - Código y documentación para capacitar a los modelos Stanford Alpaca y generar datos.

MetAllama/Llama3 - Sitio web oficial de Meta Llama 3 GitHub.

Estabilidad-AI/modelos generativos: modelos generativos de estabilidad ai

Lucidrains/Vit -Pytorch - Implementación del transformador de visión en Pytorch, utilizando solo un codificador de transformador para alcanzar el nivel más avanzado (SOTA) en las tareas de clasificación visual.

Difusión de Apple/ML-Estable: difusión estable usando Core ML en Silicon de Apple.

FacebookResearch/Codellama - Código de inferencia para el modelo Codellama.

QWENLM/QWEN - La base de código oficial de Qwen, Tongyi Qianwen es un modelo de lenguaje a gran escala propuesto por Alibaba Cloud.

AI4FINANCE -FUNDATION/FINGPT - FINGPT - Modelo de lenguaje a gran escala de finanzas de código abierto. Modelo de entrenamiento lanzado en Huggingface.

Spaces de estado/Mamba - Arquitectura de Mamba SSM

BlinkDL/RWKV -LM - RWKV es una red neuronal recurrente (RNN) que funciona bien en modelos de idiomas grandes (LLM) y puede ser entrenada como un transformador GPT. Tiene las características de excelente rendimiento y tiempo lineal.

CompVIS/Difusión latente: síntesis de imagen de alta resolución utilizando modelos de difusión potencial.

QWENLM/QWEN1.5 - Tongyi Qianwen 2.5 es una serie de modelos de lenguaje a gran escala desarrollada por el equipo de Alibaba Cloud Tongyi Qianwen.

Lucidrains/Dalle2 -Pytorch: una red de red neuronal para la síntesis de texto y gráficos que implementa la actualización de OpenAI en Pytorch - E 2.

NVIDIA/MEGATRON-LM-Continúa la investigación sobre el entrenamiento a gran escala de los modelos de transformadores.

Guoyww/Animatediff: la implementación oficial de Animatediff.

Databrickslabs/Dolly: Databricks 'Dolly es un modelo de lenguaje grande capacitado en la plataforma de aprendizaje automático de Databricks.

MLFoundations/Open_clip: una implementación de código abierto del clip (pre-entrenamiento de imagen de lenguaje de contraste).

Thudm/Cogvideo - Texto e imagen a la generación de videos: Cogvideox (2024) y Cogvideo (Conferencia internacional de 2023 sobre el aprendizaje de caracterización)

AIGC -Audio/Audiogpt - Audiogpt está relacionado con la comprensión y la generación de avatares de voz, música, sonido y habla.

NLPXUCAN/WizardLM - Modelos de lenguaje grande (LLM) se basan en Evol Insturct (Instrucciones EVOL): WizardLM (Wizard Language Model), WizardCoder (Wizard Coder), WizardMath (Wizard Mathematics).

Lucidrains/Denoising-Diffusion-Pytorch-Implementación de un modelo de probabilidad de difusión de Denoising en Pytorch.

Thudm/CodeGeEx - CodeGeEx es un modelo de generación de código multilingüe de código abierto (KDD 2023).

Vaibhavs10/Insanely-Fast-Whisper-

01-AI/YI: una serie de modelos de idiomas grandes desarrollados desde cero por los desarrolladores 01-AI.

Lucidrains/Palm-Rlhf-Pytorch-Implementación de aprendizaje de refuerzo de retroalimentación humana (RLHF) similar a ChatGPT en Palm.

Humanaigc/emo: use el modelo Audio2Video Diffusion para generar videos de retratos expresivos: retratos de emoticones vívidos.

Alembics/Disco -difusión: no se proporciona una descripción traducible.

OpenLM -Research/Open_llama - Openllama es una réplica de código abierto de Llama 7b de Meta AI con un acuerdo de licencia suelta y está capacitado en el conjunto de datos de Redpajama.

OpenBMB/MinicPM - MinicPM3 - 4B, un modelo de lenguaje grande (LLM) en el borde, con mejor rendimiento que GPT - 3.5 - Turbo.

GrandeworldModel/LWM - Modelo mundial grande para modelado de texto y videos con millones de grandes contextos.

Liheyoung/profundidad-cualquier-"Deep todo: desatar el poder de los datos sin marcar a gran escala", un modelo básico para la estimación de profundidad basado en imágenes monoculares en la conferencia 2024 sobre visión por computadora y reconocimiento de patrones (CVPR).

OpenAI/Point -E - La difusión de la nube de puntos se usa para la síntesis del modelo 3D.

Google-Research/Text-to-Text-transformer-Código para el documento "Explorando los límites del aprendizaje de transferencia con un convertidor de texto a texto unificado"

Lightning-AI/Lit-Llama: la implementación del modelo de lenguaje de LLAMA basada en Nanogpt admite una variedad de características como mecanismo de atención rápida, cuantificación, ajuste fino y pre-entrenamiento, y tiene licencia bajo la licencia Apache 2.0.

OpenGVLab/Llama-Adapter: en la Conferencia Internacional de Caracterización de Aprendizaje de 2024 (ICLR), LLAMA se ajusta en 1 hora para seguir las instrucciones utilizando 1.2 millones de parámetros.

NVIDIA/DALI - Una biblioteca de aceleración de GPU (Procesador Gráfico) tiene bloques de construcción y motores de ejecución altamente optimizados para el procesamiento de datos para acelerar las aplicaciones de capacitación e inferencias de aprendizaje profundo.

Allenai/Olmo - Código Olmo para modelado, capacitación, evaluación y razonamiento.

Salesforce/Codegen: Codegen es una serie de modelos de código abierto para la síntesis de programas, capacitado en TPU -V4, comparable a OpenAI Codex.

Lucidrains/X -Transformers: un transformador altamente enfocado, conciso y completo con características experimentales de múltiples documentos.

Scir-Hi/Huatuo-Llama-Med-Chinese-Ben Cao (anteriormente conocido como Hua Tuo), una biblioteca de modelos que utiliza el conocimiento médico chino para ajustar las instrucciones en modelos de idiomas grandes.

Modelo de consistencia de Luosiallen/Latente-Modelo de consistencia latente: síntesis de imágenes de alta resolución por inferencia de pasos pequeños.

Microsoft/Biogpt -

Google-Research/SIMCLR-SIMCLRV2: Los grandes modelos auto-supervisados son poderosos estudiantes semi-supervisados.

LLSourCell/Doctor-Dignity-Doctor Dignity es un modelo de idioma grande (LLM) que puede aprobar el Examen de Licencia Médica de EE. UU. (USMLE), estar fuera de línea, multiplataforma y proteger la privacidad de datos saludables.

Google -Research/Multinerf - Liberación de código para MIP - Nerf 360, Ref - Nerf y Rawnerf.

JayMody/Picogpt: un GPT muy pequeño implementado con la versión Numpy - 2.

Google-Research/Albert-Albert es una versión simplificada de Bert (representaciones de codificadores bidireccionales de Transformers) para el aprendizaje auto-supervisado de la representación del lenguaje.

Project-Baize/Baize-Chatbot: use ChatGPT durante horas con solo una GPU.

Salesforce/Codet5 - Codet5 está diseñado para proporcionar soporte para la comprensión y generación de código para modelos de idiomas grandes (LLM) de código abierto.

FacebookResearch/JEPA - Código Pytorch y modelo para el aprendizaje auto -supervisado de los videos a través de la visión - basado en arquitectura de predicción de incrustación conjunta (V -JEPA).

PaperswithCode/Galai - Interfaz del programa de aplicaciones modelo de Galactica.

DVLAB -Research/Longlora - Código y documentación para Longlora y Longalpaca (Informe verbal ICLR 2024).

BAAIVISION/PINTOR - Serie de pintor y SEGGPT: Modelo de Visual Basic del Instituto de Investigación de Inteligencia Artificial de Beijing Zhiyuan (BAAI).

Databricks/DBRX - Ejemplos de código y recursos para el modelo de lenguaje grande DBRX para Databricks.

ESTADO ESPACIOS/S4 - Modelo de secuencia de espacio de estado estructurado.

Google-Research/Electra: el codificador de texto previo a los entrenamientos de electra como discriminador en lugar de generador.

ELEUTHERAI/PYTHIA - Centro de investigación sobre interpretabilidad y dinámica de aprendizaje.

ISE -UIUC/Magicoder - Magicoder (ICML'24) implementa la generación de código a través de directivas de código abierto (OSS - instructo).

EPFLLM/MEDITRON - MEDITRON es un modelo de lenguaje grande de código abierto.

Metaglm/Finglm - FingLM tiene como objetivo construir un proyecto de modelo financiero abierto, de bienestar público y abierto para promover el desarrollo de "AI+Finance" a través de código abierto.

Deepseek-ai/Deepseek-llm-Modelo de lenguaje grande Deepseek (LLM): habrá una respuesta.

Allenai/Scispacy: tuberías y modelos completos para la documentación científica/biomédica.

Apple/ML-4M-4M: modelado de máscara multimodal a gran escala.

Google -Research/Language: una biblioteca compartida para el proyecto de código abierto del equipo de lenguaje de inteligencia artificial de Google.

Google/Maxtext: un modelo de lenguaje grande Jax (LLM) simple, de alto rendimiento y escalable.

NetEase -Youdao/BCembedding - Modelo de código abierto para recuperar productos de generación mejorada (RAG) (incrustación y recurso).

Shi -Labs/OneFormer - OneFormer en CVPR 2023 es un transformador para la segmentación de imágenes universales.

Google -Research/Flan -

Las bases de código LXTGH/OMG-SEG-OMG-LLAVA y OMG-SEG están relacionadas con CVPR-24 (Conferencia de reconocimiento de visión y patrones de la computadora-2024) y Neurips-24 (Conferencia del Sistema de Procesamiento de Información Neural-2024).

Shi-Labs/Versátil-difusión-Difusión versátil: un modelo de difusión que combina texto, imágenes y variantes, publicado en la plataforma Preprint ARXIV en 2022 y presentado en la Conferencia Internacional sobre Visión Computadora (ICCV) en 2023.

Modelos de terminación de series de tiempo/LAG-LLAMA-LAG-LLAMA: Métodos para predecir modelos básicos de series de tiempo probabilísticas

OpenAI/LM-Human-Preferences-Código para documentos sobre el modelo de lenguaje ajustado.

IBM/Dromedary - Dromedary está diseñado para ser un modelo de lenguaje a gran escala útil, ético y confiable.

Dauparas/ProteinMpnn: el código de papel llamado ProteinMpnn.

Shi-Labs/Vecindad-Atention-Transformer-Transformador de atención del vecindario publicado en ARXIV en 2022 y CVPR en 2023. Además, el transformador de atención del vecindario hueco publicado en ARXIV en 2022.

Thudm/SwisSarmytransformer - Swissarmytransformer es una biblioteca flexible y poderosa para desarrollar variantes de transformadores.

ctllllll/llm -toolmaker -

XWIN-LM/XWIN-LM-XWIN-LM: una alineación del modelo de lenguaje grande potente, estable y reproducible.

Microsoft/Tora - Tora (para ICLR'24) es un agente modelo de lenguaje grande con herramientas integradas para resolver problemas de razonamiento matemático difíciles.

Salesforceairesearch/UNI2TS: el transformador de predicción de la serie temporal universal está entrenado de manera uniforme.

Replic/repliclM - ReplicLm Model Serie Código de inferencia y configuración.

HazyResearch/Safari - Convolución en el contexto del modelado de secuencias.

Fight41Love/Funnlp -

LINEXJLIN/GPTS - Consejos de fuga relacionados con GPT.

E2B-DeV/Awesome-AI-Agents: una serie de agentes autónomos para inteligencia artificial.

Eugeneyan/Open -LLMS: una lista de modelos de idiomas grandes (LLM) disponibles para uso comercial.

Shubhamsaboo/Awesome-LLM-Apps: un gran conjunto de aplicaciones de modelo de lenguaje grande (LLM) con capacidades de generación mejorada de búsqueda (RAG) que usan modelos OpenAI, antrópicos, gemini y de código abierto.

Rucaibox/LLMSurvey: una encuesta de modelos de idiomas grandes, la página oficial de GitHub para este documento de encuesta.

Woooodyy/LLM-Agent-Paper-List: una lista de documentos sobre el aumento y el potencial de los agentes basados en modelos de idiomas grandes: una revisión, escrita por Xi Zhiheng (transliteración) y otros

Steven2358/Awesome-Generative-AI-Lista de proyectos y servicios de inteligencia artificial generativo contemporáneo.

WGWANG/LLMS-In-China-Modelo chino a gran escala.

Modelos LonePatient/Awesome Pretrined-Chinese-NLP: una serie de modelos de petróleo chinos de alta calidad, modelos grandes, modelos multimodales y modelos de idiomas grandes.

TensorChord/Awesome -LLMOPS: una gran lista de excelentes herramientas LLMOPS seleccionadas para desarrolladores.

Opendilab/Awesome -RLHF: una lista continuamente actualizada de recursos de aprendizaje de refuerzo basado en comentarios humanos.

DSXIANGLI/DECRYPTPROMPT - Resumen de la aplicación de modelos de idiomas rápidos y grandes (LLM), datos y modelos de código abierto, y contenido generado por inteligencia artificial (AIGC).

FreedomIntelligence/Medical_NLP - Competencia de procesamiento de lenguaje natural médico, conjuntos de datos, modelos y documentos grandes.

Archinetai/Audio-AI-Timeline: una línea de tiempo para los últimos modelos de IA generados por audio a partir de 2023.

Chiphuyen/AIE -Book - Recursos de ingenieros de IA y materiales auxiliares para ingeniería de inteligencia artificial (Chip Hughn, 2025).

Egoalpha/aviso en el aprendizaje de contexto: un recurso de alta calidad para el aprendizaje de contexto y la ingeniería rápida. Masta modelos de idiomas grandes con las últimas actualizaciones como ChatGPT, GPT-3 y Flant5.

Taranjeet/Awesome -GPTS: una colección de todos los GPT (convertidores previos a los petróleo) producidos por la comunidad.

CFAHLGREN1/NATURAL-SQL-Una serie de modelos de lenguaje grande de texto de texto a SQL de alto rendimiento.

Yokoffing/ChatGpt -ProMPts - Administración de palabras de inmediato para ChatGPT y Bing AI.

GGERGANOV/LLAMA.CPP - Inferencia de modelo de lenguaje grande (LLM) en C/C ++.

GGERGANOV/WHISPER.CPP - Una versión portada del modelo Whisper de OpenAI escrito en C/C ++.

Karpathy/LLM.C - Entrenar un modelo de lenguaje grande (LLM) utilizando C/CUDA crudo simple.

Mozilla -Odo/LlamaFile: use solo un archivo para distribuir y ejecutar modelos de idiomas grandes (LLM).

UnslotHai/Unsloth: aumente las velocidades de ajuste fino de Llama 3.3, Mistral, Phi, Qwen 2.5 y Gemma Language Models (LLMS) en 2-5 veces mientras usa un 70% menos de memoria.

MLC-AI/MLC-LLM-Un motor de implementación de Modelo de Lenguaje Grande Universal (LLM) con capacidades de compilación de aprendizaje automático (ML).

Karpathy/Llama2.C - Inferlama 2 en un solo archivo C puro.

DAO-ALAB/ATENCIÓN FLASH-Mecanismo de atención preciso rápido y eficiente, tanto rápido como para ahorrar memoria.

Openai/Triton: una biblioteca de desarrollo para el lenguaje y el compilador de Triton.

Microsoft/Bitnet: marco de inferencia oficial para modelos de lenguaje grande de 1 bits (LLMS).

GGERGANOV/GGML - Una biblioteca tensor para el aprendizaje automático.

NVIDIA/TENSORRT - NVIDIA Tensorrt es un kit de herramientas de desarrollo de software (SDK) para el razonamiento de aprendizaje profundo de alto rendimiento en las GPU NVIDIA. Este repositorio tiene sus componentes de código abierto.

BigScience-Workshop/Petals: ejecute modelos de idiomas grandes (LLMS) en casa de una manera, ajuste y las velocidades de inferencia de forma bittorrent hasta 10 veces más rápido que la descarga.

NVIDIA/TENSORT-LLM-Tensorrt-LLM proporciona una API de Python fácil de usar para definir modelos de idiomas grandes (LLMS) y construir un motor tensorrt optimizado para una inferencia de GPU eficiente, y tiene un tiempo de ejecución de Python y C ++ para crear Python y C ++ Runtimes Runtimes para ejecutar componentes de estos motores.

Inteligencia-Analítica/BigDL-Acelerar la inferencia del modelo de lenguaje grande local (LLM) y el ajuste fino en Intel XPUS e integrarse con varios marcos relacionados.

Inteligencia-Analytics/IPEX-LLM-Acelere la inferencia local del modelo de lenguaje grande (LLM) y el ajuste fino en Intel XPU (procesador acelerado para la arquitectura Intel) e integra con una variedad de herramientas.

Timdettmers/Bitsandbytes: un modelo de lenguaje grande accesible a través de la cuantificación de K -bit de Pytorch.

Google/Gemma.CPP: un motor de inferencia C ++ independiente ligero para los modelos Google Gemma.

NVIDIA/CUTLASS - plantilla CUDA para subrutinas de álgebra lineal.

Pytorch-Labs/GPT-Fast: use menos de 1000 líneas de código Python para implementar un transformador de Pytorch nativo simple y eficiente para la generación de texto.

Panqiwei/Autogptq: un paquete de cuantificación de modelo de lenguaje grande basado en el algoritmo GPTQ, interfaz fácil de usar y fácil de usar.

Turboderp/Exllamav2: una biblioteca de inferencia rápida para ejecutar modelos de idiomas grandes (LLM) localmente en GPU de grado de consumo común.

OpenNMT/Ctranslate2 - Motor de inferencia del modelo de transformador rápido.

ZTXZ16/FASTLLLM - Una biblioteca de aceleración de Modelo de lenguaje grande de plataforma completa (LLM) de C ++ C ++ que admite llamadas de Python. Puede hacer que el modelo de nivel CHATGLM-6B de una sola tarjeta alcance más de 10,000 tokens por segundo, soporte GLM, LLAMA, MOSS BASIC MODEDS y se ejecute sin problemas en dispositivos móviles.

QWOPQWOP200/GPTQ-FOR-LLAMA-Quantize Llama en 4 bits usando GPTQ.

Vainf/antorcha -publicidad - [CVPR 2023] Depgraph: poda de estructuras arbitrarias.

Turboderp/Exllama: una versión de reescritura de la versión HF Transformers de LLAMA para cuantificar los pesos, con más eficiencia de memoria.

Lucidrains/Vector-Quantize-Pytorch-Cuantización de vector (y escalar) en Pytorch

MIT-Han-Lab/LLM-AWQ-AWQ: Cuantificación de peso consciente de activación (método) para la compresión y la aceleración de modelos de idiomas grandes ganaron el premio al Mejor Papel 2024 MLSYS.

Jittor/Jittorllms: la biblioteca de inferencias de modelo Jittor tiene las características de alto rendimiento, bajos requisitos de configuración, buen soporte chino y portabilidad.

FasterDecoding/Medusa - Medusa: un marco simple que acelera la generación de modelos de idiomas grandes (LLM) a través de terminales de decodificación múltiples.

Intel/Neural-Compressor: la cuantización de LLM de baja bits de SOTA (incluyendo int8/fp8/int4/fp4/nf4) y la escasez son técnicas de compresión modelo líderes para tensorflow, pytorch y ONNX tiempos de ejecución.

NeuralMagic/Sparseml: una biblioteca que facilita la aplicación fácil de escasez a las redes neuronales, lo que resulta en modelos más rápidos y más pequeños.

IST-DASLAB/GPTQ: el código en papel sobre la cuantización precisa posterior al entrenamiento de los transformadores de pre-entrenamiento generativo (GPT) en la Conferencia Internacional de Caracterización de Aprendizaje (ICLR) de 2023, llamada "GPTQ".

HazyResearch/Thunderkittens - Primitivas de baldosas para núcleos rápidos.

Utilens/utensor: una biblioteca de inferencia de inteligencia artificial de aprendizaje micro automático.

Pytorch -Labs/AO - Quantización nativa de Pytorch y escasez para el entrenamiento y el razonamiento.

Saharnooby/rwkv.cpp - int4/int5/int8 y fp16 inferencia en CPU para el modelo de lenguaje RWKV.

MIT-Han-Lab/Smoothquant-Smoothquant: cuantificación precisa y eficiente posterior al entrenamiento de modelos de lenguaje grande.

Lightning-AI/Lightning-Thunder-Thunder es un compilador de fuente a fuente de Pytorch que puede aumentar la velocidad del modelo hasta en un 40% y usar diferentes actuadores de hardware en GPU múltiples.

Pytorch-Labs/Segment-Anything-Fast-Un segmento para razonamiento fuera de línea de lotes-cualquier versión.

VAHE1994/AQLM - Biblioteca oficial de Pytorch, que contiene dos documentos sobre la compresión extrema de modelos de lenguaje grande: uno se cuantifica por suma (https://arxiv.org/pdf/2401.06118.pdf), y el otro es PV - Ajuste fino (HTTPS (HTTPS : //arxiv.org/abs/2405.14852).

Hao-Ai-Lab/LookAheadDecoding: use la decodificación de LookAhead para romper las dependencias secuenciales en la inferencia del modelo de lenguaje grande (LLM) (ICML 2024).

Horseee/LLM -Primer - [Neurips 2023] Modelos de lenguaje grande (como Llama - 3/3.1, Llama - 2, Llama, etc.) Estructura Pruned LLM - Pruner.

Kuleshov/Minillm - Minillm es un sistema que ejecuta modelos modernos de lenguaje grande (LLM) en GPU de grado de consumo de una manera mínima.

Binary -Husky/GPT_ACademic: proporciona una interfaz interactiva práctica para modelos de lenguaje grande (LLM) como GPT/GLM, especialmente optimiza la lectura en papel, la experiencia de pulido y escritura. Admite múltiples funciones e integra múltiples modelos.

iMartinez/privateGPT: use GPT para interactuar con documentos de forma privada, sin violación de datos.

Las aplicaciones Mintplex-Labs/Anything-LLM-Desktop y Docker AI están integradas, con generación de mejora de recuperación (RAG) y proxy de IA.

KHOJ-AI/KHOJ-Es un segundo cerebro de inteligencia artificial que puede obtener respuestas de varias fuentes, construir agentes personalizados, organizar tareas automatizadas y realizar investigaciones, y puede transformar grandes modelos de idiomas en artificialidad personal para obtener inteligente gratuito.

PromTEngineer/LocalGPT - Chat en privado con documentos locales a través del modelo GPT, los datos no abandonan el dispositivo.

Kaixindelele/chatpaper: use ChatGPT para acelerar la investigación científica, incluido el resumen de los documentos ARXIV, la traducción profesional, el pulido, la revisión por pares y la respuesta a la revisión por pares.

Assafelovic/GPT -Researcher - Agente autónomo basado en un modelo de lenguaje grande (LLM) lleva a cabo investigaciones locales y web sobre cualquier tema y crea un informe integral con citas.

ARC53/DOCSGPT: los chatbots de documentos pueden chatear con datos, implementar en privado e integrar el conocimiento en flujos de trabajo de IA para compartir.

MayoOear/GPT4-PDF-CHATBOT-LANGCHAIN-Chatbot GPT4 y Langchain para grandes documentos PDF.

DANSWER -AI/DANSWER - GEN - El chat AI para equipos es como ChatGPT, pero puede obtener un conocimiento especial del equipo.

Josstorer/chatgptbox - Integra profundamente el chatGPT en su navegador. Todo lo que necesitas está aquí.

FacebookResearch/Nougat: aplicación de nougat en la comprensión neurooptica de los documentos académicos.

Bhaskatripathi/PDFGPT - PDF GPT puede interactuar con el contenido de PDF a través de las capacidades GPT y es una solución efectiva de código abierto para convertir PDF en un chatbot.

Whitead/Paper-QA-Tecnología de generación de búsqueda de alta precisión mejorada (RAG) para responder preguntas citadas basadas en literatura científica.

Weaviate/Verba - Un chatbot de generación mejorada (trapo) con Weaviate.

Run -Llama/Rags: use sus datos para crear chatgpt, todo en lenguaje natural.

Muisedestiny/Zotero -GPT - GPT se encuentra con Zotero.

Madawei2699/mygptreader: un método impulsado por la comunidad para interactuar con robots de inteligencia artificial utilizando chatgpt.

Swirlai/Swirl -Search - AI Search & Rag puede obtener respuestas instantáneas del conocimiento de la empresa en numerosas aplicaciones al tiempo que garantiza que los datos sean seguros y rápidos.

Dvorka/Mindforger: una nota de pensamiento y un editor de Markdown.

KHA-WHITE/MANGA-OCR-Se utiliza principalmente para el reconocimiento de caracteres ópticos de personajes japoneses en cómics japoneses.

NLMATICS/LLMSHERPA - Interfaz del programa de aplicaciones de desarrolladores (API) para acelerar proyectos de Modelo de Lengua grande (LLM).

UCBepic/DOCETL: un sistema de procesamiento de datos y ETL (decisión, transformación, carga) impulsado por el modelo de lenguaje autónomo (LLM).

KnowledGeCanvas/Conocimiento: el conocimiento es una herramienta utilizada para diversas operaciones (como guardar, búsqueda, etc.) de sitios web, documentos y archivos.

ROTATEMWEISS57/GPT-Newspaper: un agente autónomo basado en GPT que puede crear periódicos personalizados basados en las preferencias del usuario.

NLMatics/NLM-inestor: este repositorio proporciona código del lado del servidor para conexiones y analgésicos de la API LLMSHERPA para diferentes formatos de archivo.

KHA -WHITE/MOKURO - Lea los cómics japoneses con texto seleccionable en su navegador.

Brucemacd/Chatd: chatea con tus documentos a través de la IA local.

Akshata29/Entaoai: use sus propios datos para chatear y hacer preguntas. Cargue rápidamente los datos empresariales para usar los servicios de OpenAI para chatear y hacer preguntas sobre datos cargados.

ABI/Captura de captura a código: inserte una captura de pantalla y conviértala en código conciso (HTML/Tailwind/React/Vue).

GPT-Engineer-ORG/GPT-Engineer: una plataforma basada en terminales para experimentar ingenieros de software de inteligencia artificial, a diferencia de https://gptengineer.app.

OpenDevin/OpenDevin - OpenHands: implementa más funciones con menos código.

Pythongora-IO/GPT-Pilot: la primera persona en convertirse realmente en desarrollador en el campo de la inteligencia artificial.

GetCursor/Cursor - Editor de código de inteligencia artificial.

OpenBMB/ChatDev: cree un software personalizado basado en ideas de lenguaje natural a través de la colaboración de múltiples agentes con modelos de idiomas grandes (LLM).

Paul -Gauthier/Aider - Aider es programación de emparejamiento de inteligencia artificial en terminales.

Tabbyml/Tabby: un asistente de codificación AI autohospedado.

Continúa/Continuar - Continuar es un asistente de código de inteligencia artificial de código abierto. Se puede conectar a modelos y contextos para autocompletar y chat personalizado en VS Code y JetBrains.

Stageai/Devika - Devika es un agente ingeniero de software de inteligencia artificial que puede comprender las instrucciones humanas, desglosar instrucciones, realizar investigaciones y escribir código. Su objetivo es ser una alternativa de código abierto a Devin desarrollado por Cognition AI, y no hay un sitio web oficial.

Emilwallner/captura de pantalla para código: una red neuronal para convertir modelos de diseño en sitios web estáticos.

Fauxpilot/Fauxpilot - Fauxpilot es una alternativa de código abierto a los servidores de copilot github.

Eosphoros-AI/DB-GPT-Marco de desarrollo de aplicaciones de datos de inteligencia artificial nativa con AWEL (lenguaje de expresión de flujo de trabajo agistrator) y agentes.

Princeton-NLP/SWE-Agent-SWE-Agente soluciona automáticamente problemas de GitHub utilizando GPT-4 u otros modelos de lenguaje, y también puede usarse para desafíos ofensivos de ciberseguridad o programación competitiva. [Neurips 2024]

SINAPTIK-AI/PANDAS-AI-Interactúa con varias bases de datos (SQL, CSV, etc.) y use Pandasai para realizar análisis de datos conversacionales a través de modelos de lenguaje grande (LLM) y búsqueda de generación aumentada (RAG).

Vanna -AI/Vanna - Interactúa con su base de datos SQL. Genere declaraciones precisas de texto a SQL a través de modelos de idiomas grandes (LLM) utilizando la tecnología de generación basada en la búsqueda (RAG).

Shishirpatil/gorila - gorila: capacitación y evaluación de grandes modelos de idiomas para llamadas de funciones (llamadas de herramientas).

Codota/Tabnine: la finalización del código AI se refiere a la función de un sistema de IA para proporcionar a los programadores sugerencias o segmentos de código completos.

Ther1D/Shell_GPT: una herramienta de productividad de línea de comandos alimentada por modelos de lenguaje grande de IA como GPT -4, ayuda a completar las tareas más rápido y de manera más eficiente.

NUTLOPE/AICOMMITS: una interfaz de línea de comandos (CLI) que utiliza inteligencia artificial para escribir información de envío Git para usted.

Greydgl/Pentestgpt: una herramienta de prueba de penetración capacitada por GPT.

Joshpxyne/GPT -Migrate: migra fácilmente su base de código entre marcos o idiomas.

KUAFUAI/DevOpSGPT: un sistema de desarrollo de software de desarrollo de software con inteligencia artificial combina modelos de idiomas grandes (LLM) con herramientas DevOps para transformar los requisitos de lenguaje natural en software ejecutable, admitiendo cualquier lenguaje de desarrollo y extender el código existente.

Di -Sukharev/OpenCommit: el envoltorio GPT para GIT puede generar mensajes de confirmación en 1 segundo usando un modelo de lenguaje grande (LLM), funciona bien con Claude 3.5 y admite modelos locales.

SQLCHAT/SQLCHAT: un cliente y editor SQL basado en funciones de chat para la próxima década.

Exafunction/codeium.vim: una alternativa de copilot de gratis y súper rápida para VIM y Neovim.

Varunshenoy/Graphgpt - Inferir gráficos de conocimiento del texto no estructurado usando GPT - 3.

Nutlope/Llamacoder - Producto de código abierto hecho por Claude, construido con LLAMA 3.1 405B.

McKayWrigley/AI-Code-Translator: aprovecha la inteligencia artificial para traducir el código entre diferentes idiomas.

Shobrook/adrenalina: interactúe y visualice la base de código.

QWENLM/QWEN2.5 -CODER - Tongyi Qianwen 2.5 - Coder es la versión de código de Tongyi Qianwen 2.5.

Ricklamers/GPT-Code-UI: una implementación de código abierto del intérprete de código CHATGPT de OpenAI.

GoFireFlyio/AIAC - Generador de código de infraestructura de inteligencia artificial.

Defog -AI/SQLCoder: el modelo de lenguaje más avanzado para convertir problemas de lenguaje natural en consultas SQL.

GPTScript -AI/GPTScript - Cree un asistente de inteligencia artificial para interactuar con su sistema.

RootBeerComputer/Backend -GPT -

Mpoon/GPT-Repository-Loader: convierte la base de código en un formato de aviso de modelo de lenguaje grande (LLM) creado principalmente por GPT-4.

Canner/Wrenai: un agente de inteligencia artificial de código abierto permite que los equipos de datos y productos interactúen y chaten con datos a través de Text -to SQL (Text - TO - SQL) para crear gráficos, hojas de cálculo, informes e inteligencia empresarial (BI).

NUS-APR/Auto-Code-Rover: un ingeniero de software autónomo que comprende la estructura del proyecto está dedicada a la mejora de los programas autónomos. Completó un porcentaje de tareas en ambos puntos de referencia y cuesta menos de $ 0.7 por tarea.

Fern -Api/Fern: ingrese OpenAPI y emite el SDK (Kit de desarrollo de software) y la documentación.

Georgia-Tech-DB/EVADB: un sistema de base de datos de aplicaciones alimentado por inteligencia artificial.

Abteanteai/mentat - mentat - asistente de codificación de inteligencia artificial

EMCF/Engshell: un shell de idioma inglés (shell) alimentado por modelos de idiomas grandes (LLM) que se pueden usar en cualquier sistema operativo (OS).

AI -Citizen/SolidGPT: una inteligencia artificial desarrollador para buscar roles.

context -labs/autodoc: un conjunto de herramientas experimental que genera automáticamente documentos de base de código utilizando modelos de lenguaje grandes (LLM).

Knuckleswtf/escriba: genere documentación de API para humanos de la base del código Laravel.

Jina-AI/dev-GPT: su equipo de desarrollo virtual puede ser un grupo de desarrolladores remotos que trabajan para desarrollar software u otros proyectos a través de la colaboración virtual.

Pythongora -IO/Pythagora: genere pruebas automatizadas para aplicaciones Node.js utilizando modelos de idiomas grandes (LLM) sin la necesidad de que los desarrolladores escriban ningún código.

ELI64S/README -AI - Un generador de lectura impulsado por inteligencia artificial.

MattzCarey/Code-Review-GPT-Revisión del código utilizando modelos de lenguaje grandes (GPT4, Sonnet 3.5) y las integridades mejoran la calidad del código y detectan errores en la fase de preproducción, e integración continua con GitHub/Gitlab/Azure DevOps (IC) integrado.

SmallCloudai/Refact-WebUI para modelos de lenguaje de codificación de gran código abierto y ajustado de código abierto.

Eyelonmiz/React -Agent - Open Source React.js Autónomo de Language Model (LLM) proxy.

Gorilla-LLM/Gorilla-Cli-Modelos de lenguaje grande (LLMS) para interfaces de línea de comandos (CLIS).

Huggingface/LLM -VScode - Desarrollo alimentado por un modelo de lenguaje grande (LLM) en VScode.

Peterw/chat-with-github-repo: este repositorio tiene dos scripts de Python para crear chatbots a través de Streamlit, OpenAi GPT-3.5-TURBO y el lago profundo de Activeloop.

ParallelDrive/Sudolang-LLM-Support-Support de Sudolang Language Model (LLM) en el código Visual Studio.

Ricklamers/Shell -AI - Una interfaz de línea de comandos (CLI) alimentada por Langchain para generar y ejecutar comandos de shell.

Google/OSS -Fuzz -Gen - a través de OSS - Fuzz impulsado por un modelo de lenguaje grande (LLM).

Kantord/SeaGoat - Motor de búsqueda de código semántico que adopta un enfoque local preferido.

OpenAutocoder/Agentless: un método sin agente para resolver automáticamente problemas de desarrollo de software.

FERRISLUCAS/PROMPTR-PROMPTR es una herramienta de interfaz de línea de comando (CLI) que puede modificar la base de código en inglés fácil de entender.

Microsoft/Generation-AI-for-Beginners-21 cursos para comenzar a construir utilizando inteligencia artificial generativa. Enlace: https://microsoft.github.io/generative-ai-for-beginners/

OpenAI/OpenAI -Cookbook - OpenAI API Ejemplos y guías.

Mlabonne/LLM-Course: un curso en profundidad con modelos de idiomas grandes (LLM) que contienen hojas de ruta y cuadernos Colab.

RASBT/LLMS-FROMRACH: implementa gradualmente un modelo de idioma grande (LLM) tipo CHATGPT en Pytorch desde cero.

Lutzroeder/Netron: una herramienta de visualización para redes neuronales, aprendizaje profundo y modelos de aprendizaje automático.

Datawhalechina/Interpretación rápida para desarrolladores: Introducción al modelo de lenguaje grande (LLM) para desarrolladores, versión china de la versión china del curso NG Model Series.

Liguodongiot/LLM-Action: este proyecto tiene como objetivo compartir principios técnicos y experiencia práctica relacionada con modelos grandes (gran modelos de ingeniería e implementación de aplicaciones de modelos a gran escala).

Ingeniería STAS00/ML - Libro abierto sobre ingeniería de aprendizaje automático.

Mikeroyal/autohostante-guía-Guía de autohosting: host y administra aplicaciones de software localmente por individuos u organizaciones, que cubren la nube, los modelos de idiomas grandes (LLM) y más.

HUA1995116/Awesome-AI-pinting-Colección de materiales de pintura de inteligencia artificial, que incluyen plataformas nacionales y extranjeras, tutoriales y noticias, como difusión estable, animada, adora, cascada estable, sdxl turbo sdxl turboalimentado).

MooLer0410/LLMSPracticalGuide: una lista de recursos de guía práctica para modelos de idiomas grandes (LLMS), incluidos árboles, ejemplos y documentos de LLMS.

GoogleCloudPlatform/generative-ai - 谷歌云(Google Cloud)上使用Vertex AI中的Gemini进行生成式人工智能(Generative AI)的示例代码和笔记本。

kyrolabs/awesome-langchain - 使用LangChain框架的工具和项目的优秀列表。

microsoft/DeepSpeedExamples - DeepSpeed示例模型。

huggingface/alignment-handbook - 使语言模型符合人类和人工智能偏好的稳健方法。

trigaten/Learn_Prompting - 提示工程、生成式人工智能和大型语言模型(LLM)指南,由Learn Prompting提供。加入其Discord(一款聊天软件),获取最大的提示工程学习社区。

bbycroft/llm-viz - GPT风格大型语言模型的3D可视化。

ray-project/llm-numbers - 每个大型语言模型(LLM)开发者都应该知晓的数字。

luban-agi/Awesome-AIGC-Tutorials - 大型语言模型、人工智能绘画等方面的精选教程和资源。

georgezouq/awesome-ai-in-finance - 金融市场中一系列精心挑选的优秀大型语言模型(LLMs)、深度学习策略和工具。

howl-anderson/unlocking-the-power-of-llms - 使用提示(Prompts)和链(Chains)使ChatGPT成为强大的生产力工具。释放大型语言模型(LLMs)的潜力。

ashishpatel26/LLM-Finetuning - 使用PEFT(参数高效微调)对大型语言模型(LLM)进行微调。

ray-project/llm-applications - 一份面向生产开发基于检索增强生成(RAG)的大型语言模型(LLM)应用的综合指南。

premAI-io/state-of-open-source-ai - 在开源创新这个混乱又快节奏的世界里,需要有清晰的思路。

pionxzh/chatgpt-exporter - 导出并分享你的ChatGPT聊天记录。

ianand/spreadsheets-are-all-you-need -

majacinka/crewai-experiments - 使用本地模型和可通过应用程序接口(API)访问的模型进行实验。

thu-vu92/local-llms-analyse-finance -

KillianLucas/open-interpreter - 计算机的自然语言界面。

StanGirard/quivr - 用于将生成式人工智能(GenAI)集成到应用中的有主见的检索增强生成(RAG)技术,重点关注产品。可在现有产品中轻松集成并定制,并且在大型语言模型(LLM)、向量存储和文件方面具有多功能性。

danielmiessler/fabric - Fabric是一个开源的人工智能增强人类框架,它具有模块化结构,可通过众包人工智能提示来解决问题。

openai-translator/openai-translator - 使用ChatGPT API进行翻译的浏览器和桌面应用程序。

Skyvern-AI/skyvern - 使用大型语言模型(LLMs)和计算机视觉技术实现基于浏览器的任务自动化。

activepieces/activepieces - 您最友好的开源人工智能自动化工具。它是一个具有200多种集成的工作流自动化工具,是企业自动化方面Zapier的替代品。

OthersideAI/self-operating-computer - 一种供多模态模型操作计算机的框架。

microsoft/UFO - 一个专注于用户界面的Windows操作系统交互代理。

yihong0618/bilingual_book_maker - 利用人工智能翻译手段创作双语的epub书籍。

lavague-ai/LaVague - 用于开发人工智能网络代理的大型动作模型框架。

aisingapore/TagUI - 由新加坡人工智能开发的一款免费的机器人流程自动化(RPA)工具。

openchatai/OpenCopilot - 语言到行为引擎

KillianLucas/01 - 适用于桌面端、移动端和ESP32芯片的顶级开源语音接口。

katanaml/sparrow - 使用机器学习、大型语言模型(LLM)和基于视觉的大型语言模型进行数据处理。

xlang-ai/OpenAgents - 2024年的OpenAgents:一个面向野生语言智能体(agents)的开放平台。

BAAI-Agents/Cradle -

Cormanz/smartgpt - 一个使大型语言模型(LLMs)能够借助插件完成复杂任务的程序。

fiatrete/OpenDAN-Personal-AI-OS - OpenDAN是一个开源的个人人工智能操作系统,它整合了各种人工智能模块供个人使用。

n4ze3m/page-assist - 使用本地运行的人工智能模型来协助网络浏览。

OS-Copilot/FRIDAY -

andrewnguonly/Lumos - 一个由本地大型语言模型(LLM)提供支持、用于网络浏览的检索增强生成(RAG)大型语言模型(LLM)副驾驶。

Dicklesworthstone/swiss_army_llama - 一个通过预先计算的嵌入、相似性度量以及通过textract支持文件类型来进行语义文本搜索的FastAPI服务。

lencx/ChatGPT - 适用于Mac、Windows和Linux系统的ChatGPT桌面应用程序。

LAION-AI/Open-Assistant - OpenAssistant是一个基于聊天的助手,能够理解任务、与第三方系统交互并动态检索信息。

zhayujie/chatgpt-on-wechat - A chatbot based on large models, supporting multiple platforms (WeChat official account, enterprise WeChat application, Feishu, DingTalk, etc.), multiple models (GPT3.5/GPT - 4o/GPT - o1/ Claude/Wenxin Yiyan/iFlytek/Tongyi Qianwen/GLM-4/Claude/Qimi/Link Love), able to process text, voice and pictures, access the operating system and The Internet and supports customized enterprise intelligent customer service based on its own knowledge base.

Chanzhaoyu/chatgpt-web - 一个使用Express和Vue3构建的ChatGPT演示网页。

janhq/jan - Jan是一个开源的ChatGPT替代品,可在计算机上完全离线运行。

Bin-Huang/chatbox - 对人工智能模型/大型语言模型(如GPT、Claude、Gemini、Ollama等)友好的桌面客户端应用程序。

joonspk-research/generative_agents - 生成式智能体:人类行为的交互模拟。

Unity-Technologies/ml-agents - Unity ML - Agents工具包是一个开源项目,用于通过深度强化学习和模仿学习在游戏和模拟中训练智能体。

transitive-bullshit/chatgpt-api - 一个兼容任何大型语言模型(LLM)和TypeScript人工智能软件开发工具包(SDK)的人工智能代理标准库。

leon-ai/leon - 利昂是你的开源个人助手。

xcanwin/KeepChatGPT - 这是一个增强ChatGPT数据安全性和效率的插件。它提供许多免费的创新功能以提供更好的人工智能体验。

lss233/chatgpt-mirai-qq-bot - 一键部署!真正的人工智能聊天机器人,支持多平台和多种功能。

getumbrel/llama-gpt - 一个像ChatGPT一样的自托管离线聊天机器人,由Llama 2提供支持,是私有的,没有数据离开设备,现在还支持Code Llama。

sfyc23/EverydayWechat - 微信助手:1. 每天定期向朋友(女友)发送定制消息。2. 机器人自动回复朋友。3. 群助手功能(如垃圾分类查询、天气、日历、实时电影票房、快递物流、PM2.5等)。

BlinkDL/ChatRWKV - ChatRWKV是一个像ChatGPT一样的开源语言模型,但由RWKV(一种100%的循环神经网络)提供动力。

ztjhz/BetterChatGPT - ChatGPT的一个很棒的用户界面,可在网站以及包括Windows、MacOS和Linux在内的多种操作系统上使用。

a16z-infra/ai-town - 一个用于构建人工智能小镇(人工智能角色在其中生活、聊天和社交)的、遵循麻省理工学院(MIT)许可的入门工具包可部署且可定制。

memochou1993/gpt-ai-assistant - OpenAI、LINE和Vercel结合起来形成了GPT AI助手。

miurla/morphic - 一个由人工智能驱动并具有生成式用户界面的搜索引擎。

interstellard/chatgpt-advanced - WebChatGPT是一款浏览器扩展程序,可通过网络结果增强ChatGPT提示。

linyiLYi/street-fighter-ai - 这是一个针对《街头霸王II冠军版》的人工智能代理。

vincelwt/chatgpt-mac - 适用于Mac的ChatGPT驻留在你的菜单栏中。

camel-ai/camel - CAMEL:首个也是最佳的多智能体框架,用于发现智能体的扩展定律。(https://www.camel - ai.org)

MineDojo/Voyager - 与大型语言模型相关的开放式具身智能体。

a16z-infra/companion-app - 具有记忆功能的人工智能伙伴:一个用于创建和托管自己的人工智能伙伴的轻量级堆栈。

ConnectAI-E/Feishu-OpenAI - 飞书(结合GPT - 4、GPT - 4V、DALL·E - 3和Whisper)提供了很棒的工作体验,包括语音对话、角色扮演、多话题讨论、图像创作、表格分析和文档导出。

simonw/llm - 通过命令行访问大型语言模型。

sigoden/aichat - 一款集Shell助手、聊天交互(Chat - REPL)、检索增强生成(RAG)、人工智能工具与代理于一体的大型语言模型(LLM)命令行界面(CLI)工具,可访问OpenAI、Claude等多个平台。

lencx/nofwl - 无防火墙(No FireWall,简称NoFWL)桌面应用程序。

Kent0n-Li/ChatDoctor -

xtekky/chatgpt-clone - 具有改进用户界面的ChatGPT界面。

deep-diver/LLM-As-Chatbot - 大型语言模型(LLM)作为一种聊天机器人服务。

gragland/chatgpt-chrome-extension - 一个将ChatGPT集成到互联网上每个文本框的ChatGPT Chrome扩展程序。

ohmplatform/FreedomGPT - 这个代码库是用于一个带有基于聊天界面的React - Electron(一种将React框架用于构建桌面应用的技术)应用程序,可在Mac和Windows系统本地运行FreedomGPT大型语言模型(LLM)。

SoraWebui/SoraWebui - SoraWebui是一个开源的Sora网络客户端,可轻松使用OpenAI的Sora模型从文本创建视频。

karthink/gptel - 一个使用大型语言模型的简单Emacs客户端。

a16z-infra/llama2-chatbot - LLaMA v2聊天机器人。

ItsPi3141/alpaca-electron - 在自己的个人电脑上运行羊驼(Alpaca)和其他基于LLaMA的本地大型语言模型(LLM)的最简单方法。

opendilab/DI-star - 一个用于《星际争霸II》的人工智能平台,具备大规模分布式训练和宗师级智能体。

jncraton/languagemodels - 使用512MB内存探索大型语言模型。

SamurAIGPT/Camel-AutoGPT - 介绍CAMEL,一种针对大型语言模型(LLMs)和自动代理(auto - agents)的角色扮演方法。它使代理能够协作,并在多个领域具有潜力。

Syan-Lin/CyberWaifu - 一个由大型语言模型(LLM)+语音合成(TTS)构成的具有真实感的聊天机器人,一个支持表情符号、QQ表情和互联网搜索的QQ机器人。

PaddlePaddle/PaddleOCR - 基于飞桨(PaddlePaddle)的超棒多语言光学字符识别(OCR)工具包。它们实用、超轻量,支持80多种语言,可在多种设备上使用。

suno-ai/bark - 一种由文本提示的生成式音频模型。

openai/CLIP - CLIP(对比语言- 图像预训练):为图像预测最相关的文本片段。

hpcaitech/Open-Sora - Open - Sora:使每个人都能以民主的方式进行高效的视频制作。

haotian-liu/LLaVA - NeurIPS'23 Oral(神经信息处理系统大会2023年口头报告)中的视觉指令调整(LLaVA)旨在获得GPT - 4V级别的能力甚至更强的能力。

fishaudio/fish-speech - 最先进的开源语音合成(TTS)技术。

borisdayma/dalle-mini - DALL·E Mini根据文本提示生成图像。

google-deepmind/alphafold - AlphaFold 2的开源代码。

OpenBMB/OmniLMM - MiniCPM - V 2.6是一款在手机上用于单张图像、多张图像和视频的、达到GPT - 4V水平的多模态大语言模型(MLLM)。

PKU-YuanGroup/Open-Sora-Plan - 该项目旨在复现Sora(OpenAI的文本到视频模型),并希望开源社区做出贡献。

openai/shap-e - 基于文本或图像生成3D对象。

facebookresearch/seamless_communication - 用于最先进的语音和文本翻译的基础模型。

openai/DALL-E - PyTorch软件包用于DALL·E中的离散变分自编码器(VAE)。

google-research/vision_transformer -

magic-research/magic-animate - CVPR 2024中的MagicAnimate使用扩散模型实现时序一致的人体图像动画。

ashawkey/stable-dreamfusion - 使用神经辐射场(NeRF)+扩散技术进行文本到3D、图像到3D以及网格导出。

lucidrains/imagen-pytorch - 在Pytorch中实现谷歌的文本到图像神经网络Imagen。