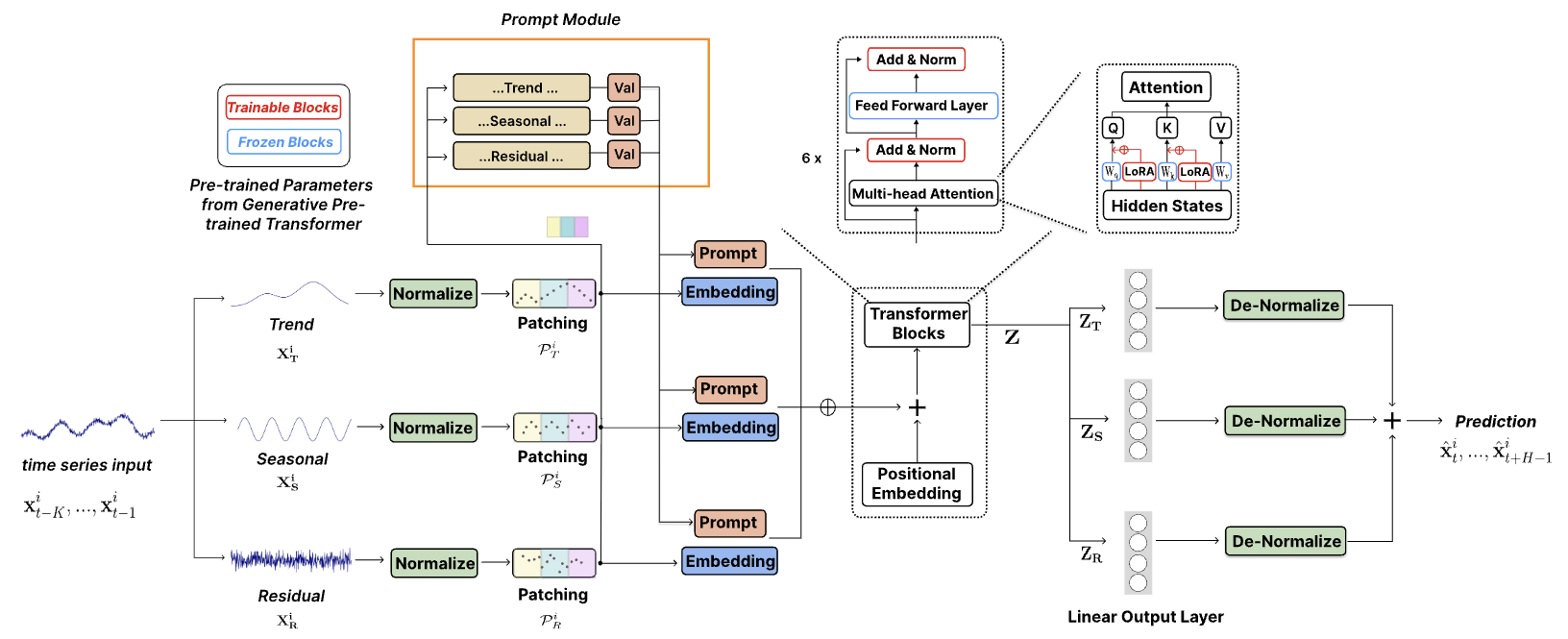

Kode resmi untuk ["TEMPO: Transformator Terlatih Generatif Berbasis Prompt untuk Peramalan Rangkaian Waktu (ICLR 2024)"].

TEMPO adalah salah satu Model Time Series Foundation open source pertama untuk tugas peramalan versi v1.0.

Okt 2024 : Kami telah menyederhanakan struktur kode kami, memungkinkan pengguna mengunduh model terlatih dan melakukan inferensi zero-shot dengan satu baris kode! Lihat demo kami untuk lebih jelasnya. Jumlah unduhan model kami di HuggingFace sekarang dapat dilacak!

Jun 2024 : Kami menambahkan demo untuk mereproduksi eksperimen zero-shot di Colab. Kami juga menambahkan demo pembuatan kumpulan data pelanggan dan langsung melakukan inferensi melalui model dasar terlatih kami: Colab

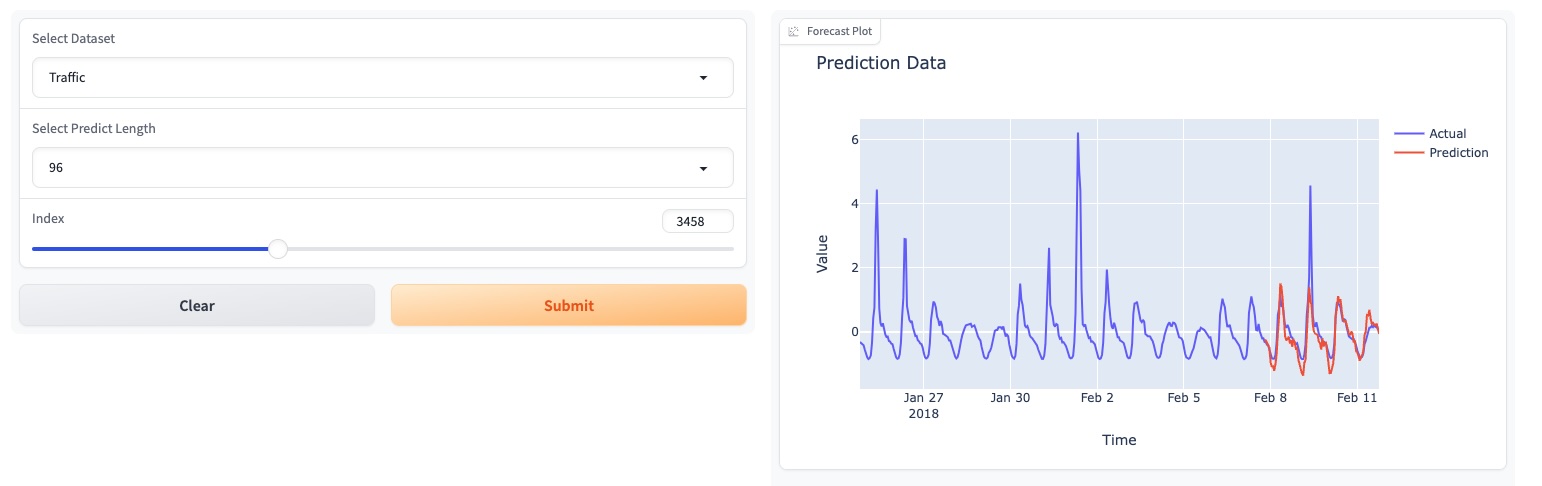

Mei 2024 : Tempo meluncurkan demo online berbasis GUI yang memungkinkan pengguna berinteraksi langsung dengan model fondasi kami!

Mei 2024 : Tempo mempublikasikan model pondasi 80M yang telah dilatih sebelumnya di HuggingFace!

Mei 2024 : ? Kami menambahkan kode untuk model Tempo pra-pelatihan dan inferensi. Anda dapat menemukan demo skrip pra-pelatihan di folder ini. Kami juga menambahkan skrip untuk demo inferensi.

Maret 2024 : ? Merilis dataset TETS dari S&P 500 yang digunakan dalam eksperimen multimodal di TEMPO.

Maret 2024 : ? Tempo mempublikasikan kode proyek dan pos pemeriksaan terlatih secara online!

Jan 2024 : Makalah Tempo diterima ICLR!

Okt 2023 : Makalah Tempo dirilis di Arxiv!

conda create -n tempo python=3.8

conda activate tempo

pip install -r requirements.txt

Contoh perampingan yang menunjukkan cara melakukan peramalan menggunakan TEMPO:

# Third-party library imports

import numpy as np

import torch

from numpy . random import choice

# Local imports

from models . TEMPO import TEMPO

model = TEMPO . load_pretrained_model (

device = torch . device ( 'cuda:0' if torch . cuda . is_available () else 'cpu' ),

repo_id = "Melady/TEMPO" ,

filename = "TEMPO-80M_v1.pth" ,

cache_dir = "./checkpoints/TEMPO_checkpoints"

)

input_data = np . random . rand ( 336 ) # Random input data

with torch . no_grad ():

predicted_values = model . predict ( input_data , pred_length = 96 )

print ( "Predicted values:" )

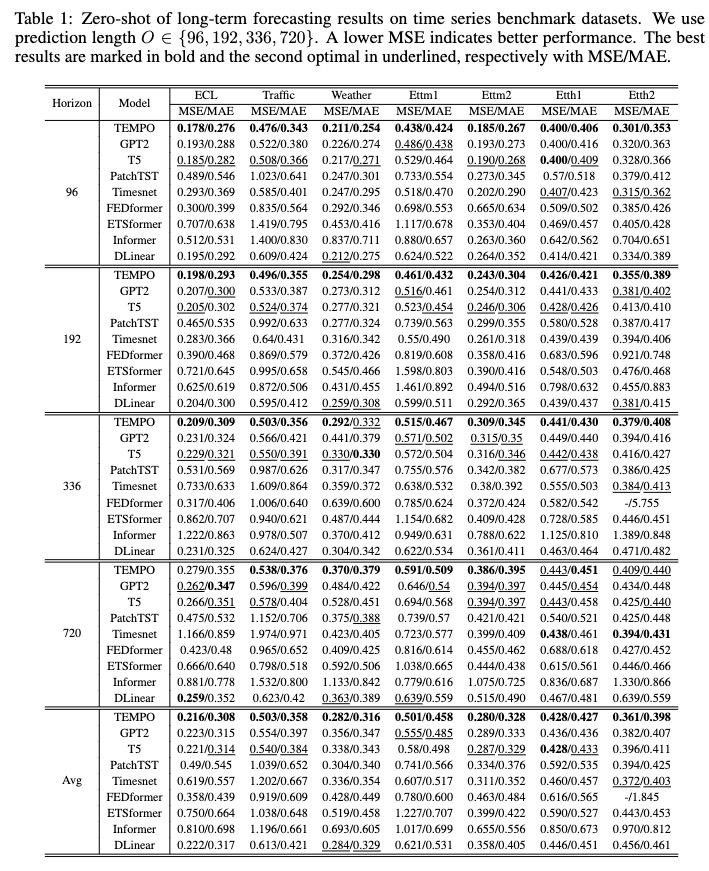

print ( predicted_values )Silakan coba mereproduksi eksperimen zero-shot di ETTh2 [di sini di Colab].

Kami menggunakan halaman Colab berikut untuk menampilkan demo pembuatan kumpulan data pelanggan dan langsung melakukan inferensi melalui model dasar terlatih kami: [Colab]

Silakan coba demo model dasar kami [di sini].

Kami juga memperbarui model kami di HuggingFace: [Melady/TEMPO].

Unduh data dari [Google Drive] atau [Baidu Drive], dan letakkan data yang diunduh di folder ./dataset . Anda juga dapat mendownload hasil STL dari [Google Drive], dan meletakkan data hasil download tersebut pada folder ./stl .

bash [ecl, etth1, etth2, ettm1, ettm2, traffic, weather].sh

Setelah pelatihan, kita dapat menguji model TEMPO dengan pengaturan zero-shot:

bash [ecl, etth1, etth2, ettm1, ettm2, traffic, weather]_test.sh

Anda dapat mengunduh model terlatih dari [Google Drive] dan kemudian menjalankan skrip pengujian untuk bersenang-senang.

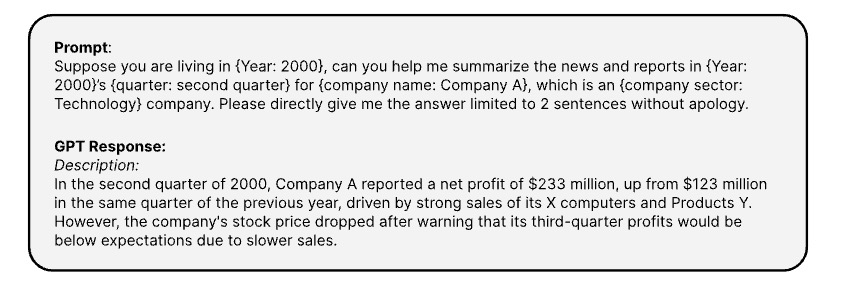

Berikut adalah petunjuk yang digunakan untuk menghasilkan informasi tekstual rangkaian waktu yang sesuai melalui [OPENAI ChatGPT-3.5 API]

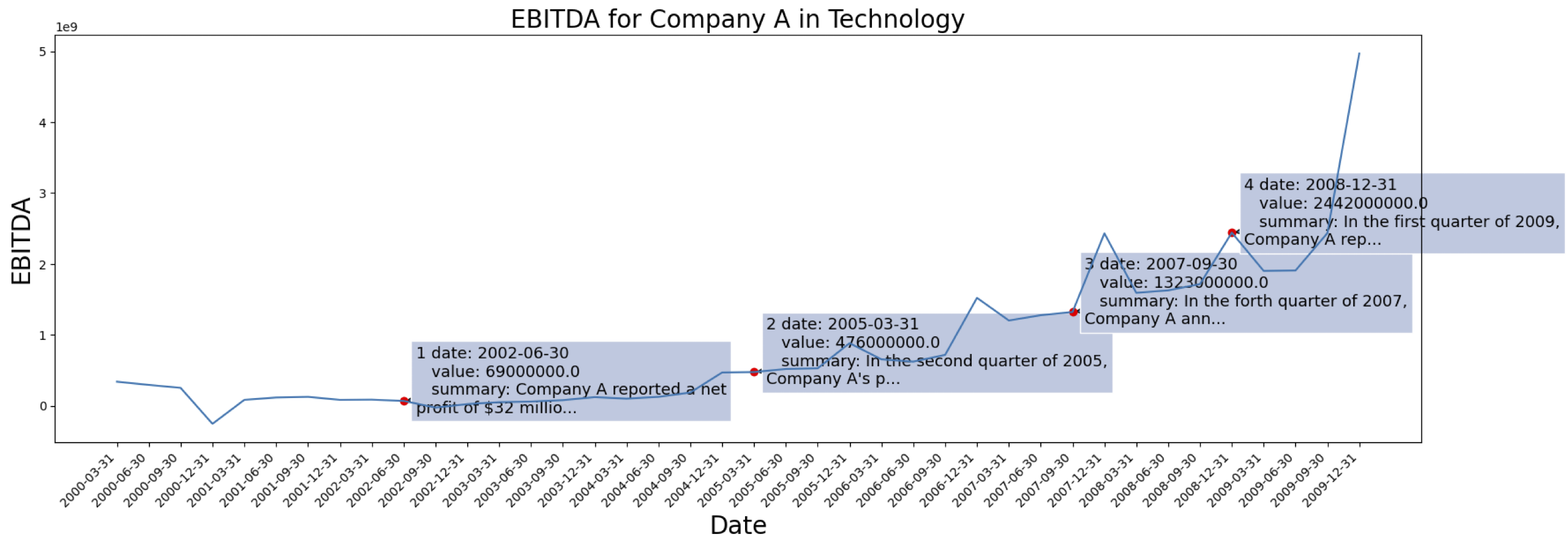

Data deret waktu berasal dari [S&P 500]. Berikut kasus EBITDA untuk satu perusahaan dari kumpulan data:

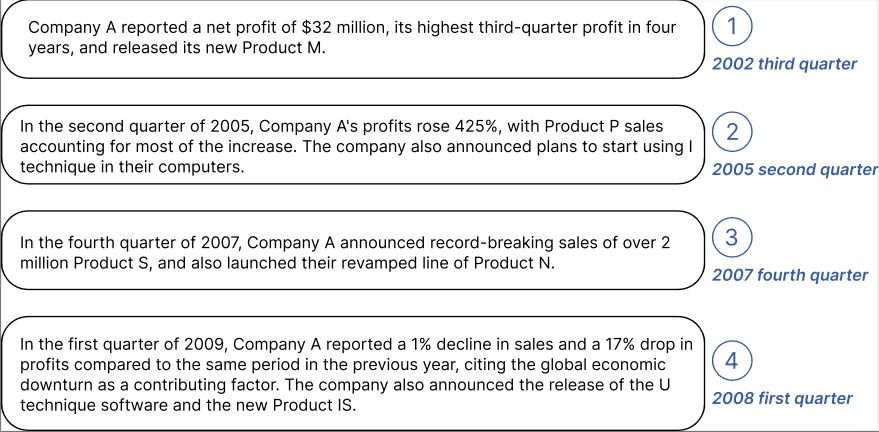

Contoh informasi kontekstual yang dihasilkan untuk Perusahaan yang ditandai di atas:

Anda dapat mengunduh data yang diproses dengan penyematan teks dari GPT2 dari: [TETS].

Jangan ragu untuk menghubungi [email protected] / [email protected] jika Anda tertarik untuk menerapkan TEMPO ke aplikasi dunia nyata Anda.

@inproceedings{

cao2024tempo,

title={{TEMPO}: Prompt-based Generative Pre-trained Transformer for Time Series Forecasting},

author={Defu Cao and Furong Jia and Sercan O Arik and Tomas Pfister and Yixiang Zheng and Wen Ye and Yan Liu},

booktitle={The Twelfth International Conference on Learning Representations},

year={2024},

url={https://openreview.net/forum?id=YH5w12OUuU}

}

@article{

Jia_Wang_Zheng_Cao_Liu_2024,

title={GPT4MTS: Prompt-based Large Language Model for Multimodal Time-series Forecasting},

volume={38},

url={https://ojs.aaai.org/index.php/AAAI/article/view/30383},

DOI={10.1609/aaai.v38i21.30383},

number={21},

journal={Proceedings of the AAAI Conference on Artificial Intelligence},

author={Jia, Furong and Wang, Kevin and Zheng, Yixiang and Cao, Defu and Liu, Yan},

year={2024}, month={Mar.}, pages={23343-23351}

}