Dibuat oleh Wayne Wu, Yunxuan Zhang dan Ren Li.

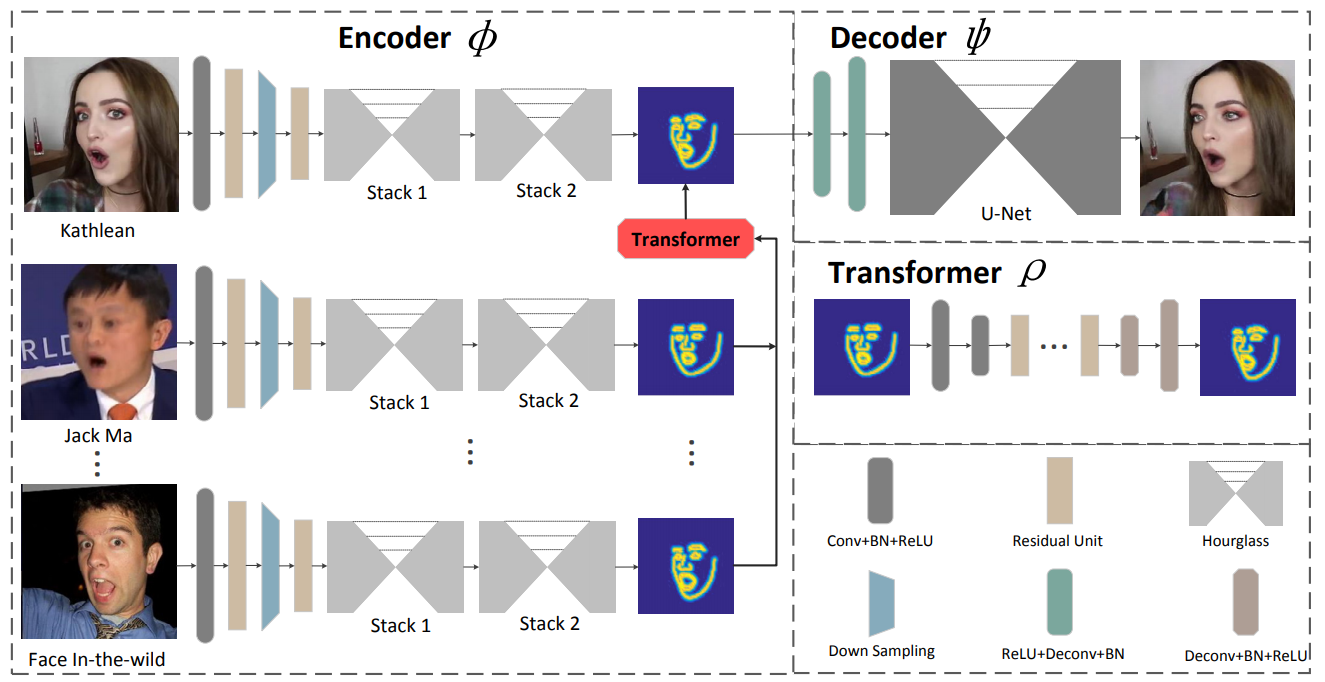

Kami menyajikan kerangka kerja berbasis pembelajaran baru untuk pemeragaan wajah. Metode yang diusulkan, yang dikenal sebagai ReenactGAN, mampu mentransfer gerakan dan ekspresi wajah dari masukan video monokuler seseorang ke video orang yang dituju. Daripada melakukan transfer langsung dalam ruang piksel, yang dapat menghasilkan artefak struktural, pertama-tama kami memetakan permukaan sumber ke ruang laten batas. Sebuah transformator kemudian digunakan untuk menyesuaikan batas permukaan sumber dengan batas target. Terakhir, dekoder khusus target digunakan untuk menghasilkan wajah target yang diaktifkan kembali. Berkat transfer berbasis batas yang efektif dan andal, metode kami dapat melakukan peragaan wajah foto-realistis. Selain itu, ReenactGAN menarik karena seluruh proses peragaan ulang bersifat feed-forward sehingga proses peragaan ulang dapat berjalan secara real-time.

Kloning repo ini:

git clone ...

cd ReenactGANEncoder batas dilatih pada kumpulan data WFLW dan Helen, dan transformator batas serta dekoder dilatih pada Kumpulan Data CelebV. Pelatihan encoder memerlukan banyak waktu, sehingga Anda bisa mendapatkan encoder terlatih di ./pretrained_models/v8_net_boundary_detection.pth .

Untuk melatih trafo batas, jalankan

sh script/train_Transformer.shAnda harus memperhatikan argumen --root_dir dan --which_target . --root_dir mengacu pada direktori kumpulan data, dan --which_target merujuk pada orang mana yang menjadi target

0: Emmanuel_Macron

1: Kathleen

2: Jack_Ma

3: Theresa_May

4: Donald_TrumpUntuk melatih decoder, jalankan

sh script/train_Decoder.shSelain itu, Anda perlu menjaga nilai --root_dir , yang merujuk ke direktori orang target.

Untuk menguji model, jalankan

sh script/move_models.sh ./checkpoints/Transformer_2019-xx-xx_xx-xx-xx/G_BA_xx.pth ./checkpoints/Decoder_2019-xx-xx_xx-xx-xx/xx_net_G.pth trump

sh script/test.shGambar yang digunakan untuk pengujian ada di ./test_imgs/samples/image, dan file teks, ./test_imgs/samples/images_list.txt, berisi daftar gambar ini. Setelah pengujian, Anda akan mendapatkan floder bernama results , yang berisi gambar wajah asli dan wajah yang diperagakan, batas, dan batas transformasi wajah asli. Berikut beberapa hasilnya.

Anda bisa mendapatkan model terlatih kami dari Decoder dan Transformer.

Jika menurut Anda ReenactGAN bermanfaat untuk penelitian Anda, harap kutip:

inproceedings{wayne2018reenactgan,

author = {Wu, Wayne and Zhang, Yunxuan and Li, Cheng and Qian, Chen and Loy, Chen Change},

title = {ReenactGAN: Learning to Reenact Faces via Boundary Transfer},

booktitle = {ECCV},

month = September,

year = {2018}

} Silakan hubungi [email protected]