Pesatnya perkembangan model bahasa besar (LLM) memang mengesankan, namun upaya memperluas skala model saja tidak cukup untuk mencapai kecerdasan AI yang sesungguhnya. Editor Downcodes percaya bahwa memberikan model kemampuan untuk berevolusi sehingga dapat terus belajar dan berkembang selama tahap inferensi sangat penting untuk pengembangan AI di masa depan. Artikel ini akan mengeksplorasi faktor kunci dalam evolusi diri AI - memori jangka panjang (LTM), dan cara mencapai kemajuan berkelanjutan dalam AI melalui LTM.

Model bahasa besar (LLM), seperti seri GPT, telah menunjukkan kemampuan luar biasa dalam pemahaman, penalaran, dan perencanaan bahasa dengan kumpulan datanya yang sangat besar, dan telah mencapai tingkat yang sebanding dengan manusia dalam berbagai tugas yang menantang. Sebagian besar penelitian berfokus pada peningkatan lebih lanjut model ini dengan melatih model tersebut pada kumpulan data yang lebih besar, dengan tujuan mengembangkan model dasar yang lebih kuat.

Namun, meskipun melatih model dasar yang lebih kuat sangatlah penting, para peneliti percaya bahwa memberikan model kemampuan untuk terus berkembang selama tahap inferensi, yaitu evolusi diri AI, juga penting untuk pengembangan AI. Dibandingkan dengan menggunakan data berskala besar untuk melatih model, evolusi diri mungkin hanya memerlukan data atau interaksi yang terbatas.

Terinspirasi oleh struktur kolom korteks serebral manusia, para peneliti berhipotesis bahwa model AI dapat mengembangkan kemampuan kognitif yang muncul dan membangun model representasi internal melalui interaksi berulang dengan lingkungannya.

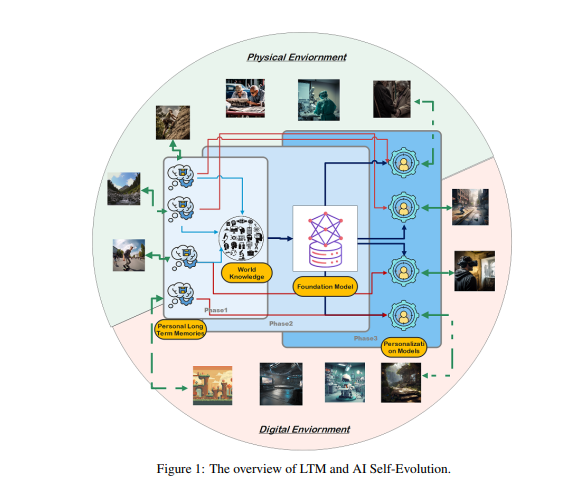

Untuk mencapai tujuan ini, para peneliti mengusulkan agar model tersebut harus memiliki memori jangka panjang (LTM) untuk menyimpan dan mengelola data interaksi dunia nyata yang telah diproses. LTM tidak hanya mampu merepresentasikan data individu jangka panjang dalam model statistik, namun juga mendorong evolusi diri dengan mendukung beragam pengalaman di berbagai lingkungan dan agen.

LTM adalah kunci untuk mewujudkan evolusi diri AI. Mirip dengan bagaimana manusia terus belajar dan berkembang melalui pengalaman pribadi dan interaksi dengan lingkungan, evolusi diri model AI juga bergantung pada data LTM yang dikumpulkan selama interaksi. Berbeda dengan evolusi manusia, evolusi model berbasis LTM tidak terbatas pada interaksi dunia nyata. Model dapat berinteraksi dengan lingkungan fisik seperti manusia dan menerima umpan balik langsung, yang diproses untuk meningkatkan kemampuannya. Ini juga merupakan bidang penelitian utama dalam perwujudan AI.

Di sisi lain, model juga dapat berinteraksi dalam lingkungan virtual dan mengumpulkan data LTM, yang berbiaya lebih rendah dan lebih efisien dibandingkan interaksi di dunia nyata, sehingga meningkatkan kemampuan secara lebih efektif.

Membangun LTM memerlukan penyempurnaan dan penataan data mentah. Data mentah mengacu pada pengumpulan semua data belum diproses yang diterima oleh model melalui interaksi dengan lingkungan eksternal atau selama proses pelatihan. Data ini berisi berbagai observasi dan catatan, yang mungkin berisi pola berharga dan sejumlah besar informasi yang berlebihan atau tidak relevan.

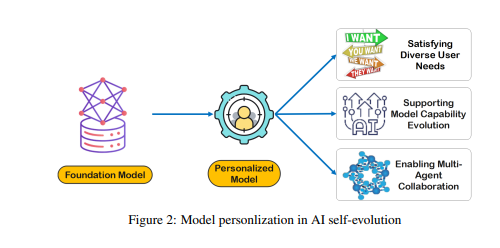

Meskipun data mentah menjadi dasar memori model dan kognisi, data tersebut memerlukan pemrosesan lebih lanjut sebelum dapat digunakan secara efektif untuk personalisasi atau pelaksanaan tugas yang efisien. LTM menyempurnakan dan menyusun data mentah ini sehingga model dapat menggunakannya. Proses ini meningkatkan kemampuan model untuk memberikan tanggapan dan rekomendasi yang dipersonalisasi.

Membangun LTM menghadapi tantangan seperti ketersebaran data dan keragaman pengguna. Dalam sistem LTM yang terus diperbarui, ketersebaran data merupakan masalah umum, terutama bagi pengguna dengan riwayat interaksi terbatas atau aktivitas tersebar, sehingga membuat pelatihan model menjadi sulit. Selain itu, keberagaman pengguna juga menambah kompleksitas, sehingga mengharuskan model beradaptasi terhadap pola individu dan melakukan generalisasi secara efektif pada kelompok pengguna yang berbeda.

Para peneliti mengembangkan kerangka kolaborasi multi-agen yang disebut Omne, yang mengimplementasikan evolusi diri AI berdasarkan LTM. Dalam kerangka ini, setiap agen memiliki struktur sistem independen dan dapat secara mandiri mempelajari dan menyimpan model lingkungan yang lengkap untuk membangun pemahaman independen terhadap lingkungan. Melalui pengembangan kolaboratif berbasis LTM ini, sistem AI dapat beradaptasi dengan perubahan perilaku individu secara real time, mengoptimalkan perencanaan dan pelaksanaan tugas, dan selanjutnya mendorong evolusi diri AI yang dipersonalisasi dan efisien.

Kerangka kerja Omne meraih peringkat pertama dalam pengujian benchmark GAIA, membuktikan potensi besar dalam memanfaatkan LTM untuk evolusi mandiri AI dan memecahkan masalah dunia nyata. Para peneliti percaya bahwa memajukan penelitian LTM sangat penting untuk kelanjutan pengembangan dan penerapan praktis teknologi AI, terutama dalam hal evolusi diri.

Secara keseluruhan, memori jangka panjang adalah kunci bagi evolusi AI, yang memungkinkan model AI belajar dan berkembang dari pengalaman seperti halnya manusia. Membangun dan memanfaatkan LTM memerlukan mengatasi tantangan seperti ketersebaran data dan keragaman pengguna. Kerangka kerja Omne memberikan solusi yang layak untuk evolusi mandiri AI berbasis LTM, dan keberhasilannya dalam uji benchmark GAIA menunjukkan potensi besar di bidang ini.

Makalah: https://arxiv.org/pdf/2410.15665

Melalui penelitian mengenai memori jangka panjang (LTM), evolusi diri AI bukan lagi sekedar mimpi belaka. Di masa depan, model AI berbasis LTM diharapkan dapat menunjukkan kemampuan yang lebih kuat di berbagai bidang dan memberikan manfaat yang lebih besar bagi masyarakat. Menantikan hasil yang lebih inovatif!