Editor Downcodes mengetahui bahwa OpenAI telah merilis model eksperimental gpt-4o-64k-output-alpha. Fitur terbesarnya adalah dapat menghasilkan token dengan panjang 64K sekaligus, yang berarti dapat menghasilkan konten yang lebih kaya dan lebih detail. Namun hal ini juga berarti harga API yang lebih tinggi. Model ini diberikan kepada peserta Alpha dan dapat digunakan dalam skenario seperti penulisan, pemrograman, dan analisis data yang kompleks untuk memberikan dukungan yang lebih komprehensif dan mendetail kepada pengguna. Namun, biayanya yang tinggi juga mengharuskan pengguna untuk mempertimbangkan dengan hati-hati, karena harga per juta token keluaran mencapai $18.

OpenAI telah membuka model eksperimental baru: gpt-4o-64k-output-alpha. Hal yang paling menarik dari model baru ini adalah ia dapat menghasilkan token dengan panjang 64K sekaligus. Artinya, dapat menghasilkan konten yang lebih kaya dan detail dalam satu permintaan, tetapi harga API lebih tinggi.

Peserta alfa dapat mengakses efek keluaran panjang GPT-4o menggunakan nama model "gpt-4o-64k-output-alpha". Model ini tidak hanya dapat memenuhi kebutuhan pengguna akan teks yang lebih panjang, baik saat menulis, memprogram, atau melakukan analisis data yang kompleks, GPT-4o dapat memberikan dukungan yang lebih komprehensif dan mendetail.

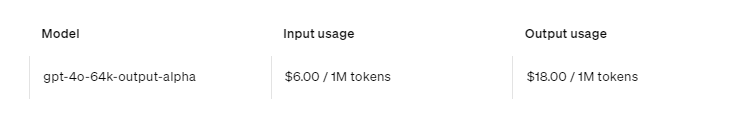

Dari segi harga, menggunakan model dengan output yang lebih panjang juga berarti peningkatan biaya. OpenAI memperjelas bahwa pembuatan teks panjang lebih mahal, sehingga harga per juta token keluarannya adalah $18. Sebagai perbandingan, harga per juta token yang dimasukkan adalah $6. Strategi penetapan harga ini dirancang untuk mengimbangi biaya komputasi yang lebih tinggi sekaligus mendorong pengguna untuk memanfaatkan alat canggih ini.

Secara keseluruhan, kemunculan model GPT-4o-64k-output-alpha memberikan opsi baru bagi pengguna yang perlu memproses dan menghasilkan teks ultra-panjang, namun biayanya yang tinggi juga mengharuskan pengguna untuk mempertimbangkan dengan cermat sesuai dengan kebutuhan mereka sendiri. Editor Downcodes menyarankan Anda memilih model yang sesuai dengan situasi aktual dan menggunakan sumber daya secara rasional.