Baru-baru ini, pengalaman pengguna chatbot AI Anthropic, Claude, telah memicu diskusi hangat. Sejumlah besar masukan pengguna muncul di Reddit, mengatakan bahwa kinerja Claude telah menurun, khususnya diwujudkan sebagai kehilangan memori dan menurunnya kemampuan pengkodean. Insiden ini memicu diskusi luas mengenai evaluasi kinerja dan pengalaman pengguna model bahasa besar, dan sekali lagi menyoroti tantangan yang dihadapi perusahaan AI dalam menjaga stabilitas model.

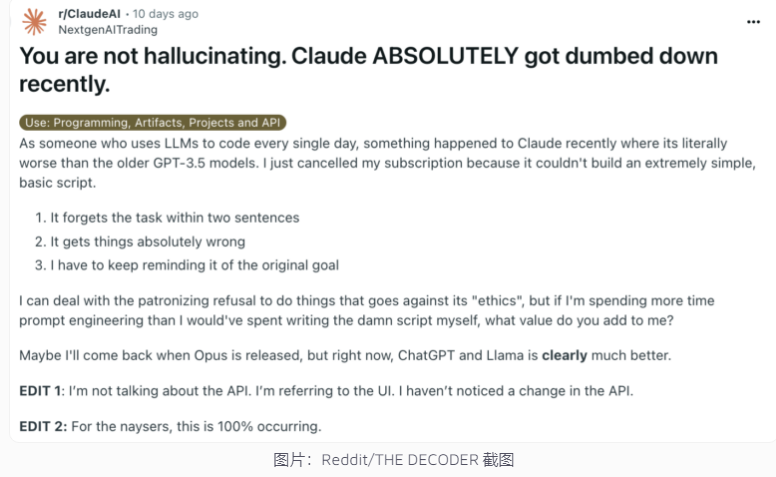

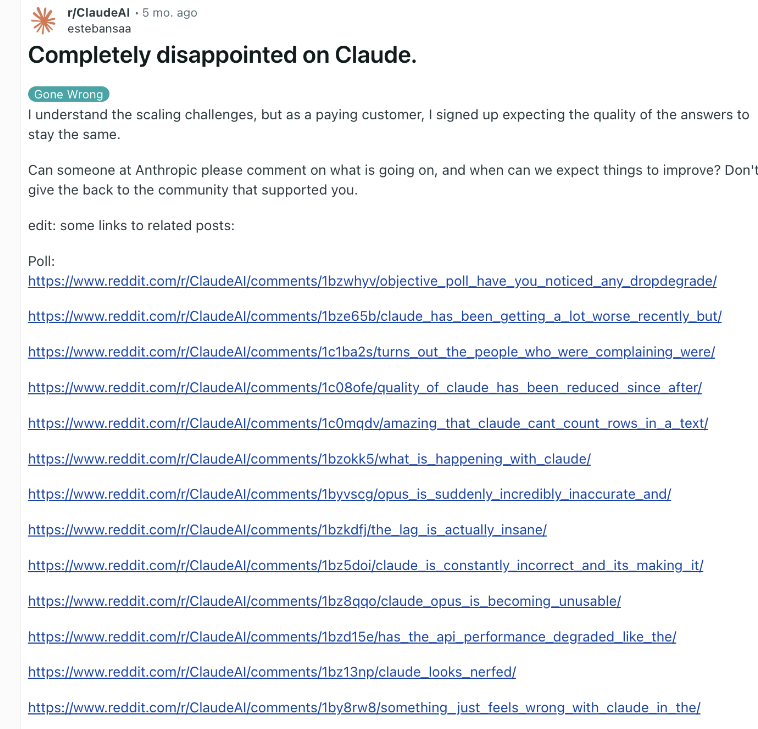

Baru-baru ini, chatbot AI Anthropic, Claude, sekali lagi terlibat dalam kontroversi kinerja. Sebuah postingan di Reddit yang mengklaim bahwa Claude menjadi jauh lebih bodoh baru-baru ini menarik perhatian luas, dengan banyak pengguna melaporkan bahwa mereka mengalami penurunan kemampuan Claude, termasuk kehilangan memori dan penurunan kemampuan pengkodean.

Sebagai tanggapan, eksekutif Anthropic Alex Albert menjawab bahwa penyelidikan perusahaan tidak menemukan masalah umum dan menegaskan bahwa tidak ada perubahan yang dilakukan pada model Claude3.5Sonnet atau saluran inferensi. Untuk meningkatkan transparansi, Anthropic telah menerbitkan petunjuk sistem model Claude di situs resminya.

Ini bukan pertama kalinya pengguna melaporkan degradasi AI dan perusahaan membantahnya. Pada akhir tahun 2023, ChatGPT OpenAI juga menghadapi keraguan serupa. Menurut orang dalam industri, alasan fenomena ini mungkin termasuk: ekspektasi pengguna yang meningkat seiring waktu, perubahan alami dalam output AI, keterbatasan sumber daya komputasi sementara, dan lain-lain.

Namun, faktor-faktor ini masih dapat menyebabkan penurunan performa yang dirasakan pengguna meskipun model dasarnya tidak mengalami perubahan signifikan. OpenAI pernah menunjukkan bahwa perilaku AI itu sendiri tidak dapat diprediksi, dan mempertahankan serta mengevaluasi kinerja AI generatif dalam skala besar merupakan tantangan besar.

Anthropic mengatakan akan terus memperhatikan masukan pengguna dan bekerja keras untuk meningkatkan stabilitas kinerja Claude. Insiden ini menyoroti tantangan yang dihadapi perusahaan AI dalam menjaga konsistensi model, serta pentingnya meningkatkan transparansi dalam evaluasi dan komunikasi kinerja AI.

Kontroversi kinerja Claude mencerminkan kompleksitas pengembangan dan penerapan model bahasa yang besar, serta kesenjangan antara harapan pengguna dan aplikasi sebenarnya. Di masa depan, perusahaan AI perlu lebih meningkatkan stabilitas model dan menjaga komunikasi yang lebih efektif dengan pengguna untuk memastikan bahwa teknologi AI dapat terus memberikan layanan yang andal kepada pengguna.