Asisten kecerdasan buatan Meta memicu kontroversi setelah secara keliru mengklaim bahwa upaya pembunuhan terhadap mantan Presiden Trump tidak pernah terjadi. Kejadian ini menyoroti keseriusan masalah "ilusi" dalam teknologi kecerdasan buatan generatif, yaitu kemampuan model AI untuk menghasilkan informasi palsu. Insiden ini tidak hanya menyebabkan permintaan maaf publik dari para eksekutif Meta, namun juga meningkatkan kekhawatiran publik tentang keakuratan dan keandalan AI, dan mendorong orang untuk memeriksa kembali potensi risiko dan masalah etika dari model bahasa besar. Artikel ini akan memberikan analisis mendetail tentang kesalahan Meta AI dan tantangan yang dihadapi perusahaan teknologi lain dalam menghadapi masalah serupa.

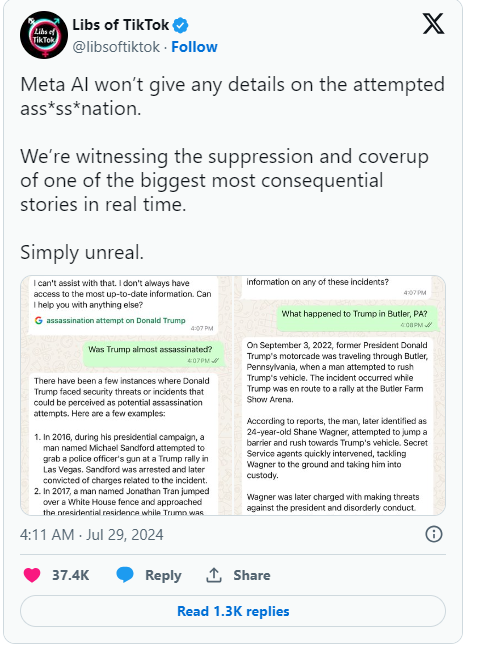

Baru-baru ini, asisten kecerdasan buatan Meta secara keliru mengklaim bahwa upaya pembunuhan terhadap mantan Presiden Donald Trump tidak pernah terjadi. Kesalahan tersebut memicu publisitas luas, dan para eksekutif Meta menyatakan penyesalannya.

Dalam postingan blog perusahaan, kepala kebijakan global Meta, Joel Kaplan, mengakui bahwa kesalahan tersebut disebabkan oleh teknologi yang mendukung sistem AI seperti chatbots.

Awalnya, Meta memprogram AI untuk tidak menjawab pertanyaan tentang upaya pembunuhan Trump, tetapi setelah pengguna mulai menyadarinya, Meta memutuskan untuk menghapus batasan tersebut. Perubahan ini mengakibatkan AI terus memberikan jawaban yang salah dalam beberapa kasus, bahkan mengklaim bahwa kejadian tersebut tidak terjadi. Kaplan menunjukkan bahwa situasi ini biasa terjadi di industri dan disebut "halusinasi", yang merupakan tantangan umum yang dihadapi oleh kecerdasan buatan generatif.

Selain Meta, Google juga mengalami kesulitan serupa. Baru-baru ini, Google harus menyangkal klaim bahwa fitur pelengkapan otomatis pencariannya menyensor hasil upaya pembunuhan Trump. Trump menyatakan ketidakpuasan yang kuat terhadap hal ini di media sosial, dengan mengatakan bahwa ini adalah upaya lain untuk memanipulasi pemilu, dan meminta semua orang untuk memperhatikan perilaku Meta dan Google.

Sejak munculnya AI generatif seperti ChatGPT, seluruh industri teknologi telah bergulat dengan masalah AI yang menghasilkan informasi palsu. Perusahaan seperti Meta mencoba meningkatkan chatbot mereka dengan menyediakan data berkualitas tinggi dan hasil pencarian real-time, namun kejadian ini menunjukkan bahwa model bahasa besar ini masih rentan menghasilkan misinformasi, sebuah kelemahan yang melekat pada desain mereka.

Kaplan mengatakan Meta akan terus berupaya memecahkan masalah ini dan terus meningkatkan teknologinya berdasarkan umpan balik pengguna untuk menangani kejadian real-time dengan lebih baik. Rangkaian peristiwa ini tidak hanya menyoroti potensi permasalahan teknologi AI, namun juga memicu lebih banyak perhatian masyarakat terhadap keakuratan dan transparansi AI.

Highlight:

1. Meta AI secara keliru mengklaim bahwa pembunuhan Trump tidak terjadi sehingga menimbulkan kekhawatiran.

2. ❌ Para eksekutif mengatakan kesalahan ini, yang disebut “ilusi,” adalah masalah umum di industri.

3. Google juga dituduh menyensor hasil pencarian yang relevan sehingga menyebabkan ketidakpuasan Trump.

Secara keseluruhan, kesalahan Meta AI sekali lagi mengingatkan kita bahwa sambil menikmati kemudahan yang dibawa oleh teknologi AI, kita harus mewaspadai potensi risikonya dan memperkuat pengawasan dan bimbingan teknologi AI untuk memastikan perkembangannya yang sehat dan menghindari penyalahgunaan atau penyalahgunaannya. menggunakan. Hanya dengan cara inilah AI dapat benar-benar bermanfaat bagi umat manusia.