Model bahasa visual (VLM) telah mencapai kemajuan signifikan di bidang kecerdasan buatan, namun masih menghadapi tantangan dalam memproses gambar beresolusi tinggi dan teks yang beragam. Model yang ada sering kali menggunakan encoder visual statis, yang tidak efisien dan kurang akurat pada kumpulan data yang berbeda. Kurangnya keragaman dan kekhususan tugas dalam kumpulan data pelatihan juga membatasi kinerjanya, terutama dalam tugas domain khusus seperti interpretasi grafik.

Dengan pesatnya perkembangan kecerdasan buatan, integrasi kemampuan visual dan bahasa telah membawa kemajuan terobosan dalam model bahasa visual (VLM). Model ini dirancang untuk memproses dan memahami data visual dan teks secara bersamaan, dan banyak digunakan dalam skenario seperti deskripsi gambar, menjawab pertanyaan visual, pengenalan karakter optik, dan analisis konten multi-modal.

VLM telah memainkan peran penting dalam mengembangkan sistem otonom, meningkatkan interaksi manusia-komputer, dan alat pemrosesan dokumen yang efisien, sehingga berhasil menjembatani kesenjangan antara kedua modalitas data ini. Namun, masih banyak tantangan dalam memproses data visual resolusi tinggi dan input teks yang beragam.

Penelitian saat ini telah mengatasi sebagian keterbatasan ini, namun encoder visual statis yang diadopsi oleh sebagian besar model kurang mampu beradaptasi pada resolusi tinggi dan ukuran input variabel. Pada saat yang sama, kombinasi model bahasa terlatih dengan encoder visual sering kali mengakibatkan inefisiensi karena tidak dioptimalkan untuk tugas multi-modal. Meskipun beberapa model memperkenalkan teknik komputasi sparse untuk mengelola kompleksitas, keakuratan pada kumpulan data yang berbeda masih belum mencukupi. Selain itu, kumpulan data pelatihan model yang ada sering kali kurang memiliki keragaman dan kekhususan tugas, sehingga semakin membatasi performanya. Misalnya, banyak model yang berkinerja buruk dalam tugas-tugas khusus seperti interpretasi bagan atau analisis dokumen yang padat.

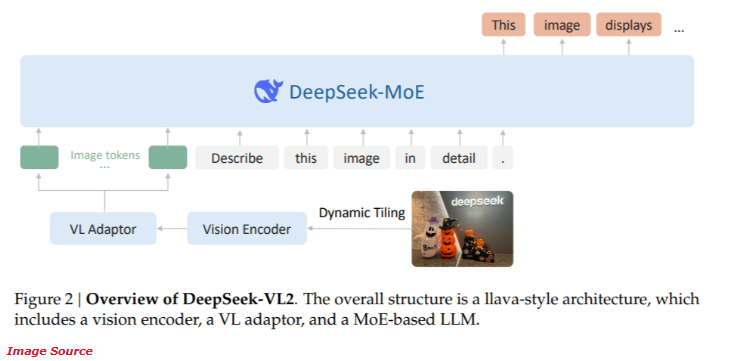

Baru-baru ini, DeepSeek-AI meluncurkan seri model bahasa visual pakar hibrid sumber terbuka (MoE) DeepSeek-VL2 baru. Rangkaian model ini menggabungkan teknologi inovatif mutakhir, termasuk pemotongan dinamis pengkodean visual, mekanisme perhatian laten multi-head, dan kerangka kerja DeepSeek-MoE.

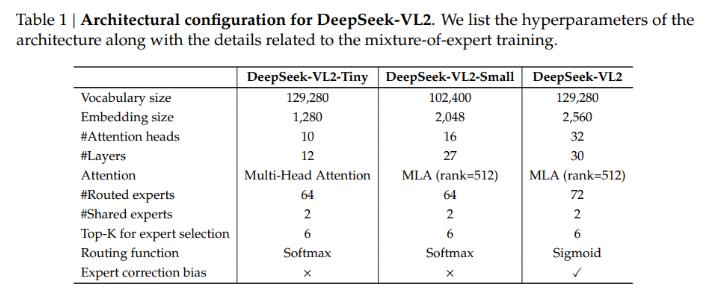

Seri DeepSeek-VL2 menyediakan tiga konfigurasi parameter berbeda:

- DeepSeek-VL2-Tiny: 3,37 miliar parameter (1 miliar parameter aktivasi)

- DeepSeek-VL2-Small: 16,1 miliar parameter (2,8 miliar parameter aktivasi)

- DeepSeek-VL2: 27,5 miliar parameter (4,5 miliar parameter aktivasi)

Skalabilitas ini memastikan kemampuannya untuk beradaptasi dengan kebutuhan aplikasi dan anggaran komputasi yang berbeda.

Arsitektur DeepSeek-VL2 dirancang untuk mengoptimalkan kinerja sekaligus mengurangi kebutuhan komputasi. Metode pemotongan dinamis memastikan gambar beresolusi tinggi diproses tanpa kehilangan detail penting, sehingga ideal untuk analisis dokumen dan tugas pelokalan visual. Selain itu, mekanisme perhatian laten multi-head memungkinkan model memproses data teks dalam jumlah besar secara efisien, mengurangi overhead komputasi yang biasanya terkait dengan pemrosesan input bahasa yang padat. Pelatihan DeepSeek-VL2 mencakup kumpulan data multi-modal yang beragam, memungkinkannya bekerja dengan baik dalam berbagai tugas seperti pengenalan karakter optik, menjawab pertanyaan visual, dan interpretasi bagan.

Berdasarkan uji performa, konfigurasi Kecil mencapai akurasi 92,3% dalam tugas pengenalan karakter optik, jauh melampaui model yang ada. Dalam pengujian benchmark pemosisian visual, model ini meningkatkan akurasi sebesar 15% dibandingkan produk generasi sebelumnya.

Pada saat yang sama, DeepSeek-VL2 mengurangi kebutuhan sumber daya komputasi sebesar 30% dengan tetap menjaga akurasi mutakhir. Hasil ini menunjukkan keunggulan model ini dalam pemrosesan gambar dan teks resolusi tinggi.

Pintu masuk proyek: https://huggingface.co/collections/deepseek-ai/deepseek-vl2-675c22accc456d3beb4613ab

Highlight:

Seri DeepSeek-VL2 menyediakan berbagai konfigurasi parameter untuk beradaptasi dengan kebutuhan aplikasi yang berbeda.

Teknologi pemotongan dinamis meningkatkan efisiensi pemrosesan gambar resolusi tinggi dan cocok untuk analisis dokumen yang kompleks.

Model ini bekerja dengan baik dalam tugas pengenalan karakter optik dan pelokalan visual, dengan akurasi yang meningkat secara signifikan.

Model seri DeepSeek-VL2 telah membawa terobosan baru di bidang model bahasa visual dengan arsitektur inovatif dan kinerja luar biasa. Keunggulannya dalam gambar resolusi tinggi dan pemrosesan teks yang kompleks membuatnya menunjukkan potensi besar dalam banyak skenario aplikasi dan patut mendapat perhatian dan penelitian lebih lanjut.