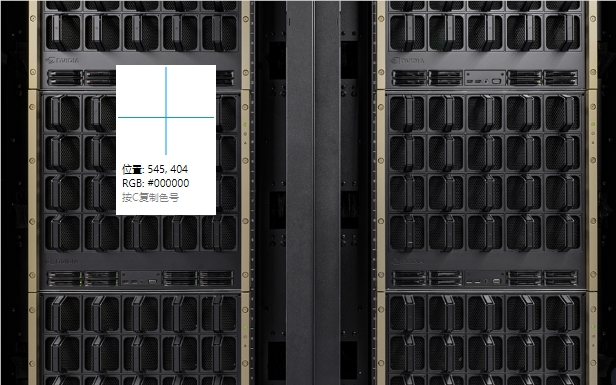

NVIDIA baru -baru ini merilis platform baru Blackwell dan menunjukkan peningkatan kinerja yang mengesankan dalam patokan MLPERF Training 4.1. Dibandingkan dengan platform hopper sebelumnya, Blackwell menggandakan kinerjanya dalam beberapa tugas pelatihan AI, terutama dalam pelatihan model bahasa besar (LLM), dan efisiensinya telah meningkat secara signifikan. Kemajuan terobosan ini menunjukkan lompatan lain dalam kekuatan komputasi AI dan meletakkan dasar yang kuat untuk implementasi aplikasi AI yang meluas di masa depan. Artikel ini akan melakukan analisis mendalam tentang kinerja platform Blackwell dan membahas inovasi teknologinya dan pengembangan di masa depan.

Baru -baru ini, NVIDIA merilis platform Blackwell yang baru dan menunjukkan kinerja pendahuluan dalam patokan MLPERF Training 4.1. Menurut hasil tes, kinerja Blackwell dalam beberapa aspek telah dua kali lipat dibandingkan dengan generasi platform hopper sebelumnya, dan pencapaian ini telah menarik perhatian luas dari industri.

Dalam pelatihan MLPERF4.1 Benchmark, platform Blackwell mencapai 2,2 kali kinerja setiap GPU dalam tugas penyempurnaan LLAMA270B dari tolok ukur LLM (model bahasa besar), dan 2 kali kinerja setiap GPU dalam pra-pelatihan pra-pelatihan GPT-3175B menggandakan peningkatan. Selain itu, dalam tolok ukur lain seperti pelatihan Difusi V2 yang stabil, generasi baru Blackwell juga melampaui generasi sebelumnya sebesar 1,7 kali.

Perlu dicatat bahwa sementara Hopper terus menunjukkan peningkatan, Hopper juga memiliki peningkatan kinerja 1,3x dalam model pra-pelatihan model bahasa dibandingkan dengan putaran sebelumnya dari tolok ukur pelatihan MLPERF. Ini menunjukkan bahwa teknologi Nvidia terus meningkat. Dalam benchmark GPT-3175B baru-baru ini, NVIDIA mengirimkan 11.616 Hopper GPU, menetapkan catatan ekspansi baru.

Mengenai detail teknis Blackwell, Nvidia mengatakan arsitektur baru menggunakan inti tensor yang dioptimalkan dan memori bandwidth tinggi yang lebih cepat. Ini membuatnya hanya 64 GPU untuk menjalankan patokan GPT-3175B, sementara 256 GPU untuk mencapai kinerja yang sama menggunakan platform Hopper.

NVIDIA juga menekankan peningkatan kinerja produk generasi Hopper dalam pembaruan perangkat lunak dan jaringan di konferensi pers, dan diharapkan bahwa Blackwell akan terus meningkat dengan pengiriman di masa depan. Selain itu, NVIDIA berencana untuk meluncurkan generasi berikutnya dari akselerator AI Blackwell Ultra tahun depan, yang diharapkan dapat memberikan lebih banyak daya komputasi memori dan lebih kuat.

Blackwell juga memulai debutnya September lalu di benchmark MLPERF Inference v4.1, dan dalam hal inferensi AI, ia mencapai kinerja 4 kali lebih menakjubkan per GPU daripada H100, terutama dengan esensi akurasi FP4 yang lebih rendah Tren baru ini dirancang untuk mengatasi meningkatnya permintaan untuk chatbots latensi rendah dan komputasi pintar seperti model O1 Openai.

Poin:

- ** Platform Nvidia Blackwell menggandakan kinerjanya dalam pelatihan AI, melanggar standar industri! **

- ** Blackwell hanya membutuhkan 64 GPU di tolok ukur GPT-3175B, secara signifikan meningkatkan efisiensi! **

- ** Blackwell Ultra akan diluncurkan tahun depan, yang diharapkan dapat memberikan daya memori dan komputasi yang lebih tinggi! **

Singkatnya, kemunculan platform Blackwell Nvidia menandai terobosan besar di bidang komputasi AI. Peningkatan kinerja yang signifikan dan peluncuran Blackwell Ultra di masa depan akan lebih mempromosikan pengembangan dan penerapan teknologi AI dan membawa lebih banyak kemungkinan ke semua industri. Kami memiliki alasan untuk mengharapkan platform Blackwell memainkan peran yang lebih besar di masa depan.