Perkembangan cepat model bahasa besar telah membawa banyak kenyamanan, tetapi juga menghadapi tantangan kecepatan respons. Dalam skenario di mana iterasi yang sering diperlukan, seperti modifikasi dokumen dan refactoring kode, masalah penundaan dapat secara serius mempengaruhi pengalaman pengguna. Untuk mengatasi masalah ini, OpenAI memperkenalkan fitur "output prediktif", yang secara signifikan meningkatkan kecepatan respons GPT-4O dan GPT-4O-Mini melalui teknologi decoding spekulatif, sehingga meningkatkan pengalaman pengguna dan mengurangi biaya infrastruktur.

Munculnya model bahasa besar seperti GPT-4O dan GPT-4O-Mini telah mendorong kemajuan besar di bidang pemrosesan bahasa alami. Model-model ini dapat menghasilkan respons berkualitas tinggi, melakukan penulisan ulang dokumen, dan meningkatkan produktivitas dalam berbagai aplikasi. Namun, salah satu tantangan utama yang dihadapi model -model ini adalah keterlambatan pembuatan respons. Penundaan ini dapat secara serius mempengaruhi pengalaman pengguna selama proses memperbarui blog atau mengoptimalkan kode, terutama dalam skenario di mana beberapa iterasi diperlukan, seperti modifikasi dokumen atau refactoring kode, dan pengguna sering frustrasi.

Untuk mengatasi tantangan ini, Openai memperkenalkan fitur "output yang diprediksi", yang secara signifikan mengurangi latensi GPT-4O dan GPT-4O-Mini, mempercepat pemrosesan dengan memberikan string referensi. Inti dari inovasi ini adalah kemampuan untuk memprediksi apa yang mungkin dan menggunakannya sebagai titik awal model, sehingga melewatkan bagian yang sudah jelas.

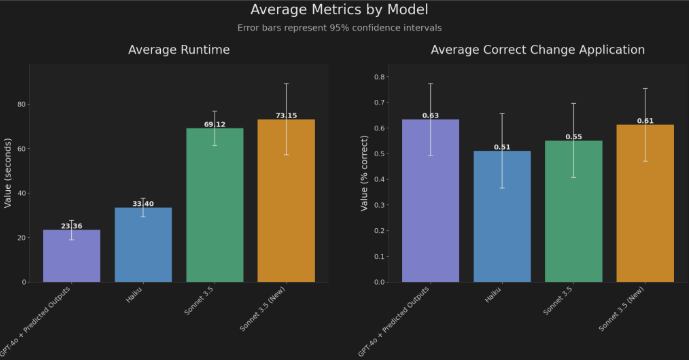

Dengan mengurangi jumlah perhitungan, metode decoding spekulatif ini dapat mengurangi waktu respons hingga lima kali, membuat GPT-4O lebih cocok untuk tugas-tugas real-time seperti pembaruan dokumen, pengeditan kode, dan kegiatan lain yang memerlukan pembuatan teks berulang. Peningkatan ini sangat bermanfaat bagi pengembang, pembuat konten, dan profesional yang membutuhkan pembaruan cepat dan mengurangi waktu henti.

Mekanisme di balik fungsi "output prediktif" adalah decoding spekulatif, pendekatan pintar yang memungkinkan model untuk melewatkan apa yang diketahui atau dapat diharapkan.

Bayangkan jika Anda memperbarui dokumen, hanya sejumlah kecil pengeditan yang perlu dilakukan. Model GPT tradisional menghasilkan teks kata demi kata dan mengevaluasi setiap markup yang mungkin pada setiap tahap, yang bisa sangat memakan waktu. Namun, dengan bantuan decoding spekulatif, jika sebagian teks dapat diprediksi berdasarkan string referensi yang disediakan, model dapat melewati bagian -bagian ini dan langsung ke bagian yang perlu dihitung.

Mekanisme ini secara signifikan mengurangi latensi, sehingga memungkinkan untuk mengulangi respons sebelumnya dengan cepat. Selain itu, fungsi output prediktif sangat efektif dalam skenario turnaround cepat seperti kolaborasi dokumen real-time, refactoring kode cepat, atau pembaruan artikel instan. Pengenalan fitur ini memastikan bahwa interaksi pengguna dengan GPT-4O tidak hanya lebih efisien, tetapi juga mengurangi beban infrastruktur, sehingga mengurangi biaya.

Hasil tes OpenAI menunjukkan bahwa GPT-4O telah secara signifikan meningkatkan kinerjanya pada tugas-tugas yang peka terhadap latensi, dengan kecepatan respons meningkat hingga lima kali dalam skenario aplikasi umum. Dengan mengurangi latensi, output yang diprediksi tidak hanya menghemat waktu, tetapi juga membuat GPT-4O dan GPT-4O-Mini lebih mudah diakses oleh basis pengguna yang lebih luas, termasuk pengembang profesional, penulis, dan pendidik.

Fitur "output prediktif" Openai menandai langkah penting dalam menyelesaikan keterbatasan utama keterlambatan model bahasa. Dengan mengadopsi decoding spekulatif, fitur ini secara signifikan mempercepat tugas -tugas seperti pengeditan dokumen, iterasi konten dan rekonstruksi kode. Pengurangan waktu tanggapan telah membawa perubahan pada pengalaman pengguna, membuat GPT-4O masih menjadi pemimpin dalam aplikasi praktis.

Portal Pendahuluan Fungsi Resmi: https://platform.openai.com/docs/guides/lateency-optimization#use-predicted-outputs

Poin -Poin Kunci:

Fungsi output yang diprediksi secara signifikan mengurangi latensi respons dan meningkatkan kecepatan pemrosesan dengan memberikan string referensi.

Fitur ini memungkinkan pengguna untuk meningkatkan waktu respons mereka hingga lima kali dalam tugas seperti pengeditan dokumen dan refactoring kode.

Pengenalan kemampuan output prediktif memberikan pengembang dan pembuat konten dengan alur kerja yang lebih efisien, mengurangi beban infrastruktur.

Singkatnya, peluncuran fungsi "output prediktif" secara efektif memecahkan masalah penundaan respons model bahasa besar, sangat meningkatkan pengalaman pengguna dan efisiensi kerja, dan meletakkan dasar yang kuat untuk penggunaan luas GPT-4O dan GPT-4- mini dalam aplikasi praktis. Inovasi Openai ini tidak diragukan lagi akan mempromosikan pengembangan lebih lanjut dari bidang pemrosesan bahasa alami.