SAM 2 Core ML 모델용 Swift 데모 앱입니다.

SAM 2(Segment Anything in Images and Videos)는 이미지와 비디오의 신속한 시각적 분할 문제를 해결하는 것을 목표로 하는 FAIR의 기반 모델 모음입니다. 자세한 내용은 SAM 2 문서를 참조하세요.

여기에서 컴파일된 버전을 다운로드하세요!.

직접 컴파일하고 싶거나 더 큰 모델을 사용하고 싶다면 저장소를 다운로드하고 Xcode로 컴파일한 후 실행하면 됩니다. 앱은 소형 버전의 모델과 함께 제공되지만 지원되는 모델 중 하나로 교체할 수 있습니다.

SAM 2.1 아주 작음

SAM 2.1 소형

SAM 2.1 베이스

SAM 2.1 대형

이전 모델의 경우 HuggingFace에서 Apple 조직을 확인하세요.

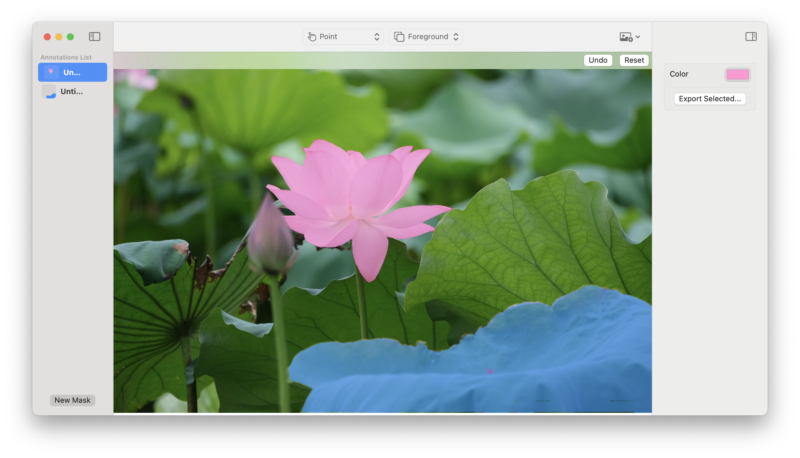

이 데모는 이미지를 지원하며, 비디오 지원은 나중에 제공될 예정입니다.

하나 이상의 전경 지점을 선택하여 이미지의 개체를 선택할 수 있습니다. 각각의 추가 포인트는 이전 마스크의 개선 으로 해석됩니다.

배경 점을 사용하여 현재 마스크에서 제거할 영역을 나타냅니다.

상자를 사용하여 관심 있는 개체가 포함된 대략적인 영역을 선택할 수 있습니다.

미세 조정된 모델을 사용하려면 SAM 2 저장소의 이 포크를 사용하여 변환할 수 있습니다. 어떤 용도로 사용하는지 알려주세요!

피드백, 이슈, PR을 환영합니다! 편하게 연락주세요.

SAM 2 논문, 모델 또는 소프트웨어를 인용하려면 다음을 사용하십시오.

@article{ravi2024sam2,

title={SAM 2: Segment Anything in Images and Videos},

author={Ravi, Nikhila and Gabeur, Valentin and Hu, Yuan-Ting and Hu, Ronghang and Ryali, Chaitanya and Ma, Tengyu and Khedr, Haitham and R{"a}dle, Roman and Rolland, Chloe and Gustafson, Laura and Mintun, Eric and Pan, Junting and Alwala, Kalyan Vasudev and Carion, Nicolas and Wu, Chao-Yuan and Girshick, Ross and Doll{'a}r, Piotr and Feichtenhofer, Christoph},

journal={arXiv preprint arXiv:2408.00714},

url={https://arxiv.org/abs/2408.00714},

year={2024}

}