멋진 AGI 설문조사

인공일반지능(Artificial General Intelligence)에 관해 꼭 읽어야 할 논문

? 소식

- [2024-10] ? 우리 논문은 TMLR 2024에 승인되었습니다.

- [2024-05] ? 우리는 ICLR 2024에서 AGI 워크숍을 조직하고 "우리는 AGI로부터 얼마나 멀리 떨어져 있습니까?"라는 입장 문서를 발표했습니다.

우리 프로젝트는 AGI의 발전과 병행하여 발전할 지속적이고 개방적인 계획입니다. 우리는 커뮤니티의 피드백과 요청을 따뜻하게 환영하며 매년 논문을 업데이트할 계획입니다. 프로젝트 웹사이트의 기여자들은 향후 개정에서 감사의 마음을 표할 것입니다.

우리의 작업/자료가 유용하다고 생각되면 BibTex 인용:

@article { feng2024far ,

title = { How Far Are We From AGI } ,

author = { Feng, Tao and Jin, Chuanyang and Liu, Jingyu and Zhu, Kunlun and Tu, Haoqin and Cheng, Zirui and Lin, Guanyu and You, Jiaxuan } ,

journal = { arXiv preprint arXiv:2405.10313 } ,

year = { 2024 }

} 콘텐츠

- 콘텐츠

- 1. 소개

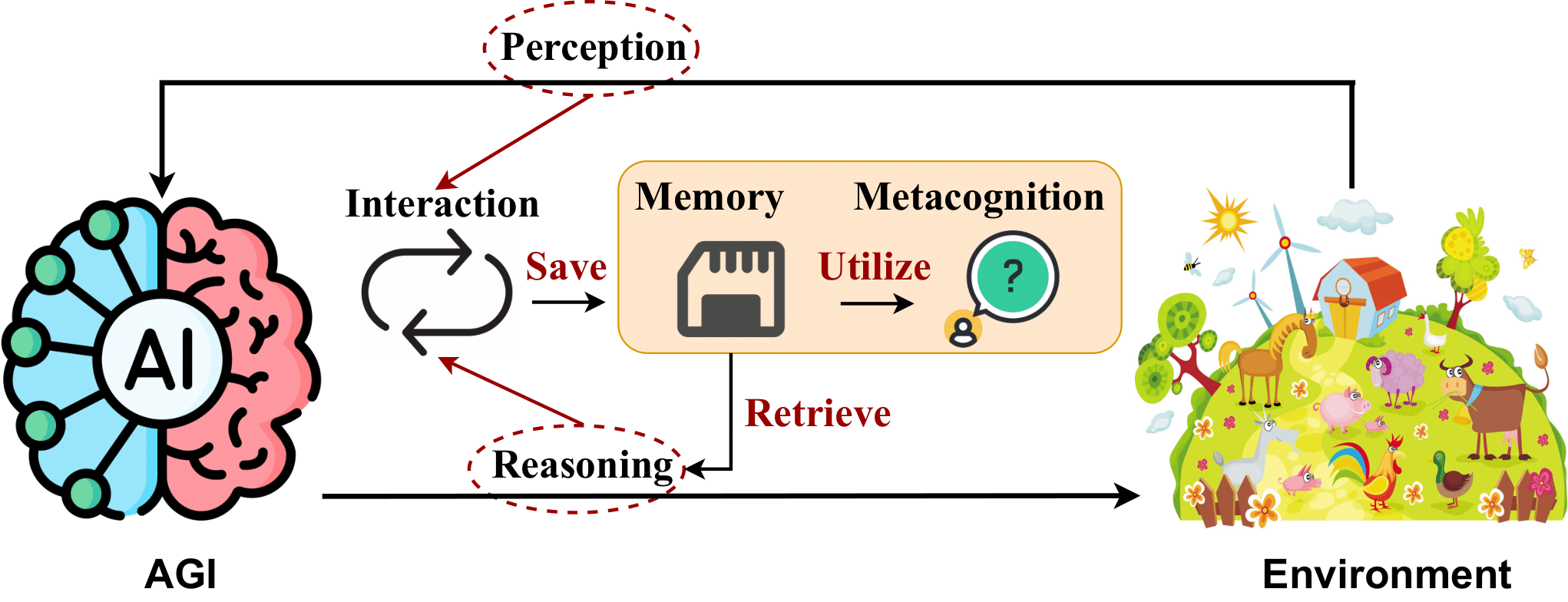

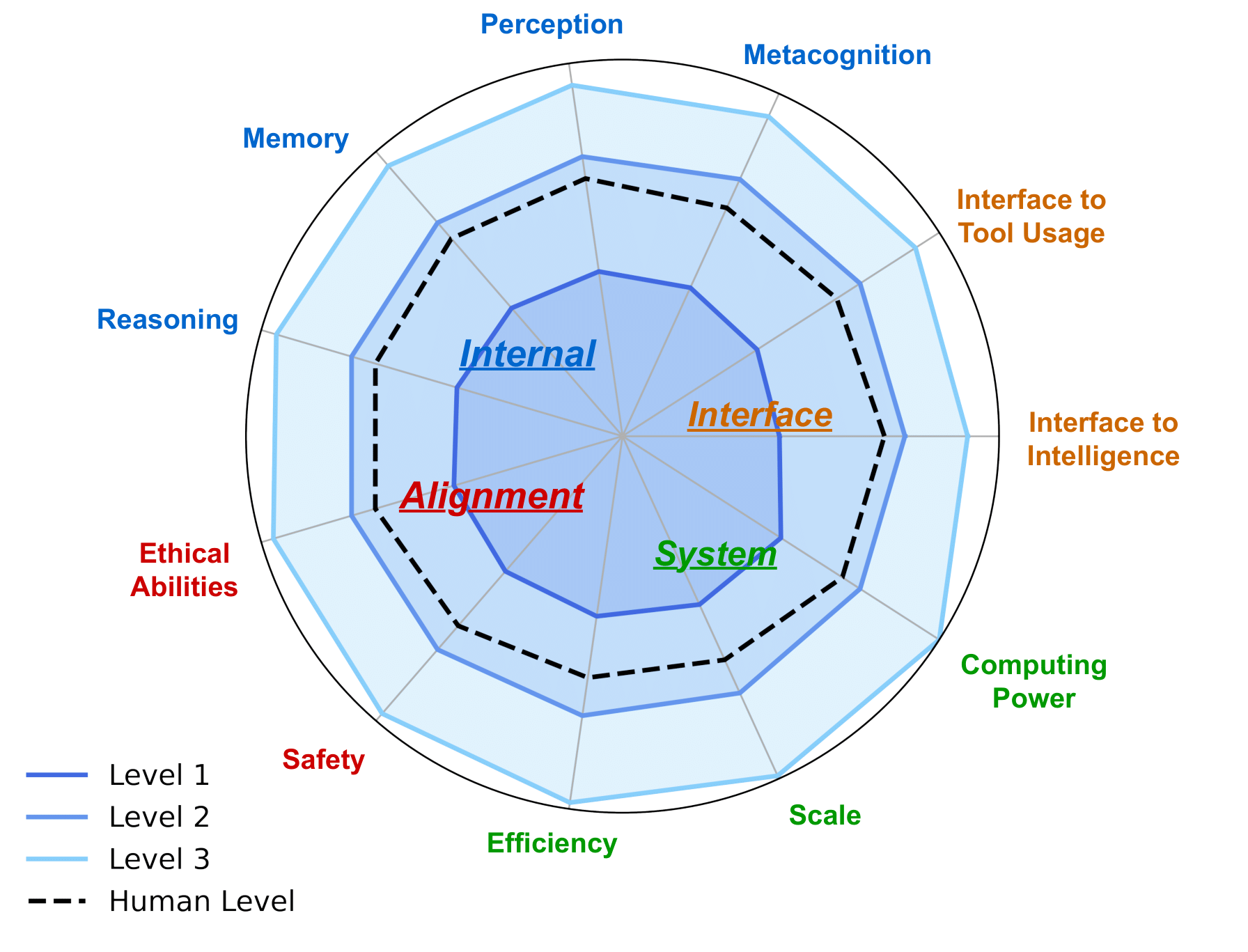

- 2. AGI 내부: AGI의 정신 공개

- 2.1 AI 인식

- 2.2 AI 추론

- 2.3 AI 메모리

- 2.4 AI 메타인지

- 3. AGI 인터페이스: AGI로 세상을 연결하다

- 3.1 디지털 세계에 대한 AI 인터페이스

- 3.2 물리적 세계에 대한 AI 인터페이스

- 3.3 지능에 대한 AI 인터페이스

- 3.3.1 AI 에이전트에 대한 AI 인터페이스

- 3.3.2 인간과 AI의 인터페이스

- 4. AGI 시스템: AGI 메커니즘 구현

- 4.2 확장 가능한 모델 아키텍처

- 4.3 대규모 훈련

- 4.4 추론 기법

- 4.5 비용과 효율성

- 4.6 컴퓨팅 플랫폼

- 5. AGI 정렬: AGI가 다양한 요구 사항을 충족하도록 보장

- 5.1 AGI 정렬에 대한 기대

- 5.2 현재 정렬 기술

- 5.3 AGI 정렬에 접근하는 방법

- 6. AGI 로드맵: 책임감 있는 AGI 접근

- 6.1 AI 수준: 인공 지능의 진화를 도표로 작성

- 6.2 AGI 평가

- 6.2.1 AGI 평가에 대한 기대

- 6.2.2 현재의 평가와 한계

- 6.5 AGI 개발 중 추가 고려사항

- 7. 사례 연구

- 7.1 과학 발견과 연구를 위한 AI

- 7.2 생성적 시각 지능

- 7.3 월드 모델

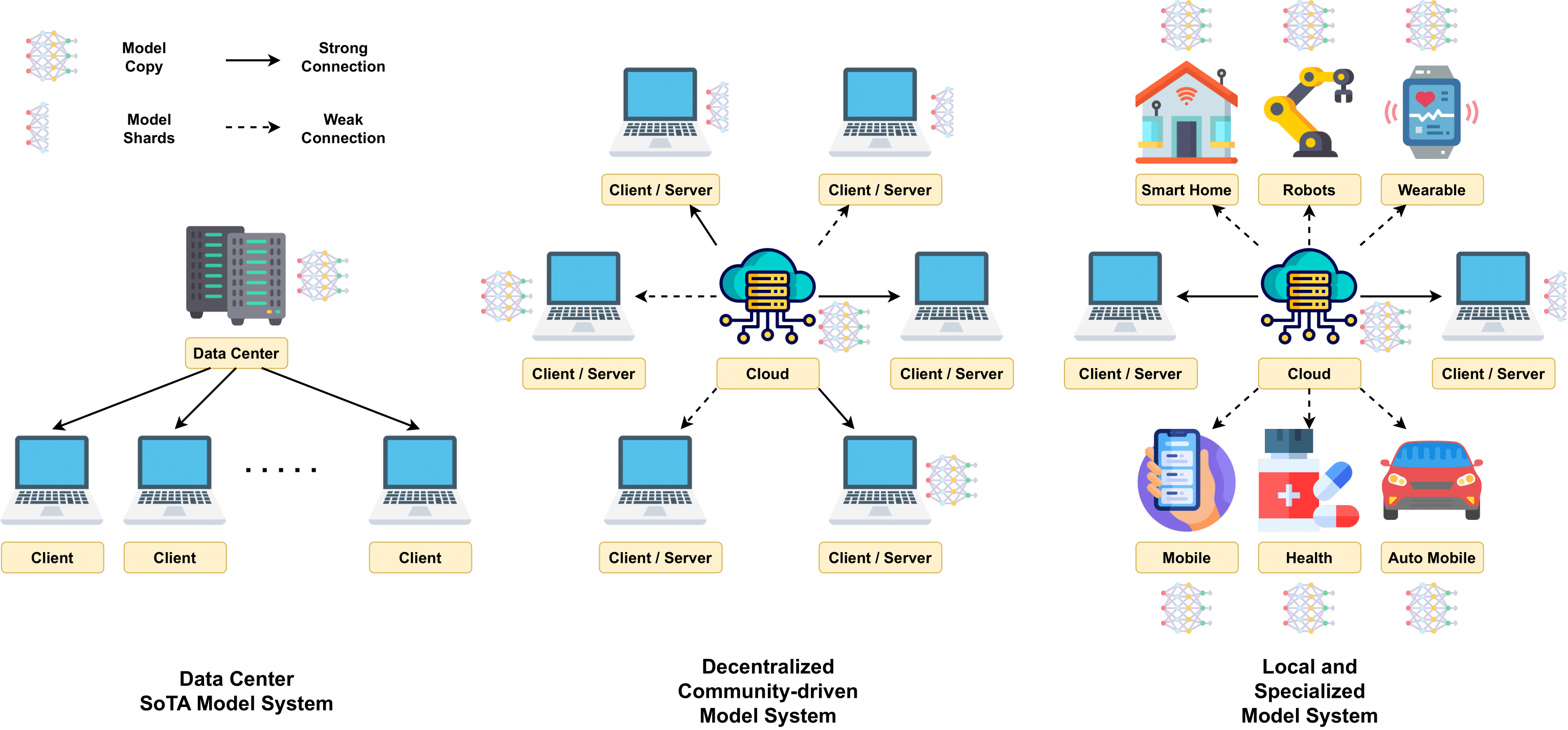

- 7.4 분산형 LLM

- 7.5 코딩을 위한 AI

- 7.6 실제 응용 분야의 로봇공학을 위한 AI

- 7.7 인간-AI 협업

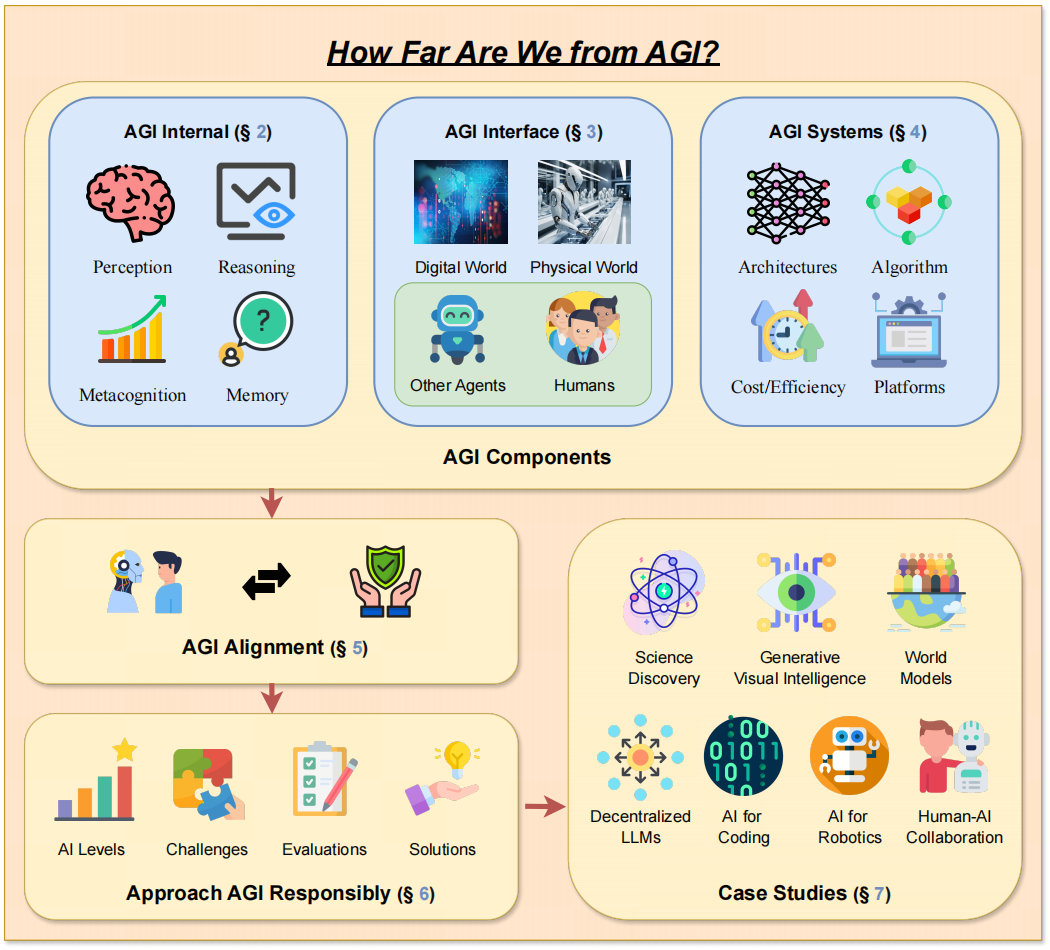

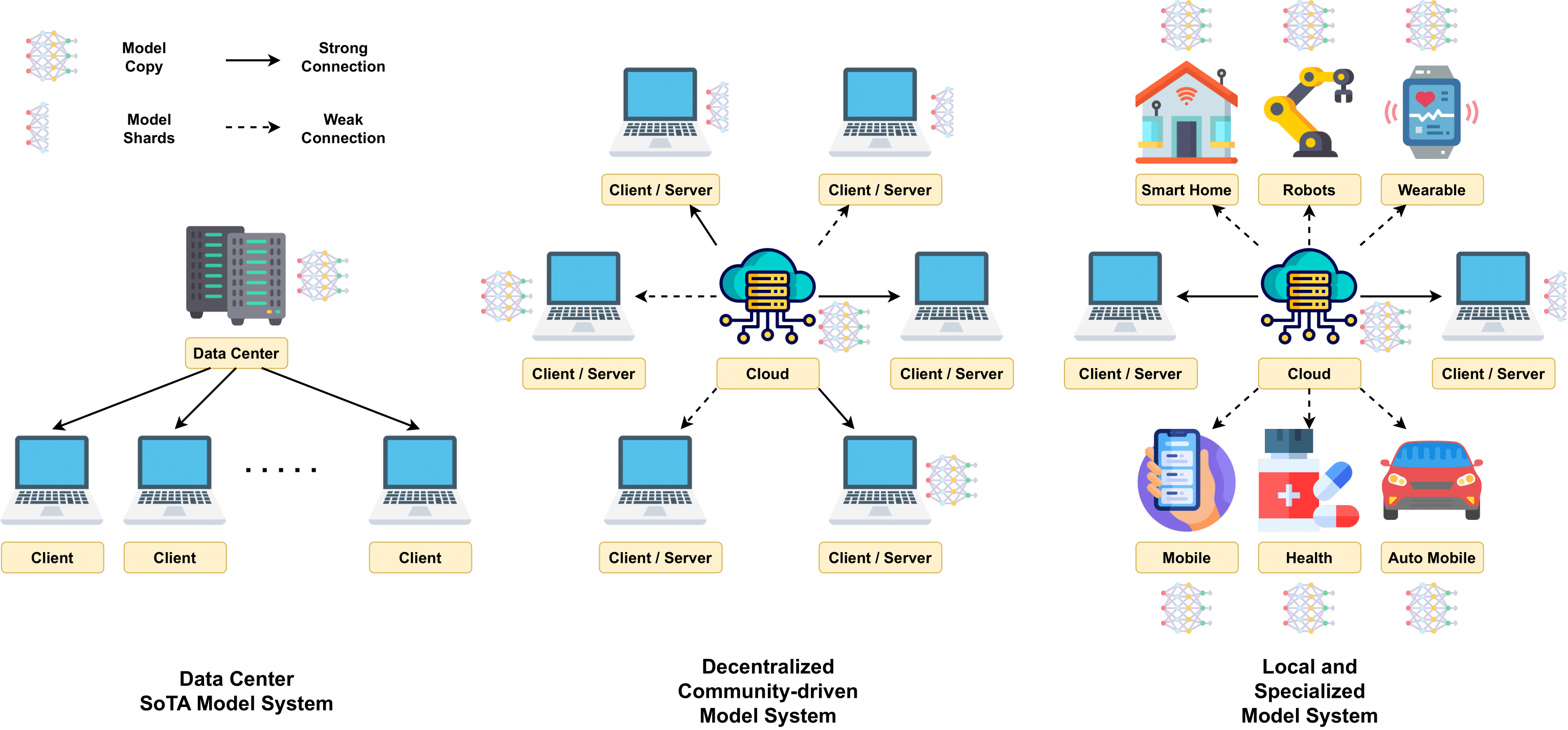

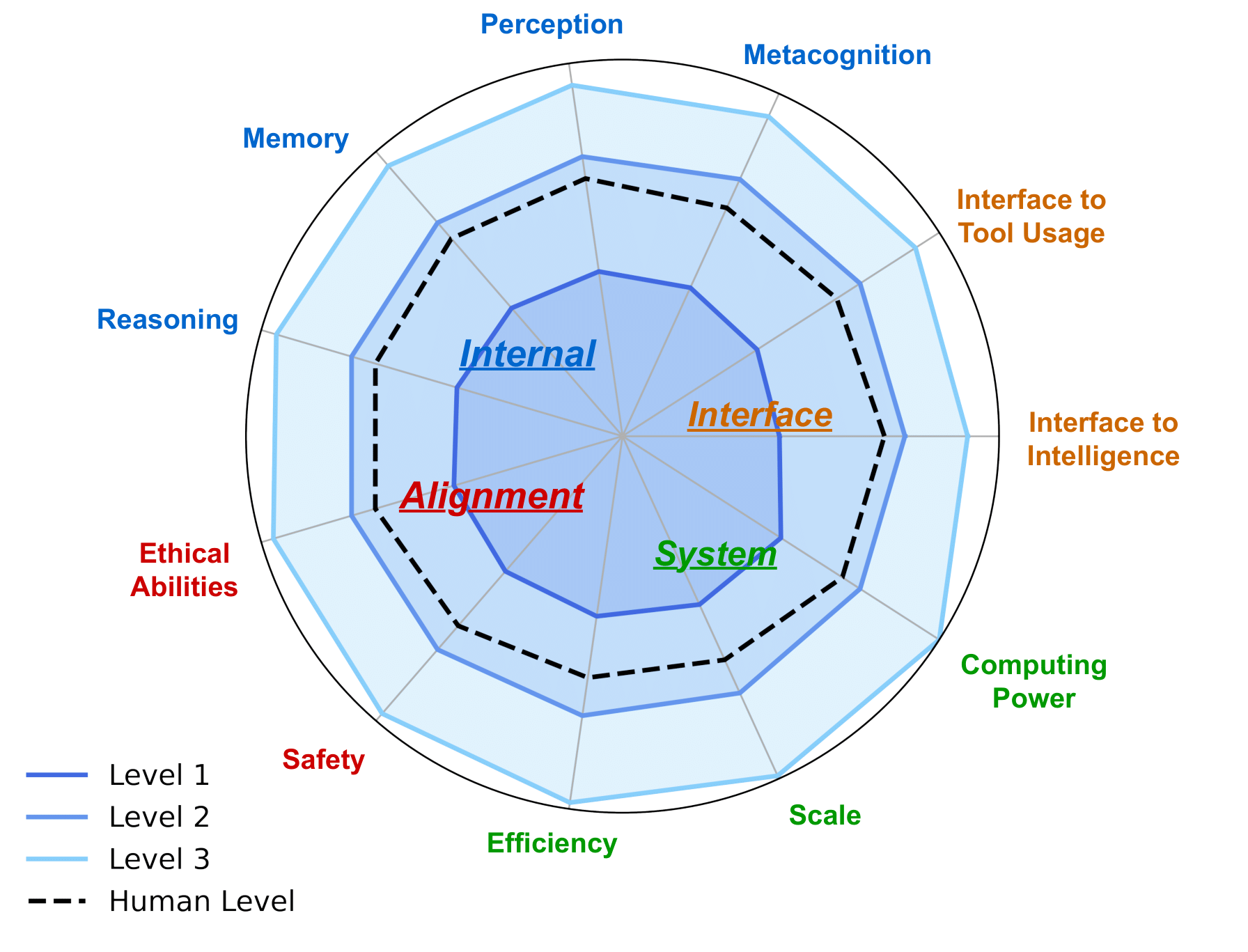

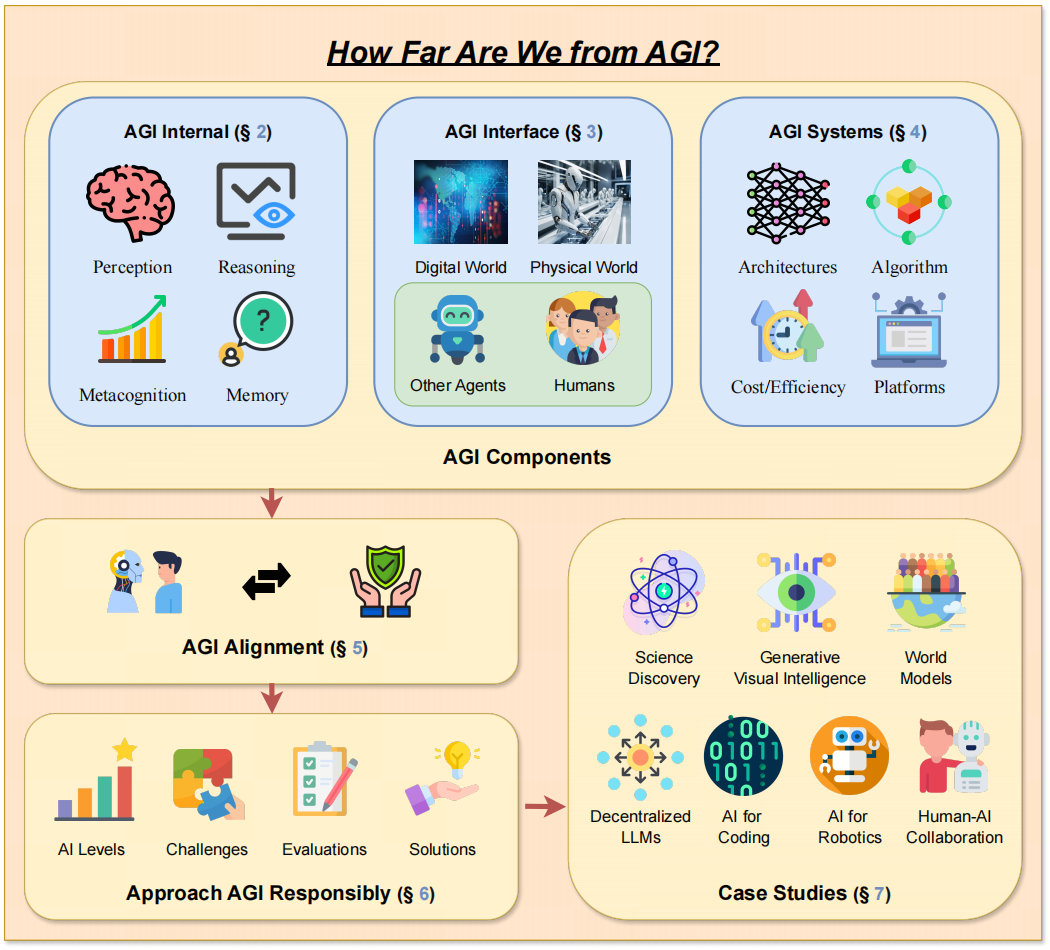

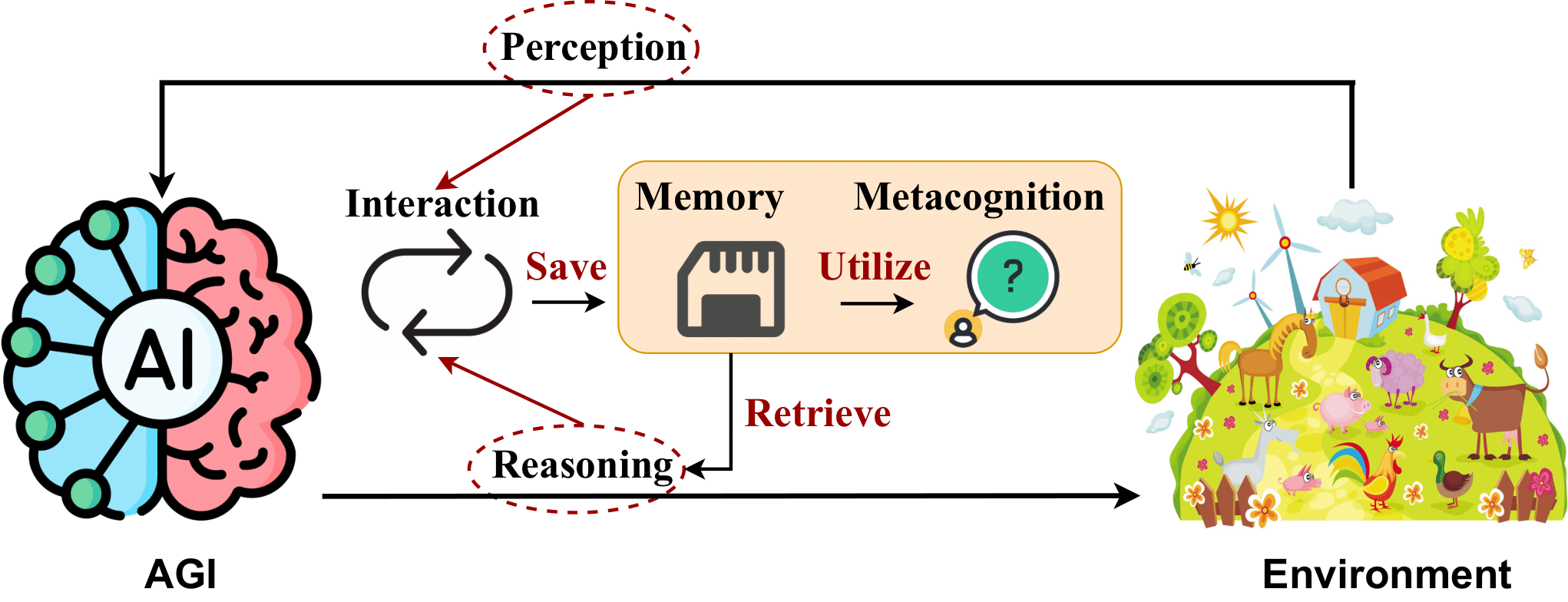

-> 우리 논문의 프레임워크 디자인. <-

1. 소개

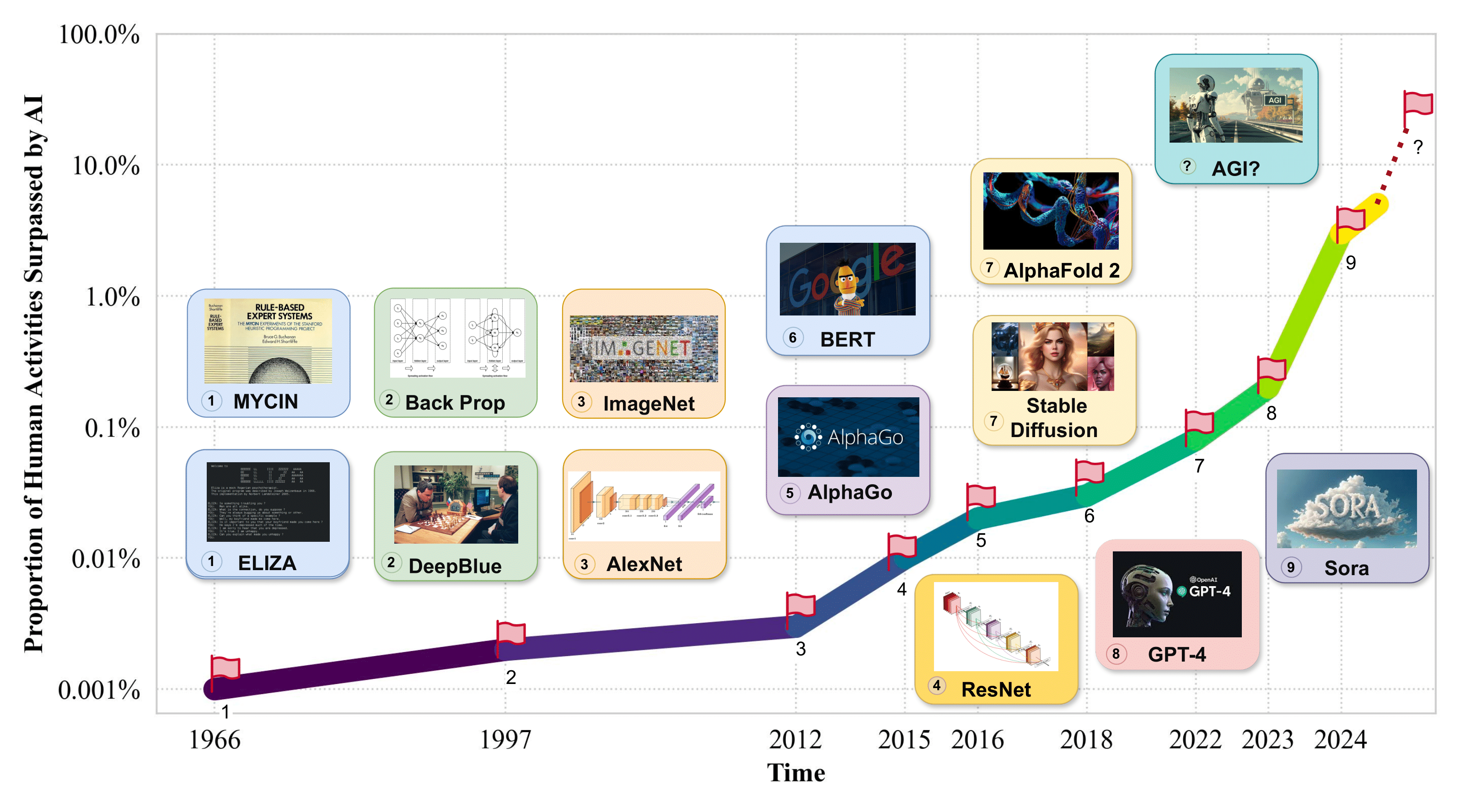

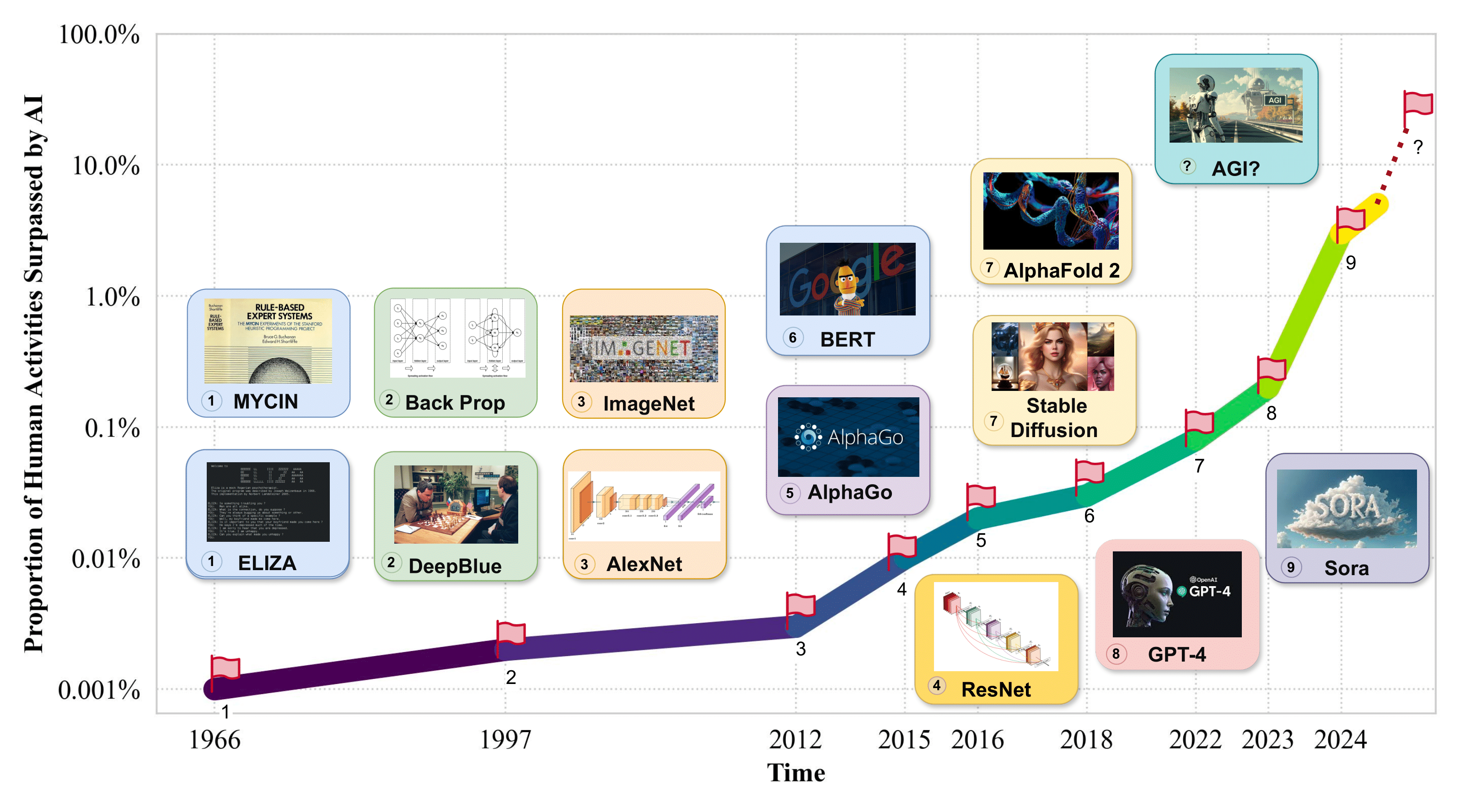

-> AI가 인간 활동을 능가하는 비율. <-

2. AGI 내부: AGI의 정신 공개

2.1 AI 인식

- Flamingo: Few-Shot 학습을 위한 시각적 언어 모델 . Jean-Baptiste Alayrac 등. NeurIPS 2022. [논문]

- BLIP-2: Frozen Image Encoder 및 Large Language Model을 사용한 부트스트래핑 언어-이미지 사전 훈련 . Junnan Liet al. ICML 2023. [논문]

- SPHINX: 다중 모드 대형 언어 모델을 위한 가중치, 작업 및 시각적 임베딩의 공동 혼합 . Ziyi Linet al. EMNLP 2023. [논문]

- 시각적 교육 튜닝 . Haotian Liu et al. NeurIPS 2023. [논문]

- GPT4Tools: 자가 지시를 통해 도구를 사용하도록 대규모 언어 모델 교육 . Rui Yanget al. NeurIPS 2023. [논문]

- Otter: 상황에 맞는 명령어 조정을 갖춘 다중 모드 모델 . Bo Liet al. arXiv 2023. [논문]

- VideoChat: 채팅 중심의 비디오 이해 . KunChang Liet al. arXiv 2023. [논문]

- mPLUG-Owl: 모듈화는 다중 양식을 통해 대규모 언어 모델을 강화합니다 . Qinghao Ye et al. arXiv 2023. [논문]

- 다중 모드 대형 언어 모델에 대한 조사 . Shukang Yin et al. arXiv 2023. [논문]

- PandaGPT: 하나의 모델로 지침을 따르세요 . Yixuan Suet al. arXiv 2023. [논문]

- LLaMA-Adapter: Zero-init Attention을 사용하여 언어 모델을 효율적으로 미세 조정합니다 . Renrui Zhanget al. arXiv 2023. [논문]

- Gemini: 고성능 다중 모드 모델 제품군 . Rohan Anilet al. arXiv 2023. [논문]

- Shikra: 멀티모달 LLM의 참조 대화 마법 출시 . Keqin Chenet al. arXiv 2023. [논문]

- ImageBind: 모두를 바인딩하는 하나의 임베딩 공간 . Rohit Girdharet al. CVPR 2023. [논문]

- MobileVLM: 모바일 장치를 위한 빠르고 강력하며 개방형 비전 언어 도우미 . Xiangxiang Chuet al. arXiv 2023. [논문]

- 대규모 언어 모델을 위한 좋은 시각적 토크나이저를 만드는 것은 무엇입니까? . Guangzhi Wanget al. arXiv 2023. [논문]

- MiniGPT-4: 고급 대형 언어 모델을 통한 시각-언어 이해 강화 . Deyao Zhuet al. ICLR 2024. [논문]

- LanguageBind: 언어 기반 의미 정렬을 통해 비디오 언어 사전 훈련을 N-양식으로 확장합니다 . Bin Zhu et al. ICLR 2024. [논문]

2.2 AI 추론

- 생각의 연쇄 유도는 대규모 언어 모델에서 추론을 이끌어냅니다 . Jason Weiet al. NeurIPS 2022. [논문]

- 신경정신이론? 대규모 LM의 사회 지능의 한계에 대하여 . Maarten Sapet al. EMNLP 2022. [논문]

- 내면의 독백: 언어 모델을 이용한 계획을 통한 구체화된 추론 . Wenlong Huanget al. CoRL 2022. [논문]

- 자연어 생성의 환각 조사 . Ziwei Jiet al. ACM 컴퓨팅 설문조사 2022. [논문]

- ReAct: 언어 모델에서 추론과 행동의 시너지 효과 . Shunyu Yaoet al. ICLR 2023. [논문]

- 분해된 프롬프트: 복잡한 작업 해결을 위한 모듈식 접근 방식 . Tushar Khotet al. ICLR 2023. [논문]

- 다단계 추론을 위한 복잡성 기반 프롬프트 . Yao Fuet al. ICLR 2023. [논문]

- 최소 대 최대 프롬프트는 대규모 언어 모델에서 복잡한 추론을 가능하게 합니다 . 데니 조우(Denny Zhou) 외. ICLR 2023. [논문]

- 대규모 언어 모델의 추론을 향하여: 설문 조사 . Jie Huanget al. ACL 조사 결과 2023. [논문]

- ProgPrompt: 대규모 언어 모델을 사용하여 위치 로봇 작업 계획 생성 . Ishika Singhet al. ICRA 2023. [논문]

- 언어 모델을 이용한 추론은 세계 모델을 이용한 계획입니다 . Shibo Haoet al. EMNLP 2023. [논문]

- 대형 시각 언어 모델에서 대상 환각 평가 . Yifan Liet al. EMNLP 2023. [논문]

- 생각의 나무: 대규모 언어 모델을 사용한 고의적 문제 해결 . Shunyu Yaoet al. NeurIPS 2023. [논문]

- 자체 개선: 자체 피드백을 통한 반복적 개선 . Aman Madaanet al. NeurIPS 2023. [논문]

- 성찰: 언어 강화 학습을 통한 언어 에이전트 . 노아 신 외. NeurIPS 2023. [논문]

- 설명, 설명, 계획 및 선택: 대규모 언어 모델을 사용한 대화형 계획을 통해 개방형 다중 작업 에이전트가 가능합니다 . Zihao Wanget al. NeurIPS 2023. [논문]

- LLM+P: 최적의 계획 능력으로 대규모 언어 모델 강화 . Bo Liu et al. arXiv 2023. [논문]

- 언어 모델, 에이전트 모델 및 월드 모델: 기계 추론 및 계획을 위한 법칙 . Zhiting Huet al. arXiv 2023. [논문]

- MMToM-QA: 다중 모드 이론 질문 답변 . Chuanyang Jinet al. arXiv 2024. [논문]

- 생각의 그래프: 대규모 언어 모델을 사용하여 정교한 문제 해결 . Maciej Bestaet al. AAAI 2024. [논문]

- GSM8K에서 97% 이상 달성: 문제를 깊이 이해하면 LLM이 완벽한 추론자가 됩니다 . Qihuang Zhong et al. arXiv 2024. [논문] 보류 중

2.3 AI 메모리

- 오픈 도메인 질문 응답을 위한 조밀한 구문 검색 . Vladimir Karpukhinet al. EMNLP 2020. [논문]

- 지식 집약적 NLP 작업을 위한 검색 증강 생성 . 패트릭 루이스 외. NeurIPS 2020. [논문]

- REALM: 검색 증강 언어 모델 사전 훈련 . Kelvin Guu et al. ICML 2020. [논문]

- 검색 증강은 대화에서 환각을 감소시킵니다 . 커트 슈스터 외. EMNLP 조사 결과 2021. [논문]

- 수조 개의 토큰을 검색하여 언어 모델을 개선합니다 . Sebastian Borgeaud 등. ICML 2022. [논문]

- 생성 에이전트: 인간 행동의 대화형 시뮬레이션 . 박준성 외. UIST 2023. [논문]

- 언어 에이전트를 위한 인지 아키텍처 . Theodore R. Sumers 외. TMLR 2024. [논문]

- Voyager: 대규모 언어 모델을 갖춘 개방형 구현 에이전트 . Guanzhi Wanget al. arXiv 2023. [논문]

- 대규모 언어 모델 기반 에이전트의 메모리 메커니즘에 관한 조사 . Zeyu Zhanget al. arXiv 2024. [논문]

- 재귀적으로 요약하면 대규모 언어 모델에서 장기 대화 메모리가 가능해집니다 . Qingyue Wanget al. arXiv 2023. [논문] 보류 중

2.4 AI 메타인지

- 암묵지 외재화와 조직학습의 메타능력에 대한 고찰 . Jyoti Choudrieet al. HICSS 2006. [논문]

- 진화하는 자기 지도 신경망 진화된 자기 교육의 자율 지능 . 남 리 . arXiv 2019. [논문]

- 사전 훈련된 언어 모델을 더 나은 소수의 학습자로 만듭니다 . Tianyu Gaoet al. ACL 2021. [논문]

- 언어 모델의 성격 특성 식별 및 조작 . Graham Caronet al. arXiv 2022. [논문]

- Brainish: 지능과 의식을 위한 다중 모드 언어 형식화 . Paul Lianget al. arXiv 2022. [논문]

- 이론적인 컴퓨터 과학 관점에서 본 의식 이론: 의식 튜링 기계의 통찰력 . Lenore Blumet al. PNAS 2022. [논문]

- WizardLM: 복잡한 지침을 따르도록 대규모 언어 모델 강화 . Can Xu et al. arXiv 2023. [논문]

- Self-Instruct: 언어 모델을 자체 생성 명령어와 정렬 . Yizhong Wanget al. ACL 2023. [논문]

- ReST와 ReAct의 만남: 다단계 추론을 위한 자기 개선 LLM 에이전트 . Renat Aksitovet al. arXiv 2023. [논문]

- 대규모 언어 모델의 문화 심리학: ChatGPT는 전체론적 사고자인가 아니면 분석적 사고자인가? . Chuanyang Jinet al. arXiv 2023. [논문]

- 인공 지능의 의식: 의식 과학의 통찰 . Patrick Butlinet al. arXiv 2023. [논문]

- 대규모 언어 모델에 대한 심리적 척도의 신뢰성 재검토 . Jen-tse Huang et al. arXiv 2023. [논문]

- 사전 훈련된 언어 모델의 성격 평가 및 유도 . Guangyuan Jiang et al. NeurIPS 2024. [논문]

- AGI 수준: AGI로 가는 과정의 운영 진행 . 메러디스 링겔 모리스(Meredith Ringel Morris ) 외. arXiv 2024. [논문] 보류 중

- 조사-통합-악용: 작업 간 에이전트 자체 진화를 위한 일반 전략 . Cheng Qianet al. arXiv 2024. [논문] 보류 중

3. AGI 인터페이스: AGI로 세상을 연결하다

3.1 디지털 세계에 대한 AI 인터페이스

- 혼합 주도형 사용자 인터페이스의 원리 . 에릭 호비츠. SIGCHI 1999. [논문]

- 대규모 언어 모델 기반 에이전트의 부상과 잠재력: 설문조사 . Zhiheng Xiet al. arXiv 2023. [논문]

- 기초 모델을 이용한 도구 학습 . Yujia Qinet al. arXiv 2023. [논문]

- 작성자: 도구 작성을 통해 대규모 언어 모델의 추상적이고 구체적인 추론을 풀어냅니다 . Cheng Qianet al. arXiv 2023. [논문]

- AppAgent: 스마트폰 사용자로서의 다중 모드 에이전트 . Zhao Yanget al. arXiv 2023. [논문]

- Mind2Web: 웹용 종합 에이전트를 향하여 . Xiang Deng et al. NeurIPS 벤치마크 2023. [논문]

- ToolQA: 외부 도구를 사용한 LLM 질문 응답용 데이터 세트 . Yuchen Zhuanget al. arXiv 2023. [논문]

- 생성 에이전트: 인간 행동의 대화형 시뮬레이션 . 박준성 외. arXiv 2023. [논문]

- Toolformer: 언어 모델은 도구 사용 방법을 스스로 학습할 수 있습니다 . Timo Schicket al. arXiv 2023. [논문]

- Gorilla: 대규모 API와 연결된 대규모 언어 모델 . Shishir G Patil 외. arXiv 2023. [논문]

- Voyager: 대규모 언어 모델을 갖춘 개방형 구현 에이전트입니다 . Guanzhi Wanget al. arXiv 2023. [논문]

- OS-Copilot: 자기 개선을 통한 일반 컴퓨터 에이전트를 향하여 . Zhiyong Wu et al. arXiv 2024. [논문]

- WebArena: 자율 에이전트 구축을 위한 현실적인 웹 환경 . Shuyan Zhouet al. ICLR 2024. [논문]

- 도구 제작자로서의 대규모 언어 모델 . Tianle Caiet al. ICLR 2024. [논문]

3.2 물리적 세계에 대한 AI 인터페이스

- Amazon 피킹 챌린지에서 얻은 교훈: 로봇 시스템 구축의 네 가지 측면 . Clemens Eppneret al. RSS 2016. [논문]

- Perceiver-Actor: 로봇 조작을 위한 다중 작업 변환기 . Mohit Shridharet al. arXiv 2022. [논문]

- Vima: 다중 모드 프롬프트를 사용한 일반 로봇 조작 . Yunfan Jiang et al. arXiv 2022. [논문]

- 내가 말하는 대로가 아니라 내가 할 수 있는 대로 하십시오: 로봇 어포던스에 언어 기반 지정 . 마이클 안 외. arXiv 2022. [논문]

- Voxposer: 언어 모델을 사용한 로봇 조작을 위한 구성 가능한 3D 값 맵입니다 . Wenlong Huanget al. arXiv 2023. [논문]

- MotionGPT: 외국어로 인간의 움직임 . Biao Jianget al. arXiv 2023. [논문]

- Rt-2: 비전-언어-행동 모델은 웹 지식을 로봇 제어로 전달합니다 . Anthony Brohanet al. arXiv 2023. [논문]

- 현실 세계의 객체로 이동합니다 . Theophile Gervet 등. 사이언스 로보틱스 2023. [논문]

- Lm-nav: 사전 훈련된 대규모 언어, 시각 및 행동 모델을 갖춘 로봇 탐색 . Dhruv Shahet al. CRL 2023. [논문]

- Palm-e: 구현된 다중 모드 언어 모델 . Danny Dryss 외. arXiv 2023. [논문]

- LLM-Planner: 대규모 언어 모델을 사용하여 구현된 에이전트에 대한 몇 번의 기초 계획 . 송찬희 외. ICCV 2023. [논문]

- Instruct2Act: 대규모 언어 모델을 사용하여 다중 양식 명령을 로봇 동작에 매핑 . Siyuan Huanget al. arXiv 2023. [논문]

- DROID: 대규모 야생 로봇 조작 데이터세트 . Alexander Khazatskyet al. arXiv 2024. [논문]

- BEHAVIOR-1K: 1,000가지 일상 활동과 현실적인 시뮬레이션을 갖춘 인간 중심의 구현된 AI 벤치마크입니다 . Chengshu Li et al. arXiv 2024. [논문]

3.3 지능에 대한 AI 인터페이스

3.3.1 AI 에이전트에 대한 AI 인터페이스

- 반사실적 다중 에이전트 정책 변화 . Jakob Foersteret al. AAAI 2018. [논문]

- 큰 언어 모델의 설명은 작은 추론자를 더 좋게 만듭니다 . Shiyang Liet al. arXiv 2022. [논문]

- 상황 내 학습 증류: 사전 훈련된 언어 모델의 퓨샷 학습 능력 전달 . Yukun Huang et al. arXiv 2022. [논문]

- 자동 에이전트: 자동 에이전트 생성을 위한 프레임워크입니다 . Guangyao Chenet al. arXiv 2023. [논문]

- 중첩된 다중 에이전트 추론을 위한 신경 상각 추론 . Kunal Jhaet al. arXiv 2023. [논문]

- 대규모 언어 모델의 지식 증류 . Yuxian Guet al. arXiv 2023. [논문]

- Metagpt: 다중 에이전트 협업 프레임워크를 위한 메타 프로그래밍 . 홍시루이 외. arXiv 2023. [논문]

- 설명, 설명, 계획 및 선택: 대규모 언어 모델을 사용한 대화형 계획을 통해 개방형 다중 작업 에이전트가 가능합니다 . Zihao Wanget al. arXiv 2023. [논문]

- Agentverse: 다중 에이전트 협업을 촉진하고 에이전트의 긴급 행동을 탐색합니다 . Weize Chenet al. arXiv 2023. [논문]

- 자연어 기반 정신사회의 마인드스톰 Mingchen Zhugeet al. arXiv 2023. [논문]

- Jarvis-1: 메모리 증강 다중 모드 언어 모델을 갖춘 개방형 다중 작업 에이전트 . Zihao Wanget al. arXiv 2023. [논문]

- 상징적 사고 사슬 증류: 소형 모델도 단계별로 "생각"할 수 있습니다 . Liunian Harold Li et al. ACL 2023. [논문]

- 단계별로 증류! 더 적은 훈련 데이터와 더 작은 모델 크기로 더 큰 언어 모델보다 성능이 뛰어납니다 . Cheng-Yu Hsieh et al. arXiv 2023. [논문]

- 약한 대 강한 일반화: 약한 감독으로 강력한 능력 끌어내기 . 콜린 번즈 외. arXiv 2023. [논문]

- 고품질 교육 대화를 확장하여 채팅 언어 모델을 향상합니다 . Ning Ding et al. arXiv 2023. [논문]

- GAIA: 일반 AI 보조자에 대한 벤치마크입니다 . Grégoire Mialon 등. ICLR 2024. [논문]

- Voyager: 대규모 언어 모델을 갖춘 개방형 구현 에이전트입니다 . Guanzhi Wanget al. arXiv 2023. [논문]

- 낙타: 대규모 언어 모델 사회의 "마음" 탐구를 위한 의사소통 에이전트 . Guohao Li et al. arXiv 2023. [논문]

- 다중 보상 증류를 통한 자기 합리화 조정 . Sahana Ramnathet al. arXiv 2023. [논문]

- 비전 초정렬: 비전 기초 모델에 대한 약함 대 강함 일반화 . Jianyuan Guo et al. arXiv 2024. [논문]

- WebArena: 자율 에이전트 구축을 위한 현실적인 웹 환경 . Shuyan Zhouet al. ICLR 2024. [논문]

- 최소한의 인간 감독으로 처음부터 언어 모델의 원칙 중심 자체 정렬입니다 . Zhiqing Sunet al. NeurIPS 2024. [논문]

- Mind2web: 웹을 위한 일반 에이전트를 향하여 . Xiang Deng et al. NeurIPS 2024. [논문]

- 일반 컴퓨터 제어를 향하여: 사례 연구로서 Red Dead Redemption ii의 다중 모드 에이전트 . Weihao Tan et al. arXiv 2024. [논문]

3.3.2 인간과 AI의 인터페이스

- 인간-AI 상호작용에 대한 지침 . Saleema Amershiet al. 치 2019. [논문]

- 생성적 AI 애플리케이션을 위한 설계 원칙 . 저스틴 D. 와이즈 외. 치 2024. [논문]

- 그래프로그: 대화형 다이어그램을 사용한 대규모 언어 모델 응답 탐색 . Peiling Jianget al. UIST 2023. [논문]

- Sensecape: 대규모 언어 모델을 통한 다단계 탐색 및 센스메이킹 지원 . 서상호 외. UIST 2023. [논문]

- 대규모 언어 모델 출력의 센스메이킹 지원 . Katy Ilonka Gero 등. 치 2024. [논문]

- Luminate: 인간-AI 공동 창작을 위한 대규모 언어 모델을 사용한 구조화된 생성 및 디자인 공간 탐색 . 서상호 외. 치 2024. [논문]

- AI 체인: 대규모 언어 모델 프롬프트를 연결하여 투명하고 제어 가능한 인간-AI 상호 작용 . Tongshuang Wu et al. 치 2022. [논문]

- Promptify: 대규모 언어 모델을 사용한 대화형 프롬프트 탐색을 통한 텍스트-이미지 생성 . Stephen Bradeet al. 치 2023. [논문]

- ChainForge: 프롬프트 엔지니어링 및 LLM 가설 테스트를 위한 시각적 툴킷 . Ian Arawjoet al. 치 2024. [논문]

- CoPrompt: 협업 자연어 프로그래밍에서 프롬프트 공유 및 참조 지원 . Li Feng et al. 치 2024. [논문]

- 대규모 언어 모델을 사용하여 UI 모형에 대한 자동 피드백 생성 . Peitong Duan et al. 치 2024. [논문]

- Rambler: LLM 지원 요점 조작을 통해 음성으로 글쓰기 지원 . 수잔 린 외. 치 2024. [논문]

- 확장된 현실에 대규모 언어 모델 내장: 포용, 참여 및 개인 정보 보호를 위한 기회와 과제 . Efe Bozkiret al. arXiv 2024. [논문]

- GenAssist: 이미지 생성에 접근 가능하게 만들기 . Mina Huhet al. UIST 2023. [논문]

- “입력 횟수가 적을수록 좋습니다.”: AI 언어 모델이 AAC 사용자의 의사소통을 향상하거나 방해하는 방법 . 스테파니 발렌시아 외. 치 2023. [논문]

- 인간-AI 상호작용이 설계하기 어려운지 여부, 이유, 방식을 재검토합니다 . Qian Yanget al. 치 2020. [논문]

4. AGI 시스템: AGI 메커니즘 구현

4.2 확장 가능한 모델 아키텍처

- 엄청나게 큰 신경망: 드물게 게이트된 전문가 혼합 계층 . Noam Shazeeret al. arXiv 2017. [논문]

- Transformers는 RNN입니다: 선형 주의를 기울이는 Fast Autoregressive Transformers입니다 . Angelos Katharopouloset al. arXiv 2020. [논문]

- Longformer: 긴 문서 변환기 . Iz Beltagyet al. arXiv 2020. [논문]

- LightSeq: 변환기용 고성능 추론 라이브러리 . Xiaohui Wanget al. arXiv 2021. [논문]

- 스위치 변압기: 간단하고 효율적인 희소성을 사용하여 수조 개의 매개변수 모델로 확장 . 윌리엄 페더스(William Fedus ) 등. arXiv 2022. [논문]

- 구조화된 상태 공간을 사용하여 긴 시퀀스를 효율적으로 모델링합니다 . Albert Guet al. arXiv 2022. [논문]

- MegaBlocks: 전문가 혼합을 통한 효율적인 희소 교육 . Trevor Galeet al. arXiv 2022. [논문]

- 컴퓨팅 최적의 대형 언어 모델 교육 . Jordan Hoffmannet al. arXiv 2022. [논문]

- 기초 모델의 효과적인 장기 컨텍스트 확장 . Wenhan Xionget al. arXiv 2023. [논문]

- 하이에나 계층 구조: 더 큰 컨볼루션 언어 모델을 향하여 . Michael Poliet al. arXiv 2023. [논문]

- Stanford Alpaca: 지시에 따르는 LLaMA 모델 . Rohan Taoriet al. GitHub 2023. [코드]

- Rwkv: 트랜스포머 시대를 위한 RNN 재창조 . Bo Penget al. arXiv 2023. [논문]

- Deja Vu: 추론 시 효율적인 LLM을 위한 상황별 희소성 . Zichang Liu et al. arXiv 2023. [논문]

- Flash-LLM: 구조화되지 않은 희소성을 통해 비용 효율적이고 효율적인 대규모 생성 모델 추론 활성화 . Haojun Xiaet al. arXiv 2023. [논문]

- ByteTransformer: 가변 길이 입력을 위해 강화된 고성능 변환기 . Yujia Zhaiet al. arXiv 2023. [논문]

- Tutel: 규모에 따른 적응형 전문가 혼합 . 황창호 외. arXiv 2023. [논문]

- Mamba: 선택적 상태 공간을 사용한 선형-시간 시퀀스 모델링 . Albert Gu, Tri Dao. arXiv 2023. [논문]

- Hungry Hungry Hippos: 상태 공간 모델을 사용한 언어 모델링을 향하여 . 다니엘 Y. 푸 외. arXiv 2023. [논문]

- 보유 네트워크: 대규모 언어 모델을 위한 Transformer의 후속 제품 . Yutao Sunet al. ArXiv, 2023.

- 하이브리드 아키텍처의 기계적 설계 및 확장 . Michael Poliet al. arXiv 2024. [논문]

- 자기회귀 언어 모델에 대한 지식 증류 재검토 . Qihuang Zhong et al. arXiv 2024. [논문]

- DB-LLM: 효율적인 LLM을 위한 정확한 이중 바이너리화 . 홍첸 외. arXiv 2024. [논문]

- Cross-Layer Attention을 사용하여 변환기 키-값 캐시 크기 줄이기 . 윌리엄 브랜든 외. arXiv 2024.[논문]

- 한 번만 캐시하면 됩니다: 언어 모델을 위한 디코더-디코더 아키텍처 Yutao Sun et al. arXiv 2024. [논문]

4.3 대규모 훈련

- 하위선형 메모리 비용으로 딥넷 훈련하기 Tianqi Chenet al. arXiv 2016. [논문]

- 심층 신경망을 위한 데이터 및 모델 병렬성 너머 . Zhihao Jiaet al. arXiv 2018. [논문]

- GPipe: 파이프라인 병렬성을 사용한 거대한 신경망의 효율적인 교육 . Yanping Huanget al. arXiv 2019. [논문]

- NLP를 위한 매개변수 효율적인 전이 학습 . Neil Houlsbyet al. ICML 2019. 논문

- Megatron-LM: 모델 병렬성을 사용하여 수십억 매개변수 언어 모델 교육 . Mohammad Shoeybi et al. arXiv 2020. [논문]

- Alpa: 분산 딥 러닝을 위한 연산자 간 및 연산자 내 병렬 처리 자동화 . Lianmin Zheng 등. arXiv 2022. [논문]

- DeepSpeed 추론: 전례 없는 규모로 변압기 모델의 효율적인 추론 지원 . Reza Yazdani Aminabadi 등. arXiv 2022. [논문]

- 과적합 없는 암기: 대규모 언어 모델의 훈련 역학 분석 . Kushal Tirumalaet al. arXiv 2022. [논문]

- SWARM 병렬성: 대규모 모델 교육은 놀라울 정도로 효율적으로 통신할 수 있습니다 . Max Ryabininet al. arXiv 2023. [논문]

- 다양한 규모의 언어 모델 훈련 궤적 . Mengzhou Xiaet al. arXiv 2023. [논문]

- HexGen: 이기종 분산 환경에 대한 기초 모델의 생성적 추론 . Youhe Jiang et al. arXiv 2023. [논문]

- FusionAI: 대규모 소비자 수준 GPU를 사용한 분산형 교육 및 LLM 배포 . Zhenheng Tanget al. arXiv 2023. [논문]

- 거의 무한한 상황을 위한 블록 단위 변환기를 사용한 링 어텐션 Hao Liuet al. arXiv 2023. [논문]

- Pythia: 학습 및 확장 전반에 걸쳐 대규모 언어 모델을 분석하기 위한 제품군 . Stella Bidermanet al. arXiv 2023. [논문]

- 보장된 활성화 압축을 사용하여 느린 네트워크에서 언어 모델을 미세 조정합니다 . Jue Wanget al. arXiv 2023. [논문]

- LLaMA-Adapter: Zero-init Attention을 사용하여 언어 모델을 효율적으로 미세 조정합니다 . Renrui Zhanget al. arXiv 2023. [논문]

- QLoRA: 양자화된 LLM의 효율적인 미세 조정 . Tim Dettmerset al. arXiv 2023. [논문]

- PagedAttention을 사용한 대규모 언어 모델 제공을 위한 효율적인 메모리 관리 권우석 외. arXiv 2023. [논문]

- Infinite-LLM: DistAttention 및 분산 KVCache를 사용하여 긴 컨텍스트를 위한 효율적인 LLM 서비스입니다 . Bin Linet al. arXiv 2024. [논문]

- OLMo: 언어 모델 과학 가속화 . Dirk Groeneveldet al. arXiv 2024. [논문]

- 대규모 딥 러닝 모델의 효율적인 훈련: 문헌 검토 . Li Shenet al. arXiv 2023. [논문] 보류 중

4.4 추론 기법

- FlashAttention: IO 인식을 통한 빠르고 메모리 효율적인 정확한 주의 . Tri Daoet al. NeurIPS 2022. [논문]

- 초안 및 검증: 자기 추측 디코딩을 통한 무손실 대규모 언어 모델 가속 . Jun Zhang et al. arXiv 2023. [논문]

- 효율적인 생성적 대형 언어 모델 제공을 향하여: 알고리즘에서 시스템까지의 설문 조사 . Xupeng Miaoet al. arXiv 2023. [논문]

- FlashDecoding++: GPU에서 더 빠른 대규모 언어 모델 추론 . Ke Honget al. arXiv 2023. [논문]

- 추론적 디코딩을 통한 변환기로부터의 빠른 추론 . Yaniv Leviathanet al. arXiv 2023. [논문]

- 대규모 언어 모델을 위한 빠른 분산 추론 제공 . Bingyang Wuet al. arXiv 2023. [논문]

- S-LoRA: 수천 개의 동시 LoRA 어댑터 제공 . Ying Shenget al. arXiv 2023. [논문]

- TensorRT-LLM: 최적화된 대규모 언어 모델 추론을 위한 TensorRT 도구 상자 . 엔비디아. GitHub 2023. [코드]

- Punica: 다중 테넌트 LoRA 서비스 . Lequn Chenet al. arXiv 2023. [논문]

- S$^3: 더 높은 처리량을 위해 생성 추론 중 GPU 활용도를 높입니다 . 진윤호 외. arXiv 2023. [논문]

- 수천 개의 미세 조정된 LLM으로 확장되는 다중 LoRA 추론 서버입니다 . Predibase. GitHub 2023. [코드]

- 프롬프트 조회 디코딩 . 아푸르프 삭세나. GitHub 2023. [코드]

- FasterTransformer . 엔비디아. GitHub 2021. [논문]

- DeepSpeed-FastGen: MII 및 DeepSpeed-Inference를 통해 LLM을 위한 높은 처리량의 텍스트 생성 . 코너 홈즈 외. arXiv 2024. [논문]

- SpecInfer: 트리 기반 추측 추론 및 검증을 통해 생성적 대규모 언어 모델 제공 가속화 . Xupeng Miaoet al. arXiv 2024. [논문]

- Medusa: 다중 디코딩 헤드를 갖춘 간단한 LLM 추론 가속 프레임워크 . Tianle Caiet al. arXiv 2024. [논문]

- 모델이 알려 주는 폐기 항목: LLM에 대한 적응형 KV 캐시 압축 . Suyu Geet al. ICLR 2024. [논문]

- 어텐션 싱크를 갖춘 효율적인 스트리밍 언어 모델 . Guangxuan Xiao 등. ICLR 2024. [논문]

- DeFT: 효율적인 트리 검색 기반 LLM 추론을 위한 IO 인식 기능을 갖춘 플래시 트리 주의 . Jinwei Yaoet al. arXiv 2024. [논문]

- SGLang을 사용하여 대규모 언어 모델을 효율적으로 프로그래밍합니다 . Lianmin Zheng 등. arXiv 2023. [논문]

- 속도: 효율적인 디코딩을 위한 추론적 파이프라인 실행 . Coleman Hooperet al. arXiv 2023. [논문]

- Sequoia: 확장 가능하고 견고하며 하드웨어를 인식하는 추론적 디코딩 . Zhuoming Chenet al. arXiv 2024. [논문] 보류 중

4.5 비용과 효율성

- 시연-검색-예측: 지식 집약적 NLP를 위한 검색 및 언어 모델 구성 . Omar Khattabet al. arXiv 2023. [논문]

- 자동화된 기계 학습: 방법, 시스템, 과제 . Frank Hutteret al. Springer 출판사, 통합, 2019.

- 모델 수프: 미세 조정된 여러 모델의 가중치를 평균하면 추론 시간을 늘리지 않고도 정확도가 향상됩니다 . Mitchell Wortsmanet al. arXiv 2022. [논문]

- 엔드투엔드 기계 학습 파이프라인에 대한 Shapley 중요성을 이용한 데이터 디버깅 . Bojan Karlaš et al. arXiv 2022. [논문]

- 대규모 언어 모델 생성 추론을 위한 비용 효율적인 하이퍼파라미터 최적화 . Chi Wanget al. arXiv 2023. [논문]

- 대규모 언어 모델은 인간 수준의 프롬프트 엔지니어입니다 . Yongchao Zhouet al. arXiv 2023. [논문]

- 작업 하위 공간에서 모델을 일치시켜 병합합니다 . Derek Tamet al. arXiv 2023. [논문]

- 작업 산술을 사용하여 모델 편집 . Gabriel Ilharco 등. arXiv 2023. [논문]

- PriorBand: 딥러닝 시대의 실용적인 하이퍼파라미터 최적화 . Neeratyoy Mallik et al. arXiv 2023. [논문]

- 다중모달 모델 병합에 관한 실증적 연구 . 성이린 외. arXiv 2023. [논문]

- DSPy: 선언적 언어 모델 호출을 자체 개선 파이프라인으로 컴파일 . Omar Khattabet al. arXiv 2023. [논문]

- FrugalGPT: 비용을 절감하고 성능을 향상시키면서 대규모 언어 모델을 사용하는 방법 . Lingjiao Chenet al. arXiv 2023. [논문]

- 추론 효율적인 LLM을 위한 직렬 변환기 . Aishwarya PS 외. arXiv 2024. [논문]

- AIOS: LLM 에이전트 운영 체제 . Kai Meiet al. arXiv 2024. [논문]

- LoraHub: 동적 LoRA 구성을 통한 효율적인 교차 작업 일반화 . Chengsong Huanget al. arXiv 2024. [논문]

- 대규모 언어 모델 시대의 AutoML: 현재 과제, 미래 기회 및 위험 . Alexander Tornedeet al. arXiv 2024. [논문]

- 전문가를 하나로 병합: 전문가 혼합의 계산 효율성 향상 . Shwai Heet al. EMNLP 2023. [논문] 보류 중

4.6 컴퓨팅 플랫폼

- TVM: 딥 러닝을 위한 자동화된 엔드투엔드 최적화 컴파일러 . Tianqi Chenet al. arXiv 2018. [논문]

- TPU v4: 임베딩을 위한 하드웨어 지원을 갖춘 머신러닝을 위한 광학적으로 재구성 가능한 슈퍼컴퓨터 . Norman P. Jouppi 외. arXiv 2023. [논문]

5. AGI 정렬: AGI가 다양한 요구 사항을 충족하도록 보장

5.1 AGI 정렬에 대한 기대

- 인간과의 호환성: 인공지능과 통제의 문제 . 스튜어트 러셀 . 바이킹, 2019.

- 인공 지능, 가치 및 정렬 . 이아슨 가브리엘 . 마음과 기계, 2020. [논문]

- 언어 에이전트의 정렬 . 재커리 켄튼 외. arXiv, 2021. [논문]

- 가치 학습 문제 . 네이트 소아레스 . 기계지능연구소 기술보고서 [논문]

- AI 안전의 구체적인 문제 . Dario Amodeiet al. arXiv, 2016. [논문]

- 언어 모델로 인한 윤리적 및 사회적 위험 . Laura Weidingeret al. arXiv, 2021. [논문]

- 확률론적 앵무새의 위험성: 언어 모델이 너무 클 수 있습니까? . 에밀리 M. 벤더 외. FAccT 2021. [논문]

- AI 윤리 지침의 글로벌 환경 . Anna Jobinet al. 네이처 머신 인텔리전스(Nature Machine Intelligence), 2019. [논문]

- 대규모 언어 모델의 지속적인 반무슬림 편견 . Abubakar Abidet al. AIES, 2021. [논문]

- 성별을 포용하는 상호참조 해결을 향하여 . Yang Trista Cao et al. ACL, 2020. [논문]

- 자연어 처리의 사회적 영향 . Dirk Hovyet al. ACL 2016. [논문]

- TruthfulQA: 모델이 인간의 거짓을 어떻게 모방하는지 측정합니다 . 스테파니 린 외. ACL 2022. [논문]

- GPT-3 및 고급 신경 언어 모델의 급진화 위험 . Kris McGuffieet al. arXiv, 2020. [논문]

- LLM 시대의 AI 투명성: 인간 중심 연구 로드맵 . Q. Vera Liao 외. arXiv 2023. [논문]

- 전문성과 역할을 넘어서: 해석 가능한 기계 학습의 이해관계자와 그들의 요구를 특성화하는 프레임워크 . Harini Sureshet al. 치 2021. [논문]

- 생성 AI의 보안 위험 식별 및 완화 . Clark Barrettet al. arXiv, 2023. [논문]

- LLM 에이전트는 웹사이트를 자율적으로 해킹할 수 있습니다 . Richard Fanget al. arXiv, 2024. [논문]

- 딥페이크, 골상학, 감시 등! AI 개인정보 위험 분류 . 하오핑 리 외. 치 2024. [논문]

- AI 시대의 개인정보 보호 . Sauvik Daset al. ACM 커뮤니케이션, 2023. [논문]

5.2 현재 정렬 기술

- 인간의 피드백을 통해 요약하는 방법을 학습합니다 . Nisan Stiennonet al. NeurIPS 2020. [논문]

- 다시 생각하는 것이 가장 좋습니다. 텍스트 편집을 통해 인간의 가치에 다시 맞추는 방법을 배웁니다 . Ruibo Liuet al. NeurIPS 2022. [논문]

- 인간의 피드백을 통해 지침을 따르도록 언어 모델을 훈련합니다 . Long Ouyanget al. NeurIPS 2022. [논문]

- 내면의 악마를 속박하기: 언어 모델을 위한 자기 해독 . Canwen Xuet al. AAAI 2022. 논문

- 생성적 언어 모델을 인간의 가치와 일치시킵니다 . Ruibo Liuet al. NAACL 2022. [논문]

- 인간 피드백을 통한 강화 학습을 통해 유용하고 무해한 보조자를 훈련합니다 . Yuntao Baiet al. arXiv 2022. [논문]

- 헌법적 AI: AI 피드백의 무해성 . Yuntao Baiet al. arXiv 2022. [논문]

- Raft: 생성 기반 모델 정렬을 위한 보상 순위 미세 조정 . Hanze Donget al. arXiv 2023. [논문]

- 이점 기반 오프라인 정책 그라데이션을 사용하여 언어 모델 개선 . Ashutosh Baheti et al. arXiv 2023. [논문]

- 대규모 언어 피드백을 사용하여 언어 모델을 교육합니다 . Jérémy Scheurer 등. arXiv 2023. [논문]

- 인간의 선호에 따른 학습을 이해하기 위한 일반적인 이론적 패러다임 . Mohammad Gheshlaghi Azar 외. arXiv 2023. [논문]

- 단계별로 확인해 봅시다 . Hunter Lightmanet al. arXiv 2023. [논문]

- 인간 피드백을 통한 강화 학습의 공개 문제와 근본적인 한계 . Stephen Casperet al. arXiv 2023. [논문]

- 합성 피드백을 통한 대규모 언어 모델 정렬 . 김성동 외. arXiv 2023. [논문]

- RLAIF: AI 피드백을 사용하여 인간 피드백에서 강화 학습 확장 . 해리슨 리 외. arXiv 2023. [논문]

- 인간 정렬을 위한 선호도 순위 최적화 . Feifan Songet al. arXiv 2023. [논문]

- 다중 에이전트 토론을 통한 언어 모델의 사실성 및 추론 개선 . Yilun Du et al. arXiv 2023. [논문]

- 대규모 언어 모델 정렬: 설문조사 . Tianhao Shenet al. arXiv 2023. [논문]

- 직접적인 선호 최적화: 귀하의 언어 모델은 비밀리에 보상 모델입니다 . Rafael Rafailovet al. NeurIPS 2024. [논문]

- 리마: 정렬에는 적을수록 좋습니다 . Chunting Zhouet al. NeurIPS 2024. [논문]

5.3 AGI 정렬에 접근하는 방법

- 언어로 인한 피해의 윤리적, 사회적 위험 . Mellor Weidingeret al. arXiv 2021. [논문]

- 베이징 AI 안전 국제 합의 . 베이징 인공 지능 아카데미. 2024. [논문]

- 블랙박스를 열지 않은 반사실적 설명: 자동화된 의사결정 및 GDPR . Sandra Wachter 외. Harvard Journal of Law & Technology, 2017. [논문]

- 보상 모델링을 통한 확장 가능한 에이전트 정렬 : 연구 방향 . Jan Leike et al. ARXIV 2018. [종이]

- 인공 지능으로 윤리를 구축합니다 . Han Yu et al. IJCAI 2018. 종이

- 인간 호환 : 인공 지능과 통제 문제 . 스튜어트 러셀 . 바이킹, 2019. [종이]

- 책임있는 인공 지능 : 책임있는 방식으로 AI를 개발하고 사용하는 방법 . 버지니아 ignum . Springer Nature, 2019. [종이]

- 기계 윤리 : 윤리 AI 및 자율 시스템의 설계 및 거버넌스 . Alan F. Winfield et al. IEEE의 절차, 2019. [종이]

- 협동 조합 AI에서 열린 문제 . Allan Dafoe et al. Arxiv 2020. [종이]

- 인공 지능, 가치 및 정렬 . 이아슨 가브리엘 . 마음과 기계, 2020. [종이]

- 협력 AI : 기계는 공통점을 찾는 법을 배워야합니다 . Allan Dafoe et al. 자연 2021. [종이]

- 기계 도덕성, 도덕적 진보 및 다가오는 환경 재해 . Ben Kenward et al. Arxiv 2021. [종이]

- AI 연구를위한 X-Risk 분석 . Dan Hendryck et al. Arxiv 2022. [종이]

- 확장 가능한 감독을위한 작업 분해 (농업 증류) . Charbel-Raphaël Segerie. 블로그 2023. [블로그]

- 약한 일반화 : 약한 감독으로 강력한 능력을 이끌어냅니다 . Collin Burns 등. Arxiv 2023. [종이]

- 언어 모델은 누구의 의견을 반영합니까? . Shibani Santurkar et al. ICML 2023. [종이]

- AI 정렬 : 포괄적 인 설문 조사 . Jiaming Ji et al. Arxiv 2023. [종이]

- 인간의 피드백으로부터 강화 학습의 열린 문제와 근본적인 한계 . Stephen Casper et al. Arxiv 2023. [종이]

- Base LLM의 잠금 해제 주문 : 텍스트 내 학습을 통한 재고 정렬 . Bill Yuchen Lin et al. Arxiv 2023. [종이]

- 큰 언어 모델 정렬 : 설문 조사 . Tianhao Shen et al. Arxiv 2023. [종이]

6. AGI 로드맵 : 책임감있게 다가오는 AGI

6.1 AI 수준 : 인공 지능의 진화 차트

- 인공 일반 정보의 불꽃 : GPT-4를 사용한 초기 실험 . Sébastien Bubeck et al. Arxiv 2023. [종이]

- AGI 수준 : AGI 경로에서의 운영 진행 . Meredith Ringel Morris et al. Arxiv 2024. [종이]

6.2 AGI 평가

6.2.1 AGI 평가에 대한 기대

- 머신 러닝의 에너지 및 탄소 발자국에 대한 체계적인보고를 향해 . Peter Henderson et al. 기계 학습 연구 저널, 2020.

- 녹색 ai . ACM의 Roy Schwartz Communications, 2020.

- 코드에서 훈련 된 대형 언어 모델 평가 . Mark Chen et al. 일기 없음, 2021.

- 대형 WebText Corpora 문서화 : 거대한 깨끗한 크롤링 코퍼스에 대한 사례 연구 . Jesse Dodge et al. Arxiv 2021. [종이]

- 기초 모델의 기회와 위험에 . Rishi Bommasani et al. Arxiv 2021. [종이]

- 메타 학습 신경망을 통한 인간과 유사한 체계적인 일반화 . Brenden M Lake et al. 자연, 2023 년. [종이]

- Superbench는 Open에서 LLM을 측정하고 있습니다 : 중요한 분석 . 슈퍼 벤치 팀. ARXIV 2023.

- 언어 모델의 전체적인 평가 . Percy Liang et al. Arxiv 2023. [종이]

6.2.2 현재 평가 및 그 제한

- 분대 : 텍스트의 기계 이해력에 대한 10 만 개 이상의 질문 . Pranav Rajpurkar et al. Arxiv 2016. [종이]

- Triviaqa : 독해를위한 대규모 먼 감독 챌린지 데이터 세트 . Mandar Joshi et al. ARXIV 2017. [종이]

- Coqa : 대화 상담에 대한 답변 도전 . Siva Reddy et al. 2019 년 컴퓨터 언어학 협회의 거래.

- 정확하고 신뢰할 수 있으며 빠른 견고성 평가 . Wieland Brendel et al. Neurips 2019. [종이]

- 대규모 멀티 태스킹 언어 이해 측정 . Dan Hendryck et al. Arxiv 2020. [종이]

- 데이터 세트 전환에 대한 모델 견고성 및 안정성 평가 . Adarsh Subbaswamy et al. 2021 년 인공 지능 및 통계에 관한 국제 회의에서 발표

- MMDialog : 다중 모달 오픈 도메인 대화를 향한 대규모 다중 회전 대화 데이터 세트 . Jiazhan Feng et al. Arxiv 2022. [종이]

- 자체 강조 : 언어 모델을 자체 생성 된 지침으로 정렬합니다 . Yizhong Wang et al. Arxiv 2022. [종이]

- 초자연 변환 : 1600 개 이상의 NLP 작업에 대한 선언적 지침을 통한 일반화 . Yizhong Wang et al. Arxiv 2022. [종이]

- GPT-4V (ISION)에서 환각의 전체적인 분석 : 편향 및 간섭 문제 . Chenhang Cui et al. Arxiv 2023. [종이]

- 대형 언어 모델의 지시에 대한 견고성 평가 . Yuansheng Ni et al. Arxiv 2023. [종이]

- GAIA : AI 보조원을위한 벤치 마크 . Grégoire Mialon et al. Arxiv 2023. [종이]

- 심층 모델 견고성을위한 포괄적 인 평가 프레임 워크 . Jun Guo et al. 패턴 인식, 2023. [종이]

- Agieval : 기초 모델을 평가하기위한 인간 중심 벤치 마크 . Wanjun Zhong et al. Arxiv 2023. [종이]

- MMMU : 전문가 AGI에 대한 대규모 다 분야의 멀티 모드 이해 및 추론 벤치 마크 . Xiang et al. Arxiv 2023. [종이]

- 문학적 관점에서 큰 언어 모델 창의성 평가 . Murray Shanahan et al. Arxiv 2023. [종이]

- AgentBench : LLM 평가 . Xiao Liu et al. ICLR 2024. [종이]

- 큰 언어 모델에서 창의성을 평가하고 이해합니다 . Yunpu Zhao et al. Arxiv 2024. [종이]

- MT-Bench 및 Chatbot Arena로 LLM-as-A-Judge 판단 . Lianmin Zheng et al. Neurips 2024. [종이]

6.5 AGI 개발 중 추가 고려 사항

- 대형 언어 모델의 조정 및 안전을 보장하는 기본적 과제 . Usman Anwar et al. Arxiv 2024. [종이]

- 언어 모델의 합성 데이터에 대한 모범 사례 및 수업 . Ruibo Liu et al. Arxiv 2024. [종이]

- AI 요원의 사회적 지능 발전 : 기술적 인 도전과 공개 질문 . Leena Mathur et al. Arxiv 2024. [종이]

7. 사례 연구

7.1 과학 발견 및 연구를위한 AI

- 알파 폴드와의 매우 정확한 단백질 구조 예측 . 점퍼, John et al. 자연, 2021. [종이]

- 자동화 된 과학적 발견 : 방정식 발견에서 자율 발견 시스템에 이르기까지 . Kramer, Stefan et al. Arxiv 2023. [종이]

- 딥 러닝 기반 시퀀스 모델로 비 코딩 변이체의 효과 예측 . Zhou, Jian et al. Nature Methods, 2015.

- 시각적 탈지성을 통해 물리학을 보는 법을 배우는 것 . Wu, Jiajun et al. Neurips 2017. [종이]

- 실시간 중력파 감지 및 매개 변수 추정을위한 딥 러닝 : 고급 리고 데이터를 사용한 결과 . George, Daniel et al. 물리학 편지 B, 2018. [종이]

- 적대적 신경 네트워크로 양자 상 전이를 식별합니다 . REM, Bart-Jan et al. 자연 물리학, 2019. [종이]

- Openagi : LLM이 도메인 전문가를 만나면 . GE, Yingqiang et al. Neurips, 2023. [종이]

- 암흑 물질에서 컨볼 루션 네트워크가있는 은하 . Zhang, Xinyue et al. ARXIV 2019. [종이]

- Alphazero Deep Exploration을 사용한 양자 역학의 글로벌 최적화 . Dalgaard, Mogens et al. NPJ Quantum Information, 2020. [종이]

- 생물 의학적 시력-언어 처리를위한 시간적 구조를 이용하는 법을 배우는 학습 . Shruthi Bannur et al. CVPR, 2023. [종이]

- Mathbert : 수학 교육의 일반적인 NLP 작업을위한 미리 훈련 된 언어 모델 . Shen, Jia Tracy et al. Arxiv 2021. [종이]

- 언어 모델을 사용한 분자 최적화 . Maziarz, Krzysztof et al. Arxiv 2022. [종이]

- Retrotrae : 변압기를 사용한 원자 환경의 역동 성 변환 . Ucak, Umit Volkan et al. 저널 없음, 2022. [종이]

- Scholarbert : 더 큰 것이 항상 더 나은 것은 아닙니다 . Hong, Zhi et al. Arxiv 2022. [종이]

- Galactica : 과학을위한 큰 언어 모델 . Taylor, Ross et al. Arxiv 2022. [종이]

- 공식 수학 성명 커리큘럼 학습 . Polu, Stanislas et al. Arxiv 2022. [종이]

- 언어 모델을 사용한 정리를위한 증거 아티팩트 공동 훈련 . Jesse Michael Han et al. ICLR 2022. [종이]

- 언어 모델의 정량적 추론 문제 해결 . Lewkowycz, Aitor et al. Arxiv 2022. [종이]

- Biogpt : 생물 의학 텍스트 생성 및 광업을위한 생성 사전 훈련 된 변압기 . Luo, Renqian et al. 생물 정보학 브리핑, 2022.

- Chemcrow : 화학 도구로 대규모 모델을 늘립니다 . 밀기울, 안드레스 M et al. Arxiv 2023. [종이]

- 대형 언어 모델을 사용한 자율 화학 연구 . Boiko, Daniil A et al. 자연, 2023 년. [종이]

- 대형 언어 모델의 자율 과학 연구 능력 . Daniil A. Boiko et al. Arxiv 2023. [종이]

- MathPrompter : 대형 언어 모델을 사용한 수학적 추론 . Imani, Shima 등 계산 언어 협회 (Association for Computational Linguistics)의 제 61 차 연례 회의에서 발표 (5 권 : 산업 트랙), 2023. [논문]

- 생물 의학적 시력-언어 처리를위한 시간적 구조를 이용하는 법을 배우는 학습 . Shruthi Bannur et al. Arxiv 2023. [종이]

- 과학을위한 LLM : 코드 생성 및 데이터 분석 용 사용 . Nejjar, Mohamed et al. Arxiv 2023. [종이]

- Medagents : 제로 샷 의료 추론을위한 공동 작업자로서 대형 언어 모델 . Xiangru Tang et al. Arxiv 2024. [종이]

7.2 생성 시각 지능

- 비평형 열역학을 사용한 깊은 감독 학습 . Jascha Sohl-Dickstein et al. ICML 2015. [종이]

- 데이터 분포의 기울기를 추정하여 생성 모델링 . 양 송 등 Neurips 2019. [종이]

- 확산 확률 모델을 비난합니다 . Jonathan Ho et al. Neurips 2020. [종이]

- 확률 적 미분 방정식을 통한 점수 기반 생성 모델링 . 양 송 등 ICLR 2021. [종이]

- 글라이드 : 텍스트 유도 확산 모델로 사진 이미지 생성 및 편집 . Alex Nichol et al. ICML 2022. [종이]

- SDEDIT : 안내 이미지 합성 및 확률 적 미분 방정식으로 편집 . Chenlin Meng et al. ICLR 2022. [종이]

- 비디오 확산 모델 . Jonathan Ho et al. Neurips 2022. [종이]

- 클립 잠재심을 가진 계층 적 텍스트 조건 이미지 생성 . Aditya Ramesh et al. Arxiv 2022. [종이]

- 분류기가없는 확산 안내 . Jonathan Ho et al. Arxiv 2022. [종이]

- 팔레트 : 이미지-이미지 확산 모델 . Chitwan Saharia et al. Siggraph 2022. [종이]

- 잠복 확산 모델을 사용한 고해상도 이미지 합성 . Robin Rombach et al. CVPR 2022. [종이]

- 텍스트-이미지 확산 모델에 조건부 제어 추가 . Lvmin Zhang et al. ICCV 2023. [종이]

- 변압기가있는 확장 가능한 확산 모델 . William Peebles et al. ICCV 2023. [종이]

- 순차적 모델링은 대형 비전 모델에 대한 확장 가능한 학습을 가능하게합니다 . Yutong Bai et al. Arxiv 2023. [종이]

- 세계 시뮬레이터로서 비디오 생성 모델 . Tim Brooks et al. Openai 2024. [종이]

7.3 세계 모델

- 시각적 탈지성을 통해 물리학을 보는 법을 배우는 것 . Wu, Jiajun et al. Neurips 2017. [종이]

- 안정성 보장을 가진 안전한 모델 기반 강화 학습 . Berkenkamp, Felix et al. Neurips, 2017. [종이]

- SIMNET : 물리적 추론을위한 시뮬레이션 기반 세계 모델 학습 . Vicol, Paul, Menapace et al. ICLR 2022. [종이]

- Dreamix : 반복 시공간 혼합을 통한 Dreamfusion . 칼리파, 안지 등. Arxiv 2022. [종이]

- 인터넷 규모의 지식을 갖춘 강화 학습을 통한 범용 구체화 된 AI 에이전트 . Guo, Xiaoxiao et al. Arxiv 2022. [종이]

- VQGAN-CLIP : 도메인 이미지 생성 및 자연어 지침으로 편집 . 크로우슨, 캐서린. Arxiv 2022. [종이]

- 자율 기계 지능을 향한 길 . Lecun Yann OpenReview, 2022. [종이]

- 언어 모델은 세계 모델을 충족시킵니다. 구체화 된 경험은 언어 모델을 향상시킵니다 . Jiannan Xiang et al. Neurips 2023. [종이]

- 세계 모델을 통해 다양한 도메인을 마스터합니다 . Hafner, Danijar et al. Arxiv 2023. [종이]

- 검색을 통한 멀티 모달 모델의 획득 . 리드, Scott et al. Arxiv 2023. [종이]

- 제로 샷 플래너로서 언어 모델 : 구체화 된 에이전트를위한 실행 가능한 지식 추출 . Dohan, David et al. Arxiv 2023. [종이]

- 언어 모델, 에이전트 모델 및 세계 모델 : 기계 추론 및 계획을위한 법률 . Zhiting Hu et al. Arxiv 2023. [종이]

- 언어 모델과의 추론은 세계 모델로 계획하고 있습니다 . Hao, Shibo et al. Arxiv 2023. [종이]

- Metasim : 합성 데이터 세트를 생성하는 법을 배웁니다 . Zhang, Yuxuan et al. Arxiv 2023. [종이]

- Ringattention과 함께 백만 길이의 비디오 및 언어에 대한 세계 모델 . Hao Liu et al. Arxiv 2024. [종이]

- Genie : 생성 대화 형 환경 . Jake Bruce et al. Arxiv 2024. [종이]

7.4 분산 LLM

- 꽃잎 : 대형 모델의 공동 추론 및 미세 조정 . Alexander Borzunov et al. Arxiv 2022. [종이]

- 딥 러닝을위한 블록 체인 : 검토 및 공개 도전 . 경제 시대. 클러스터 컴퓨팅 2021. [종이]

- Flexgen : 단일 GPU를 가진 대형 언어 모델의 고 처리량 생성 추론 . Ying Sheng et al. Arxiv 2023. [종이]

- 이기종 환경에서 기초 모델의 분산 교육 . Binhang Yuan et al. Arxiv 2023. [종이]

7.5 코딩을위한 AI

- 코드 생성 모델 평가를위한 프레임 워크 . Ben Allal et al. Github, 2023. [코드]

- 코드에서 훈련 된 대형 언어 모델 평가 . Mark Chen et al. Arxiv 2021. [종이]

- 큰 언어 모델로 프로그램 합성 . Jacob Austin et al. Arxiv 2021. [종이]

- 알파 코드를 통한 경쟁 수준 코드 생성 . Yujia Li et al. 과학, 2022. [종이]

- 중간을 채우기위한 언어 모델의 효율적인 교육 . Mohammad Bavarian et al. Arxiv 2022. [종이]

- Santacoder : 별에 도달하지 마십시오! . Loubna Ben Allal et al. 마음, 2023. [종이]

- Starcoder : 소스가 당신과 함께 있기를 바랍니다! . Raymond Li et al. Arxiv 2023. [종이]

- 컴파일러 최적화를위한 대형 언어 모델 . Chris Cummins et al. Arxiv 2023. [종이]

- 교과서 만 있으면됩니다 . Suriya Gunasekar et al. Arxiv 2023. [종이]

- 인터 코드 : 실행 피드백을 사용한 대화식 코딩 표준화 및 벤치마킹 . John Yang et al. Arxiv 2023. [종이]

- 고품질 단위 테스트 생성을위한 자동 피드백의 강화 학습 . Benjamin Steenhoek et al. Arxiv 2023. [종이]

- 인코더 : 코드 충전 및 합성을위한 생성 모델 . Daniel Fried et al. Arxiv 2023. [종이]

- 대형 언어 모델로 정제 된 C 코드 . Wai Kin Wong et al. Arxiv 2023. [종이]

- Swe-Bench : 언어 모델이 실제 세계를 해결할 수 있습니까?