CLASS: 학습 과학 원리를 기반으로 한 지능형 학습 시스템 구축을 위한 설계 프레임워크(EMNLP 2023)

샤생크 손카, Naiming Liu, Debshila Basu Mallick, Richard G. Baraniuk

논문: https://arxiv.org/abs/2305.13272

분기: 클래스

대규모 언어 모델의 교육학적 정렬(EMNLP 2024)

Shashank Sonkar*, Kangqi Ni*, Sapana Chaudhary, Richard G. Baraniuk

논문: https://arxiv.org/abs/2402.05000

지점: 메인

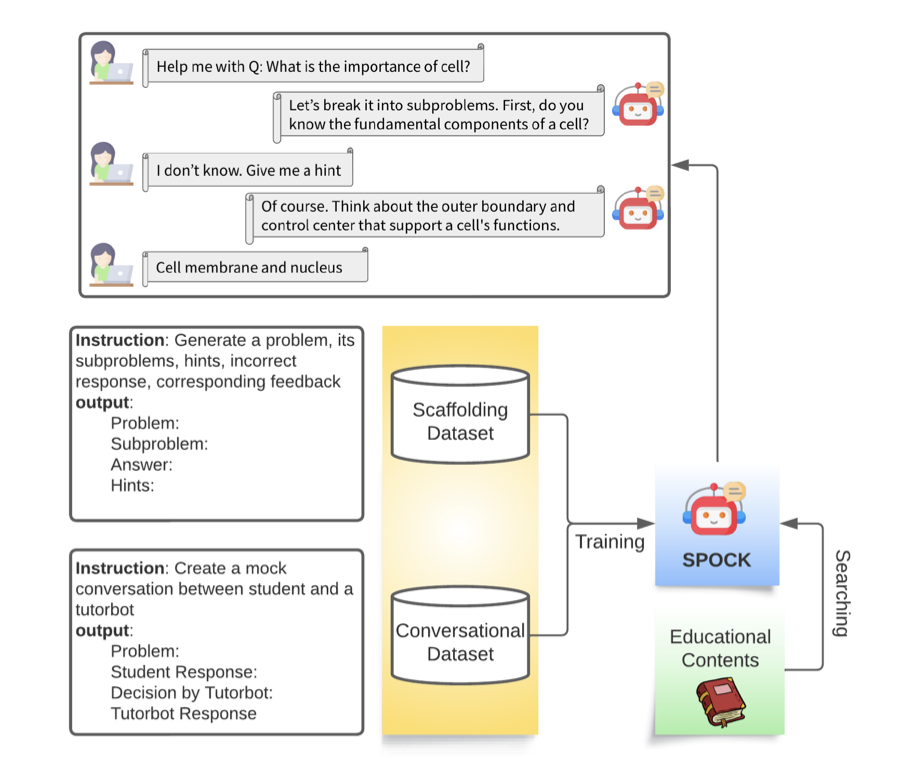

이 레포는 학생들이 비판적 사고와 문제 해결 능력을 개발하는 데 도움이 되는 효과적인 지능형 튜터링 에이전트를 개발하는 것을 목표로 합니다.

4*A100 GPU를 사용하여 선택한 모델의 훈련 및 평가를 실행하는 예제로 scripts/run.sh 를 참조하십시오. 훈련 없이 이 예제를 실행하려면 아래 섹션에서 모델을 다운로드하고 scripts/run_no-train.sh 를 참조하세요. 다음 하위 섹션에서는 scripts/run.sh 더 자세히 설명합니다.

훈련 및 평가에는 데이터 세트 폴더의 bio-dataset-1.json, bio-dataset-2.json, bio-dataset-3.json 및 bio-dataset-ppl.json이 사용됩니다. 각각에는 OpenAI의 GPT-4에서 생성된 생물학 개념을 기반으로 하는 학생과 교사 간의 모의 대화가 포함되어 있습니다. 그런 다음 이러한 데이터는 교육 및 평가 데이터 세트에 필요한 형식으로 전처리됩니다. 이러한 데이터 생성에 대한 지침은 분기 CLASS를 참조하세요.

사용자 매개변수를 설정합니다.

FULL_MODEL_PATH="meta-llama/Meta-Llama-3.1-8B-Instruct"

MODEL_DIR="models"

DATA_DIR="datasets"

SFT_OPTION="transformers" # choices: ["transformers", "fastchat"]

ALGO="dpo" # choices: ["dpo", "ipo", "kto"]

BETA=0.1 # choices: [0.0 - 1.0]

데이터 전처리:

python src/preprocess_sft_data.py --data_dir $DATA_DIR

SFT에는 (1) Transformers (2) FastChat이라는 2가지 옵션이 제공됩니다.

(1) Transformers를 사용하여 SFT를 실행합니다.

CUDA_VISIBLE_DEVICES=0,1,2,3 torchrun --nproc_per_node=4 --master_port=20001 src/train/train_sft.py

--model_path $FULL_MODEL_PATH

--train_dataset_path $SFT_DATASET_PATH

--eval_dataset_path ${DATA_DIR}/bio-test.json

--output_dir $SFT_MODEL_PATH

--cache_dir cache

--bf16

--num_train_epochs 3

--per_device_train_batch_size 2

--per_device_eval_batch_size 1

--gradient_accumulation_steps 2

--evaluation_strategy "epoch"

--eval_accumulation_steps 50

--save_strategy "epoch"

--seed 42

--learning_rate 2e-5

--weight_decay 0.05

--warmup_ratio 0.1

--lr_scheduler_type "cosine"

--logging_steps 1

--max_seq_length 4096

--gradient_checkpointing

(2) FastChat으로 SFT를 실행합니다.

CUDA_VISIBLE_DEVICES=0,1,2,3 torchrun --nproc_per_node=4 --master_port=20001 FastChat/fastchat/train/train.py

--model_name_or_path $FULL_MODEL_PATH

--data_path $SFT_DATASET_PATH

--eval_data_path ${DATA_DIR}/bio-test.json

--output_dir $SFT_MODEL_PATH

--cache_dir cache

--bf16 True

--num_train_epochs 3

--per_device_train_batch_size 2

--per_device_eval_batch_size 1

--gradient_accumulation_steps 2

--evaluation_strategy "epoch"

--eval_accumulation_steps 50

--save_strategy "epoch"

--seed 42

--learning_rate 2e-5

--weight_decay 0.05

--warmup_ratio 0.1

--lr_scheduler_type "cosine"

--logging_steps 1

--tf32 True

--model_max_length 4096

--gradient_checkpointing True

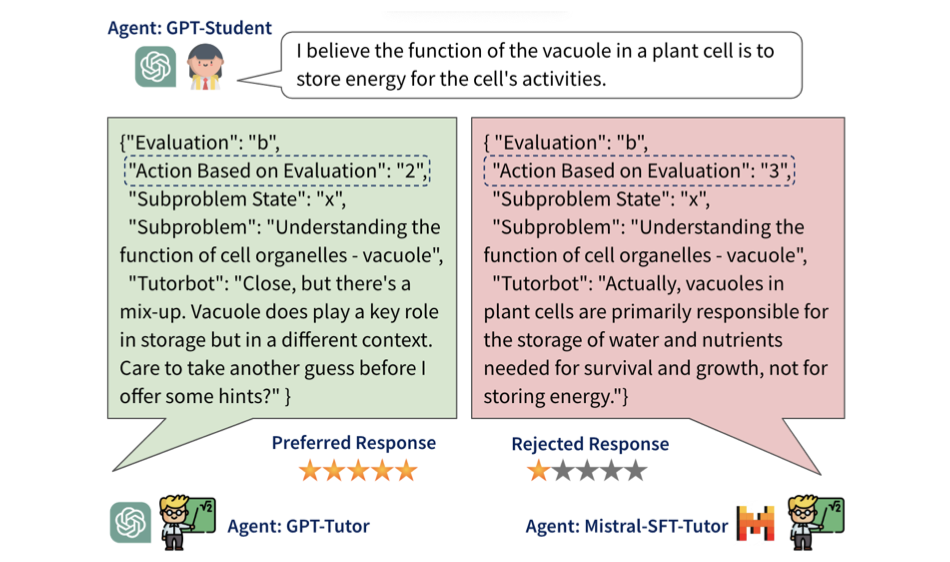

선호도 데이터 생성:

CUDA_VISIBLE_DEVICES=0,1,2,3 python src/evaluate/generate_responses.py --model_path $SFT_MODEL_PATH --output_dir ${SFT_MODEL_PATH}/final_checkpoint-dpo --test_dataset_path $DPO_DATASET_PATH --batch_size 256

python src/preprocess/preprocess_dpo_data.py --response_file ${SFT_MODEL_PATH}/final_checkpoint-dpo/responses.csv --data_file $DPO_PREF_DATASET_PATH

기본 설정 정렬 실행:

DPO_MODEL_PATH="${MODEL_DIR}_dpo/${MODEL_NAME}_bio-tutor_${ALGO}"

CUDA_VISIBLE_DEVICES=0,1,2,3 accelerate launch --config_file=ds_config/deepspeed_zero3.yaml --num_processes=4 train/train_dpo.py

--train_data $DPO_PREF_DATASET_PATH

--model_path $SFT_MODEL_PATH

--output_dir $DPO_MODEL_PATH

--beta $BETA

--loss $ALGO

--gradient_checkpointing

--bf16

--gradient_accumulation_steps 4

--per_device_train_batch_size 2

--num_train_epochs 3

SFT 및 정렬 모델의 정확도와 F1 점수를 평가합니다.

# Generate responses from the SFT model

CUDA_VISIBLE_DEVICES=0,1,2,3 python src/evaluate/generate_responses.py --model_path $SFT_MODEL_PATH --output_dir ${SFT_MODEL_PATH}/final_checkpoint-eval --test_dataset_path $TEST_DATASET_PATH --batch_size 256

# Generate responses from the Aligned model

CUDA_VISIBLE_DEVICES=0,1,2,3 python src/evaluate/generate_responses.py --model_path $DPO_MODEL_PATH --output_dir ${DPO_MODEL_PATH}/final_checkpoint-eval --test_dataset_path $TEST_DATASET_PATH --batch_size 256

# Evaluate the SFT model

echo "Metrics of the SFT Model:"

python src/evaluate/evaluate_responses.py --response_file ${SFT_MODEL_PATH}/final_checkpoint-eval/responses.csv

# Evaluate the Aligned model

echo "Metrics of the RL Model:"

python src/evaluate/evaluate_responses.py --response_file ${DPO_MODEL_PATH}/final_checkpoint-eval/responses.csv

SFT 및 정렬 모델의 ppl을 평가합니다.

CUDA_VISIBLE_DEVICES=0,1 python src/evaluate/evaluate_ppl.py --model_path $SFT_MODEL_PATH

CUDA_VISIBLE_DEVICES=0,1 python src/evaluate/evaluate_ppl.py --model_path $DPO_MODEL_PATH

모델에 더 쉽게 접근하려면 Hugging Face에서 다운로드하세요.

SFT 모델:

정렬된 모델:

우리의 작업이 유용하다고 생각되면 다음을 인용해 주세요.

@misc{sonkar2023classdesignframeworkbuilding,

title={CLASS: A Design Framework for building Intelligent Tutoring Systems based on Learning Science principles},

author={Shashank Sonkar and Naiming Liu and Debshila Basu Mallick and Richard G. Baraniuk},

year={2023},

eprint={2305.13272},

archivePrefix={arXiv},

primaryClass={cs.CL},

url={https://arxiv.org/abs/2305.13272},

}

@misc{sonkar2024pedagogical,

title={Pedagogical Alignment of Large Language Models},

author={Shashank Sonkar and Kangqi Ni and Sapana Chaudhary and Richard G. Baraniuk},

year={2024},

eprint={2402.05000},

archivePrefix={arXiv},

primaryClass={cs.CL},

url={https://arxiv.org/abs/2402.05000},

}