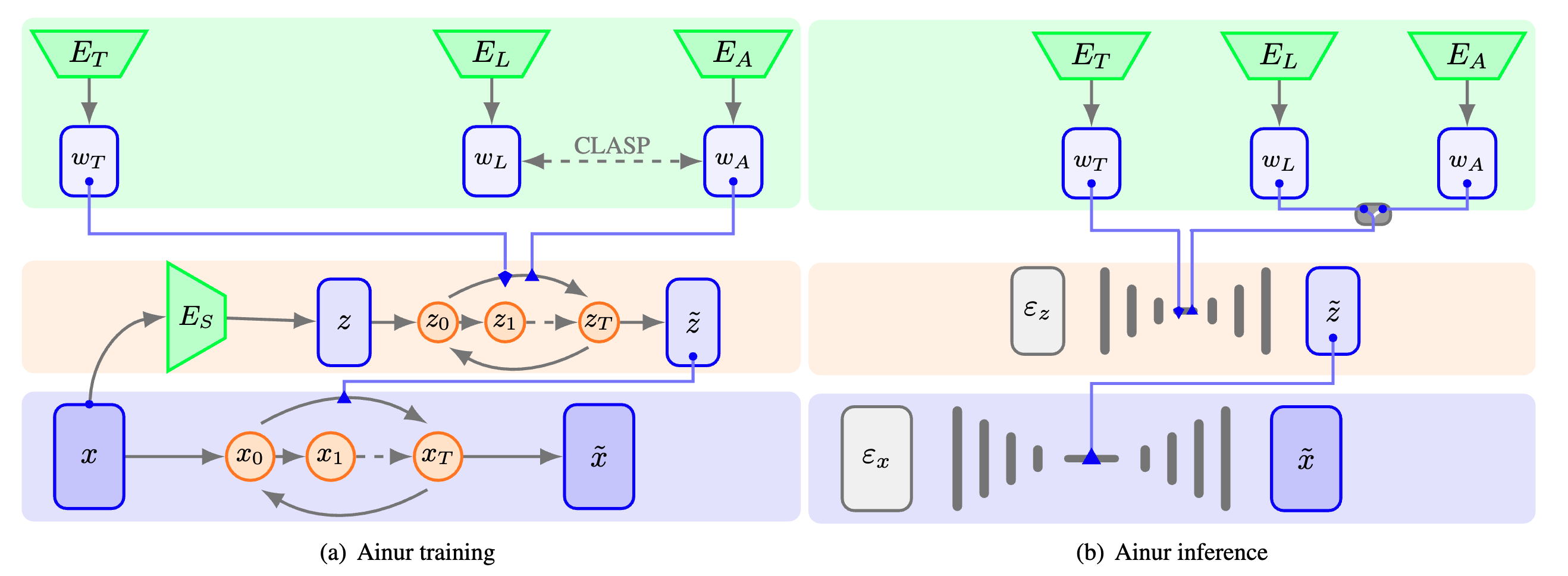

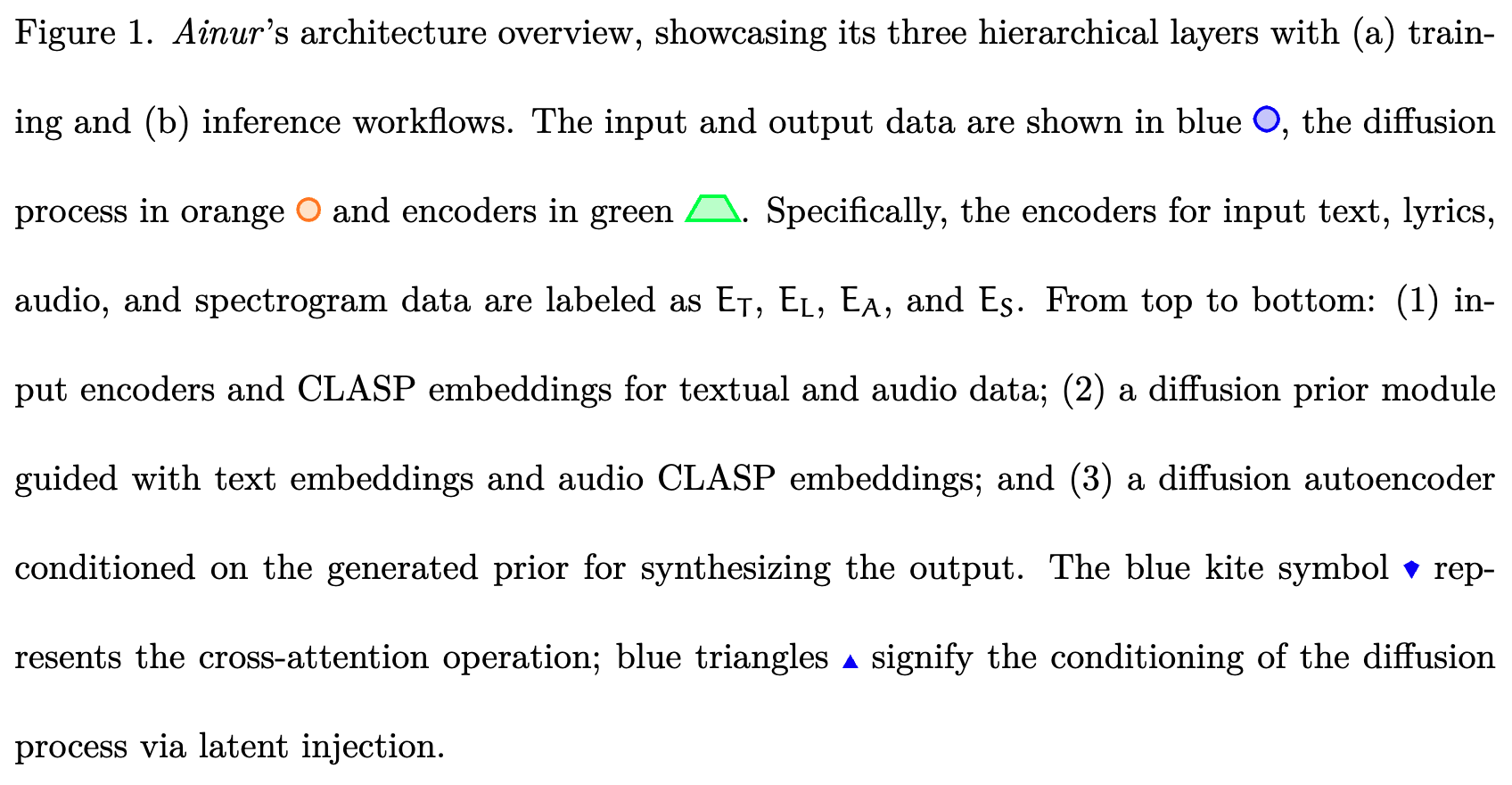

Ainur는 조건부 다중 모드 음악 생성을 위한 혁신적인 딥 러닝 모델입니다. 가사, 텍스트 설명자 및 기타 오디오와 같은 다양한 입력을 조건으로 48kHz에서 고품질 스테레오 음악 샘플을 생성하도록 설계되었습니다. Ainur의 계층적 확산 아키텍처는 CLASP 임베딩과 결합되어 다양한 장르와 스타일에 걸쳐 일관되고 표현력이 풍부한 음악 작곡을 생성할 수 있습니다.

조건부 생성: Ainur는 가사, 텍스트 설명자 또는 기타 오디오를 조건으로 음악을 생성하여 음악 작곡에 유연하고 창의적인 접근 방식을 제공합니다.

고품질 출력: 이 모델은 48kHz에서 22초 스테레오 음악 샘플을 생성할 수 있어 높은 충실도와 현실감을 보장합니다.

다중 모드 학습: Ainur는 가사와 오디오의 다중 모드 표현인 CLASP 임베딩을 사용하여 텍스트 가사와 해당 오디오 조각의 정렬을 용이하게 합니다.

객관적인 평가: 생성된 음악의 품질과 일관성을 평가하기 위해 FAD(Frechet Audio Distance) 및 CLASP Cycle Consistency(C3)를 포함한 포괄적인 평가 지표를 제공합니다.

Ainur를 실행하려면 다음 종속성이 설치되어 있는지 확인하십시오.

파이썬 3.8+

파이토치 1.13.1

파이토치 라이트닝 2.0.0

다음을 실행하여 필수 Python 패키지를 설치할 수 있습니다.

pip 설치 -r 요구사항.txt

다음 저장소를 복제하세요.

자식 클론 https://github.com/ainur-music/ainur.gitcd ainur

위에서 언급한 대로 종속성을 설치합니다.

원하는 입력으로 Ainur를 실행하십시오. 음악 생성을 위해 Ainur를 사용하는 방법에 대한 지침은 examples 폴더의 예제 노트북을 확인하세요. ( 곧 제공 예정 )

Ainur는 음악 생성을 안내하고 텍스트 정보와 동기화된 가사를 통해 보컬의 품질을 향상시킵니다. 다음은 Ainur를 사용하여 음악을 훈련하고 생성하기 위한 입력의 예입니다.

«Red Hot Chili Peppers, Alternative Rock, 7 of 19»

«[00:45.18] I got your hey oh, now listen what I say oh [...]»

우리는 Ainur의 성능을 텍스트-음악 생성을 위한 다른 최첨단 모델과 비교합니다. 우리는 FAD와 같은 객관적인 지표를 기반으로 평가하고 VGGish, YAMNet 및 Trill과 같은 참조용으로 다양한 임베딩 모델을 사용했습니다.

| 모델 | 속도 [kHz] | 길이 [초] | 매개변수 [M] | 추론 단계 | 추론 시간 [초] ↓ | 유행 VGGish ↓ | FAD YAMNet ↓ | 유행 트릴 ↓ |

|---|---|---|---|---|---|---|---|---|

| 아이누르 | 48@2 | 22 | 910 | 50 | 14.5 | 8.38 | 20.70 | 0.66 |

| 아이누르(CLASP 없음) | 48@2 | 22 | 910 | 50 | 14.7 | 8.40 | 20.86 | 0.64 |

| 오디오LDM | 16@1 | 22 | 181 | 200 | 2.20 | 15.5 | 784.2 | 0.52 |

| 오디오LDM 2 | 16@1 | 22 | 1100 | 100 | 20.8 | 8.67 | 23.92 | 0.52 |

| 뮤직젠 | 16@1 | 22 | 300 | 1500 | 81.3 | 14.4 | 53.04 | 0.66 |

| 주크박스 | 16@1 | 1 | 1000 | - | 538 | 20.4 | 178.1 | 1.59 |

| 음악LM | 16@1 | 5 | 1890년 | 125 | 153 | 15.0 | 61.58 | 0.47 |

| 확산 | 44.1@1 | 5 | 890 | 50 | 6.90 | 5.24 | 15.96 | 0.67 |

여기에서 Ainur가 생성한 음악을 탐색하고 들어보세요.

드라이브에서 사전 훈련된 Ainur 및 CLASP 체크포인트를 다운로드할 수 있습니다.

아이누르 최고 체크포인트(훈련 중 손실이 가장 적은 모델)

Ainur 마지막 체크포인트(훈련 단계 수가 가장 많은 모델)

CLASP 체크포인트

이 프로젝트는 MIT 라이선스에 따라 라이선스가 부여됩니다. 자세한 내용은 LICENSE 파일을 참조하세요.

© 2023 주세페 콘시알디