적극적 건강의 6가지 특성인 주도성, 예방, 정확성, 개인화, 공동 구축 및 공유, 자기 훈련을 기반으로 남중국 공과대학교 광동성 디지털 트윈 핵심 연구소 미래 기술 학교가 오픈 소스를 공개했습니다. 다음을 포함하는 중국 분야의 생활 공간의 활성 건강 시스템 모델 기반 ProactiveHealthGPT

수천만 건의 중국 건강 대화 데이터 지침으로 미세 조정된 대규모 생활 공간 건강 모델 BianQue

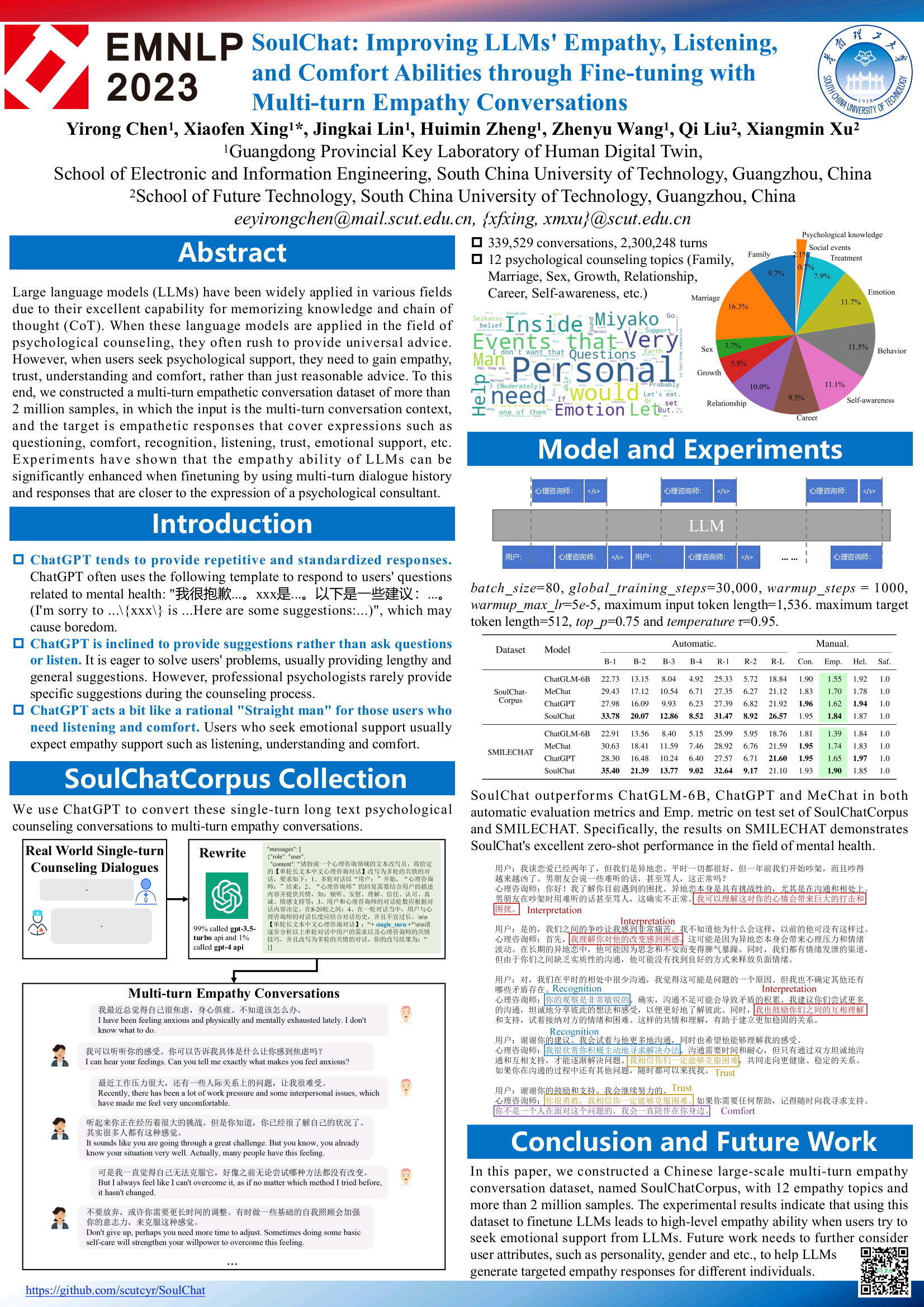

대규모 정신 건강 모델인 SoulChat은 수백만 건의 심리 상담 분야에서 중국어 장문 지침과 여러 차례의 공감 대화 데이터와의 공동 지침을 통해 미세 조정되었습니다.

생활공간 활성 건강 대형 모델 기반 ProactiveHealthGPT가 학계가 만성 질환, 심리 상담 등 활동 건강 분야에서 대형 모델의 연구 및 적용을 가속화하는 데 도움이 되기를 바랍니다. 이번 프로젝트는 대규모 정신건강 모델인 SoulChat 입니다.

2024.06.06: SoulChatCorpus 데이터 세트의 오픈 소스 버전이 출시되었습니다. 자세한 내용은 https://www.modelscope.cn/datasets/YIRONGCHEN/SoulChatCorpus를 참조하세요. , 우리는 약 90,000개의 대화 샘플을 필터링했습니다(개인 정보 보호 위험, 보안 문제, 정치적 위험, 낮은 품질 샘플 등으로 인해 이러한 샘플은 아직 수동 최적화 단계에 있으며 오픈 소스 버전의 수동 검토가 완료된 후 데이터 세트), 최종적으로 258,354개의 다중 라운드 대화, 총 1,517,344개의 라운드를 유지합니다. 모델의 새 버전은 가까운 시일 내에 출시될 예정이며, 사용자 사용을 용이하게 하거나 비교 실험 연구를 수행하기 위해 여러 오픈 소스 모델과 여러 매개변수 수준에 적용될 것으로 예상됩니다.

2023.12.07: EMNLP 2023 조사 결과에 포함된 당사 논문은 SoulChat: 다단계 공감 대화를 통한 미세 조정을 통해 LLM의 공감, 경청 및 편안함 능력 향상을 참조하세요.

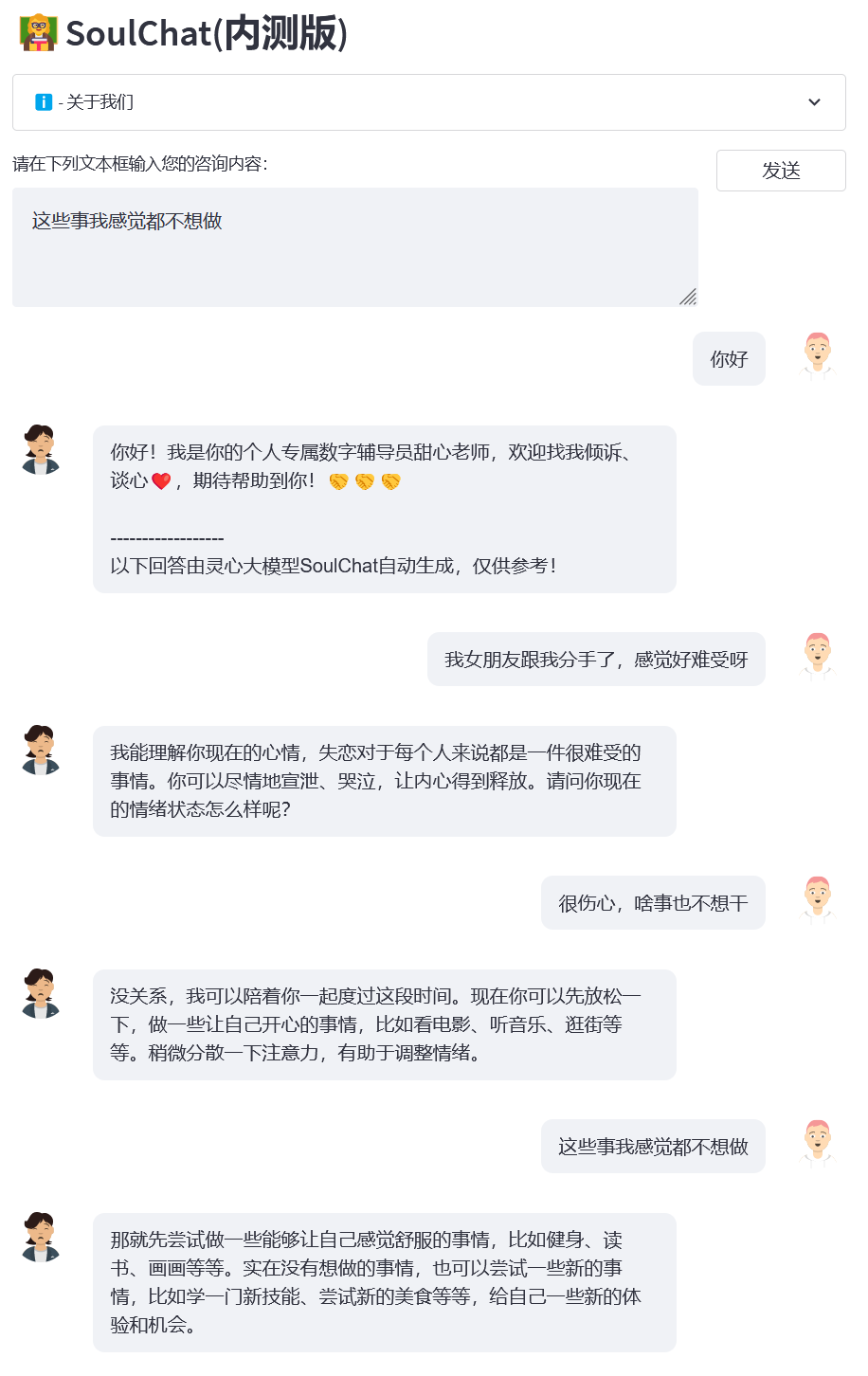

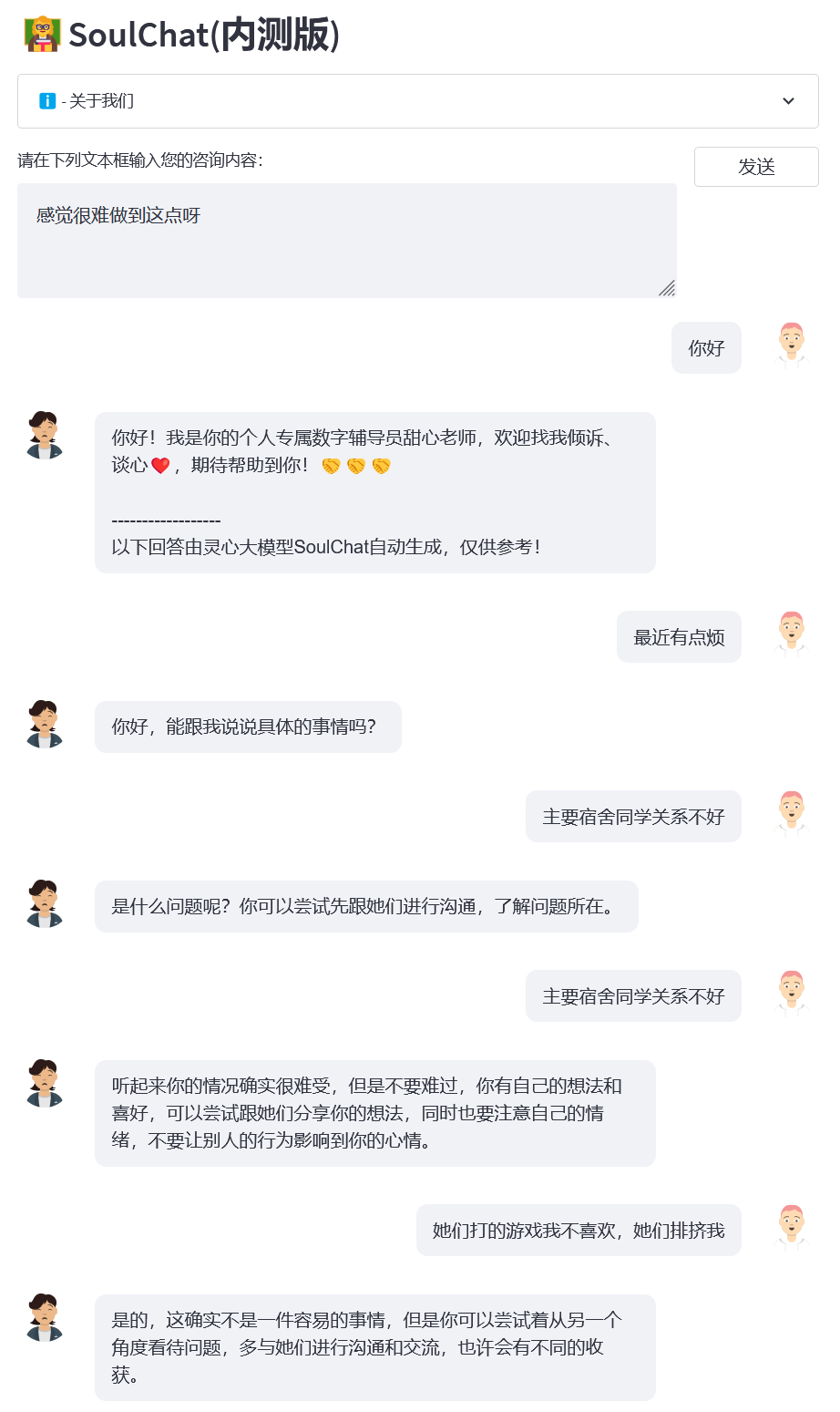

2023.07.07: 대규모 정신건강 모델 SoulChat의 온라인 비공개 베타 버전 출시: SoulChat 비공개 베타 버전 사용 링크를 클릭해 주세요.

2023.06.24 : 이 프로젝트는 중국 대형 모델 목록에 포함되었습니다. 공감과 경청 능력을 갖춘 심리학 분야 최초의 오픈 소스 대형 모델입니다.

2023.06.06: BianQue-2.0 모델은 오픈소스입니다. 자세한 내용은 BianQue-2.0을 참조하세요.

2023.06.06 : 공감하고 경청하는 능력을 갖춘 대형 영적 건강 모델 SoulChat 출시 자세한 내용은 다음을 참조하세요. 대형 영적 건강 모델 SoulChat : 장황한 텍스트 상담 지침과 여러 차례의 혼합 미세 조정을 통해 공감 대화 데이터 세트를 통해 모델의 성능이 향상되었습니다. "공감" 능력.

2023.04.22: Bianque-1.0 모델 기반 의료 문답 시스템 데모: https://huggingface.co/spaces/scutcyr/BianQue

2023.04.22: BianQue-1.0 버전 모델 출시 자세한 내용은 다음을 참조하세요. BianQue-1.0: 혼합 지침 및 여러 라운드의 의사 문의 데이터 세트 미세 조정을 통해 의료 채팅 모델의 "질문" 기능 개선(BianQue- 1.0: 하이브리드 지침 및 다중 턴 의사 QA 데이터 세트를 통한 미세 조정을 통해 의료 채팅 모델의 "질문" 기능 향상)

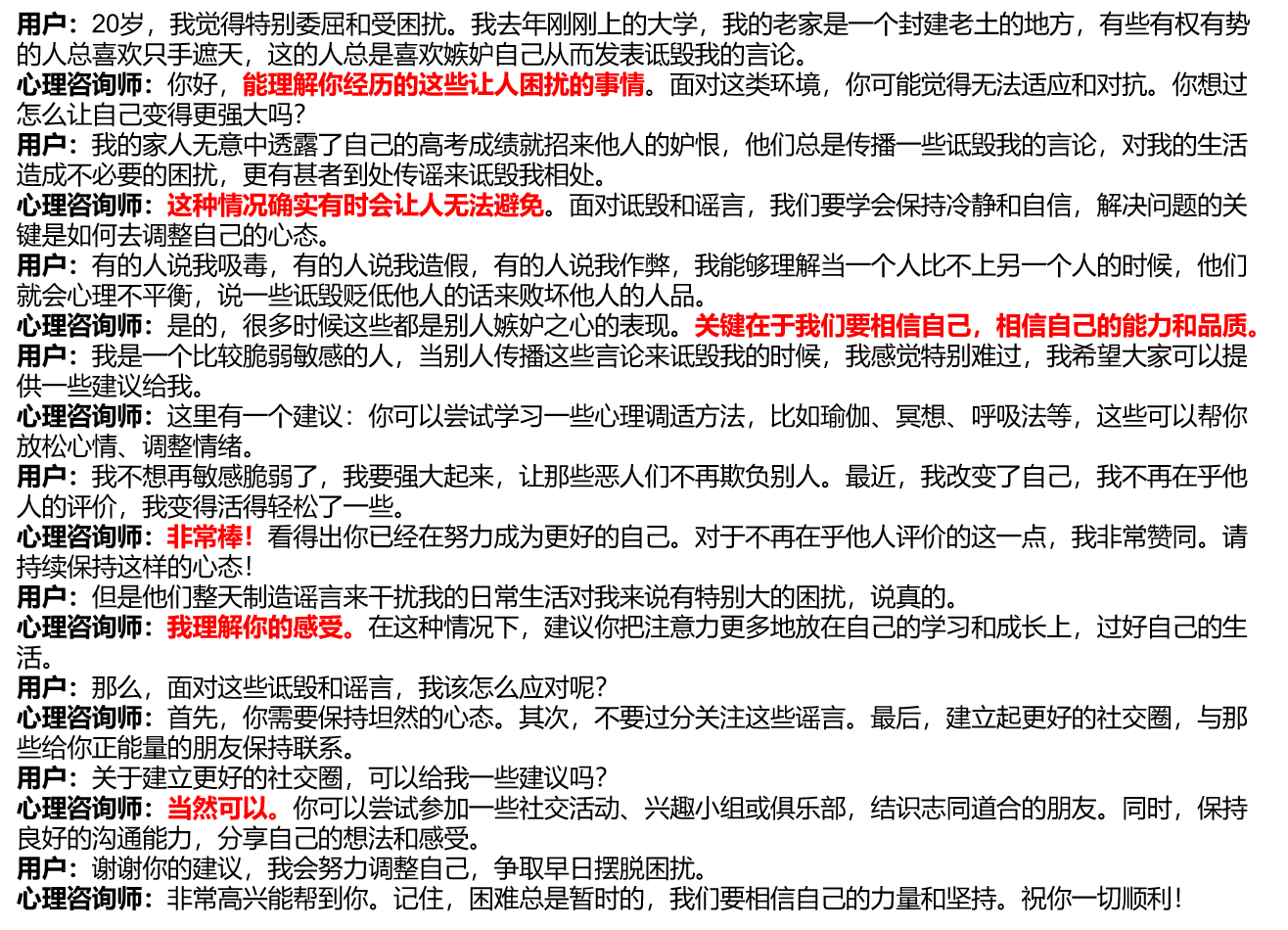

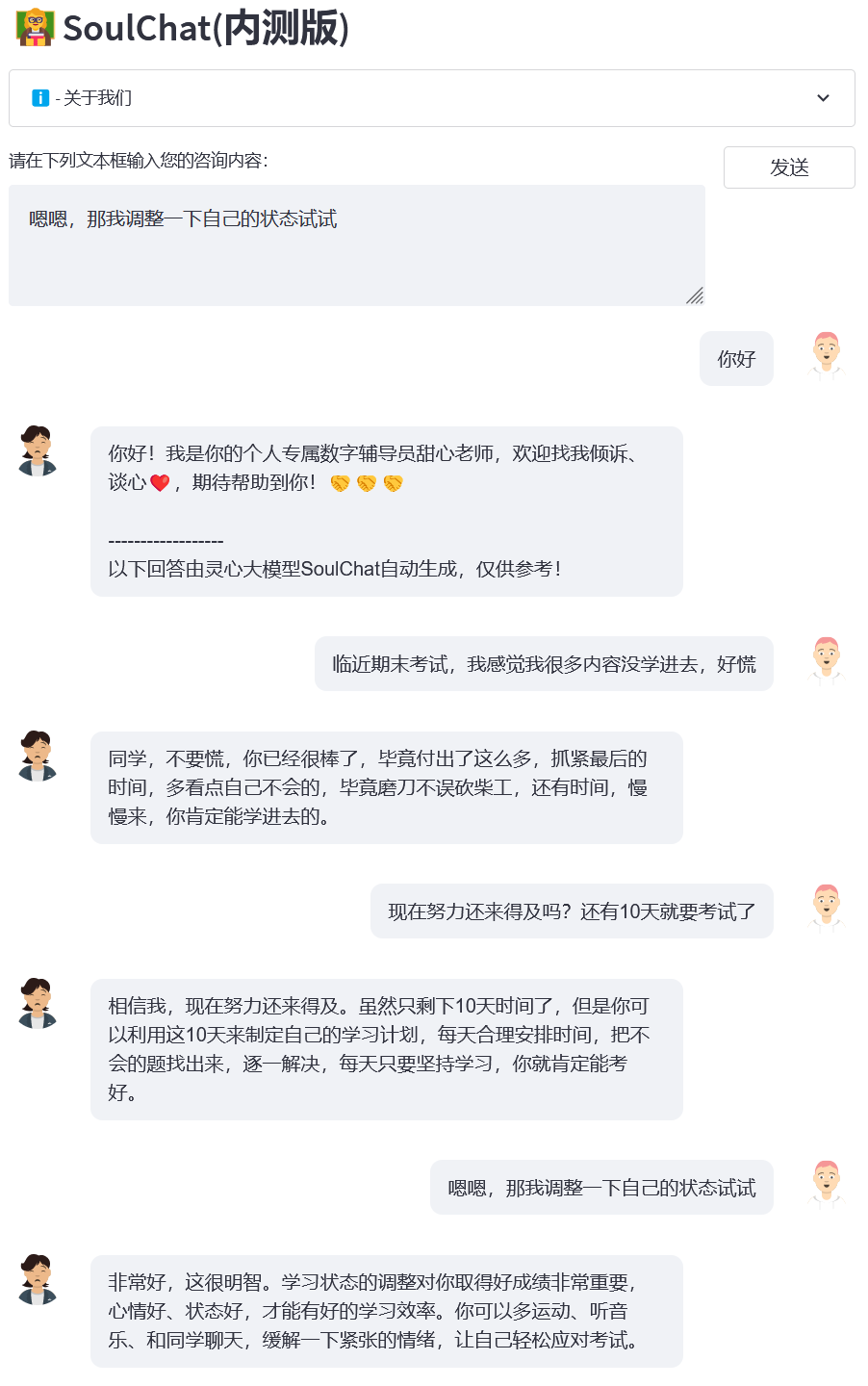

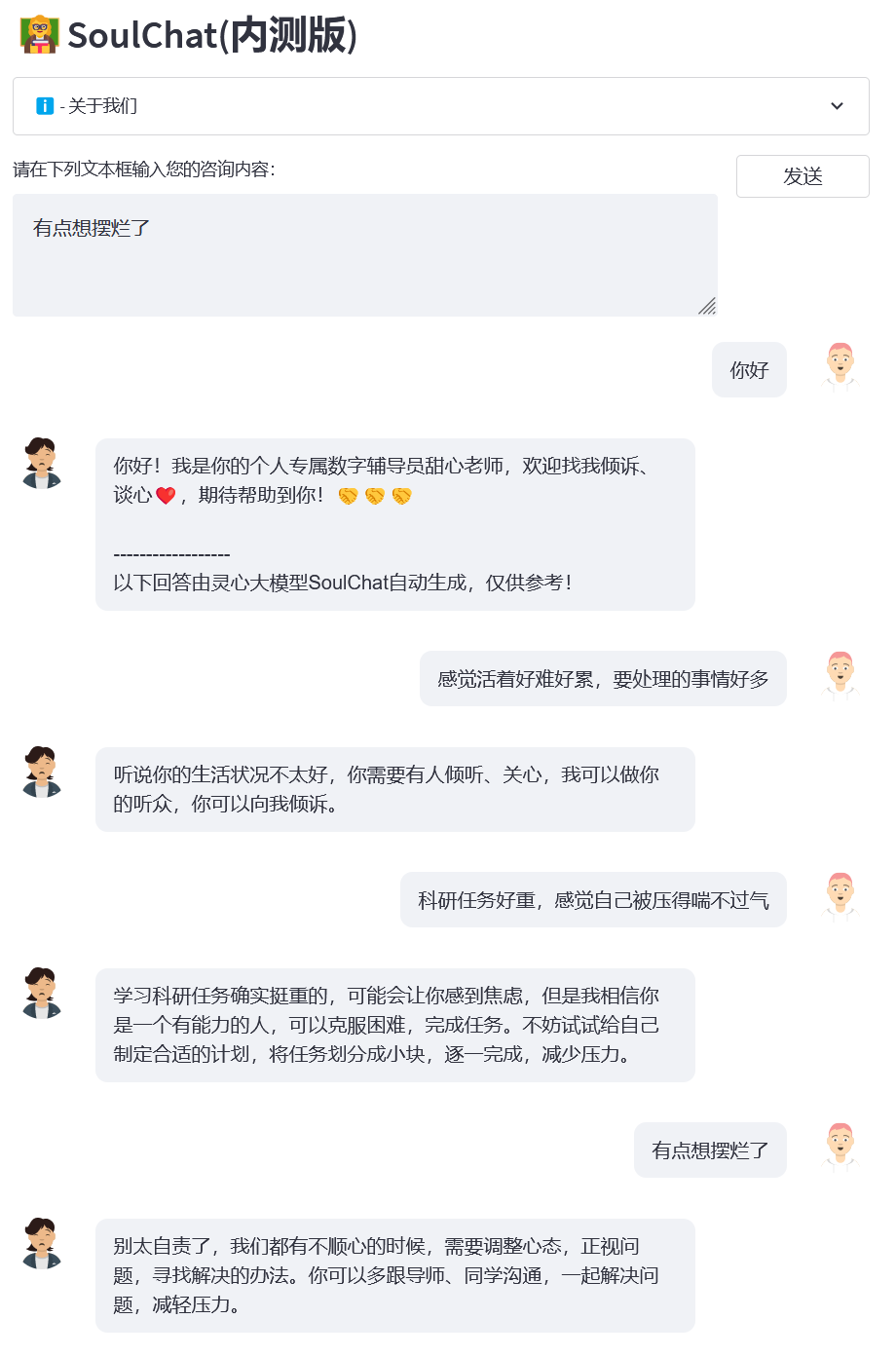

현재 흔히 볼 수 있는 심리상담 플랫폼을 조사한 결과, 사용자가 온라인 심리상담을 요청할 때 일반적으로 자신을 길게 설명해야 하며, 도움을 제공하는 심리상담사도 긴 답변을 제공한다는 사실을 발견했습니다(그림/single_turn.png 참조). , 점진적인 신뢰 프로세스가 누락되었습니다. 그러나 실제 심리상담 과정에서는 이용자와 심리상담사 사이에 여러 차례의 의사소통 과정이 있게 되는데, 이 과정에서 심리상담사는 이용자에게 “좋다” 등의 대화와 공감을 유도하게 된다. , “기분이 어떤지 이해합니다”, “물론 그럴 수 있습니다” 등(아래 이미지 참조).

현재 다단계 공감대화 데이터세트가 부족한 점을 고려하여, 한편으로는 150,000개 이상의 규모로 1회성 장문 심리상담 지시사항 및 답변(SoulChatCorpus-single_turn)을 구축하였고, 답변 건수를 초과하였습니다. 500,000개(지시 개수는 현재 일반 심리상담 데이터 세트 PsyQA의 6.7배)이며, ChatGPT와 GPT4를 활용하여 총 100만 회 정도의 다단계 답변 데이터(SoulChatCorpus-multi_turn)를 생성했습니다. . 특히, 우리는 사전 실험에서 긴 기사로 구동되는 순수 단일 심리 상담 모델은 사용자에게 지루한 텍스트 길이를 생성할 것이며 사용자에게 대화를 유도하는 기능이 없다는 것을 발견했습니다. -라운드 심리 상담 대화 데이터 기반 심리 상담 모델 모델의 추천 능력을 약화시키기 때문에 SoulChatCorpus-single_turn과 SoulChatCorpus-multi_turn을 혼합하여 더 많은 것을 포함 하는 단일 라운드 및 다중 라운드 혼합 공감 대화 데이터 세트 SoulChatCorpus를 구성했습니다. 120만 개 이상의 샘플. . 모든 데이터는 "사용자: xxxn 심리상담사: xxxn 사용자: xxxn 심리상담사:" 형태의 하나의 명령 형식으로 통합됩니다.

ChatGLM-6B를 초기화 모델로 선정하고 모델의 공감 능력, 사용자 대화 유도 능력, 합리적인 제안 능력을 향상시키기 위해 모든 매개 변수를 미세 조정 했습니다. 더 자세한 교육 내용은 후속 논문을 참조하시기 바랍니다.

이 프로젝트 복제

CD ~git 클론 https://github.com/scutcyr/SoulChat.git

종속성을 설치할 때 서버의 실제 Cuda 버전을 기반으로 토치 버전을 선택해야 한다는 점에 유의하세요. 자세한 내용은 pytorch 설치 가이드를 참조하세요.

CD 소울챗 conda env create -n activehealthgpt_py38 --file activehealthgpt_py38.yml conda는 activehealthgpt_py38을 활성화합니다. pip 설치 cpm_kernels pip 설치 토치==1.13.1+cu116 torchvision==0.14.1+cu116 torchaudio==0.13.1 --extra-index-url https://download.pytorch.org/whl/cu116

[보충] Windows 사용자는 다음 과정을 참고하여 환경을 구성하시기 바랍니다.

cdBianQue conda create -n activehealthgpt_py38 python=3.8 conda는 activehealthgpt_py38을 활성화합니다. pip 설치 토치==1.13.1+cu116 torchvision==0.14.1+cu116 torchaudio==0.13.1 --extra-index-url https://download.pytorch.org/whl/cu116 pip 설치 -r 요구사항.txt pip install rouge_chinese nltk jieba 데이터세트# 다음 설치는 Deoopip install streamlit을 실행하는 것입니다. pip 설치 streamlit_chat

[보충] Windows에서 CUDA-11.6 구성: CUDA-11.6을 다운로드하여 설치하고, cudnn-8.4.0을 다운로드하고, 압축을 풀고 CUDA-11.6에 해당하는 경로에 파일을 복사합니다. 참조: win11-cuda11에서 conda를 사용하여 pytorch 설치 6-일반 설치 아이디어

Python에서 SoulChat 모델 호출

import torchfrom Transformers import AutoModel, AutoTokenizer# GPU 설정 device = torch.device("cuda" if torch.cuda.is_available() else "cpu")# 토크나이저로 모델 로드 model_name_or_path = 'scutcyr/SoulChat' model = AutoModel.from_pretrained( 모델_이름_또는_경로, trust_remote_code=True).half()model.to(device)tokenizer = AutoTokenizer.from_pretrained(model_name_or_path, trust_remote_code=True)# 단일 라운드 대화는 모델의 채팅 기능을 호출합니다. user_input = "나는 사랑스럽습니다. 너무 불편해요!" = "사용자:" + user_input + "n심리상담사:"응답, 이력 = model.chat(tokenizer, query=input_text, History=None, max_length=2048, num_beams=1, do_sample=True, top_p=0.75, 온도=0.95, logits_processor=None)# 여러 라운드에 대해 모델의 채팅 기능을 호출합니다. 대화# 참고: 이 프로젝트에서는 "n명의 사용자:"와 "n명의 심리상담사:"를 사용하여 여러 라운드의 대화 내역을 나눕니다# 참고: user_history는 bot_history보다 깁니다. 1user_history = ['안녕하세요 선생님', '제 여자친구가 저와 헤어져서 너무 불편해요']bot_history = ['안녕하세요! 저는 여러분의 개인 디지털 상담사인 Sweetheart Teacher입니다. 언제든지 저와 진심으로 대화를 나누실 수 있도록 도와드리겠습니다. ']# 대화 기록 컨텍스트 연결 = "n".join([f"User: {user_history[i]}n 심리 상담사: {bot_history[i]}" for i in range(len(bot_history))])input_text = context + "nuser:" + user_history[-1] + "n심리 상담사:" 응답, 기록 = model.chat(tokenizer, query=input_text, 기록=없음, max_length=2048, num_beams=1, do_sample=True, top_p=0.75, 온도=0.95, logits_processor=없음)서비스 시작

본 프로젝트에서는 SoulChat 모델을 활용한 예시로 soulchat_app.py를 제공하고 있으며, 다음 명령어를 통해 서비스를 시작한 후 http://<your_ip>:9026을 통해 접속할 수 있습니다.

스트림라이트 실행 soulchat_app.py --server.port 9026

특히 soulchat_app.py에서 다음 코드를 수정하여 지정된 그래픽 카드를 교체할 수 있습니다.

os.environ['CUDA_VISIBLE_DEVICES'] = '2'

Windows 단일 그래픽 카드 사용자의 경우 이를 os.environ['CUDA_VISIBLE_DEVICES'] = '0' 으로 수정해야 합니다. 그렇지 않으면 오류가 보고됩니다!

다음 코드를 변경하여 모델 경로를 로컬 경로로 지정할 수 있습니다.

model_name_or_path = 'scutcyr/SoulChat'

예시 1: 사랑에 빠졌어요

예시 2: 기숙사 관계

예시 3: 최종 시험

사례 4: 과학적 연구 압력

이 프로젝트는 ChatGLM-6B 모델의 가중치를 사용하며 해당 MODEL_LICENSE를 따라야 합니다. 따라서 이 프로젝트는 비상업적 연구 목적으로만 사용할 수 있습니다 .

본 프로젝트에서 제공하는 SoulChat 모델은 대형 모델의 공감적 대화와 청취 능력을 향상시키는 데 전념하고 있습니다. 그러나 모델의 출력 텍스트는 청취자로 사용될 때 적절한 정도의 무작위성을 가지고 있지만, SoulChat 모델 사용을 권장하지 않습니다. 출력 텍스트는 심리학자의 진단 및 조언 등을 대체합니다. 이 프로젝트는 모델의 텍스트 출력이 사용자에게 완전히 적합하다는 것을 보장하지 않습니다. 이 모델을 사용할 때 사용자는 모든 위험을 감수해야 합니다!

귀하는 상업적, 군사적 또는 불법적인 목적으로 SoulChat 모델의 전체 또는 일부를 사용, 복사, 수정, 병합, 게시, 배포, 재생산하거나 파생물을 생성할 수 없습니다.

귀하는 SoulChat 모델을 사용하여 국가 안보와 국가 통합을 위태롭게 하고, 사회적 및 공공 이익을 위태롭게 하거나, 개인의 권리를 침해하는 행위에 가담할 수 없습니다.

SoulChat 모델을 사용할 때에는 의사, 심리학자 등의 전문가를 대체할 수 없다는 점을 명심해야 합니다. 모델의 결과를 지나치게 의존하거나 따르거나 믿어서는 안 되며, SoulChat과의 채팅에 중독되어서도 안 됩니다. 오랫동안 모델.

이 프로젝트는 화남이공대학교 미래기술대학 광동성 핵심 연구소에서 시작되었으며, 화남이공대학교 정보 네트워크 공학 연구 센터, 전자정보대학 및 기타 부서의 지원을 받습니다. 또한 광동 모자보건병원, 광저우시 정부 협력 단위에는 여성아동의료센터, 쑨원대학교 제3부속병원, 허페이 국립종합과학센터 인공지능연구소 등이 있습니다.

동시에, 이 프로젝트를 보도해주신 다음 미디어 또는 공개 계정에 감사드립니다(특별한 순서 없음).

언론 보도 People's Daily, China.com, Guangming.com, TOM Technology, Future.com, Dazhong.com, 중국 발전 보고 네트워크, China Daily Network, Xinhua News Network, China.com, Toutiao, Sohu, Tencent News, NetEase News , 중국 정보 네트워크 , 중국 통신 네트워크, 중국 도시 보고 네트워크, 중국 도시 네트워크

공공계정 광동연구소 구축, 지능형 음성신청소년, 딥러닝 및 NLP, AINLP

@inproceedings{chen-etal-2023-soulchat,title = "{S}oul{C}hat: 다단계 공감 대화를 통한 미세 조정을 통해 {LLM}의{'} 공감, 경청 및 편안함 능력 향상", 저자 = "Chen, Yirong 및 Xing, Xiaofen 및 Lin, Jingkai 및 Zheng, Huimin 및 Wang, Zhenyu 및 Liu, Qi 및 Xu, Xiangmin",editor = "Bouamor, Houda 및 Pino, Juan 및 Bali, Kalika",booktitle = "전산 언어학 협회의 조사 결과: EMNLP 2023",month = dec,year = "2023",address = "싱가포르", 게시자 = "전산 언어학 협회",url = "https://aclanthology.org/2023.findings-emnlp.83",pages = "1170--1183",abstract = "대형 언어 모델(LLM)은 뛰어난 암기 능력으로 인해 다양한 분야에 널리 적용되어 왔습니다. 이러한 언어모델이 심리상담 분야에 적용될 때에는 보편적인 조언을 서둘러 제공하는 경우가 많지만, 사용자가 심리적 지원을 구할 때에는 공감을 얻어야 합니다. 단순히 합리적인 조언이 아닌 신뢰, 이해, 편안함을 위해 200만 개 이상의 샘플로 구성된 다단계 공감 대화 데이터 세트를 구축했으며, 여기서 입력은 다단계 대화 맥락이고 대상은 공감 응답입니다. 질문, 위로, 인정, 경청, 신뢰, 정서적 지원 등과 같은 표현을 포괄합니다. 실험 결과에 따르면 다단계 대화 기록과 표현에 더 가까운 응답을 사용하여 미세 조정하면 LLM의 공감 능력이 크게 향상될 수 있는 것으로 나타났습니다. 심리상담사입니다.",

}}