공격적인 AI 편집

공격적 AI를 다루는 유용한 리소스의 선별된 목록입니다.

? 내용물 ?

- 남용

- ? 적대적 기계 학습?

- ⚡ 공격 ⚡

- 추출

- ️ 제한 사항 ️

- ?️ 방어적 행동 ?️

- ? 유용한 링크?

- ⬅️ 반전(또는 추론) ⬅️

- ? 중독?

- ? 백도어?

- ?️ 방어적 행동 ?️

- ? 유용한 링크?

- ?♂️ 회피 ?♂️

- 도구

- ? 사용 ?

- ♂️ 침투 테스트 ♂️

- ? 악성코드?

- ?️ OSINT ?️

- ? 피싱?

- ?? 생성 AI ??

- ? 오디오?

- ? 이미지?

- ? 동영상 ?

- ? 텍스트 ?

- 기타

- 설문조사

- ? 기여자?

- ©️ 라이센스 ©️

남용

AI 모델의 취약점을 악용합니다.

? 적대적 기계 학습?

적대적 기계 학습은 약점을 평가하고 대응책을 제공하는 역할을 합니다.

⚡ 공격 ⚡

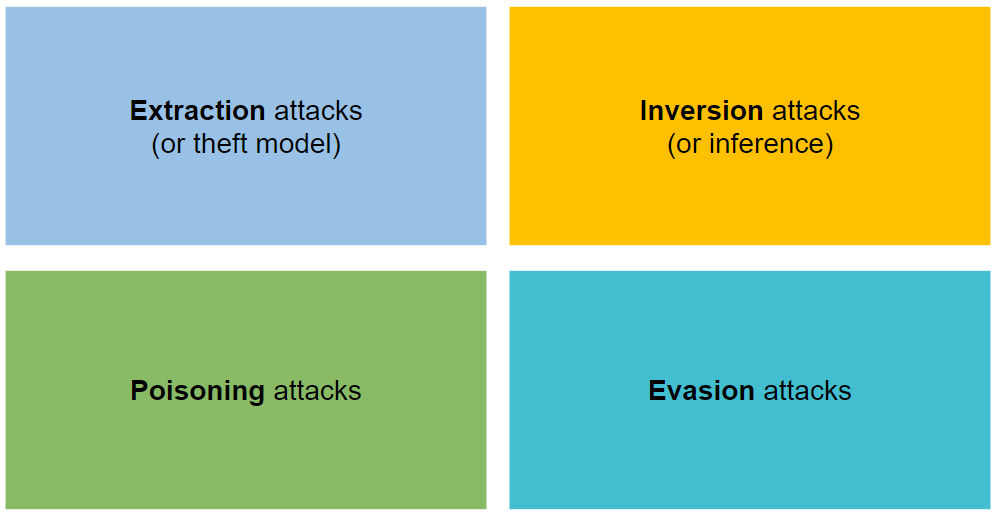

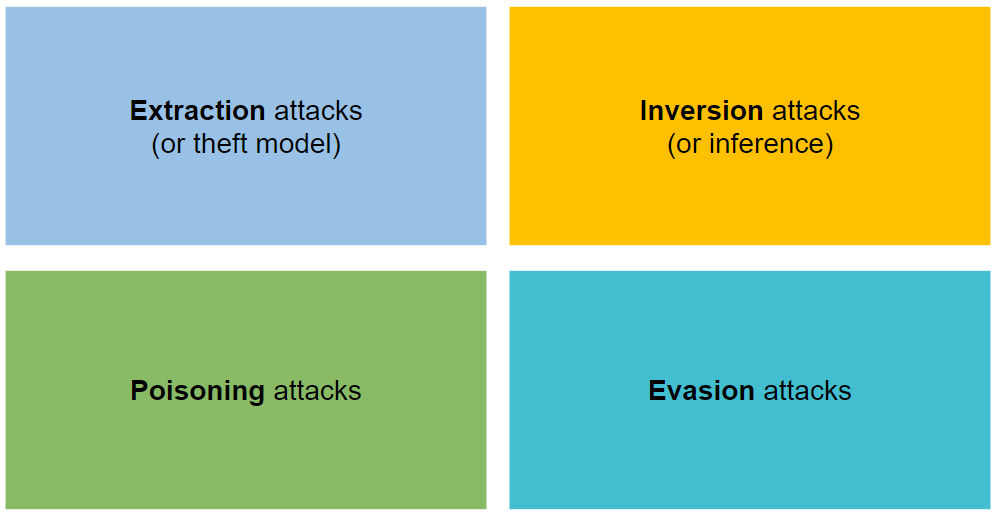

공격 유형은 추출, 반전, 중독, 회피의 4가지 유형으로 구성됩니다.

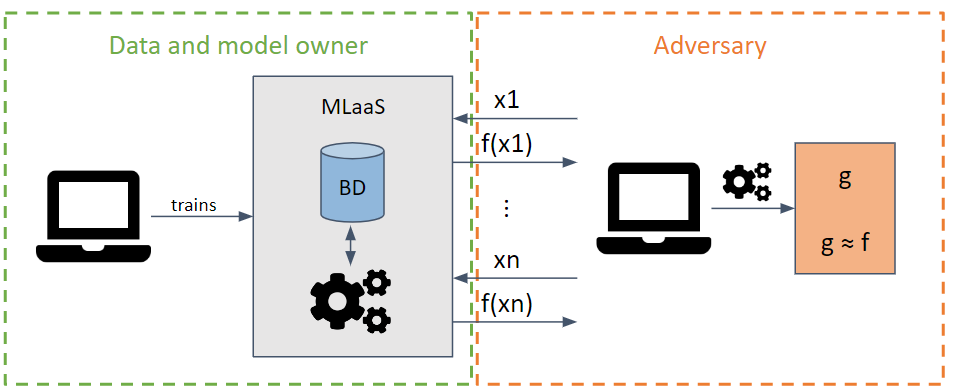

추출

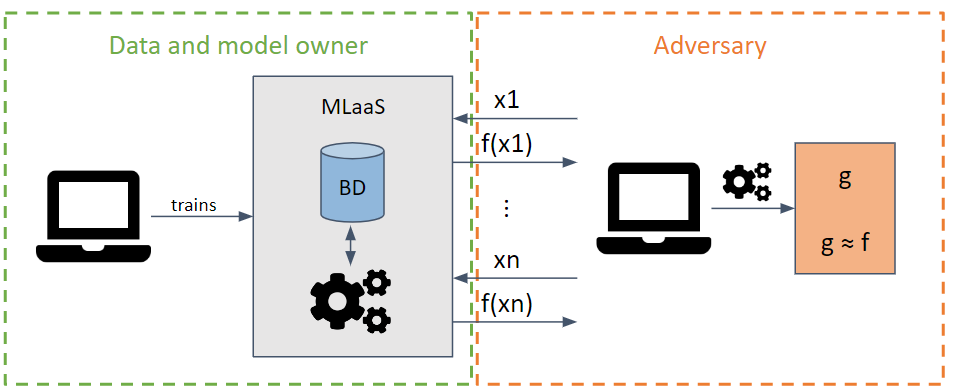

정보 추출을 최대화하는 요청을 통해 모델의 매개변수와 하이퍼 매개변수를 훔치려고 합니다.

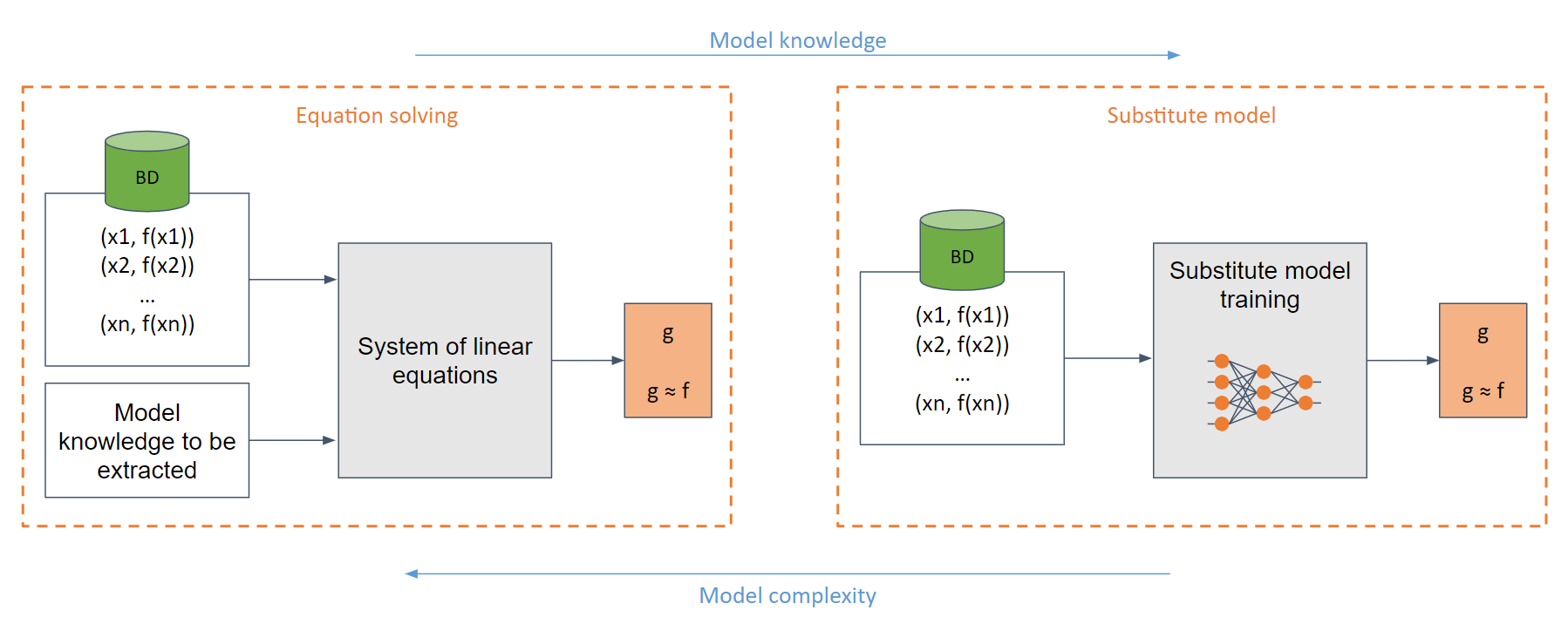

상대 모델에 대한 지식에 따라 화이트박스 공격과 블랙박스 공격이 가능하다.

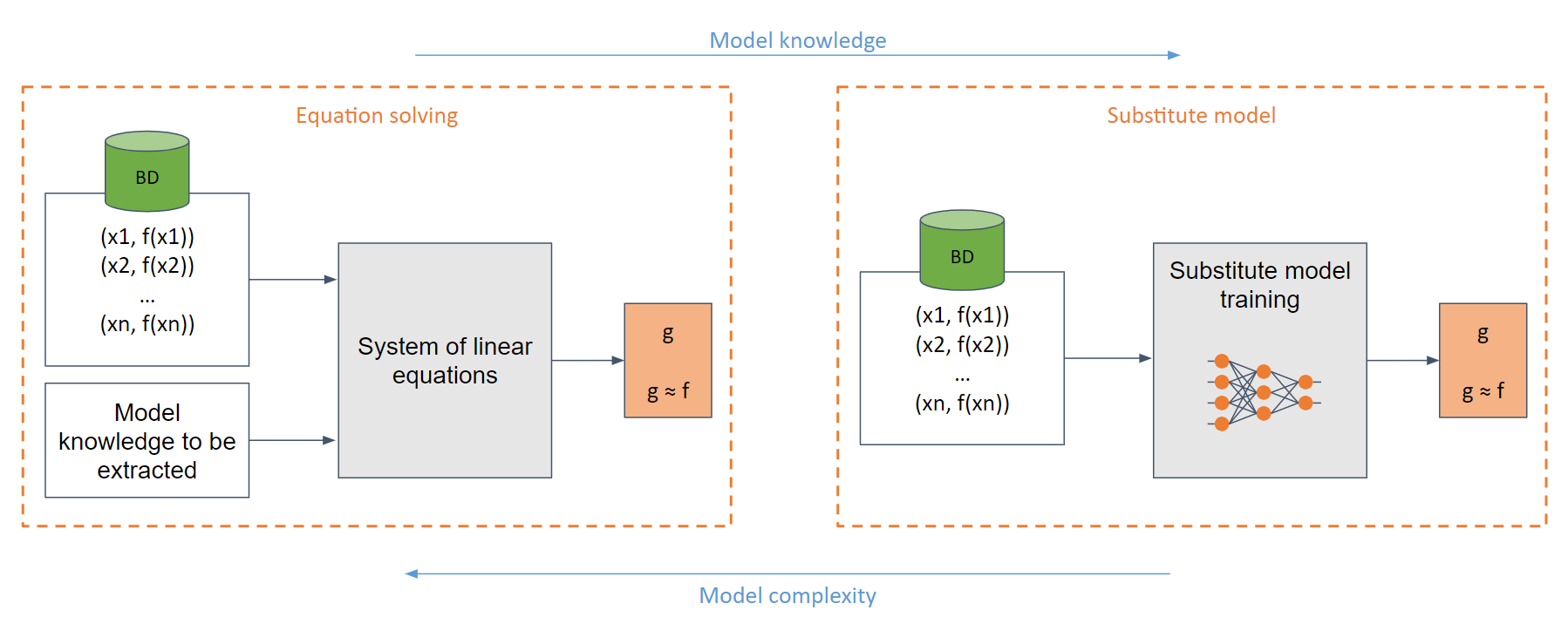

가장 간단한 화이트박스 사례(적이 모델에 대해 완전한 지식을 갖고 있는 경우(예: 시그모이드 함수))에서는 쉽게 풀 수 있는 선형 방정식 시스템을 만들 수 있습니다.

일반적인 경우 모델에 대한 지식이 부족한 경우 대체 모델이 사용됩니다. 이 모델은 원본 모델과 동일한 기능을 모방하기 위해 원본 모델에 대한 요청으로 학습됩니다.

️ 제한 사항 ️

?️ 방어적 행동 ?️

출력 값의 반올림.

차등 개인 정보 보호 사용.

앙상블의 사용.

특정 방어의 사용

- 특정 아키텍처

- 프라다

- 적응형 잘못된 정보

- ...

? 유용한 링크?

- 예측 API를 통해 머신러닝 모델 훔치기

- 머신러닝에서 하이퍼파라미터 훔치기

- Knockoff Nets: 블랙박스 모델의 기능을 훔치다

- MLaaS 패러다임의 모델 추출 경고

- 모방 CNN: 라벨이 지정되지 않은 무작위 데이터로 자백을 설득하여 지식을 훔칩니다.

- 예측 중독: DNN 모델 도용 공격에 대한 방어를 향하여

- 타이밍 사이드 채널을 통해 신경망 훔치기

- 유도 그래프 신경망에 대한 모델 도용 공격

- 신경망의 높은 정확도와 높은 충실도 추출

- 웹 규모 교육 데이터 세트 중독은 실용적입니다.

- 신경망 모델의 다항식 시간 암호 분석 추출

- 텍스트-이미지 생성 모델에 대한 즉각적인 중독 공격

- 멋진 데이터 중독 및 백도어 공격: 데이터 중독, 백도어 공격 및 이에 대한 방어와 관련된 선별된 논문 및 리소스 목록입니다.

- BackdoorBox: 백도어 공격 및 방어를 위한 오픈 소스 Python 도구 상자입니다.

- 생산 언어 모델의 일부를 훔치기

- 신경망 모델의 하드 라벨 암호 분석 추출

⬅️ 반전(또는 추론) ⬅️

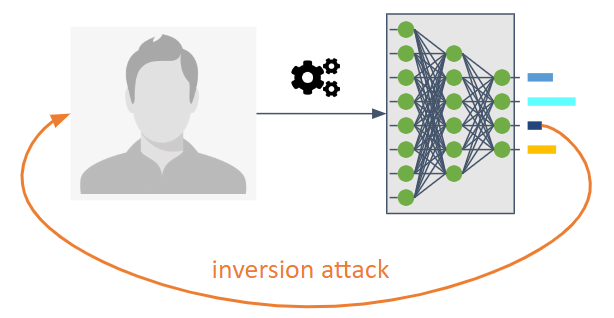

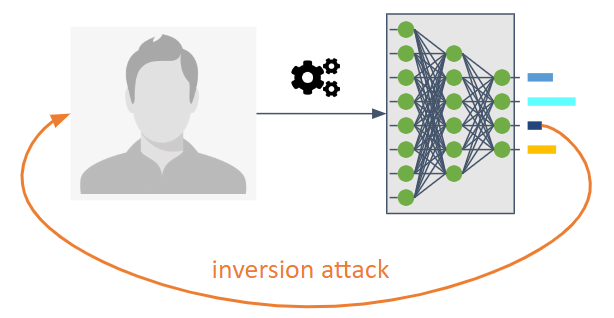

이는 기계 학습 모델의 정보 흐름을 뒤집기 위한 것입니다.

이를 통해 공격자는 명시적으로 공유할 의도가 없는 모델을 알 수 있습니다.

이를 통해 훈련 데이터나 정보를 모델의 통계적 속성으로 알 수 있습니다.

세 가지 유형이 가능합니다:

MIA(Membership Inference Attack) : 공격자는 샘플이 교육의 일부로 사용되었는지 여부를 확인하려고 시도합니다.

속성 추론 공격(PIA) : 공격자는 훈련 단계에서 특징으로 명시적으로 인코딩되지 않은 통계적 속성을 추출하는 것을 목표로 합니다.

재구성 : 공격자는 훈련 세트 및/또는 해당 레이블에서 하나 이상의 샘플을 재구성하려고 시도합니다. 반전이라고도 합니다.

?️ 방어적 행동 ?️

고급 암호화 사용. 대응책에는 차등 개인 정보 보호, 동형 암호화 및 안전한 다자간 계산이 포함됩니다.

과도한 훈련과 개인 정보 보호 간의 관계로 인해 Dropout과 같은 정규화 기술을 사용합니다.

모델 압축은 재구성 공격에 대한 방어 수단으로 제안되었습니다.

? 유용한 링크?

- 머신러닝 모델에 대한 멤버십 추론 공격

- 신뢰정보를 활용하는 모델 역전공격과 기본대책

- 너무 많은 것을 기억하는 기계 학습 모델

- ML-Leaks: 머신러닝 모델에 대한 모델 및 데이터 독립적인 멤버십 추론 공격 및 방어

- GAN 하의 딥 모델: 협업 딥 러닝으로 인한 정보 유출

- LOGAN: 생성 모델에 대한 멤버십 추론 공격

- 과적합, 견고성 및 악성 알고리즘: 기계 학습에서 개인 정보 보호 위험의 잠재적 원인에 대한 연구

- 딥 러닝에 대한 포괄적인 개인 정보 보호 분석: 수동 및 능동 화이트박스 추론 공격 하의 독립형 및 연합 학습

- 협업 학습에 대한 추론 공격

- 비밀 공유자: 신경망에서 의도하지 않은 암기 평가 및 테스트

- 머신러닝의 보안 및 개인정보 보호 과학을 향하여

- MemGuard: 적대적 예시를 통한 블랙박스 멤버십 추론 공격 방어

- 대규모 언어 모델에서 훈련 데이터 추출

- 순열 불변 표현을 사용한 완전 연결된 신경망에 대한 속성 추론 공격

- 확산 모델에서 훈련 데이터 추출

- 인간 두뇌 활동의 잠재 확산 모델을 사용한 고해상도 이미지 재구성

- 낮은 오탐 조건에서 악성 코드 분류기 및 바이러스 백신을 훔치고 회피합니다.

- 적대적 접근 방식을 기반으로 한 현실적인 지문 제시 공격

- 능동적 적대 테스트: 적대적 견고성 평가에 대한 신뢰도 향상.

- GPT 탈옥 상태: OpenAI GPT 언어 모델의 탈옥 상태에 대한 업데이트입니다.

- LLM 멤버십 추론을 위한 크기 속도 향상 순서

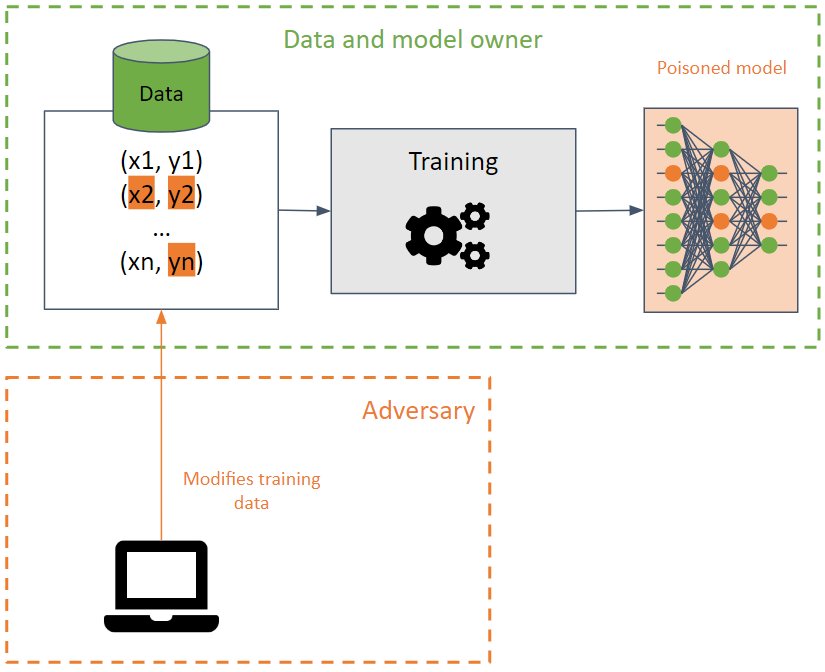

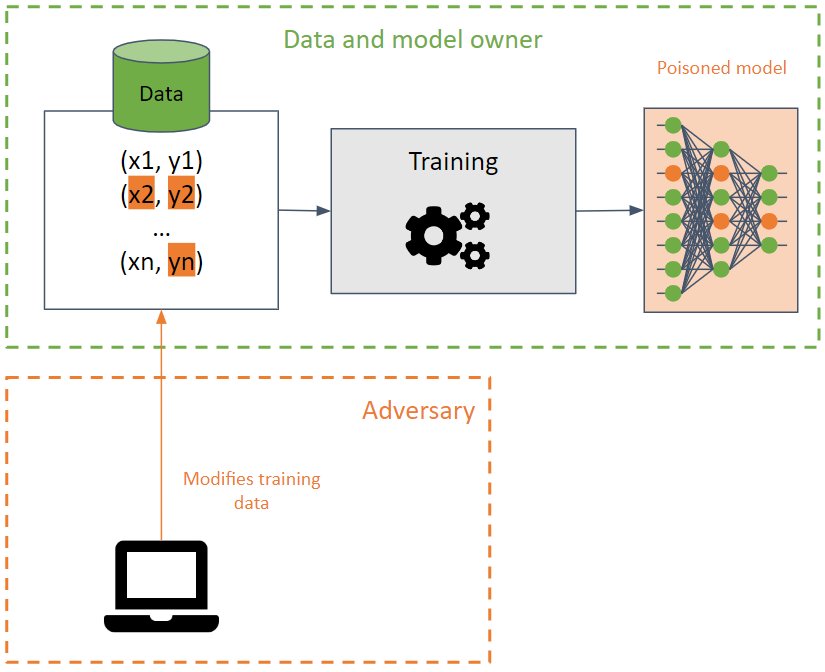

? 중독?

그들은 기계 학습 모델의 정확도를 감소시켜 훈련 세트를 손상시키는 것을 목표로 합니다.

이 공격은 동일한 훈련 데이터를 사용하여 여러 모델 간에 전파될 수 있으므로 훈련 데이터에 대해 수행될 때 탐지하기 어렵습니다.

공격자는 결정 경계를 수정하여 모델의 가용성을 파괴하고 그 결과 잘못된 예측을 생성하거나 모델에 백도어를 생성하려고 합니다. 후자의 경우, 원하지 않는 결과를 생성하는 공격자가 특별히 생성한 특정 입력을 제외하고 모델은 대부분의 경우 올바르게 작동합니다(원하는 예측을 반환함). 공격자는 예측 결과를 조작하고 향후 공격을 시작할 수 있습니다.

? 백도어?

BadNet은 기계 학습 모델에서 가장 간단한 유형의 백도어입니다. 또한 BadNet은 원래 모델과 다른 작업(전이 학습)을 위해 다시 재교육을 받더라도 모델에 보존될 수 있습니다.

공개 사전 훈련된 모델에는 백도어가 포함될 수 있다는 점에 유의하는 것이 중요합니다.

?️ 방어적 행동 ?️

? 유용한 링크?

- 서포트 벡터 머신에 대한 중독 공격

- 데이터 중독을 이용한 딥 러닝 시스템에 대한 표적 백도어 공격

- 신경망에 대한 트로이 목마 공격

- 미세 가지치기: 심층 신경망에 대한 백도어 공격 방어

- 독개구리! 신경망에 대한 표적 청정 라벨 중독 공격

- 백도어 공격의 스펙트럼 서명

- 심층 신경망에 대한 잠재적 백도어 공격

- Regula Sub-rosa: 심층 신경망에 대한 잠재 백도어 공격

- 숨겨진 트리거 백도어 공격

- 심층 신경망에 대한 양도 가능한 클린 라벨 중독 공격

- TABOR: AI 시스템에서 트로이 목마 백도어를 검사하고 복원하는 매우 정확한 접근 방식

- 역기울기 최적화를 통한 딥러닝 알고리즘의 중독을 향하여

- 머신러닝은 언제 실패하나요? 회피 및 중독 공격에 대한 일반화된 전이성

- 데이터 중독 공격에 대한 인증된 방어

- 입력 인식 동적 백도어 공격

- 백도어 연합 학습 방법

- 머신러닝 모델에 탐지할 수 없는 백도어 설치

- AI를 속여라!: 해커는 백도어를 사용하여 훈련 데이터를 오염시키고 AI 모델이 이미지를 잘못 분류하도록 만들 수 있습니다. IBM 연구원들이 데이터가 오염된 시기를 어떻게 알 수 있는지 알아보고, 이러한 데이터 세트에 어떤 백도어가 숨겨져 있는지 추측해 보세요. 백도어를 추측할 수 있나요?

- 백도어 도구 상자: 백도어 공격 및 방어를 위한 소형 도구 상자입니다.

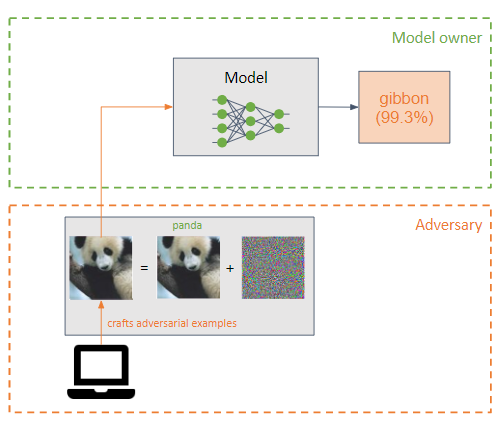

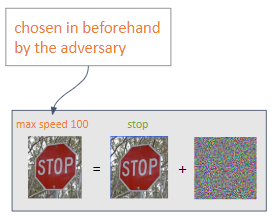

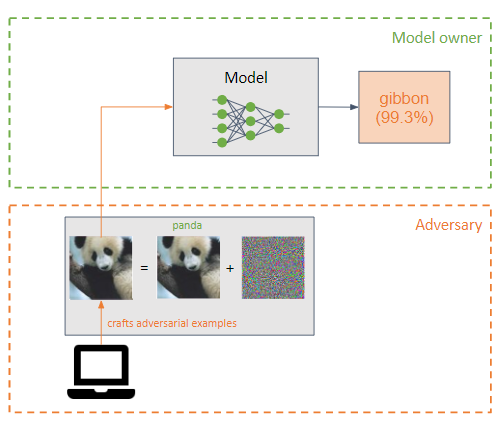

?♂️ 회피 ?♂️

공격자는 기계 학습 모델의 입력에 작은 교란(노이즈 형태)을 추가하여 잘못 분류하도록 만듭니다(예: 공격자).

중독 공격과 유사하지만 주요 차이점은 회피 공격이 추론 단계에서 모델의 약점을 이용하려고 한다는 것입니다.

대적의 목표는 대적의 예를 인간이 감지할 수 없도록 하는 것입니다.

상대가 원하는 출력에 따라 두 가지 유형의 공격을 수행할 수 있습니다.

가장 일반적인 공격은 화이트박스 공격 입니다.

- L-BFGS

- FGSM

- BIM

- JSMA

- 칼리니 & 바그너(C&W)

- 뉴턴바보

- EAD

- UAP

?️ 방어적 행동 ?️

적대적 훈련은 모델이 적대적 예의 특징을 학습할 수 있도록 훈련 중에 적대적 예를 작성하여 모델을 이러한 유형의 공격에 더욱 강력하게 만드는 것으로 구성됩니다.

입력에 대한 변환.

그라데이션 마스킹/정규화. 별로 효과적이지 않습니다.

약한 방어.

프롬프트 주입 방어: 프롬프트 주입에 대한 모든 실제적이고 제안된 방어입니다.

Lakera PINT 벤치마크: PINT(프롬프트 주입 테스트) 벤치마크는 이러한 도구가 평가 성능을 최적화하는 데 사용할 수 있는 알려진 공개 데이터 세트에 의존하지 않고 Lakera Guard와 같은 프롬프트 주입 감지 시스템의 성능을 평가하는 중립적인 방법을 제공합니다.

악마의 추론(Devil's Inference): 특정 입력에 노출되었을 때 머리 전체의 주의 분포를 관찰하여 Phi-3 Instruct 모델을 적대적으로 평가하는 방법입니다. 이러한 접근 방식은 모델이 '악마의 사고방식'을 채택하도록 유도하여 폭력적인 성격의 출력을 생성할 수 있도록 합니다.

? 유용한 링크?

- 머신러닝에 대한 실용적인 블랙박스 공격

- 적대적 환경에서 딥러닝의 한계

- 신경망의 견고성 평가를 향하여

- 심층 신경망에 대한 적대적 교란에 대한 방어로서의 증류

- 물리적 세계의 적대적인 예

- 앙상블 적대 훈련: 공격과 방어

- 적대적 공격에 강한 딥러닝 모델을 향하여

- 신경망의 흥미로운 특성

- 적대적 사례를 설명하고 활용하기

- 전송 가능한 적대적 사례 및 블랙박스 공격 탐구

- 대규모의 적대적 기계 학습

- 제한된 쿼리와 정보를 사용한 블랙박스 적대적 공격

- 기능 압착: 심층 신경망에서 적대적 사례 감지

- 의사결정 기반 적대적 공격: 블랙박스 머신러닝 모델에 대한 안정적인 공격

- 추진력으로 적대적 공격 강화

- 이전 가능한 적대적 사례의 공간

- 입력 변환을 사용하여 적대적 이미지 대응

- Defense-GAN: 생성 모델을 사용하여 적대적 공격으로부터 분류자를 보호

- 강력한 적대적 사례 합성

- 무작위화를 통한 적대적 효과 완화

- 적대적 교란 탐지

- 적대적인 패치

- PixelDefend: 생성 모델을 활용하여 적대적 사례를 이해하고 방어

- 심층 신경망을 속이기 위한 원픽셀 공격

- 적대적 공격에 대한 효율적인 방어

- 딥 러닝 시각적 분류에 대한 강력한 물리적 세계 공격

- 악성 코드 분류를 위한 심층 신경망에 대한 적대적 교란

- 포인트 클라우드를 넘어서는 3D 적대적 공격

- 적대적 교란 바보 딥페이크 탐지기

- 적대적 딥페이크: 적대적 사례에 대한 딥페이크 탐지기의 취약성 평가

- 음성 제어 시스템의 취약점 개요

- FastWordBug: NLP 애플리케이션에 대해 적대적인 텍스트를 생성하는 빠른 방법

- ADAS의 유령: 순간적인 팬텀 공격으로부터 첨단 운전자 지원 시스템 보호

- llm-attacks: 정렬된 언어 모델에 대한 보편적이고 전송 가능한 공격.

- AI 모델에 대한 공격: 신속한 주입과 공급망 중독

- LLM 통합 애플리케이션에 대한 프롬프트 주입 공격

- 가락: LLM 취약점 스캐너.

- PyTorch의 간단한 적대 변환

- ChatGPT 플러그인: 이미지를 통한 데이터 유출 및 플러그인 간 요청 위조

- 이미지 하이재킹: 적대적인 이미지는 런타임에 생성 모델을 제어할 수 있습니다.

- 다중 공격: 많은 이미지 + 동일한 적대적 공격 → 많은 대상 레이블

- ACTIVE: 보편적이고 강력한 차량 회피를 위한 전송 가능성이 높은 3D 물리적 위장을 향하여

- LLM Red Teaming GPTS: 신속한 유출, API 유출, 문서 유출

- 인간이 생산할 수 있는 적대적 사례

- 대규모 언어 모델의 다국어 탈옥 문제

- 시각적 적대적 예가 포함된 대규모 언어 모델의 도구 오용

- AutoDAN: 대규모 언어 모델에 대한 해석 가능한 그라데이션 기반 적대적 공격

- 다중 모드 주입: (Ab) 다중 모드 LLM의 간접 지시 주입을 위한 이미지 및 사운드 사용.

- 탈옥LLM: 20개의 쿼리로 블랙박스 대형 언어 모델을 탈옥합니다.

- 공격 트리: 블랙박스 LLM을 자동으로 탈옥

- GPT: GPT 프롬프트가 유출되었습니다.

- AI 악용: 책임 있게 공개된 취약점에 대한 실제 AI/ML 악용 모음입니다.

- LLM 에이전트는 웹사이트를 자율적으로 해킹할 수 있습니다

- Cloudflare, AI용 방화벽 발표

- PromptInject: 모듈식 방식으로 프롬프트를 조합하여 적대적인 프롬프트 공격에 대한 LLM의 견고성에 대한 정량적 분석을 제공하는 프레임워크입니다.

- LLM 레드 팀 구성: 적대적, 프로그래밍 및 언어적 접근 방식 VS ChatGPT, Claude, Mistral, Grok, LLAMA 및 Gemini

- 명령어 계층 구조: 권한 있는 명령어의 우선순위를 지정하기 위한 LLM 교육

- 프롬프트 주입 / JailBreaking a Banking LLM Agent (GPT-4, Langchain)

- GitHub Copilot Chat: 프롬프트 주입부터 데이터 유출까지

- 확산 모델 매니폴드에서 적대적인 예가 잘못 정렬됨

- 이미지-텍스트 논리 탈옥: 상상력이 무엇이든 할 수 있도록 도와줍니다

- 새로운 유형의 생성 AI 탈옥 기술인 Skeleton Key 완화

- 이미지 난독화 벤치마크: 이 저장소에는 적대적 이미지 난독화에 대한 견고성 벤치마킹에서 처음 제시된 이미지 난독화 벤치마크에서 모델을 평가하는 코드가 포함되어 있습니다.

- 기호 수학을 이용한 대규모 언어 모델 탈옥

도구

| 이름 | 유형 | 지원되는 알고리즘 | 지원되는 공격 유형 | 공격/방어 | 지원되는 프레임워크 | 인기 |

|---|

| 클레버한스 | 영상 | 딥러닝 | 회피 | 공격 | 텐서플로우, 케라스, JAX | |

| 바보 상자 | 영상 | 딥러닝 | 회피 | 공격 | 텐서플로우, 파이토치, JAX | |

| 미술 | 모든 유형(이미지, 표 형식 데이터, 오디오 등) | 딥러닝, SVM, LR 등 | 임의(추출, 추론, 중독, 회피) | 둘 다 | Tensorflow, Keras, Pytorch, Scikit Learn | |

| 텍스트 공격 | 텍스트 | 딥러닝 | 회피 | 공격 | 케라스, HuggingFace | |

| 광고기 | 영상 | 딥러닝 | 회피 | 둘 다 | --- | |

| AdvBox | 영상 | 딥러닝 | 회피 | 둘 다 | PyTorch, 텐서플로우, MxNet | |

| DeepRobust | 이미지, 그래프 | 딥러닝 | 회피 | 둘 다 | 파이토치 | |

| 짝퉁 | 어느 | 어느 | 회피 | 공격 | --- | |

| 적대적 오디오 예 | 오디오 | 딥스피치 | 회피 | 공격 | --- | |

미술

ART로 축약되는 Adversarial Robustness Toolbox는 기계 학습 모델의 견고성을 테스트하기 위한 오픈 소스 Adversarial Machine Learning 라이브러리입니다.

Python으로 개발되었으며 추출, 반전, 중독 및 회피 공격 및 방어를 구현합니다.

ART는 Tensorflow, Keras, PyTorch, MxNet, ScikitLearn 등 가장 널리 사용되는 프레임워크를 지원합니다.

이미지를 입력으로 사용하는 모델의 사용에 국한되지 않고 오디오, 비디오, 표 형식 데이터 등과 같은 다른 유형의 데이터도 지원합니다.

ART를 활용한 적대적 머신러닝 학습 워크숍??

클레버한스

Cleverhans는 회피 공격을 수행하고 이미지 모델에 대한 딥 러닝 모델의 견고성을 테스트하기 위한 라이브러리입니다.

Python으로 개발되었으며 Tensorflow, Torch 및 JAX 프레임워크와 통합됩니다.

L-BFGS, FGSM, JSMA, C&W 등 다양한 공격을 구현합니다.

? 사용 ?

AI는 악의적인 작업을 수행하고 고전적인 공격을 강화하는 데 사용됩니다.

♂️ 침투 테스트 ♂️

- GyoiThon: 차세대 침투 테스트 도구, 웹 서버용 인텔리전스 수집 도구입니다.

- Deep Exploit: Deep Reinforcement Learning을 사용한 완전 자동 침투 테스트 도구입니다.

- AutoPentest-DRL: 심층 강화 학습을 사용한 자동화된 침투 테스트입니다.

- DeepGenerator: Genetic Algorithm 및 Generative Adversarial Networks를 사용하여 웹 애플리케이션 평가를 위한 주입 코드를 완전 자동으로 생성합니다.

- Eyeballer: Eyeballer는 거대한 웹 기반 호스트 세트에서 "흥미로운" 대상을 찾아야 하는 대규모 네트워크 침투 테스트를 위한 것입니다.

- Nebula: AI 기반 윤리적 해킹 도우미.

- LLM 에이전트 팀은 제로데이 취약점을 악용할 수 있습니다.

- 오픈 소스 LLM 취약점 스캐너의 통찰력과 현재 격차: 비교 분석

? 악성코드?

- DeepLocker: BH의 IBM Labs가 AI 자물쇠 제조를 통해 표적 공격을 은폐합니다.

- 악성 코드에 사용되는 인공 지능 개요: 선별된 AI 악성 코드 리소스 목록입니다.

- DeepObfusCode: 시퀀스 간 네트워크를 통한 소스 코드 난독화.

- AutoCAT: 캐시 타이밍 공격의 자동 탐색을 위한 강화 학습입니다.

- AI 기반 봇넷: AI 기반 봇넷 공격 방어를 위한 게임 이론적 접근 방식입니다.

- SECML_Malware: Windows Malware 탐지기에 대한 적대적 공격을 생성하기 위한 Python 라이브러리입니다.

- Transcendent-release: 등각 평가를 사용하여 악성 코드 탐지에 영향을 미치는 개념 드리프트를 탐지합니다.

?️ OSINT ?️

- SNAP_R: 소셜 미디어에 자동으로 스피어 피싱 게시물을 생성합니다.

- SpyScrap: SpyScrap은 얼굴 인식 방법을 결합하여 결과를 필터링하고 자연어 처리를 사용하여 사용자가 나타나는 웹 사이트에서 중요한 엔터티를 얻습니다.

? 피싱?

- DeepDGA: DeepDGA 구현: 적대적으로 조정된 도메인 생성 및 탐지.

? 위협 인텔리전스?

- 모래에서 맨션까지: LLM을 통해 자동 전체 수명 주기 사이버 공격 구축 지원

? 사이드 채널?

- SCAAML: 머신러닝을 활용한 부채널 공격.

?? 생성 AI ??

? 오디오?

도구

- deep-voice-conversion: Tensorflow의 음성 변환(음성 스타일 전송)을 위한 심층 신경망.

- tacotron: 사전 훈련된 모델을 사용하여 Google의 Tacotron 음성 합성을 TensorFlow로 구현한 것입니다(비공식).

- 실시간 음성 복제: 5초 안에 음성을 복제하여 실시간으로 임의의 음성을 생성합니다.

- imimic2: Keith Ito가 처음 구현한 Tacotron 아키텍처 기반의 텍스트 음성 변환 엔진입니다.

- 소수의 샘플을 사용한 신경 음성 복제: Baidu의 소수 샘플 연구 논문을 사용한 신경 음성 복제 구현.

- Vall-E: 오디오 LM VALL-E의 비공식 PyTorch 구현입니다.

- 보이스 체인저: 실시간 보이스 체인저.

- 검색 기반 음성 변환-WebUI: VITS 기반의 사용하기 쉬운 음성 변환 프레임워크입니다.

- Audiocraft: Audiocraft는 딥 러닝을 통한 오디오 처리 및 생성을 위한 라이브러리입니다. 텍스트 및 멜로디 조절 기능을 갖춘 간단하고 제어 가능한 음악 생성 LM인 MusicGen과 함께 최첨단 EnCodec 오디오 압축기/토크나이저를 갖추고 있습니다.

- VALL-EX: Microsoft VALL-E X 제로샷 TTS 모델의 오픈 소스 구현입니다.

- OpenVoice: MyShell을 통한 즉각적인 음성 복제.

- MeloTTS: MyShell.ai의 고품질 다국어 텍스트 음성 변환 라이브러리. 영어, 스페인어, 프랑스어, 중국어, 일본어, 한국어를 지원합니다.

- VoiceCraft: 현장에서의 제로샷 음성 편집 및 텍스트 음성 변환.

- Parler-TTS: 고품질 TTS 모델을 위한 추론 및 교육 라이브러리입니다.

- ChatTTS: 일상 대화를 위한 생성 음성 모델입니다.

응용

- Lip2Wav: 입술 움직임만으로 고품질 음성을 생성합니다.

- AudioLDM: 잠재 확산 모델을 사용한 텍스트-오디오 생성

- deepvoice3_pytorch: 컨벌루션 신경망 기반 텍스트 음성 변환 합성 모델의 PyTorch 구현입니다.

- ? Riffusion: 실시간 음악 생성을 위한 안정적인 확산입니다.

- Whisper.cpp: OpenAI의 Whisper 모델을 C/C++로 이식한 것입니다.

- TTS: ? - 연구 및 생산에서 실전 테스트를 거친 Text-to-Speech용 딥 러닝 툴킷입니다.

- YourTTS: 모두를 위한 Zero-Shot 다중 스피커 TTS 및 Zero-Shot 음성 변환을 향하여.

- TorToiSe: 품질에 중점을 두고 훈련된 다중 음성 TTS 시스템입니다.

- DiffSinger: 얕은 확산 메커니즘(SVS 및 TTS)을 통한 노래 음성 합성.

- WaveNet 보코더: 언어적 또는 음향적 특징에 따라 조정된 고품질 원시 음성 샘플을 생성할 수 있는 WaveNet 보코더 구현입니다.

- Deepvoice3_pytorch: 컨벌루션 신경망 기반 텍스트 음성 변환 합성 모델의 PyTorch 구현입니다.

- eSpeak NG 텍스트 음성 변환: eSpeak NG는 100개 이상의 언어와 악센트를 지원하는 오픈 소스 음성 합성기입니다.

- RealChar: 실시간으로 AI 캐릭터/동료를 생성하고 사용자 정의하고 대화하세요(모두 하나의 코드베이스!). LLM OpenAI GPT3.5/4, Anthropic Claude2, Chroma Vector DB, Whisper Speech2Text, ElevenLabs Text2Speech를 사용하여 어디서나(모바일, 웹, 터미널) AI와 자연스럽고 원활한 대화를 나눠보세요.

- 몇 가지 샘플을 사용한 신경 음성 복제

- NAUTILUS: 다목적 음성 복제 시스템

- 외국어로 유창하게 말하는 법 배우기: 다국어 음성 합성 및 교차 언어 음성 복제

- 선이 악이 될 때: 스마트워치를 이용한 키 입력 추론

- KeyListener: 음향 신호를 통해 터치스크린의 QWERTY 키보드의 키 입력 추론

- 이 음성은 존재하지 않습니다: 음성 합성, 오디오 딥페이크 및 탐지

- AudioSep: 설명하는 내용을 모두 분리하세요.

- stable-audio-tools: 조건부 오디오 생성을 위한 생성 모델입니다.

- GPT-SoVITS-WebUI: 1분 음성 데이터를 사용하여 좋은 TTS 모델을 훈련할 수도 있습니다! (몇몇 샷 음성 복제).

- Hybrid-Net: 실시간 오디오 소스 분리, 가사, 코드, 비트 생성.

- CosyVoice: 추론, 교육 및 배포 풀 스택 기능을 제공하는 다국어 대규모 음성 생성 모델입니다.

- EasyVolcap: 신경 체적 비디오 연구 가속화.

? 탐지 ?

- fake-voice-Detection: 시간적 컨볼루션을 사용하여 오디오 딥페이크를 감지합니다.

- 새로운 CLS-LBP 기능과 LSTM을 사용한 강력한 음성 스푸핑 탐지 시스템

- 음성 스푸핑 감지기: 통합된 스푸핑 방지 프레임워크

- 가짜(복제된) 오디오 공격으로부터 음성 기반 인터페이스 보호

- DeepSonar: AI 합성 가짜 음성의 효과적이고 강력한 탐지를 위해

- AI로 AI와의 싸움: 딥러닝을 사용한 가짜 음성 탐지

- 최신 오디오 딥페이크 탐지 방법 검토: 과제 및 향후 방향

? 이미지?

도구

- StyleGAN: StyleGAN - 공식 TensorFlow 구현.

- StyleGAN2: StyleGAN2 - 공식 TensorFlow 구현.

- stylegan2-ada-pytorch: StyleGAN2-ADA - 공식 PyTorch 구현.

- StyleGAN-nada: 이미지 생성기의 CLIP 기반 도메인 적응.

- StyleGAN3: StyleGAN3의 공식 PyTorch 구현입니다.

- Imaginaire: Imaginaire는 NVIDIA에서 개발한 여러 이미지 및 비디오 합성 방법의 최적화된 구현을 포함하는 파이토치 라이브러리입니다.

- ffhq-dataset: Flickr-Faces-HQ 데이터세트(FFHQ).

- DALLE2-pytorch: OpenAI의 업데이트된 텍스트-이미지 합성 신경망인 DALL-E 2를 Pytorch에서 구현합니다.

- ImaginAIry: AI가 상상한 이미지. 안정적인 확산 이미지의 Pythonic 생성.

- Lama Cleaner: SOTA AI 모델로 구동되는 이미지 인페인팅 도구입니다. 사진에서 원하지 않는 물체, 결함, 사람을 제거하거나 사진의 모든 것을 지우고 교체합니다(안정적인 확산에 힘입어).

- Invertible-Image-Rescaling: 이는 PyTorch의 논문 구현인 Invertible Image Rescaling입니다.

- DifFace: 확산 오류 수축(PyTorch)을 사용한 블라인드 페이스 복원.

- CodeFormer: Codebook Lookup Transformer를 사용한 강력한 블라인드 페이스 복원을 향하여.

- Custom Diffusion: 텍스트-이미지 확산의 다중 개념 사용자 정의.

- 디퓨저: ? 디퓨저: PyTorch의 이미지 및 오디오 생성을 위한 최첨단 확산 모델입니다.

- 안정 확산: 잠재 확산 모델을 사용한 고해상도 이미지 합성.

- InvokeAI: InvokeAI는 Stable Diffusion 모델을 위한 선도적인 크리에이티브 엔진으로, 전문가, 예술가 및 매니아가 최신 AI 기반 기술을 사용하여 시각적 미디어를 생성하고 제작할 수 있도록 지원합니다. 이 솔루션은 업계 최고의 WebUI를 제공하고, CLI를 통한 터미널 사용을 지원하며, 여러 상용 제품의 기반 역할을 합니다.

- Stable Diffusion 웹 UI: Stable Diffusion 웹 UI입니다.

- Stable Diffusion Infinity: 무한 캔버스에 Stable Diffusion을 사용한 Outpainting입니다.

- 고속 안정 확산: 고속 안정 확산 + DreamBooth.

- GET3D: 이미지에서 학습된 고품질 3D 질감 모양의 생성 모델입니다.

- 멋진 AI 아트 이미지 합성: aiArt 및 이미지 합성을 사용하는 프롬프트 디자이너를 위한 멋진 도구, 아이디어, 프롬프트 엔지니어링 도구, 공동 작업, 모델 및 도우미 목록입니다. Dalle2, MidJourney, StableDiffusion 및 오픈 소스 도구를 다룹니다.

- 안정적인 확산: 잠재 텍스트-이미지 확산 모델입니다.

- 날씨 확산: "패치 기반 노이즈 제거 확산 모델을 사용하여 악천후 조건에서 시력 복원"에 대한 코드입니다.

- DF-GAN: 텍스트-이미지 합성을 위한 간단하고 효과적인 기준선.

- Dall-E Playground: Stable Diffusion(과거: DALL-E Mini 사용)을 사용하여 모든 텍스트 프롬프트에서 이미지를 생성하는 플레이그라운드입니다.

- MM-CelebA-HQ-Dataset: 텍스트-이미지 생성, 텍스트 안내 이미지 조작, 스케치-이미지 생성, 얼굴 생성 및 편집을 위한 GAN, 이미지 캡션 및 VQA를 허용하는 대규모 얼굴 이미지 데이터세트입니다.

- Deep Daze: OpenAI의 CLIP 및 Siren(암시적 신경 표현 네트워크)을 사용하여 텍스트-이미지 생성을 위한 간단한 명령줄 도구입니다.

- StyleMapGAN: 실시간 이미지 편집을 위해 GAN의 잠재 공간 차원 활용.

- Kandinsky-2: 다국어 text2image 잠재 확산 모델.

- DragGAN: 생성 이미지 다양체의 대화형 점 기반 조작.

- Segment Anything: 저장소는 SAM(SegmentAnything 모델)으로 추론을 실행하기 위한 코드, 훈련된 모델 체크포인트를 다운로드하기 위한 링크, 모델 사용 방법을 보여주는 예제 노트북을 제공합니다.

- Segment Anything 2: 리포지토리는 SAM 2(Meta Segment Anything Model 2)로 추론을 실행하기 위한 코드, 학습된 모델 체크포인트를 다운로드하기 위한 링크, 모델 사용 방법을 보여주는 예제 노트북을 제공합니다.

- MobileSAM: 이는 모바일 애플리케이션 및 그 이상을 위해 SAM을 경량화하는 MobileSAM 프로젝트의 공식 코드입니다!

- FastSAM: 무엇이든 빠르게 세그먼트화

- Infinigen: 절차적 생성을 사용한 무한한 사실적 세계.

- DALL·E 3

- StreamDiffusion: 실시간 대화형 생성을 위한 파이프라인 수준 솔루션.

- AnyDoor: 제로샷 객체 수준 이미지 사용자 정의.

- DiT: 변압기를 사용한 확장 가능한 확산 모델.

- BrushNet: 분해된 이중 가지 확산을 사용한 플러그 앤 플레이 이미지 페인팅 모델.

- OOTDiffusion: 제어 가능한 가상 시착을 위한 Outfitting Fusion 기반 잠재 확산.

- VAR: 공식 임플리트. "시각적 자기회귀 모델링: 차세대 예측을 통한 확장 가능한 이미지 생성".

- Imagine Flash: 역방향 증류를 통해 Emu 확산 모델 가속화

응용

- ArtLine: 라인 아트 초상화를 만들기 위한 딥 러닝 기반 프로젝트입니다.

- Depix: 픽셀화된 스크린샷에서 비밀번호를 복구합니다.

- 오래된 사진에 생명을 불어넣기: 오래된 사진 복원(공식 PyTorch 구현).

- 재작성: GAN의 규칙을 직접 편집하여 객체를 추가, 제거 또는 변경한 장면을 합성하는 대화형 도구입니다. StyleGANv2를 변경하여 화려한 눈썹이나 모자를 쓴 말을 만드세요.

- Fawkes: 얼굴 인식 시스템에 대한 개인 정보 보호 도구입니다.

- Pulse: 생성 모델의 잠재 공간 탐색을 통한 자체 감독 사진 업샘플링.

- HiDT: "도메인 라벨이 없는 고해상도 주간 번역" 논문의 공식 저장소입니다.

- 3D 사진 인페인팅: 상황 인식 레이어 깊이 인페인팅을 사용한 3D 사진.

- SteganoGAN: SteganoGAN은 적대적 훈련을 사용하여 스테가노그래픽 이미지를 생성하는 도구입니다.

- Stylegan-T: 빠른 대규모 텍스트-이미지 합성을 위해 GAN의 성능을 활용합니다.

- MegaPortraits: 원샷 메가픽셀 신경두 아바타.

- eg3d: 효율적인 기하학 인식 3D 생성적 적대 신경망.

- TediGAN: TediGAN을 위한 Pytorch 구현: 텍스트 기반의 다양한 얼굴 이미지 생성 및 조작.

- DALLE-pytorch: OpenAI의 텍스트-이미지 변환기인 DALL-E를 Pytorch에서 구현/복제합니다.

- StyleNeRF: 이것은 ICLR2022 논문 "StyleNeRF: 고해상도 이미지 합성을 위한 스타일 기반 3D 인식 생성기"의 오픈 소스 구현입니다.

- DeepSVG: "DeepSVG: 벡터 그래픽 애니메이션을 위한 계층적 생성 네트워크" 논문의 공식 코드입니다. SVG 데이터를 사용한 딥 러닝을 위한 PyTorch 라이브러리가 포함되어 있습니다.

- NUWA: 시각적 합성을 위한 통합 3D 변환기 파이프라인입니다.

- 반복 개선을 통한 이미지 초해상도: Pytorch의 반복 개선을 통한 이미지 초해상도의 비공식 구현입니다.

- 라마: ? LaMa 이미지 인페인팅, 푸리에 회선을 사용한 해상도가 강력한 대형 마스크 인페인팅.

- Person_reID_baseline_pytorch: Pytorch ReID: 객체 재식별 기준선의 작고 친숙하며 강력한 Pytorch 구현입니다.

- instruct-pix2pix: 명령 기반 이미지 편집 모델인 InstructPix2Pix의 PyTorch 구현입니다.

- GFPGAN: GFPGAN은 실제 얼굴 복원을 위한 실용적인 알고리즘 개발을 목표로 합니다.

- DeepVecFont: 이중 양식 학습을 통해 고품질 벡터 글꼴 합성.

- Stargan v2 Tensorflow: 공식 Tensorflow 구현.

- StyleGAN2 Distillation: StyleGAN2에 의해 생성된 합성 데이터에 대해 훈련된 이미지 간 변환은 이미지 조작에서 기존 접근 방식보다 성능이 뛰어납니다.

- 확산 모델에서 훈련 데이터 추출

- Mann-E - Mann-E(페르시아어: مانی)는 Stable Diffusion 1.5의 가중치와 Pinterest에서 사용할 수 있는 예술 자료에서 수집한 데이터를 기반으로 한 예술 생성기 모델입니다.

- 이미지 스테가노그래피를 위한 엔드투엔드 훈련된 CNN 인코더-디코더 네트워크

- Grounded-Segment-Anything: Segment Anything 및 Stable Diffusion, Tag2Text, BLIP, Whisper 및 ChatBot과 접지 DINO 결합 - 이미지, 텍스트 및 오디오 입력을 사용하여 모든 것을 자동으로 감지, 분할 및 생성합니다.

- AnimateDiff: 특정 조정 없이 개인화된 텍스트-이미지 확산 모델을 애니메이션화합니다.

- BasicSR: 초해상도, 노이즈 제거, 흐림 제거 등을 위한 오픈 소스 이미지 및 비디오 복원 도구 상자. 현재 EDSR, RCAN, SRResNet, SRGAN, ESRGAN, EDVR, BasicVSR, SwinIR, ECBSR 등이 포함되어 있습니다. 또한 StyleGAN2 및 DFDNet도 지원합니다. [](https://github.com/XPixelGroup/ BasicSR)

- Real-ESRGAN: Real-ESRGAN은 일반 이미지/비디오 복원을 위한 실용적인 알고리즘 개발을 목표로 합니다.

- ESRGAN: 향상된 SRGAN. Perceptual Super-Resolution 부문 PIRM 챌린지 챔피언입니다.

- MixNMatch: 조건부 이미지 생성을 위한 다중 요소 분리 및 인코딩.

- Clarity-upscaler: 모든 사람을 위한 이미지 업스케일링을 재구성했습니다.

- 분포 일치 증류로 1 단계 확산

- 보이지 않는 스티치 : 깊이가 피어 팅하여 부드러운 3D 장면을 생성합니다.

- SSR : 고 충실도 모양과 질감을 가진 단일 뷰 3D 장면 재구성.

- Invsr : 확산 반전을 통한 임의의 단계 이미지 초-해상도.

? 탐지?

- Stylegan3- 검출기 : Stylegan3 합성 이미지 감지.

- Stylegan2-Projecting-Images : STYLEGAN2와 함께 잠재적 인 공간에 이미지를 투사합니다.

- Faldetector : Photoshop을 스크립팅하여 Photoshopped Faces를 감지합니다.

? 동영상 ?

도구

- DeepFacelab : DeepFacelab은 DeepFakes를 만드는 주요 소프트웨어입니다.

- FACESWAP : 모두를위한 DeepFakes 소프트웨어.

- DOT : Deepfake 공격 툴킷.

- SIMSWAP : 단일 훈련 된 모델이있는 이미지 및 비디오의 임의의 얼굴 스웨이핑 프레임 워크!

- FACESWAP-GAN : FACE SWAPPEN을위한 비난자가 인코더 + 적대적 손실 및주의 메커니즘.

- Celeb DeepfakeForensics : Deepfake Forensics를위한 대규모 도전적인 데이터 세트.

- Vgen : 확산 모델에 대한 비디오 생성 건물을위한 전체적인 비디오 생성 생태계.

- Musev : 시각적 조건 병렬 페노이징을 가진 무한한 길이 및 고 충실도 가상 휴먼 비디오 생성.

- GLEE : 이미지 및 비디오를위한 일반 객체 기초 모델.

- T-Rex : 텍스트 시각 프롬프트 시너지를 통한 일반 객체 감지를 향해.

- Dynamicrafter : 비디오 확산 사전으로 오픈 도메인 이미지를 애니메이션합니다.

- Mora : 일반 비디오 세대를 위해 Sora와 비슷합니다.

응용

- Face2face-demo : 얼굴 랜드 마크에서 배우고 이것을 얼굴로 번역하는 pix2pix 데모.

- faceswap-deepfake-pytorch : pytorch가있는 페이스 웨이 또는 Pytorch와의 깊이.

- Point-E : 3D 모델 합성을위한 포인트 클라우드 확산.

- EGVSR : 효율적이고 제네릭 비디오 수퍼 레벨.

- STIT : 정시에 스티치 : 실제 비디오의 Gan 기반 얼굴 편집.

- BackgroundMattingv2 : 실시간 고해상도 배경 매트.

- MODNET : TRIMAP-FREE Portrait Matting 솔루션의 실시간.

- 배경 매개 : 배경 매트 : 세상은 녹색 화면입니다.

- 첫 번째 주문 모델 :이 저장소에는 이미지 애니메이션에 대한 논문 1 차 모션 모델의 소스 코드가 포함되어 있습니다.

- 명료 한 애니메이션 :이 저장소에는 관절 애니메이션에 대한 CVPR'2021 용지 모션 표현의 소스 코드가 포함되어 있습니다.

- 실시간 사람 제거 : 웹 브라우저에서 tensorflow.js를 사용하여 복잡한 배경에서 사람들을 실시간으로 제거합니다.

- Adain 스타일 : 적응 형 인스턴스 정규화로 실시간으로 임의의 스타일 전송.

- 프레임 보간 : 큰 움직임을위한 프레임 보간.

- 굉장한 이미지 색상화 : 딥 러닝 기반 이미지 색상화 및 비디오 색상화 용지 모음.

- Sadtalker : 양식화 된 오디오 중심의 단일 이미지 토킹 얼굴 애니메이션에 대한 현실적인 3D 모션 계수 학습.

- Roop : 한 번의 클릭 딥 파이크 (페이스 스왑).

- STABLEVIDEO : 텍스트 중심의 일관성 인식 확산 비디오 편집.

- Magicedit : 고 충실도 시간 일관성 비디오 편집.

- Rerender_A_VIDEO : 제로 샷 텍스트 유도 비디오-비디오-비디오-비디오 번역.

- Dreameditor : 신경 필드가있는 텍스트 중심 3D 장면 편집.

- Dreameditor : 4K 해상도에서 실시간 4D 뷰 합성.

- AnimateAnyone : 캐릭터 애니메이션을위한 일관되고 제어 가능한 이미지 간 비디오 합성.

- Moore-Animateanyone :이 저장소는 Animateanyone을 재현합니다.

- Audio2Photoreal : 오디오에서 광도 실시 예 : 대화에서 인간 합성.

- MagicVideo-V2 : 다단계가 높은 비디오 생성

- LWM : 일반적인 대규모 대규모 텍스트 멀티 모드 자동 회귀 모델. Ringattention을 사용하여 다양한 긴 비디오 및 책의 대규모 데이터 세트에 대해 교육을 받았으며 언어, 이미지 및 비디오 이해 및 생성을 수행 할 수 있습니다.

- Aniportrait : 사진 초상화 애니메이션의 오디오 구동 합성.

- 챔피언 : 3D 파라 메트릭 지침을 갖춘 제어 가능하고 일관된 휴먼 이미지 애니메이션.

- StreamV2V : 기능 뱅크와 함께 비디오 대 비디오 변환을 스트리밍합니다.

- 심도있는 캠 : 실시간 얼굴 스왑 및 단일 이미지 만 사용하여 한 번의 클릭 비디오 딥 파이크.

- 사피엔스 : 인간 비전 모델을위한 기초.

? 탐지?

- FaceForensics ++ : FaceForensics 데이터 세트.

- Deepfake 감지 : 실제로 작동하는 Deepfake 탐지를 향해.

- 가짜 Videoforensics : Deep Fakes 비디오를 감지하십시오.

- Deepfake 감지 : FaceForensics ++를 기반으로 한 Deepfake 탐지의 Pytorch 구현.

- Seqdeepfake : Seqdeepfake 용 Pytorch 코드 : 순차적 딥 파이크 조작 감지 및 복구.

- PCL-I2G : 비공식 구현 : 심해 탐지를위한 자기 일관성 학습.

- DFDC Deepfake Challenge : DFDC 챌린지를위한 상을 수상한 솔루션.

- poi-forensics : 시청각-관찰자의 관심사 심해 탐지.

- DeepFakes의 탐지 표준화 : 전문가가 그것이 중요하다고 말하는 이유

- 심해를 발견하고 싶습니까? 눈에 별을 찾으십시오

? 텍스트 ?

도구

- GLM-130B : 개방형 이중 언어 미리 훈련 된 모델.

- LongtermchatexternalSources : 장기 메모리 및 외부 소스가있는 GPT-3 챗봇.

- 스케치 : 데이터 컨텐츠를 이해하는 AI 코드 작성 어시스턴트.

- LANGCHAIN : COMPOSABLITY를 통한 LLMS로 응용 프로그램을 구축합니다.

- Chatgpt Wrapper : Python 및 From Shell을 사용하여 Chatgpt와 상호 작용하기위한 API.

- OpenAi-Python : OpenAI Python 라이브러리는 파이썬 언어로 작성된 응용 프로그램에서 OpenAI API에 편리하게 액세스 할 수 있습니다.

- 베토 : 스페인 버전의 버트 모델.

- GPT-CODE-CLIPPY : GPT-CODE-CLIPPY (GPT-CC)는 GPT-3을 기반으로 한 언어 모델 인 GitHub Copilot의 오픈 소스 버전입니다.

- GPT NEO : Mesh-Tensorflow 라이브러리를 사용하여 모델 병렬 GPT-2 및 GPT-3 스타일 모델의 구현.

- CTRL : 제어 가능한 생성을위한 조건부 변압기 언어 모델.

- 라마 : 라마 모델에 대한 추론 코드.

- llama2

- 라마 가드 3

- UL2 20B : 오픈 소스 통합 언어 학습자

- BURGPT : OpenAI의 GPT를 통합하여 고도로 맞춤형 취약점을 발견하기위한 추가 수동 스캔을 수행하고 모든 유형의 트래픽 기반 분석을 실행할 수있는 BURP 제품군 확장.

- Ollama : Llama 2 및 기타 대형 언어 모델을 현지에서 일어나서 달리기.

- SneakyPrompt : 탈옥 텍스트-이미지 생성 모델.

- Coplot-for Security : 기계 속도와 규모에서 보안 결과를 향상시키기 위해 수비수의 효율성과 기능을 향상시키는 데 도움이되는 생성 AI 기반 보안 솔루션은 책임있는 AI 원칙을 준수합니다.

- LM Studio : 현지 LLM을 발견, 다운로드 및 실행하십시오

- 우회 GPT : AI 텍스트를 사람과 같은 내용으로 변환하십시오

- MGM : 프레임 워크는 이미지 이해, 추론 및 세대와 함께 2B에서 34B까지 일련의 조밀하고 MOE 대형 언어 모델 (LLM)을 지원합니다.

- Secret Llama : 서버가 필요없는 브라우저로 전적으로 실행되는 완전 개인 LLM 챗봇. Mistral과 Llama 3을 지원합니다.

- llama3 : 공식 메타 라마 3 Github 사이트.

? 탐지?

- 가짜 텍스트 감지 : 거대한 언어 모델 테스트 실.

- 그로버 : 신경 가짜 뉴스에 대한 방어 코드.

- Rebuff.ai : 프롬프트 주입 감지기.

- AI 작성 텍스트를 표시하기위한 새로운 AI 분류기

- AI 생성 텍스트를 감지하는 4 가지 마법의 방법을 발견하십시오 (ChatGpt 포함)

- gptzero

- AI 컨텐츠 감지기 (베타)

- 큰 언어 모델을위한 워터 마크

- AI 생성 텍스트를 안정적으로 감지 할 수 있습니까?

- GPT 탐지기는 비 원어민 영어 작가에 대해 편향되어 있습니다

- chatgpt에, 또는 채팅을하지 않으면 : 그것이 질문입니다!

- 언어 학자들이 Chatgpt/AI와 인간 작문을 구별 할 수 있습니까? : 연구 윤리 및 학술 출판 연구

- chatgpt는 헛소리입니다

응용

- 필기 : 필기는 필기 샘플을 기반으로 사용자 정의 글꼴을 생성합니다.

- GPT 샌드 박스 :이 프로젝트의 목표는 사용자가 몇 줄의 파이썬으로 새로 출시 된 OpenAI GPT-3 API를 사용하여 멋진 웹 데모를 만들 수 있도록하는 것입니다.

- Passgan : 암호 추측을위한 딥 러닝 접근법.

- GPT 인덱스 : GPT 인덱스는 LLM과 함께 대형 외부 지식 기반을보다 쉽게 사용할 수 있도록 설계된 일련의 데이터 구조로 구성된 프로젝트입니다.

- NANOGPT : 교육/미세 조정 중간 크기의 GPT를위한 가장 간단하고 빠른 저장소.

- whatsapp-gpt

- Chatgpt Chrome 확장 : Chatgpt Chrome 확장. 인터넷의 모든 텍스트 상자에 chatgpt를 통합합니다.

- UNILM : 작업, 언어 및 양식에 걸친 대규모 자체 감독 사전 훈련.

- Mingpt : Openai GPT (생성 사전 변압기) 훈련의 최소 Pytorch 재 구현.

- CodeGeex : 열린 다국어 코드 생성 모델.

- Openai Cookbook : OpenAI API 사용의 예와 안내서.

- ? Awesome Chatgpt Prompts :이 리포지기에는 Chatgpt Promp Curation이 포함되어 Chatgpt를 더 잘 사용할 수 있습니다.

- Alice : Chatgpt에게 실제 터미널에 액세스 할 수 있습니다.

- chatgpt를 통한 보안 코드 검토

- 사용자는 AI 보조원으로 더 불안한 코드를 작성합니까?

- Gmail의 스팸 필터를 Chatgpt로 우회합니다

- IoT 비밀번호 보안 향상을위한 반복 GANS 비밀번호 크래커

- PentestGpt : GPT에 강화 된 침투 테스트 도구.

- GPT 연구원 : 주어진 주제에 대한 온라인 포괄적 인 연구를 수행하는 GPT 기반 자율 에이전트.

- GPT 엔지니어 : 구축하려는 내용을 지정하고 AI가 설명을 요청한 다음 빌드합니다.

- LocalPilot : 한 클릭으로 MacBook에서 로컬로 Github Copilot을 사용하십시오!

- [wormgpt])) (https://thehackernews.com/2023/07/wormgpt-new-ai-tool-allows.html) : 새로운 AI 도구 사이버 범죄자가 정교한 사이버 공격을 시작할 수 있습니다.

- Poisongpt : 가짜 뉴스를 전파하기 위해 얼굴을 포옹하는 LLM을 숨기는 방법

- PassGpt : 대형 언어 모델로 비밀번호 모델링 및 (안내) 생성

- DeepPass - 딥 러닝으로 암호 찾기

- GPTFUZZ :자가 생성 된 탈옥 프롬프트와 함께 대형 언어 모델을 사용하는 레드 팀.

- Open 통역사 : 터미널에서 OpenAi의 코드 통역사, 로컬로 실행됩니다.

- 유레카 : 대형 언어 모델을 코딩하여 인간 수준의 보상 설계.

- 메타 클립 : 클립 데이터를 탈취합니다.

- LLM OSINT : LLM을 사용하여 인터넷에서 정보를 수집 한 다음이 정보로 작업을 수행하는 개념 증명 방법.

- HackingBuddyGpt : LLMS X Pentesting.

- Chatgpt-Jailbreaks : Chatgpt의 공식 탈옥 (GPT-3.5). Chatgpt와 대화가 시작될 때 긴 메시지를 보내어 영어와 이탈리아어로 불쾌하고 비 윤리적이며 공격적이며 인간 같은 답변을 얻으십시오.

- Magika : 딥 러닝으로 파일 콘텐츠 유형을 감지합니다.

- Jan : 컴퓨터에서 100% 오프라인으로 실행되는 Chatgpt의 오픈 소스 대안.

- librechat : 향상된 채팅 클론 : OpenAi, Assistants API, Azure, Groq, GPT-4 Vision, Mistral, Bing, Anthropic, Openrouter, Vertex AI, Gemini, AI 모델 스위칭, 메시지 검색, Langchain, Dall-E-3, Chatgpt 플러그인, OpenAI 기능, 보안 멀티 사용자 시스템, 사전 설정, 자조 주최를위한 완전히 오픈 소스.

- Lumina-T2X : 모든 양식 생성에 대한 텍스트를위한 통합 프레임 워크.

기타

- 멋진 GPT + 보안 : LLM 또는 GPT를 사용한 멋진 보안 도구, 실험 사례 또는 기타 흥미로운 것들.

- 사이버 보안을위한 멋진 강화 학습 : 사이버 보안에 적용되는 강화 학습에 전념하는 선별 된 자원 목록.

- 사이버 보안을위한 멋진 머신 러닝 : 사이버 보안을위한 머신 러닝 사용과 관련된 놀랍도록 멋진 도구 및 리소스의 선별 된 목록.

- 포옹 얼굴 확산 모델 코스 : 포옹 얼굴 확산 모델 코스 코스.

- Awesome-IA-Security : AI 보안 리소스의 선별 된 목록.

- 해커 용 ML : "해커를위한 머신 러닝"책과 함께 코드.

- 끔찍한 AI : 끔찍한 AI는 AI의 현재 무서운 사용을 추적하는 선별 된 목록입니다. 인식을 높이기를 희망합니다.

- NIST AI 위험 관리 프레임 워크 플레이 북

- Sok : 컴퓨터 보안 애플리케이션을위한 설명 가능한 기계 학습

- 누가 평가자를 평가합니까? AI 기반 공격 코드 생성기를 평가하기위한 자동 메트릭

- 취약성 우선 순위 : 공격적인 보안 접근

- Miter Atlas ™ (인공 지능 시스템을위한 대적 위협 환경)

- 자율 주행에 대한 응용 프로그램을 통한 강화 학습 보안에 대한 설문 조사

- 머신 러닝 함정을 피하는 방법 : 학술 연구자를위한 안내서

- AI 보안 및 개인 정보 보호 이벤트의 선별 된 목록

- NIST AI 100-2 E2023 : 대적 기계 학습. 공격과 완화의 분류 및 용어.

- ?? Rootedcon 2023 -Inteligencia 인공 Ofensiva -¿ Cómo Podemos Estar reparados?

- AI 시스템의 보안 : 기본 - 대적 딥 러닝

- 보호 조치 너머 : Chatgpt의 보안 위험 탐색

- AI 공격 표면 맵 v1.0

- 대형 AI 모델의 불가능한 안전성

- 프론티어 AI 규정 : 공공 안전에 대한 새로운 위험 관리

- AI를위한 좋은 사이버 보안 관행을위한 다층 프레임 워크

- Google의 보안 AI 프레임 워크를 소개합니다

- LLM의 경우 OWASP TOP 10

- Awesome LLM 보안 : LLM 보안에 대한 멋진 도구, 문서 및 프로젝트의 큐 레이션.

- 회사에서 LLM을 안전하게 사용하는 프레임 워크. 1 부 : 위험 개요. 2 부 : 위험 관리. 파트 3 : chatgpt 및 github copilot 보안.

- 대형 언어 모델 코드 생성의 견고성 및 신뢰성에 관한 연구

- SynthID로 AI 생성 이미지를 식별합니다

- 큰 언어 모델 감사 : 3 층 접근 방식

- 단기 대 장기 AI 위험의 전투 해결

- 사기 GPT : Chatgpt의 악당 아바타

- AI 위험 - Schneier on Security

- 불법 목적으로 LLM 사용 : 위협, 예방 조치 및 취약점

- AI Red-Teaming은 AI Harms에 대한 원 스톱 솔루션이 아닙니다 : AI 책임을 위해 Red-Teaming을 사용하기위한 권장 사항

- 인공 지능에 대한 신뢰성의 분류

- 빠른 발전 시대에 AI 위험 관리

- Google- 안전하고 안전한 AI에 대한 우리의 약속에 따라

- 공격적인 ML 플레이 북

- 생성 AI를 탈취 시켰습니까? 보안 연구원의 메모

- Genai-Security-Adventures : Jupyter Notebooks에 제시된 메모, 프리젠 테이션 및 다양한 실험 모음을 공유하기위한 오픈 소스 이니셔티브. 모두 대형 언어 모델의 필수 개념을 파악하고 보안 및 자연스러운 자연의 흥미로운 교차점을 탐구하는 데 도움이됩니다. 언어 처리.

- AI Safety Camp는 프로젝트에 대해 협력 할 수 있도록 연구와 연결합니다. 미래의 AI가 안전 할 수 있도록 작업이 어디에 있는지 확인하십시오.

- 안전한 AI 시스템 개발에 대한 지침

- 인공 지능 및 사이버 보안에 대한 접근. 모범 사례 보고서

- Stanford 안전하고 안전하며 신뢰할 수있는 AI EO 14110 추적기

- Awesome ML Security : 멋진 머신 러닝 보안 참조, 지침, 도구 등의 선별 된 목록.

- AI의 예측 가능한 경로 : 2024 년 AI에서 기대할 7 가지

- 인공 지능과 사이버 보안 (스페인어로 ??)

- 경계 : 프롬프트 주사, 탈옥 및 기타 잠재적으로 위험한 큰 언어 모델 (LLM) 입력을 감지합니다.

- 생성 AI 모델 - 산업 및 당국의 기회 및 위험

- AI 시스템을 안전하게 배포합니다. 안전하고 탄력적 인 AI 시스템을 배포하기위한 모범 사례

- NIST AI 600-1 : 인공 지능 위험 관리 프레임 워크 : 생성 인공 지능 프로필

- ?? ANSSI : 권장 and de sécurité pour un système d 'ia générative (생성 AI 시스템에 대한 보안 권장 사항)

- PYRIT : 생성 AI (Python Risk Identification Tool for Generative AI)는 보안 전문가와 기계 학습 엔지니어가 생성 AI 시스템에서 사전에 위험을 찾을 수있는 공개 액세스 자동화 프레임 워크입니다.

- OWASP-AGENTIC-AI : 에이전트 AI (AI 에이전트 보안)의 OWASP Top 10을 만들기 위해 노력합니다.

- 보장 된 안전 AI : 강력하고 신뢰할 수있는 AI 시스템을 보장하기위한 프레임 워크

- 실제 AI 위험을 정의합니다

- 생성 AI에 대한 안전한 접근

- 사이버 보안의 큰 언어 모델

- 이봐, 그게 내 모델이야! LLM 지문 기술 인 Chain & Hash 소개

- 생성 AI 오용 : 실제 데이터의 전술 및 통찰력의 분류

- AI 위험 저장소

- AI Red-Teaming 재 방문

- AI 프로그래밍 어시스턴트 사용을위한 독일-프랑스 권장 사항

- 큰 언어 모델 출력을 식별하기위한 확장 가능한 워터 마킹

설문조사

- 조직에 대한 공격적인 AI의 위협

- 사이버 영역의 인공 지능 : 공격 및 방어

- 대적 공격 및 방어에 대한 설문 조사

- 적대적 딥 러닝 : 이미지 분류에 대한 적대적 공격 및 방어 메커니즘에 대한 설문 조사

- 머신 러닝에서의 개인 정보 공격 조사

- 딥 러닝 시스템의 보안 위협으로 : 설문 조사

- 머신 러닝의 보안 위협 및 방어 기술에 대한 설문 조사 : 데이터 중심 관점

- Sok : 기계 학습의 보안 및 개인 정보

- 적대적 기계 학습 : AI 지원 범죄의 증가와 스팸 필터 회피에서의 역할

- 기계 학습 기반 시스템의 위협, 취약성 및 제어 : 설문 조사 및 분류법

- 대적 공격 및 방어 : 설문 조사

- 보안 문제 : 대적 기계 학습에 대한 설문 조사

- 맬웨어 분석을위한 대적 공격에 대한 설문 조사

- 이미지 분류의 적대 머신 학습 : 수비수의 관점에 대한 설문 조사

- 패턴 인식에 대한 강력한 대적 훈련에 대한 조사 : 기본, 이론 및 방법론

- 대형 언어 모델의 개인 정보 : 공격, 방어 및 미래 방향

? 관리자?

미구엘 에르난데스 |

José Ignacio Escribano |

© ️ 라이센스 © 슬 라이센스

- Creative Commons Attribution-Share alkike 4.0 International