Este é um AI Voice Assistant baseado em grandes modelos de linguagem. Um usuário pode interagir com o Voice Assistant em linguagem natural, atualmente inglês.

A implementação reúne vários modelos de aprendizagem profunda:

O módulo de fala faz interface com o microfone local para criar transcrição ao vivo por meio de um processo VAD. Uma transcrição é enviada ao LLM escolhido para processamento com base nas palavras de ativação.

Depois que o LLM gera uma resposta, o módulo de fala também salva o arquivo de áudio e gera uma saída de fala usando um modelo TTS.

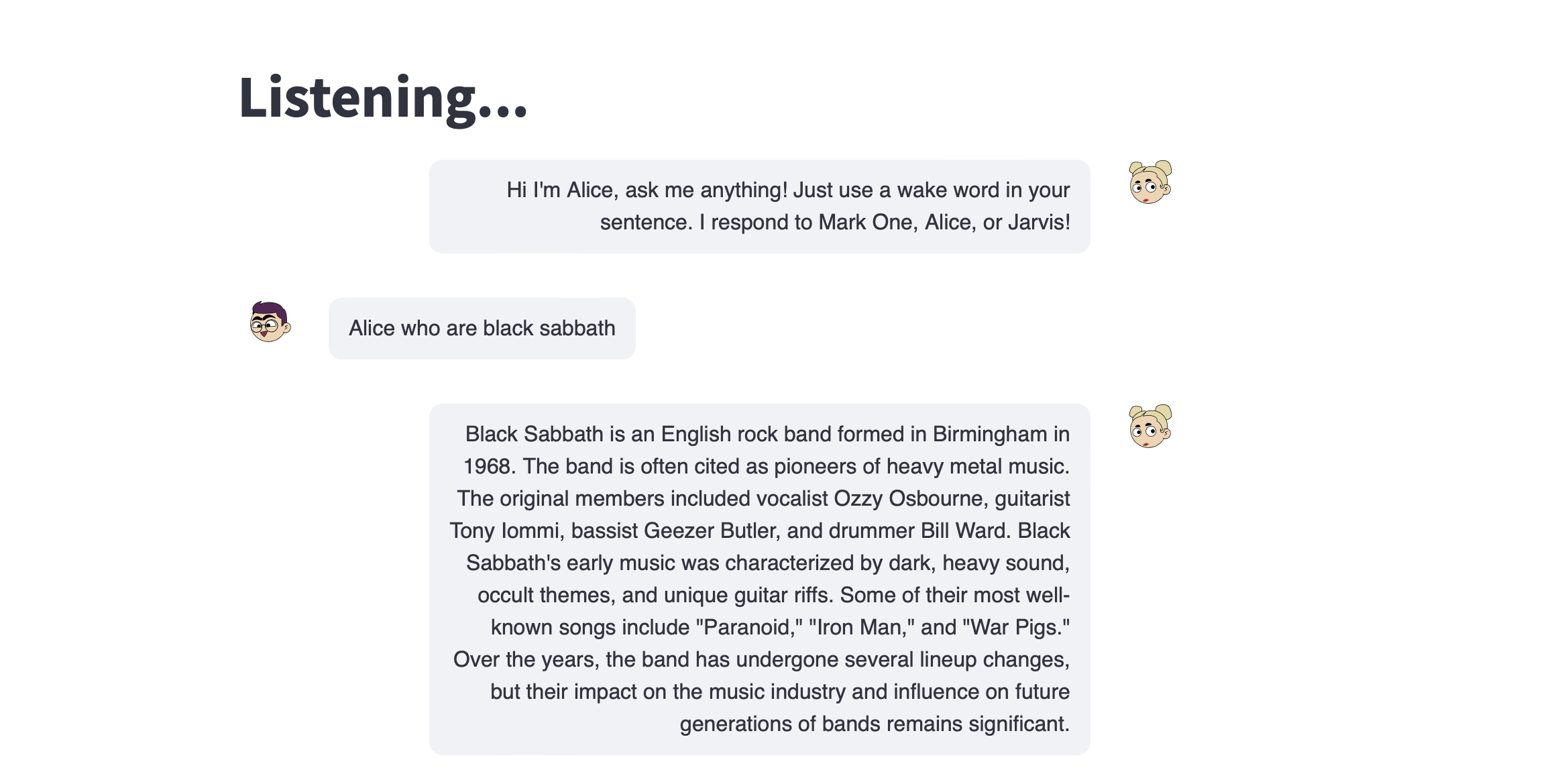

A interface do usuário é construída usando Streamlit e oferece uma experiência familiar semelhante a um bate-papo.

Instalar dependências do projeto

pip install -r requirements

Se estiver usando modelos GPT, crie um arquivo .env com variáveis de ambiente para OPENAI_API_KEY e OPENAI_API_BASE .