llm agent

1.0.0

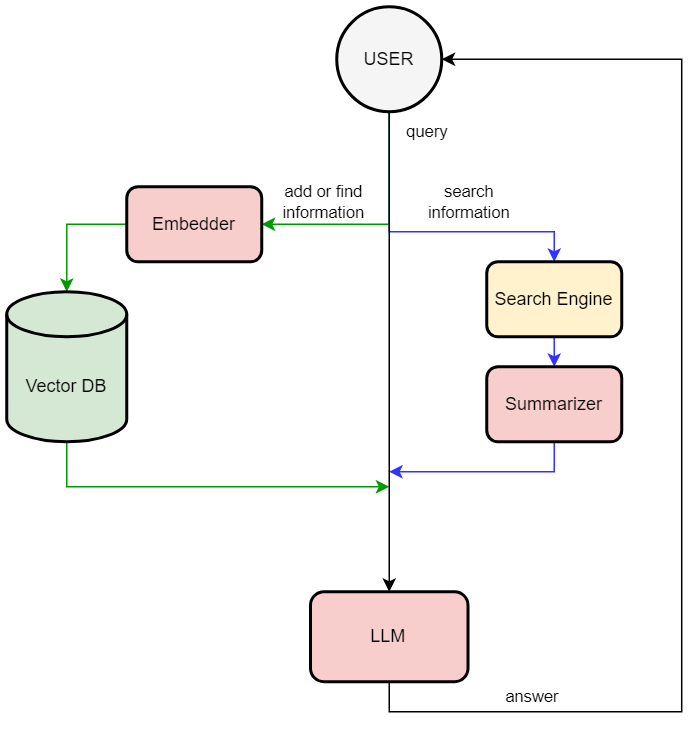

LLM на основе RAG с использованием долговременной памяти через векторную базу данных

Этот репозиторий позволяет большой языковой модели использовать долговременную память через векторную базу данных (этот метод называется RAG (Retrival Augmented Generation) — это метод, который позволяет LLM извлекать факты из внешней базы данных). Приложение создано с использованием mistral-7b-instruct-v0.2.Q4_K_M.gguf (с использованием привязки LLAMA_cpp_python) и chromadb. Пользователь может на естественном языке попросить добавить информацию в базу данных, найти информацию в базе данных или в Интернете, используя руководство.

You > Hi

LOG: [Response]

Bot < Hello! How can I assist you today?

You > Please add information to db "The user name is Rustam Akimov"

LOG: [Adding to memory]

Bot < Done!

You > Can you find on the Internet who is Pavel Durov

LOG: [Extracting question]

LOG: [Searching]

LOG: [Summarizing]

Bot < According to the search results provided, Pavel Durov is a Russian entrepreneur who co-founded Telegram Messenger Inc.

You > Please find information in db who is Rustam Akimov

LOG: [Extracting question]

LOG: [Querying memory]

Bot < According to the input memories, your name is Rustam Akimov.