DeveloperGPT คือเครื่องมือบรรทัดคำสั่งที่ขับเคลื่อนด้วย LLM ซึ่งช่วยให้สามารถใช้ภาษาธรรมชาติกับคำสั่งเทอร์มินัลและการแชทในเทอร์มินัลได้ DeveloperGPT ขับเคลื่อนโดย Google Gemini 1.5 Flash เป็นค่าเริ่มต้น แต่ยังรองรับ Google Gemini 1.0 Pro, OpenAI GPT-3.5 & GPT-4, Anthropic Claude 3 Haiku & Sonnet, LLM แบบเปิด (Zephyr, Gemma, Mistral) ที่โฮสต์บน Hugging Face และวัดปริมาณ Mistral-7B-สั่งให้ทำงานออฟไลน์บนอุปกรณ์

ณ เดือนมิถุนายน 2024 DeveloperGPT ใช้งานได้ฟรีโดยสมบูรณ์เมื่อใช้ Google Gemini 1.5 Pro (ใช้เป็นค่าเริ่มต้น) หรือ Google Gemini 1.0 Pro ที่คำขอสูงสุด 15 รายการต่อนาที

สลับระหว่าง LLM ที่แตกต่างกันโดยใช้ --model flag: developergpt --model [llm_name] [cmd, chat]

| โมเดล | แหล่งที่มา | รายละเอียด |

|---|---|---|

| ราศีเมถุน Pro , ราศีเมถุนแฟลช (ค่าเริ่มต้น) | Google Gemini 1.0 Pro, Gemini 1.5 แฟลช | ฟรี (สูงสุด 15 คำขอ/นาที) ต้องใช้คีย์ Google AI API |

| GPT35, GPT4 | OpenAI | จ่ายต่อการใช้งาน ต้องใช้คีย์ OpenAI API |

| ไฮกุ, ซอนเน็ต | มานุษยวิทยา (Claude 3) | ต้องใช้คีย์ API แบบจ่ายต่อการใช้งาน |

| เซเฟอร์ | Zephyr7B-เบต้า | ฟรี, Open LLM, Hugging Face Inference API |

| เจมม่า เจมม่า-เบส | Gemma-1.1-7B-สั่งสอน Gemma-Base | ฟรี, Open LLM, Hugging Face Inference API |

| มิสทรัล-Q6, มิสทรัล-Q4 | GGUF Mistral-7B- คำสั่งเชิงปริมาณ | ฟรี เปิด LLM ออฟไลน์ บนอุปกรณ์ |

| มิสทรัล | Mistral-7B-คำสั่ง | ฟรี, Open LLM, Hugging Face Inference API |

mistral-q6 และ mistral-q4 เป็น Quantized GGUF Mistral-7B-Instruct LLM ที่ทำงานภายในอุปกรณ์โดยใช้ llama.cpp (โมเดล Q6_K quantized และ Q4_K quantized ตามลำดับ) LLM เหล่านี้สามารถทำงานบนเครื่องที่ไม่มี GPU เฉพาะได้ - ดู llama.cpp สำหรับรายละเอียดเพิ่มเติมDeveloperGPT มี 2 คุณสมบัติหลัก

การใช้งาน: developergpt cmd [your natural language command request]

# Example

$ developergpt cmd list all git commits that contain the word llm

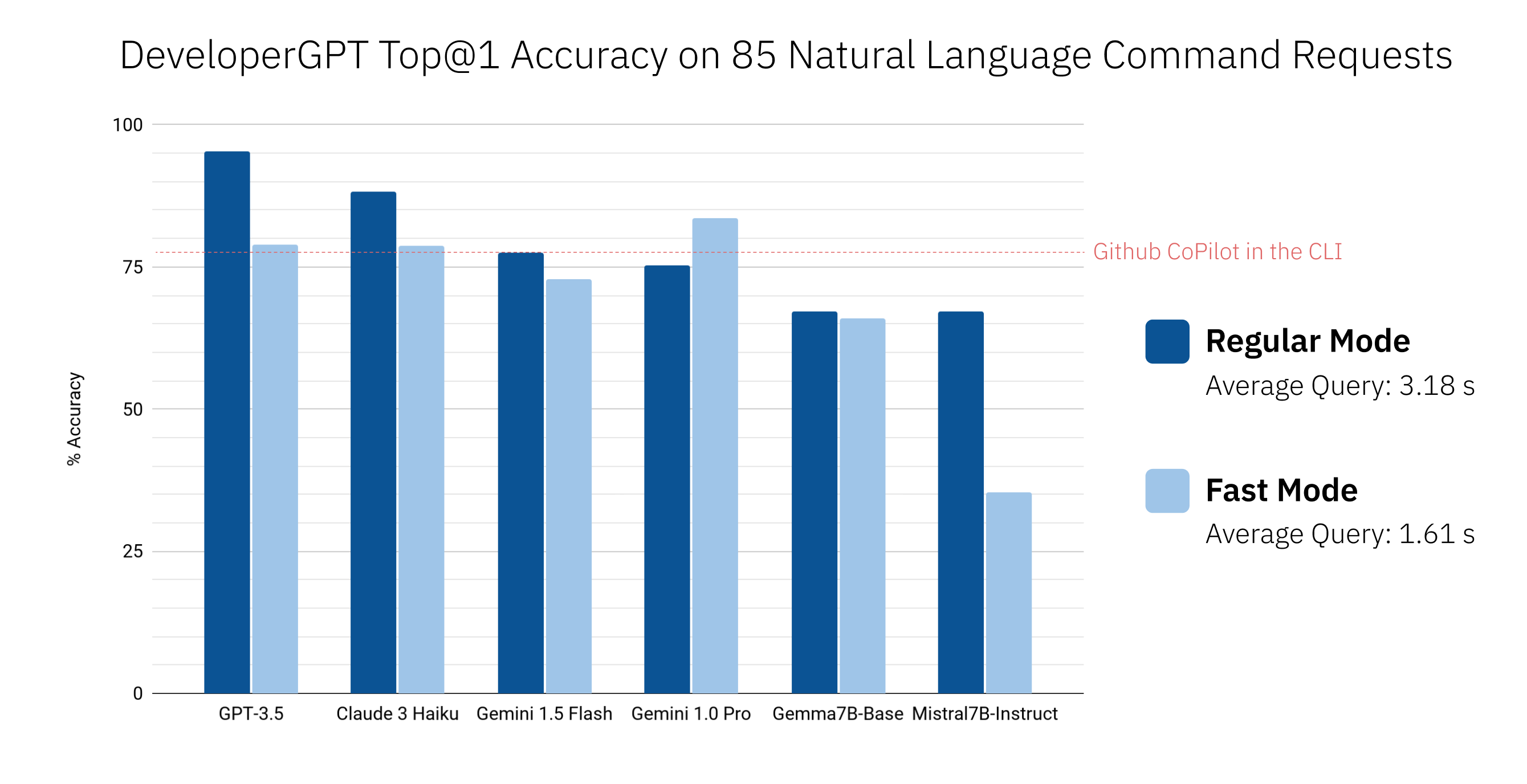

ใช้ developergpt cmd --fast เพื่อรับคำสั่งเร็วขึ้นโดยไม่มีคำอธิบายใด ๆ (~1.6 วินาทีด้วย --fast เทียบกับ ~3.2 วินาทีโดยเฉลี่ยโดยเฉลี่ย) คำสั่งที่จัดทำโดย DeveloperGPT ในโหมด --fast อาจมีความแม่นยำน้อยกว่า - ดู DeveloperGPT Natural Language to Terminal Command Accuracy สำหรับรายละเอียดเพิ่มเติม

# Fast Mode: Commands are given without explanation for faster response

$ developergpt cmd --fast [your natural language command request] ใช้ developergpt --model [model_name] cmd เพื่อใช้ LLM อื่นแทน Gemini Flash (ใช้เป็นค่าเริ่มต้น)

# Example: Natural Language to Terminal Commands using the GPT-3.5 instead of Gemini Flash

$ developergpt --model gpt35 cmd [your natural language command request] การใช้งาน: developergpt chat

# Chat with DeveloperGPT using Gemini 1.5 Flash (default)

$ developergpt chat

ใช้ developergpt --model [model_name] chat เพื่อใช้ LLM อื่น

# Example

$ developergpt --model mistral chatไม่มี การกลั่นกรองแชท - ข้อความแชททั้งหมดของคุณควรเป็นไปตามเงื่อนไขการใช้งานของ LLM ที่ใช้

DeveloperGPT จะ ไม่ ถูกนำมาใช้เพื่อวัตถุประสงค์ใดๆ ที่ถูกห้ามโดยข้อกำหนดการใช้งานของ LLM ที่ใช้ นอกจากนี้ DeveloperGPT เอง (นอกเหนือจาก LLM) เป็นเครื่องมือพิสูจน์แนวคิด และไม่ได้มีวัตถุประสงค์เพื่อใช้สำหรับงานที่จริงจังหรือเชิงพาณิชย์ใดๆ

pip install -U developergpt # see available commands

$ developergpt ความแม่นยำของ DeveloperGPT จะแตกต่างกันไปขึ้นอยู่กับ LLM ที่ใช้และโหมด ( --fast กับ ปกติ) ด้านล่างนี้คือความแม่นยำสูงสุด@1 ของ LLM ต่างๆ ในชุดคำขอคำสั่งภาษาธรรมชาติ 85 รายการ (นี่ไม่ใช่การประเมินที่เข้มงวด แต่ให้ความรู้สึกถึงความแม่นยำโดยคร่าว) Github CoPilot ใน CLI v1.0.1 รวมอยู่ด้วยเพื่อการเปรียบเทียบ

ตามค่าเริ่มต้น DeveloperGPT จะใช้ Google Gemini 1.5 Flash หากต้องการใช้ Gemini 1.0 Pro หรือ Gemini 1.5 Flash คุณจะต้องมีคีย์ API (ใช้ฟรีสูงสุด 15 คำสั่งต่อนาที)

GOOGLE_API_KEY คุณต้องทำสิ่งนี้เพียงครั้งเดียว # set Google API Key (using zsh for example)

$ echo ' export GOOGLE_API_KEY=[your_key_here] ' >> ~ /.zshenv

# reload the environment (or just quit and open a new terminal)

$ source ~ /.zshenv หากต้องการใช้ LLM แบบเปิด เช่น Gemma หรือ Mistral ที่โฮสต์บน Hugging Face คุณสามารถเลือกตั้งค่าโทเค็น Hugging Face Inference API เป็นตัวแปรสภาพแวดล้อม HUGGING_FACE_API_KEY ได้ ดู https://huggingface.co/docs/api-inference/index สำหรับรายละเอียดเพิ่มเติม

หากต้องการใช้ Mistral-7B-Instruct เชิงปริมาณ เพียงเรียกใช้ DeveloperGPT ด้วยแฟล็ก --offline การดำเนินการนี้จะดาวน์โหลดโมเดลในการรันครั้งแรกและใช้งานภายในเครื่องในการรันในอนาคต (ไม่จำเป็นต้องเชื่อมต่ออินเทอร์เน็ตหลังจากการใช้งานครั้งแรก) ไม่จำเป็นต้องตั้งค่าพิเศษ

developergpt --offline chatหากต้องการใช้ GPT-3.5 หรือ GPT-4 คุณจะต้องมีคีย์ OpenAI API

OPENAI_API_KEY คุณต้องทำสิ่งนี้เพียงครั้งเดียว หากต้องการใช้ Anthropic Claude 3 Sonnet หรือ Haiku คุณจะต้องมีคีย์ Anthropic API

ANTHROPIC_API_KEY คุณต้องทำสิ่งนี้เพียงครั้งเดียวตั้งแต่เดือนมิถุนายน 2024 Google Gemini 1.0 Pro และ Gemini 1.5 Flash สามารถใช้คำค้นหาได้ฟรีสูงสุด 15 รายการต่อนาที สำหรับข้อมูลเพิ่มเติม โปรดดู: https://ai.google.dev/pricing

ตั้งแต่เดือนมิถุนายน 2024 การใช้ Hugging Face Inference API ที่โฮสต์ LLM นั้นฟรี แต่มีอัตราจำกัด ดู https://huggingface.co/docs/api-inference/index สำหรับรายละเอียดเพิ่มเติม

Mistral-7B-Instruct ใช้งานได้ฟรีและทำงานบนอุปกรณ์

คุณสามารถตรวจสอบการใช้งาน OpenAI API ของคุณได้ที่นี่: https://platform.openai.com/account/usage ราคาเฉลี่ยต่อการสืบค้นโดยใช้ GPT-3.5 คือ < 0.1 เซนต์ ไม่แนะนำให้ใช้ GPT-4 เนื่องจาก GPT-3.5 คุ้มค่ากว่ามาก และให้ความแม่นยำสูงมากสำหรับคำสั่งส่วนใหญ่

คุณสามารถตรวจสอบการใช้งาน Anthropic API ได้ที่นี่: https://console.anthropic.com/settings/plans ต้นทุนเฉลี่ยต่อการสืบค้นโดยใช้ Claude 3 Haiku คือ < 0.1 เซนต์ ดู https://www.anthropic.com/api สำหรับรายละเอียดราคา

อ่านไฟล์ CONTRIBUTING.md