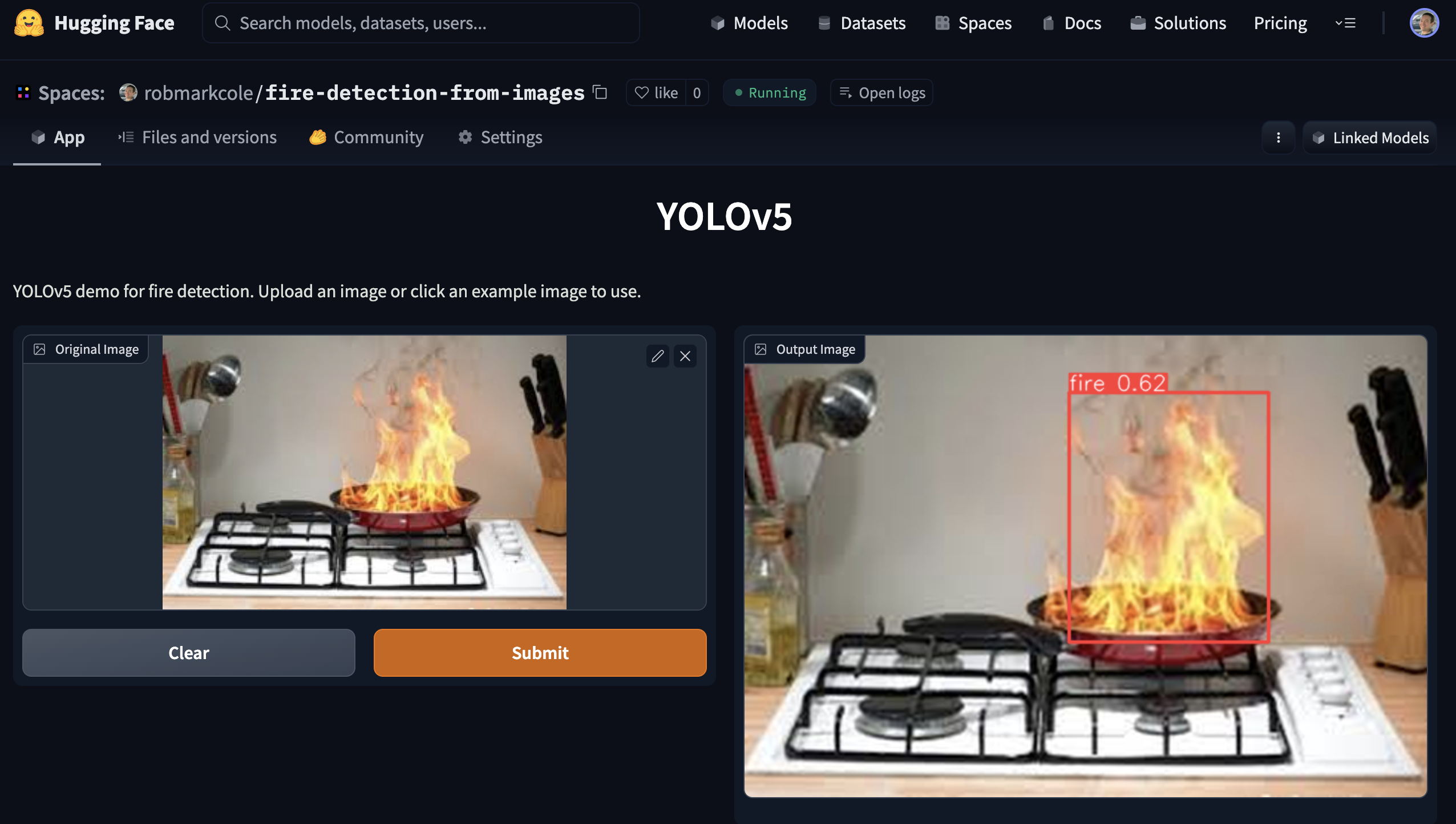

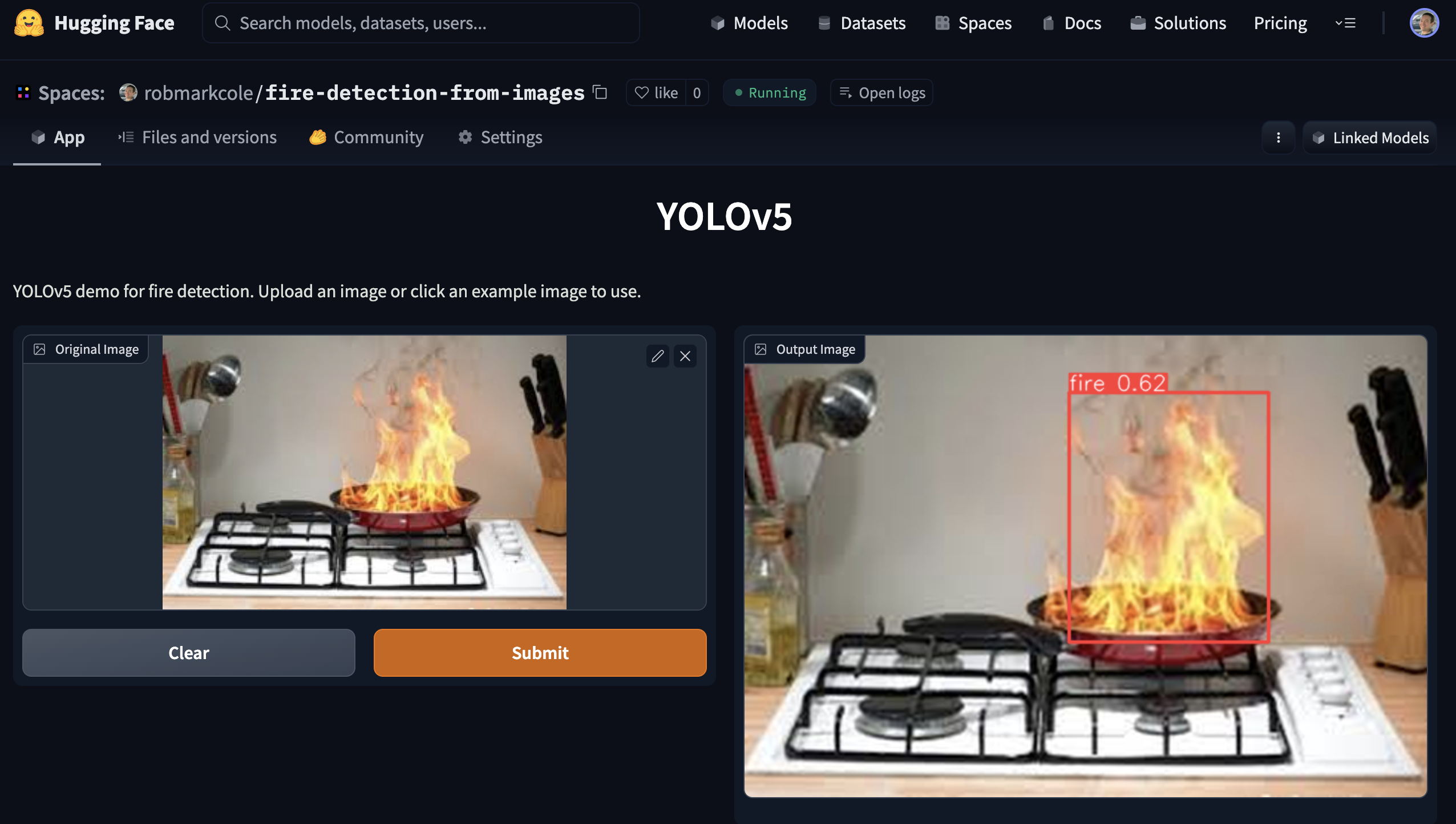

การตรวจจับไฟจากภาพ

วัตถุประสงค์ของการซื้อคืนนี้คือเพื่อสาธิตโมเดลเครือข่ายประสาทตรวจจับไฟ ในการใช้งานโมเดลนี้จะวางกรอบล้อมรอบไฟในภาพ

ผลลัพธ์ที่ดีที่สุด

การตรวจจับวัตถุ: หลังจากทดลองกับสถาปัตยกรรมโมเดลต่างๆ ฉันตัดสินใจเลือกโมเดล Yolov5 pytorch (ดู pytorch/object-detection/yolov5/experiment1/best.pt ) หลังจากการทดลองไม่กี่ชั่วโมง ฉันได้สร้างแบบจำลอง [email protected] ที่ 0.657 ความแม่นยำ 0.6 การเรียกคืน 0.7 ฝึกฝนกับรูปภาพ 1155 รูป (รูปภาพพื้นฐาน 337 รูป + ส่วนเสริม)

การจัดหมวดหมู่: ฉันยังไม่ได้ฝึกโมเดลของตัวเอง แต่มีการรายงานความแม่นยำ 95% โดยใช้ ResNet50

การแบ่งส่วน: ต้องมีคำอธิบายประกอบ

แรงจูงใจและความท้าทาย

เครื่องตรวจจับควันแบบดั้งเดิมทำงานโดยการตรวจจับการมีอยู่ทางกายภาพของอนุภาคควัน อย่างไรก็ตาม อุปกรณ์เหล่านี้มีแนวโน้มที่จะตรวจพบสิ่งที่ผิดพลาด (เช่น จากเครื่องปิ้งขนมปัง) และไม่สามารถระบุตำแหน่งไฟได้ดีเป็นพิเศษ ในสถานการณ์เหล่านี้ โซลูชันกล้องสามารถเสริมเครื่องตรวจจับแบบเดิมได้ เพื่อปรับปรุงเวลาตอบสนองหรือเพื่อให้ตัวชี้วัดเพิ่มเติม เช่น ขนาดและตำแหน่งของเพลิงไหม้ ด้วยการระบุตำแหน่งและลักษณะของไฟ การแทรกแซงอัตโนมัติอาจเป็นไปได้ เช่น ผ่านระบบสปริงเกอร์หรือโดรน นอกจากนี้ยังสามารถส่งข้อมูลไปยังหน่วยดับเพลิงเพื่อให้การตระหนักรู้ในสถานการณ์ที่ไม่มีอยู่จริง สถานที่เฉพาะที่ฉันสนใจ ได้แก่ ห้องครัวและห้องนั่งเล่น โรงรถและอาคารอื่นๆ และพื้นที่ที่อาจเกิดเพลิงไหม้อยู่แล้วแต่ลุกลามออกไปนอกโซนที่ต้องการ เช่น หลุมไฟ

มีคำถามปลายเปิดและความท้าทายที่สำคัญอยู่สองสามข้อ:

- สำหรับโมเดล fast edge สถาปัตยกรรม 'ดีที่สุด' คืออะไร Yolo3 ได้รับความนิยมอย่างมากสำหรับแอปพลิเคชันเชิงพาณิชย์ และสามารถนำไปใช้ใน keras หรือ pytorch ซึ่งเป็นพื้นฐาน Yolov5 เนื่องจากปัจจุบันเป็น SOTA และมีแนวทางการปรับใช้กับ Jetson

- สถาปัตยกรรมสามารถปรับให้เหมาะสมได้หรือไม่เนื่องจากเราตรวจพบเพียงคลาสเดียว

- การตรวจจับวัตถุพื้นฐาน แต่มีประโยชน์ต่อตัวแยกประเภทหรือการแบ่งส่วนหรือไม่ โมเดล Obj ฝึกฝนบน mAP และตัววัด Recall แต่ความแม่นยำของ Bounding Box ของแอปพลิเคชันของเราอาจไม่มีความสำคัญสูงสุดใช่หรือไม่ อย่างไรก็ตาม โมเดลการจัดหมวดหมู่ทำงานได้ดีที่สุดกับช็อตที่สวยงามซึ่งมีเฉพาะวัตถุเป้าหมาย แต่ในสถานการณ์ไฟไหม้ในชีวิตจริง ฉากจะไม่ง่ายเหมือนสถานการณ์นี้

- Tensorflow + ระบบนิเวศของ Google หรือ Pytorch + NVIDIA/MS Tensorflow ทนทุกข์ทรมานจากมรดก tf1

- ควรใช้โมเดล 'ซุปเปอร์' เพียงรุ่นเดียวหรือหลายรุ่นพิเศษ ประเภทของเพลิงไหม้โดยทั่วไป ได้แก่ เปลวเทียน ในร่ม/กลางแจ้ง ยานพาหนะ

- การรวบรวมหรือค้นหาชุดข้อมูลการฝึกอบรมที่ครอบคลุม เป็นตัวแทน และสมดุล

- การจัดการกับมุมมองที่แตกต่างกัน ผู้ผลิตกล้องและการตั้งค่าที่แตกต่างกัน และสภาพแสงโดยรอบที่แตกต่างกัน

- เนื่องจากไฟมีความสว่างมากจนสามารถล้างภาพและทำให้เกิดการรบกวนทางแสงอื่นๆ ได้ จะสามารถชดเชยสิ่งนี้ได้อย่างไร

- เนื่องจากเราคาดหวังว่าโมเดลจะมีข้อจำกัด เราจะทำให้ผลลัพธ์ของโมเดลสามารถตีความได้อย่างไร

- ไฟอาจมีได้หลากหลายขนาด ตั้งแต่เปลวเทียนไปจนถึงไฟที่ลุกลามทั่วทั้งป่า นี่เป็นปัญหาของวัตถุขนาดเล็กและวัตถุขนาดใหญ่หรือไม่ การแยกชุดข้อมูลตามคลาสอัคคีภัยและโมเดลการฝึกสำหรับแต่ละคลาสอาจให้ผลลัพธ์ที่ดีกว่าหรือไม่ ถือว่าเป็นปัญหาการแบ่งเซ็กเมนต์เชิงความหมาย (ต้องมีชุดข้อมูลที่ทำหมายเหตุประกอบใหม่) หรือไม่

ไอเดีย:

- การประมวลผลภาพล่วงหน้า เช่น ลบพื้นหลังหรือใช้ฟิลเตอร์

- การจำแนกลำดับวิดีโอสั้นๆ เนื่องจากการเคลื่อนที่ของไฟมีลักษณะเฉพาะ

- ข้อมูลจำลอง ระบุซอฟต์แวร์ใดๆ ที่สามารถสร้างไฟที่สมจริง และเพิ่มลงในชุดข้อมูลที่มีอยู่

- การเพิ่มเพื่อจำลองเอฟเฟกต์ของกล้องและการตั้งค่าการรับแสงที่แตกต่างกัน

- ระบุคำแนะนำ/กฎหมายที่เกี่ยวข้องเกี่ยวกับความแม่นยำที่จำเป็นของเทคนิคการตรวจจับอัคคีภัย

- รวม RGB + ความร้อนเพื่อระงับผลบวกลวงหรือไม่ เช่นใช้ https://openmv.io/blogs/news/introcing-the-openmv-cam-pure-thermal หรือ grideye หรือ melexsis ที่ถูกกว่า

วิธีการและการใช้เครื่องมือ

- เฟรมจะถูกป้อนผ่านโครงข่ายประสาทเทียม เมื่อตรวจพบผลบวกของตัวชี้วัดไฟจะถูกดึงออกมา ละเว้นควันสำหรับ MVP ลองใช้สถาปัตยกรรมและพารามิเตอร์ต่างๆ เพื่อสร้างแบบจำลองพื้นฐานที่ 'ดี'

- พัฒนาโมเดลที่มีความแม่นยำต่ำแต่รวดเร็วโดยกำหนดเป้าหมายไปที่ RPi และอุปกรณ์เคลื่อนที่ และโมเดลที่มีความแม่นยำสูงซึ่งกำหนดเป้าหมายไปที่อุปกรณ์ GPU เช่น Jetson Yolo นำเสนอทั้งสองตัวเลือก yolo4 lite สำหรับมือถือและ yolo5 สำหรับ GPU อีกทางหนึ่งคือ mobilenet และ tf-object-detection-api ให้ความสำคัญกับรุ่น GPU ที่มีความแม่นยำสูงกว่า

- ใช้ Google Colab ในการฝึกอบรม

บทความและ repos

- Fire_Detection -> ระบบตรวจจับไฟและควันโดยใช้ Jetson nano & Yolov5 พร้อมชุดข้อมูลรูปภาพจาก gettyimages

- YOLOv5 การตรวจจับควันไฟป่าด้วย Roboflow และ Weights & Biases

- Yolov5-Fire-Detection -> โมเดลที่ได้รับการบันทึกไว้อย่างดีซึ่งได้รับการฝึกฝนเกี่ยวกับข้อมูล kaggle

- การตรวจจับไฟและควันด้วย Keras และ Deep Learning โดย pyimagesearch - ชุดข้อมูลที่รวบรวมโดยการคัดลอกรูปภาพของ Google (ให้ลิงก์ไปยังชุดข้อมูลที่มีรูปภาพไฟ 1315 ภาพ) การจำแนกประเภทไฟแบบไบนารี/แบบไม่มีไฟด้วย tf2 & keras sequential CNN บรรลุความแม่นยำ 92% สรุปว่า จำเป็นต้องมีชุดข้อมูลที่ดีกว่า

- การตรวจจับไฟตั้งแต่เริ่มต้นโดยใช้ YOLOv3 - อภิปรายการคำอธิบายประกอบโดยใช้ LabelImg โดยใช้ Google ไดรฟ์และ Colab การปรับใช้ผ่าน Heroku และ ได้แก่ การใช้ Streamlit ที่นี่ ผลงานของ Devdarshan Mishra

- การตรวจจับไฟและปืน -> การตรวจจับไฟและปืนโดยใช้ yolov3 ในวิดีโอและรูปภาพ มีรหัสการฝึกอบรม ชุดข้อมูล และไฟล์น้ำหนักที่ผ่านการฝึกอบรม

- YOLOv3-Cloud-Based-Fire-Detection -> การตรวจจับวัตถุแบบกำหนดเองโดยใช้ YOLOv3 บนคลาวด์ ได้รับการฝึกฝนให้ตรวจจับไฟในเฟรมที่กำหนด ส่วนใหญ่สามารถนำมาใช้สำหรับไฟป่า อุบัติเหตุไฟไหม้ ฯลฯ

- fire-detect-yolov4 -> การฝึกอบรมโมเดล Yolo v4

- midasklr/FireSmokeDetectionByEfficientNet - การจำแนกและการตรวจจับไฟและควันโดยใช้ Efficientnet, Python 3.7、PyTorch1.3 แสดงภาพแผนที่การเปิดใช้งาน รวมถึงสคริปต์การฝึกและการอนุมาน

- arpit-jadon/FireNet-LightWeight-Network-for-Fire-Detection - โมเดลการตรวจจับไฟและควันน้ำหนักเบาแบบพิเศษสำหรับแอปพลิเคชัน IoT แบบเรียลไทม์ (เช่น บน RPi) ความแม่นยำประมาณ 95%. บทความ https://arxiv.org/abs/1905.11922v2

- tobybreckon/fire-detection-cnn - ลิงก์ไปยังชุดข้อมูลสองสามชุด

- EmergencyNet - ระบุเหตุเพลิงไหม้และเหตุฉุกเฉินอื่น ๆ จากโดรน

- การตรวจจับไฟโดยใช้ภาพกล้องวงจรปิด - แอปพลิเคชัน Monk Library - ตัวแยกประเภท keras บนชุดข้อมูล kaggle, mobilenet-v2, Densenet121 และ Ddennet201

- fire-detection-cnn - การตรวจจับพื้นที่พิกเซลไฟในภาพวิดีโอ (หรือภาพนิ่ง) โดยอัตโนมัติภายในขอบเขตแบบเรียลไทม์ ความแม่นยำสูงสุด 0.93 สำหรับการตรวจจับไฟแบบไบนารีทั้งภาพ (1) โดยมีความแม่นยำ 0.89 ภายในกรอบงานการแปลซูเปอร์พิกเซลของเรา

- ระบบการตรวจจับอัคคีภัยล่วงหน้าโดยใช้การเรียนรู้เชิงลึกและ OpenCV - สถาปัตยกรรม InceptionV3 และ CNN ที่ปรับแต่งเองสำหรับการตรวจจับอัคคีภัยในร่มและกลางแจ้ง 980 รูปภาพสำหรับการฝึกและ 239 รูปภาพสำหรับการตรวจสอบ ความแม่นยำในการฝึกอบรม 98.04 และความแม่นยำในการตรวจสอบ 96.43 openCV ใช้สำหรับการตรวจจับสดบนเว็บแคม - โค้ดและชุดข้อมูล (อ้างอิงแล้วที่นี่) บน https://github.com/jackfrost1411/fire- การตรวจจับ

- การตรวจจับควันโดยใช้ Tensorflow 2.2 - EfficientDet-D0, ภาพควันที่มีคำอธิบายประกอบ 733 ภาพ กล่าวถึงในบล็อก Roboflow

- ชุดข้อมูลภาพถ่ายทางอากาศสำหรับการตรวจจับเพลิงไหม้: การจำแนกประเภทและการแบ่งส่วนโดยใช้ยานพาหนะทางอากาศไร้คนขับ (UAV) - ตัวแยกประเภทไบนารี ความแม่นยำ 76% ในชุดทดสอบ

- ระบบตรวจจับไฟป่าตามการเรียนรู้แบบ Ensemble -> ประการแรก ผู้เรียนสองคน Yolov5 และ EfficientDet ได้รับการบูรณาการเพื่อให้กระบวนการตรวจจับไฟบรรลุผลสำเร็จ ประการที่สอง EfficientNet ผู้เรียนแต่ละคนมีหน้าที่รับผิดชอบในการเรียนรู้ข้อมูลทั่วโลกเพื่อหลีกเลี่ยงผลบวกลวง

- ระบบแจ้งเตือนเหตุเพลิงไหม้พร้อมโมเดลการจำแนกประเภทหลายฉลากที่อธิบายโดย GradCAM -> ใช้ CAM เพื่อให้เห็นภาพว่าบริเวณใดของรูปภาพที่รับผิดชอบในการทำนาย และใช้ข้อมูลสังเคราะห์เพื่อเติมคลาสที่ขาดเพื่อทำให้การกระจายคลาสมีความสมดุล

- การฝึกอบรมโมเดล fast.ai และการปรับใช้ผ่านแอป gradio

- Deepfire -> ดำเนินการรับรู้ไฟป่าบน UAV โดยใช้ ResNet50 และ EfficientNetB7

- การตรวจจับควันไฟป่า -> โมเดลเครือข่ายประสาทเทียมแบบ Convolutional ตามสถาปัตยกรรมของ Faster-RCNN สำหรับการตรวจจับควันไฟป่า

- FireNet-LightWeight-Network-for-Fire-Detection -> โมเดลการตรวจจับไฟและควันน้ำหนักเบาแบบพิเศษสำหรับแอปพลิเคชัน IoT แบบเรียลไทม์ด้วยกระดาษ ArXiv

- การวิจัยการตรวจจับควันไฟป่า -> การตรวจจับควันไฟป่าในระยะเริ่มต้นพร้อมกระดาษ

ชุดข้อมูล

- FireNET - ประมาณ ภาพไฟไหม้ 500 ภาพพร้อมกรอบขอบเขตในรูปแบบ pascal voc XML Repo มีโมเดล Yolo3 ที่ผ่านการฝึกอบรมโดยใช้ imageai ประสิทธิภาพที่ไม่รู้จัก อย่างไรก็ตาม รูปภาพขนาดเล็ก โดยเฉลี่ย 275x183 พิกเซล หมายความว่าเครือข่ายต้องเรียนรู้คุณสมบัติพื้นผิวน้อยลง

- การตรวจจับอัคคีภัยจาก CCTV บน Kaggle - รูปภาพและวิดีโอ ภาพจะถูกดึงมาจากวิดีโอ ชุดข้อมูลที่ค่อนข้างเล็ก โดยภาพทั้งหมดที่ถ่ายจากวิดีโอ 3-4 รายการเท่านั้น ค่อนข้างเกี่ยวข้องกับงานปัจจุบันเนื่องจากมีวิดีโอให้ทดสอบ ชุดข้อมูลที่จัดระเบียบสำหรับงานจำแนกประเภทปกติ/ควัน/ไฟ ไม่มีคำอธิบายประกอบแบบ Bounding Box

- cair/Fire-Detection-Image-Dataset - ชุดข้อมูลนี้ประกอบด้วยรูปภาพปกติจำนวนมากและรูปภาพ 111 รูปที่มีไฟ ชุดข้อมูลไม่สมดุลอย่างมากในการตอบสนองสถานการณ์ในโลกแห่งความเป็นจริง รูปภาพมีขนาดพอเหมาะแต่ไม่มีคำอธิบายประกอบ

- ชุดข้อมูลการตรวจจับอัคคีภัย mivia - ประมาณ 30 วิดีโอ

- การตรวจจับควันของ USTC - ลิงก์ไปยังแหล่งต่างๆ ที่ให้วิดีโอเกี่ยวกับควัน

- สามารถดาวน์โหลดชุดข้อมูล fire/not-fire ในบทความ pyimagesearch ได้ โปรดทราบว่ามีภาพฉากไฟไหม้หลายภาพที่ไม่มีไฟจริง แต่มีบ้านไฟไหม้ เป็นต้น

- ชุดข้อมูล FIRE บน Kaggle - ภาพไฟกลางแจ้ง 755 ภาพ และภาพที่ไม่ใช่ไฟ 244 ภาพ รูปภาพมีขนาดพอเหมาะแต่ไม่มีคำอธิบายประกอบ

- ชุดข้อมูลภาพไฟสำหรับการศึกษา Dunnings 2018 - ชุดภาพนิ่ง PNG

- ชุดข้อมูลภาพ Fire Superpixel สำหรับการศึกษา Samarth 2019 - ชุดภาพนิ่ง PNG

- ชุดข้อมูลควันไฟป่า - รูปภาพที่มีคำอธิบายประกอบ 737 รูป (อยู่ในกรอบ)

- ชุดข้อมูลโดย jackfrost1411 -> หลายร้อยภาพจัดเรียงเป็นไฟ/เป็นกลางสำหรับงานการจัดหมวดหมู่ ไม่มีคำอธิบายประกอบแบบมีขอบเขต

- ชุดข้อมูลไฟและควันบน Kaggle -> รูปภาพมากกว่า 7000 ภาพ ประกอบด้วยภาพเปลวไฟเท่านั้น 691 ภาพ ภาพควันเท่านั้น 3721 ภาพ และภาพ {เปลวไฟและควัน} 4207 ภาพ

- ชุดข้อมูลไฟและควันในประเทศ -> ประมาณ รูปภาพที่ไม่ซ้ำใคร 5,000 ภาพ 2 คลาส (ไฟและควัน) คำอธิบายประกอบแบบ Bounding Box รูปแบบ COCO, PASCAL VOC และ YOLO

- ชุดข้อมูลไฟและปืน kaggle

- การตรวจจับไฟป่า -> ชุดข้อมูลโดย PerceptiLabs รูปภาพขนาด 250x250 พิกเซลที่แสดงฉากปกติและฉากที่มีไฟ พร้อมบทความ. เป็นชุดข้อมูลจาก kaggle

- DFireDataset -> ชุดข้อมูลรูปภาพสำหรับการตรวจจับไฟและควัน

ข้อมูลอ้างอิงด้านความปลอดภัยจากอัคคีภัย

- ค้นหาข้อมูลอ้างอิงที่ครอบคลุมไฟไหม้ประเภทต่างๆ ในบ้าน สถานการณ์ทั่วไป และมาตรการแก้ไข

- มาตรฐานความปลอดภัย/ความแม่นยำสำหรับเครื่องตรวจจับอัคคีภัย รวมถึงคุณลักษณะ ROC

ไฟไหม้บ้าน

- สาเหตุที่พบบ่อย ได้แก่ บุหรี่ที่ยังคุกรุ่นอยู่ เทียน ไฟฟ้าขัดข้อง ไฟไหม้กระทะทอด

- ปัจจัยจำนวนมากส่งผลต่อธรรมชาติของไฟ โดยเฉพาะเชื้อเพลิงและออกซิเจน แต่ยังรวมไปถึงบริเวณที่เกิดเพลิงไหม้ กลางห้อง/กับผนัง ความจุความร้อนของห้อง ผนัง อุณหภูมิโดยรอบ ความชื้น สิ่งปนเปื้อนบน วัสดุ (ฝุ่น ผลิตภัณฑ์จากน้ำมัน สารทำให้ผิวนวล ฯลฯ)

- ในการดับไฟ ต้องใช้สารหน่วงหลายชนิด เช่น น้ำ (ไม่ใช้ไฟฟ้าหรือกระทะทอด) โฟม คาร์บอนไดออกไซด์ ผงแห้ง

- ในเหตุเพลิงไหม้ทางไฟฟ้า ควรแยกแหล่งจ่ายไฟฟ้าออกก่อน

- การลดการระบายอากาศ เช่น การปิดประตู จะช่วยจำกัดการเกิดเพลิงไหม้

- ควันไฟเองเป็นตัวบ่งชี้ธรรมชาติของไฟที่ชัดเจน

- อ่าน https://en.m.wikipedia.org/wiki/Fire_triangle และ https://en.m.wikipedia.org/wiki/Combustion

การปรับใช้ Edge

เป้าหมายสุดท้ายของเราในการปรับใช้กับอุปกรณ์ Edge (RPi, jetson nano, android หรือ ios) จะมีอิทธิพลต่อการตัดสินใจเกี่ยวกับสถาปัตยกรรมและข้อดีอื่นๆ

- ปรับใช้ YOLOv5 กับ Jetson Xavier NX ที่ 30FPS - การอนุมานที่ 30 FPS

- วิธีฝึก YOLOv5 บนชุดข้อมูลที่กำหนดเอง

- ฝึกฝน YOLOv4-tiny บนข้อมูลที่กำหนดเอง - การตรวจจับวัตถุที่รวดเร็วปานสายฟ้า

- วิธีฝึกโมเดลการตรวจจับวัตถุ TensorFlow Lite แบบกำหนดเอง - สมุดบันทึก colab, MobileNetSSDv2, ปรับใช้กับ RPi

- วิธีฝึกโมเดลการตรวจจับวัตถุมือถือแบบกำหนดเองด้วย YOLOv4 Tiny และ TensorFlow Lite - ฝึกฝน YOLOv4 Tiny Darknet และแปลงเป็น tflite สาธิตบน Android มีขั้นตอนมากกว่าการฝึกโดยตรงสำหรับ tflite

- AI for AG: การเรียนรู้ของเครื่องการผลิตเพื่อการเกษตร - ขั้นตอนการทำงานที่สมบูรณ์ตั้งแต่การฝึกอบรมไปจนถึงการใช้งาน

- ขณะนี้ Pytorch รองรับ RPi อย่างเป็นทางการhttps://pytorch.org/blog/prototype-features-now-available-apis-for-hardware-accelerated-mobile-and-arm64-builds/

- Hermes เป็นระบบตรวจจับไฟป่าที่ใช้ Computer Vision และเร่งความเร็วด้วย NVIDIA Deepstream

การใช้งานระบบคลาวด์

เราต้องการโซลูชันที่สามารถนำไปใช้กับระบบคลาวด์ได้เช่นกัน โดยมีการเปลี่ยนแปลงเพียงเล็กน้อยเทียบกับการปรับใช้ Edge สองสามตัวเลือก:

- ปรับใช้เป็นฟังก์ชัน lambda - ในประสบการณ์ของฉัน เวลาตอบสนองยาวนานถึง 45 วินาที

- ปรับใช้บน VM ด้วยโค้ดที่กำหนดเองเพื่อจัดการคิวคำขอ

- ใช้ torchserve บน sagemaker ทำงานบนอินสแตนซ์ EC2 มีการบันทึกไว้อย่างดีแต่เฉพาะ AWS

- ใช้ผู้ให้บริการคลาวด์รายใดรายหนึ่ง เช่น AWS Rekognition จะระบุการเกิดเพลิงไหม้

การประมวลผลภาพล่วงหน้าและการเพิ่ม

Roboflow อนุญาตให้มีการเพิ่มได้สูงสุด 3 ประเภทต่อชุดข้อมูล นอกเหนือจากการครอบตัดพื้นฐาน หากเราต้องการทดสอบด้วยการเสริมเพิ่มเติมเราสามารถชำระเงินได้ https://imgaug.readthedocs.io/en/latest/

- เหตุใดการประมวลผลล่วงหน้าและการเพิ่มรูปภาพจึงมีความสำคัญ

- ความสำคัญของการเบลอในฐานะเทคนิคการเพิ่มภาพ

- เมื่อใดจึงควรใช้คอนทราสต์เป็นขั้นตอนก่อนการประมวลผล

- การเพิ่มข้อมูลใน YOLOv4

- เหตุใดจึงต้องเพิ่มจุดรบกวนให้กับรูปภาพเพื่อการเรียนรู้ของเครื่อง

- เหตุใดและวิธีใช้การเพิ่มข้อมูลพืชผลแบบสุ่ม

- เมื่อใดจึงควรใช้โทนสีเทาเป็นขั้นตอนก่อนการประมวลผล

เมตริก ML

-

Precision คือ ความแม่นยำของการทำนาย ซึ่งคำนวณเป็น precision = TP/(TP+FP) หรือ "การทำนายถูกต้องกี่ %" -

Recall คือ อัตราบวกที่แท้จริง (TPR) ซึ่งคำนวณจาก recall = TP/(TP+FN) หรือ "โมเดลจับเปอร์เซ็นต์ของผลบวกจริงเป็นเท่าใด" -

F1 score (เรียกอีกอย่างว่าคะแนน F หรือการวัด F) คือค่าเฉลี่ยฮาร์มอนิกของความแม่นยำและการเรียกคืน โดยคำนวณเป็น F1 = 2*(precision * recall)/(precision + recall) มันสื่อถึงความสมดุลระหว่างความแม่นยำและการเรียกคืน อ้างอิง - อัตราผลบวกลวง (FPR) ซึ่งคำนวณเป็น

FPR = FP/(FP+TN) มักจะถูกพล็อตเทียบกับการเรียกคืน/TPR ในกราฟ ROC ซึ่งแสดงให้เห็นว่าการแลกเปลี่ยน TPR/FPR แปรผันตามเกณฑ์การจำแนกประเภทอย่างไร การลดเกณฑ์การจำแนกประเภทจะทำให้เกิดผลบวกจริงมากขึ้น แต่ก็มีผลบวกลวงมากขึ้นเช่นกัน - mAP, IoU, ความแม่นยำ และการเรียกคืนทั้งหมดได้รับการอธิบายไว้อย่างดีที่นี่และที่นี่

- IceVision ส่งคืน COCOMetric โดยเฉพาะ

AP at IoU=.50:.05:.95 (primary challenge metric) จากที่นี่ โดยทั่วไปจะเรียกว่า "ความแม่นยำเฉลี่ยเฉลี่ย" (mAP) -

[email protected] : ค่าเฉลี่ยความแม่นยำหรือความถูกต้องของแต่ละฉลากโดยคำนึงถึงฉลากทั้งหมด @0.5 กำหนดเกณฑ์สำหรับจำนวนกรอบขอบที่คาดการณ์ไว้ซ้อนทับคำอธิบายประกอบดั้งเดิม เช่น "ทับซ้อนกัน 50%"

ความคิดเห็น

- Firenet เป็นชื่อทั่วไปของรุ่น อย่าใช้

การอภิปราย

- กระทู้ที่ผมได้เริ่มในฟอรั่ม fast.ai

สาธิต

โมเดลที่มีประสิทธิภาพดีที่สุดสามารถใช้ได้โดยการเรียกใช้แอปสาธิตที่สร้างด้วย Gradio ดูไดเร็กทอรี demo