ComfyUI NSFW Detection

1.0.0

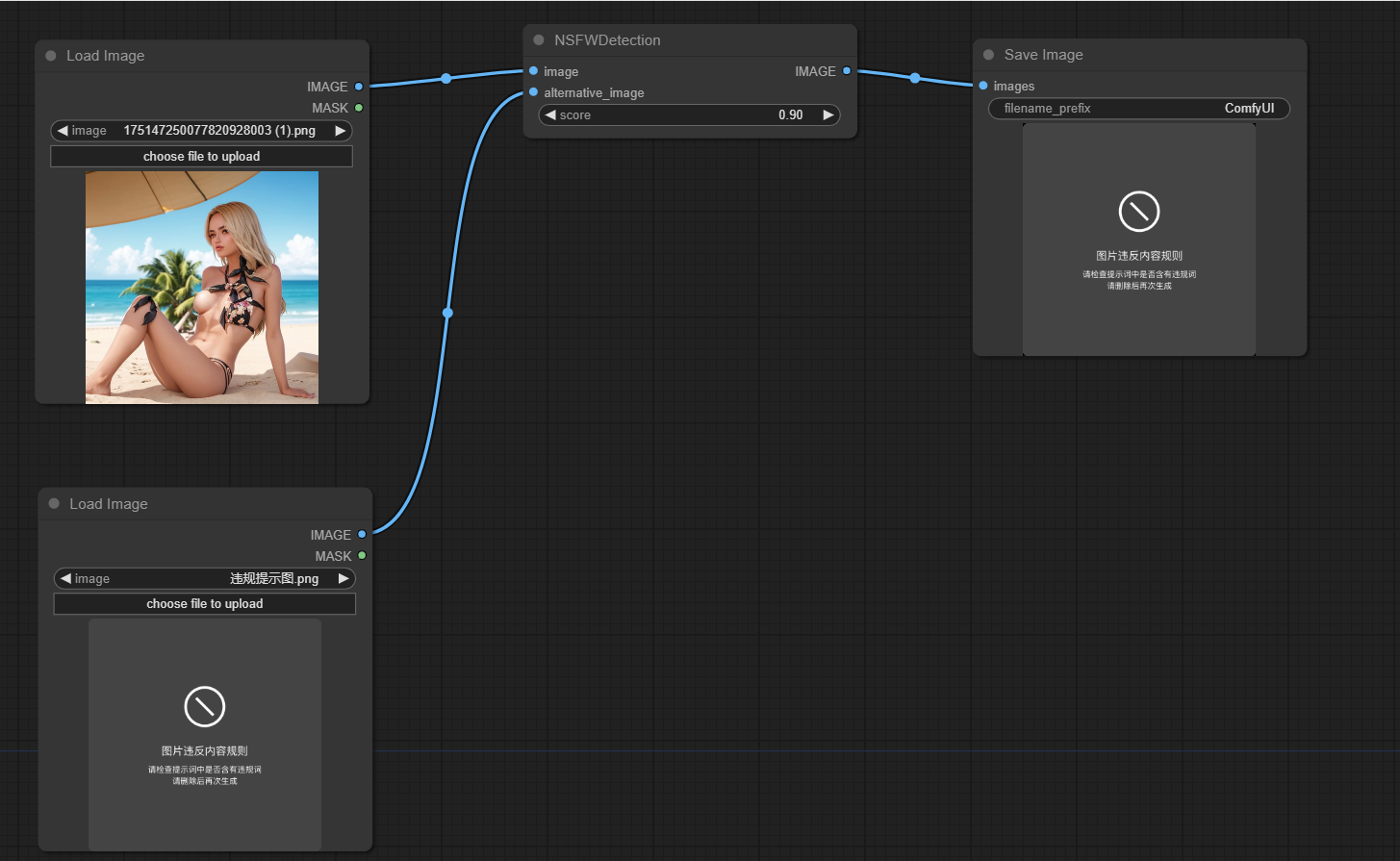

โครงการนี้ได้รับการออกแบบมาเพื่อตรวจสอบว่าภาพที่สร้างโดย COMFYUI นั้นไม่ปลอดภัยสำหรับการทำงาน (NSFW) หรือไม่ มันใช้รูปแบบการเรียนรู้ของเครื่องเพื่อจำแนกรูปภาพว่าปลอดภัยหรือไม่ปลอดภัยสำหรับการทำงาน หากรูปภาพถูกจัดประเภทเป็น NSFW จะส่งคืนรูปภาพทางเลือก

โคลน repo นี้ลงในไดเรกทอรี custom_nodes ของสถานที่ comfyui

เรียกใช้ PIP Install -r rechent.txt

ฟังก์ชั่นหลักของโครงการถูกห่อหุ้มในคลาส NSFWDetection ในไฟล์ node.py คลาสนี้มีวิธี run ที่ใช้สามพารามิเตอร์:

image : ภาพที่จะจำแนกscore : คะแนนธรณีประตูสำหรับการจำแนกภาพเป็น NSFWalternative_image : รูปภาพที่จะส่งคืนหากภาพอินพุตถูกจัดประเภทเป็น NSFW

https://github.com/trumanwong/comfyui-nsfw-detection/blob/main/workflow.json

ยินดีต้อนรับการมีส่วนร่วม โปรดส่งคำขอดึงหากคุณมีการปรับปรุงหรือแก้ไขข้อผิดพลาด

โครงการนี้ได้รับใบอนุญาตภายใต้ข้อกำหนดของใบอนุญาต MIT