南亨镇* 1 、郑丹尼尔·成浩* 1 、文庆植2 、李庆武1

![]()

![]()

1首尔国立大学, 2编解码器化身实验室,Meta

(*同等贡献)

CONTHO利用人与物体的接触作为精确重建的关键信号,联合重建3D 人和物体。为此,我们将“3D人-物体重建”和“人-物体接触估计”这两个分别在两个轨道上研究的不同任务整合到一个统一的框架中。

我们建议您使用 Anaconda 虚拟环境。安装 PyTorch >=1.10.1 和 Python >= 3.7.0。我们最新的 CONTHO 模型在 Python 3.9.13、PyTorch 1.10.1、CUDA 10.2 上进行了测试。

设置环境

# Initialize conda environment conda create -n contho python=3.9 conda activate contho # Install PyTorch conda install pytorch==1.10.1 torchvision==0.11.2 torchaudio==0.10.1 cudatoolkit=10.2 -c pytorch # Install all remaining packages pip install -r requirements.txt

从 Google Drive 或 Onedrive 准备base_data ,并将其放置为${ROOT}/data/base_data 。

从 Google Drive 或 OneDrive 下载预先训练的检查点。

最后请运行

python main/demo.py --gpu 0 --checkpoint {CKPT_PATH}您需要遵循如下data的目录结构。

${ROOT}

|-- data

| |-- base_data

| | |-- annotations

| | |-- backbone_models

| | |-- human_models

| | |-- object_models

| |-- BEHAVE

| | |-- dataset.py

| | |-- sequences

| | | |-- Date01_Sub01_backpack_back

| | | |-- Date01_Sub01_backpack_hand

| | | |-- ...

| | | |-- Date07_Sub08_yogamat

| |-- InterCap

| | |-- dataset.py

| | |-- sequences

| | | |-- 01

| | | |-- 02

| | | |-- ...

| | | |-- 10将 BEHAVE 数据集中的 Data01~Data07 序列下载到${ROOT}/data/BEHAVE/sequences 。

(选项 1)直接从下载页面下载 BEHAVE 数据集。

(选项 2)运行以下脚本。

scripts/download_behave.sh

将 InterCap 数据集的 RGBD_Images.zip 和 Res.zip 下载到${ROOT}/data/InterCap/sequences 。

(选项 1)直接从下载页面下载 InterCap 数据集。

(选项 2)运行以下脚本。

scripts/download_intercap.sh

从 Google Drive 或 Onedrive 下载 base_data。

(可选)下载已发布的 BEHAVE (Google Drive | OneDrive) 和 InterCap (Google Drive | OneDrive) 数据集的检查点。

要在 BEHAVE 或 InterCap 数据集上训练 CONTHO,请运行

python main/train.py --gpu 0 --dataset {DATASET}要在 BEHAVE 或 InterCap 数据集上评估 CONTHO,请运行

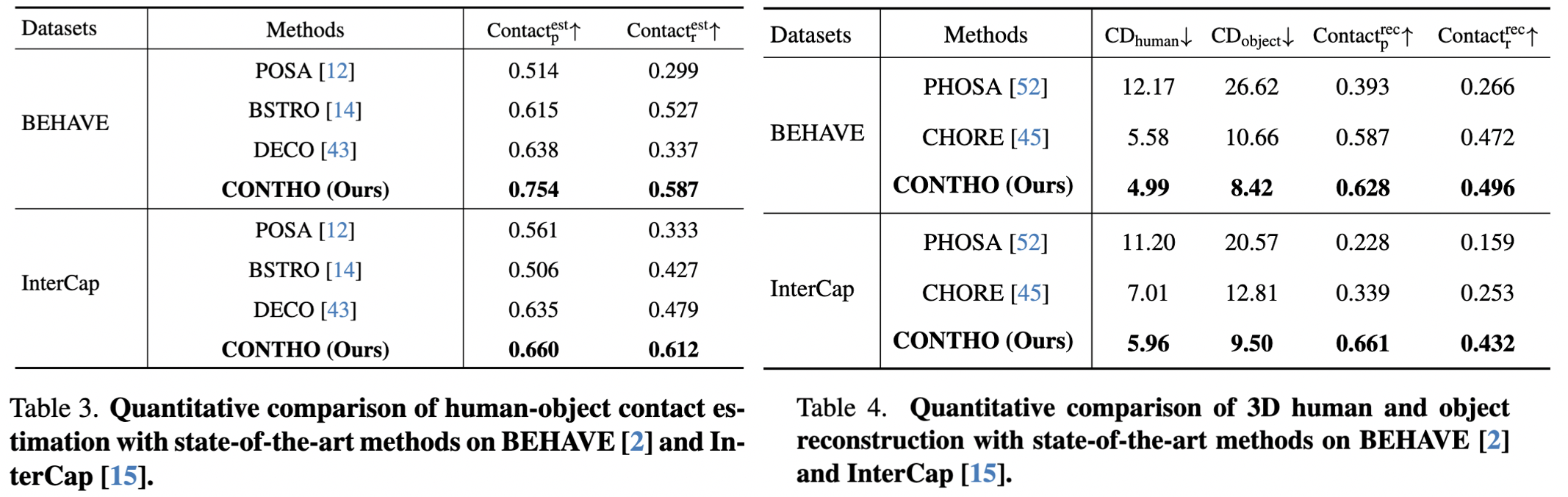

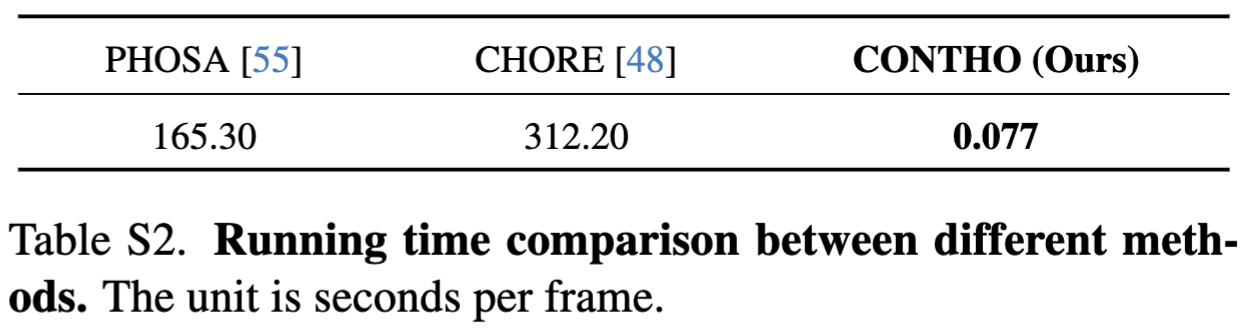

python main/test.py --gpu 0 --dataset {DATASET} --checkpoint {CKPT_PATH}在这里,我们报告 CONTHO 的性能。

CONTHO是一个快速、准确的3D人体和物体重建框架!

运行时错误:不支持带有布尔张量的减法、 -运算符。如果您尝试反转掩码,请改用~或logical_not()运算符:请检查参考。

bash:scripts/download_behave.sh:权限被拒绝:请检查参考。

我们感谢:

Hand4Whole 用于 3D 人体网格重建。

CHORE 用于 BEHAVE 的培训和测试。

InterCap 用于数据集的下载脚本。

DECO 用于野外实验设置。

@inproceedings{nam2024contho,

title = {Joint Reconstruction of 3D Human and Object via Contact-Based Refinement Transformer},

author = {Nam, Hyeongjin and Jung, Daniel Sungho and Moon, Gyeongsik and Lee, Kyoung Mu},

booktitle = {Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition},

year = {2024}

}