Reversal of Thought

1.0.0

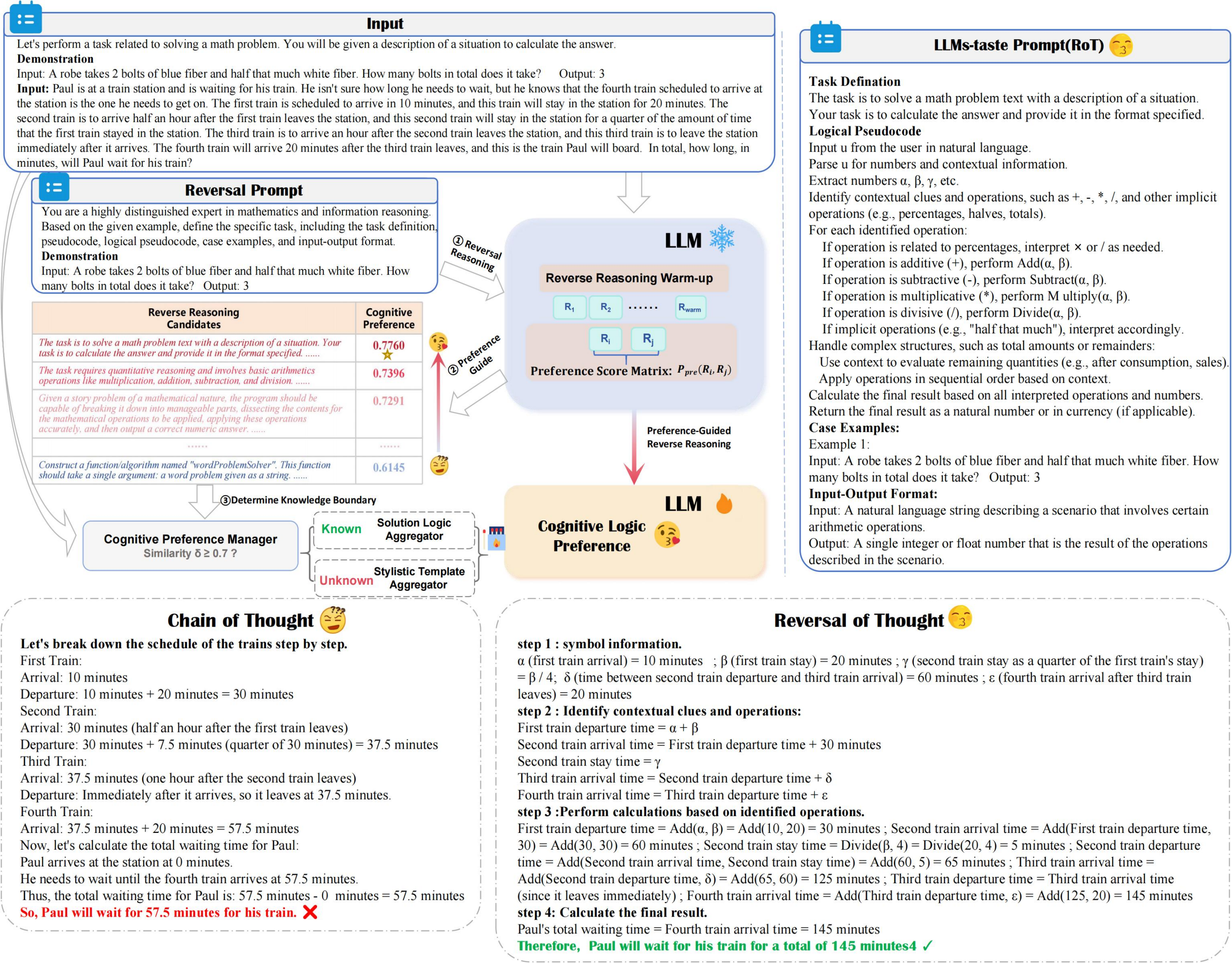

ROT提高了推理的准确性和效率,同时最大程度地降低了计算成本,利用偏好引导的反向推理以及认知偏好管理器以最佳的方式探索具有认知偏好的LLM推理。

??? reversal_demo.py

from utils . llm_utils import *

from utils . prompt import *

pipeline = Pipeline ( model_id = model_id , base_url = base_url , api_key = api_key , prob = True )

demos = "Input:... Output:..." #Suggest 2-shot Demos

llm_taste = rot_pipeline ( pipeline , reversal_of_thought , demos = demos , warmup = 5 )增强任务解决方案的LLM偏爱提示

提示提示与LLM偏爱的策略保持一致,从而优化任务解决效率。

创建各种质量检查数据集的潜力

生成各种问答对,以改善数据集多样性。

如果您发现我们的工作对您的研究很有用,请请我们的论文如下:

@article { yuan2024reversal ,

title = { Reversal of Thought: Enhancing Large Language Models with Preference-Guided Reverse Reasoning Warm-up } ,

author = { Yuan, Jiahao and Du, Dehui and Zhang, Hao and Di, Zixiang and Naseem, Usman } ,

journal = { arXiv preprint arXiv:2410.12323 } ,

year = { 2024 }

}