中文 | 한국어 | 日本語 | Русский | 俄羅斯德語 |法語 |西班牙語 |葡萄牙語 |土耳其 |越南 | Tiếng Việt |巴黎

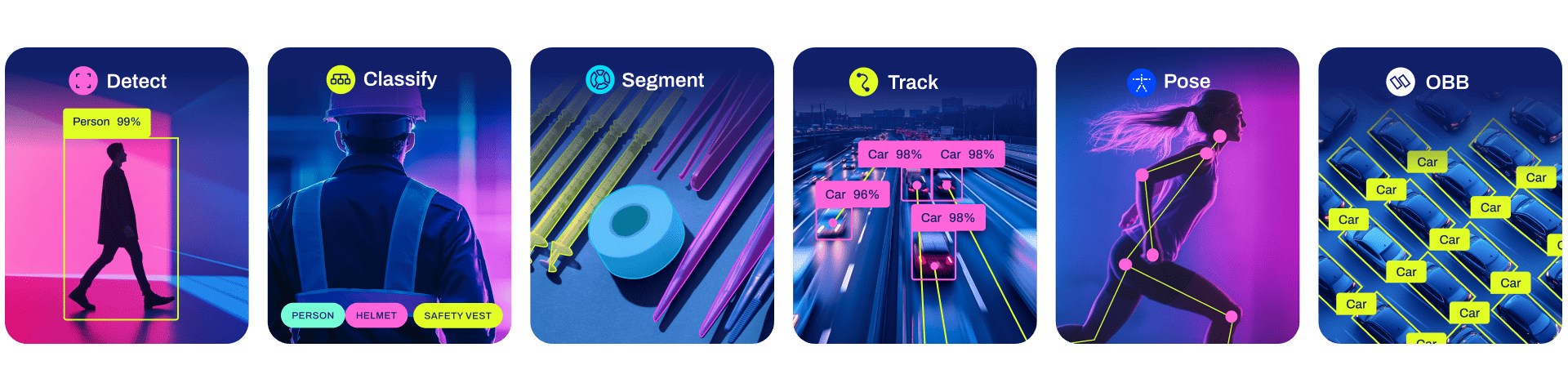

Ultralytics YOLO11 是一種尖端、最先進 (SOTA) 模型,它建立在先前 YOLO 版本成功的基礎上,並引入了新功能和改進,以進一步提高性能和靈活性。 YOLO11 的設計目標是快速、準確且易於使用,使其成為各種物件偵測和追蹤、實例分割、影像分類和姿態估計任務的絕佳選擇。

我們希望這裡的資源能幫助您充分利用 YOLO。請瀏覽 Ultralytics 文件以了解詳細信息,在 GitHub 上提出問題以獲得支援、問題或討論,成為 Ultralytics Discord、Reddit 和論壇的成員!

要申請企業許可證,請填寫 Ultralytics Licensing 處的表格。

文件

請參閱下面的快速入門安裝和使用範例,並參閱我們的文件以取得有關培訓、驗證、預測和部署的完整文件。

Pip 安裝 ultralytics 套件,包括使用PyTorch>=1.8的Python>=3.8環境中的所有要求。

pip 安裝 ultralytics

有關 Conda、Docker 和 Git 等替代安裝方法,請參閱快速入門指南。

YOLO 可以透過yolo指令直接在命令列介面 (CLI) 中使用:

yolo 預測模型=yolo11n.pt source='https://ultralytics.com/images/bus.jpg'

yolo可用於各種任務和模式,並接受附加參數,即imgsz=640 。有關範例,請參閱 YOLO CLI 文件。

YOLO 也可以直接在 Python 環境中使用,並接受與上面 CLI 範例相同的參數:

from ultralytics import YOLO# 載入模型 model = YOLO("yolo11n.pt")# 訓練模型train_results = model.train( data="coco8.yaml", # 資料集路徑 YAML epochs=100, # 訓練週期數 imgsz= 640 , # 訓練影像大小device="cpu", # 運行的設備,即device=0 或device=0,1,2,3 或device=cpu)# 在驗證集上評估模型性能metrics = model.val( ) # 對影像進行物件偵測results = model("path/to/image.jpg")results[0].show()# 將模型匯出為ONNX格式path = model.export(format="onnx") # 返迴路徑到匯出模型有關更多範例,請參閱 YOLO Python 文件。

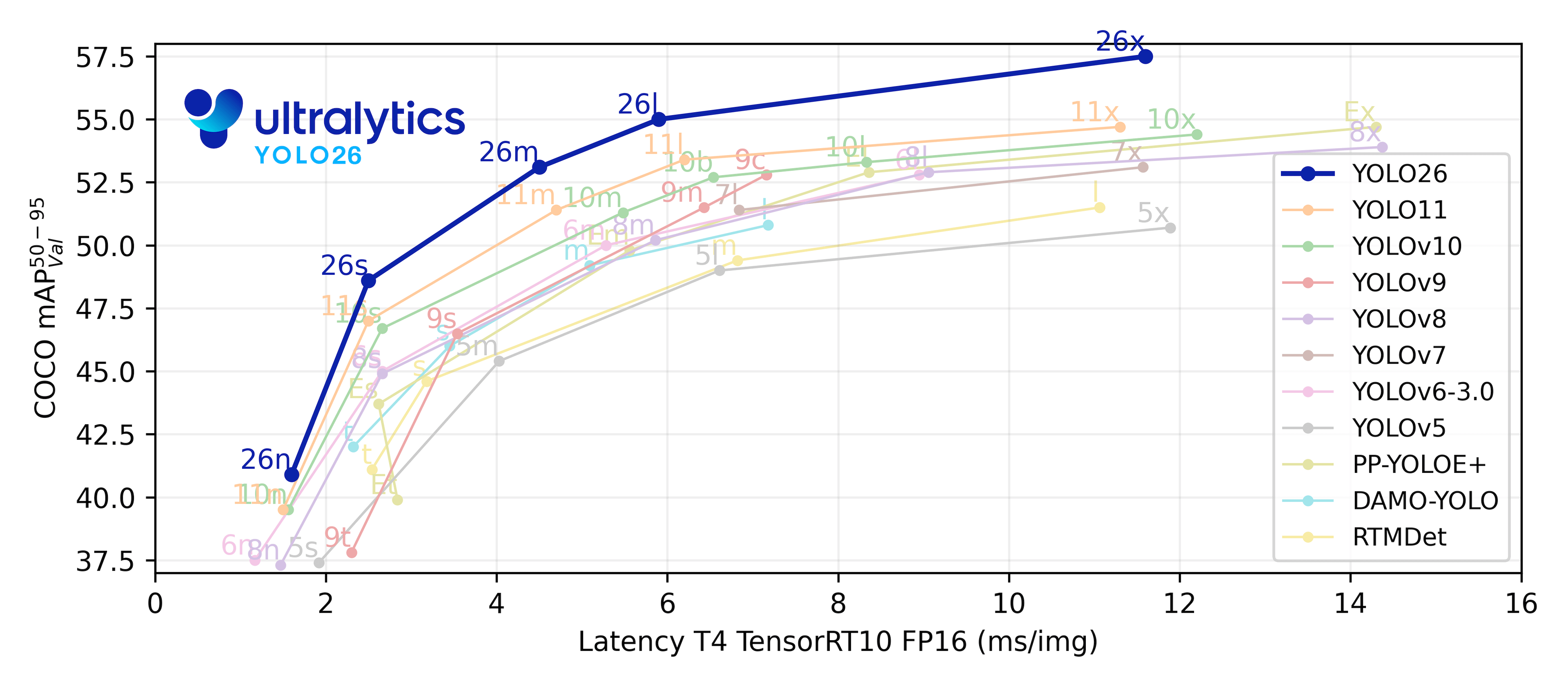

型號

這裡提供了在 COCO 資料集上預先訓練的 YOLO11 檢測、分段和姿勢模型,以及在 ImageNet 資料集上預先訓練的 YOLO11 分類模型。追蹤模式適用於所有檢測、分段和姿勢模型。

所有模型在首次使用時都會自動從最新的 Ultralytics 版本下載。

請參閱檢測文檔,以了解在 COCO 上訓練的這些模型的使用範例,其中包括 80 個預訓練類別。

| 模型 | 尺寸 (像素) | 平均AP值 50-95 | 速度 CPU ONNX (多發性硬化症) | 速度 T4 張量RT10 (多發性硬化症) | 參數 (男) | 失敗次數 (二) |

|---|---|---|---|---|---|---|

| YOLO11n | 640 | 39.5 | 56.1±0.8 | 1.5±0.0 | 2.6 | 6.5 |

| YOLO11s | 640 | 47.0 | 90.0±1.2 | 2.5±0.0 | 9.4 | 21.5 |

| YOLO11米 | 640 | 51.5 | 183.2±2.0 | 4.7±0.1 | 20.1 | 68.0 |

| YOLO11l | 640 | 53.4 | 238.6±1.4 | 6.2±0.1 | 25.3 | 86.9 |

| YOLO11x | 640 | 54.7 | 462.8±6.7 | 11.3±0.2 | 56.9 | 194.9 |

mAP val值適用於 COCO val2017 資料集上的單模型單尺度。

由yolo val detect data=coco.yaml device=0重現

使用 Amazon EC2 P4d 執行個體對 COCO val 影像進行平均速度。

透過yolo val detect data=coco.yaml batch=1 device=0|cpu

請參閱分割文檔,以了解在 COCO-Seg 上訓練的這些模型的使用範例,其中包括 80 個預訓練類別。

| 模型 | 尺寸 (像素) | 地圖框 50-95 | 地圖掩模 50-95 | 速度 CPU ONNX (多發性硬化症) | 速度 T4 張量RT10 (多發性硬化症) | 參數 (男) | 失敗次數 (二) |

|---|---|---|---|---|---|---|---|

| YOLO11n-seg | 640 | 38.9 | 32.0 | 65.9±1.1 | 1.8±0.0 | 2.9 | 10.4 |

| YOLO11s-seg | 640 | 46.6 | 37.8 | 117.6±4.9 | 2.9±0.0 | 10.1 | 35.5 |

| YOLO11m-段 | 640 | 51.5 | 41.5 | 281.6±1.2 | 6.3±0.1 | 22.4 | 123.3 |

| YOLO11l-段 | 640 | 53.4 | 42.9 | 344.2±3.2 | 7.8±0.2 | 27.6 | 142.2 |

| YOLO11x-seg | 640 | 54.7 | 43.8 | 664.5±3.2 | 15.8±0.7 | 62.1 | 319.0 |

mAP val值適用於 COCO val2017 資料集上的單模型單尺度。

透過yolo val segment data=coco-seg.yaml device=0重現

使用 Amazon EC2 P4d 執行個體對 COCO val 影像進行平均速度。

透過yolo val segment data=coco-seg.yaml batch=1 device=0|cpu

請參閱分類文檔,以了解在 ImageNet 上訓練的這些模型的使用範例,其中包括 1000 個預訓練類別。

| 模型 | 尺寸 (像素) | ACC 前1名 | ACC 前5名 | 速度 CPU ONNX (多發性硬化症) | 速度 T4 張量RT10 (多發性硬化症) | 參數 (男) | 失敗次數 (B) 640 |

|---|---|---|---|---|---|---|---|

| YOLO11n-cls | 224 | 70.0 | 89.4 | 5.0±0.3 | 1.1±0.0 | 1.6 | 3.3 |

| YOLO11s-cls | 224 | 75.4 | 92.7 | 7.9±0.2 | 1.3±0.0 | 5.5 | 12.1 |

| YOLO11m-cls | 224 | 77.3 | 93.9 | 17.2±0.4 | 2.0±0.0 | 10.4 | 39.3 |

| YOLO11l-cls | 224 | 78.3 | 94.3 | 23.2±0.3 | 2.8±0.0 | 12.9 | 49.4 |

| YOLO11x-cls | 224 | 79.5 | 94.9 | 41.4±0.9 | 3.8±0.0 | 28.4 | 110.4 |

acc值是 ImageNet 資料集驗證集上的模型精確度。

由yolo val classify data=path/to/ImageNet device=0

使用 Amazon EC2 P4d 執行個體對 ImageNet val 影像進行平均速度。

由yolo val classify data=path/to/ImageNet batch=1 device=0|cpu

請參閱 Pose 文檔,以了解在 COCO-Pose 上訓練的這些模型的使用範例,其中包括 1 個預訓練類別、人員。

| 模型 | 尺寸 (像素) | 地圖位姿 50-95 | 地圖位姿 50 | 速度 CPU ONNX (多發性硬化症) | 速度 T4 張量RT10 (多發性硬化症) | 參數 (男) | 失敗次數 (二) |

|---|---|---|---|---|---|---|---|

| YOLO11n-姿勢 | 640 | 50.0 | 81.0 | 52.4±0.5 | 1.7±0.0 | 2.9 | 7.6 |

| YOLO11s-姿勢 | 640 | 58.9 | 86.3 | 90.5±0.6 | 2.6±0.0 | 9.9 | 23.2 |

| YOLO11m-姿勢 | 640 | 64.9 | 89.4 | 187.3±0.8 | 4.9±0.1 | 20.9 | 71.7 |

| YOLO11l-姿勢 | 640 | 66.1 | 89.9 | 247.7±1.1 | 6.4±0.1 | 26.2 | 90.7 |

| YOLO11x-姿勢 | 640 | 69.5 | 91.1 | 488.0±13.9 | 12.1±0.2 | 58.8 | 203.3 |

mAP val值適用於 COCO Keypoints val2017 資料集上的單模型單尺度。

由yolo val pose data=coco-pose.yaml device=0重現

使用 Amazon EC2 P4d 執行個體對 COCO val 影像進行平均速度。

由yolo val pose data=coco-pose.yaml batch=1 device=0|cpu

請參閱 OBB 文檔,以了解這些在 DOTAv1 上訓練的模型的使用範例,其中包括 15 個預訓練類。

| 模型 | 尺寸 (像素) | 映射測試 50 | 速度 CPU ONNX (多發性硬化症) | 速度 T4 張量RT10 (多發性硬化症) | 參數 (男) | 失敗次數 (二) |

|---|---|---|---|---|---|---|

| YOLO11n-ob | 1024 | 78.4 | 117.6±0.8 | 4.4±0.0 | 2.7 | 17.2 |

| YOLO11s-ob | 1024 | 79.5 | 219.4±4.0 | 5.1±0.0 | 9.7 | 57.5 |

| YOLO11m-ob | 1024 | 80.9 | 562.8±2.9 | 10.1±0.4 | 20.9 | 183.5 |

| YOLO11l-ob | 1024 | 81.0 | 712.5±5.0 | 13.5±0.6 | 26.2 | 232.0 |

| YOLO11x-obb | 1024 | 81.3 | 1408.6±7.7 | 28.6±1.0 | 58.8 | 520.2 |

mAP測試值適用於 DOTAv1 資料集上的單模型多尺度。

透過yolo val obb data=DOTAv1.yaml device=0 split=test重現並將合併結果提交給 DOTA 評估。

使用 Amazon EC2 P4d 執行個體對 DOTAv1 val 影像進行平均速度。

由yolo val obb data=DOTAv1.yaml batch=1 device=0|cpu

整合

我們與領先的人工智慧平台的關鍵整合擴展了 Ultralytics 產品的功能,增強了資料集標記、培訓、視覺化和模型管理等任務。了解 Ultralytics 如何與 W&B、Comet、Roboflow 和 OpenVINO 合作優化您的 AI 工作流程。

![]()

![]()

![]()

| 超解集線器? | 溫布利 | 彗星 ⭐ 新 | 神經魔法 |

|---|---|---|---|

| 簡化 YOLO 工作流程:使用 Ultralytics HUB 輕鬆標記、訓練和部署。立即嘗試! | 使用權重和偏差來追蹤實驗、超參數和結果 | Comet 永久免費,可讓您保存 YOLO11 模型、恢復訓練以及互動式視覺化和調試預測 | 使用 Neural Magic DeepSparse 將 YOLO11 推理速度提高 6 倍 |

超解集線器

透過 Ultralytics HUB 體驗無縫 AI,這是資料視覺化的一體化解決方案 YOLO11?模型訓練和部署,無需任何編碼。使用我們的尖端平台和用戶友好的 Ultralytics 應用程序,將圖像轉化為可行的見解,並輕鬆將您的 AI 願景變為現實。立即免費開始您的旅程!

貢獻

我們喜歡您的意見!如果沒有我們社群的幫助,Ultralytics YOLO 就不可能實現。請參閱我們的貢獻指南以開始使用,並填寫我們的問卷,向我們發送有關您的體驗的回饋。謝謝 ?致我們所有的貢獻者!

執照

Ultralytics 提供兩種許可選項來適應不同的用例:

AGPL-3.0 授權:此 OSI 批准的開源授權非常適合學生和愛好者,促進開放協作和知識共享。有關更多詳細信息,請參閱許可證文件。

企業許可證:該許可證專為商業用途而設計,允許將 Ultralytics 軟體和人工智慧模型無縫整合到商業產品和服務中,繞過 AGPL-3.0 的開源要求。如果您的方案涉及將我們的解決方案嵌入到商業產品中,請透過 Ultralytics 授權進行聯絡。

接觸

有關 Ultralytics 錯誤報告和功能請求,請造訪 GitHub 問題。成為 Ultralytics Discord、Reddit 或論壇的成員,以便提出問題、分享專案、學習討論或尋求有關 Ultralytics 的所有幫助!