這個端到端專案簡化了大型語言模型 (LLM) 應用程式的生命週期,包括開發、生產和部署。該儲存庫包含作為專案元件的資料夾和文件,例如代理、API、鏈、聊天機器人、GROQ(查詢語言)、Hugging Face 模型、ObjectBox(嵌入式資料庫)、OpenAI 模型和檢索增強生成(RAG) ) )。該計畫旨在提供與法學碩士合作的全面解決方案,涵蓋數據處理、聊天機器人開發以及與各種工具和框架的整合。

該專案演示了透過 Langchain 和 Ollama 使用付費和開源大規模語言模型 (LLM) 創建聊天機器人。它涵蓋了LLM應用程式的整個生命週期,包括開發、生產和部署。

是的。所有 API 都是秘密的,具有受限的使用者存取權限和匿名 .gitignore,以及透過 Github 秘密環境提供的另一層安全性(抱歉!您必須使用自己的!)

conda create -p venv python==3.10 -y

venv S cripts a ctivate

pip install -r requirements.txt在app.py檔案中配置必要的 API 金鑰和設定。

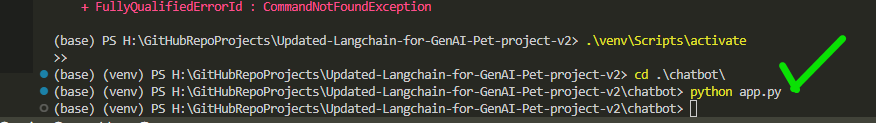

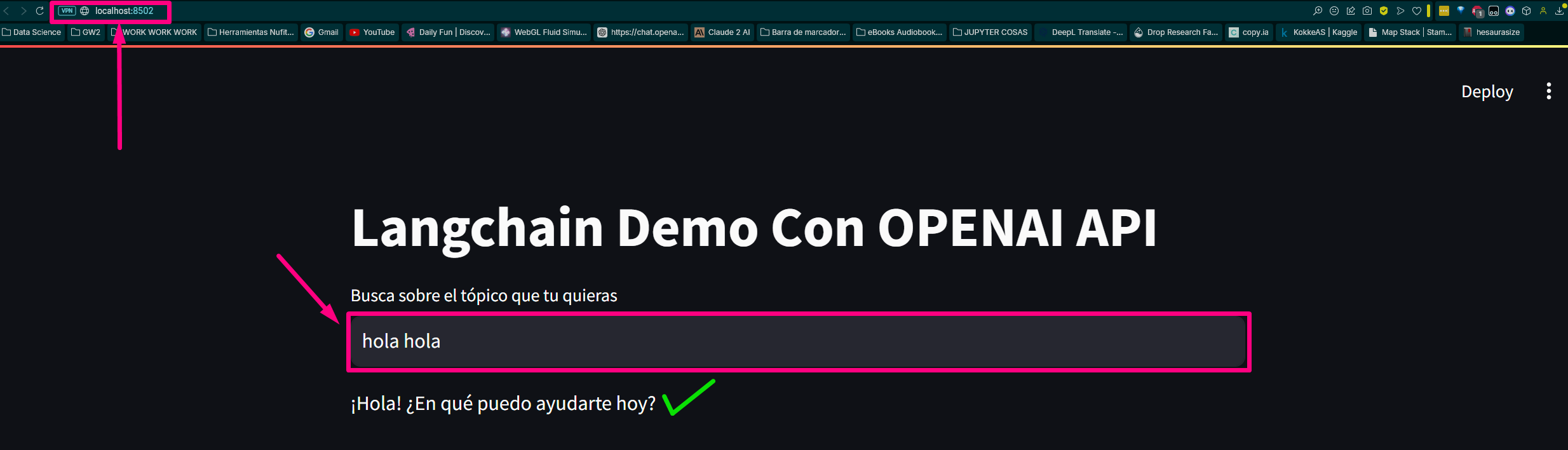

python app.py開啟網頁瀏覽器並導航至(或電腦上指派的漸進連接埠)。我的是:

http://localhost:8502我們透過呼叫基礎聊天機器人的 3 個主要鍊式函數來建立檔案。

我們載入模組和函式庫的需求:

我們運行我們的app.py

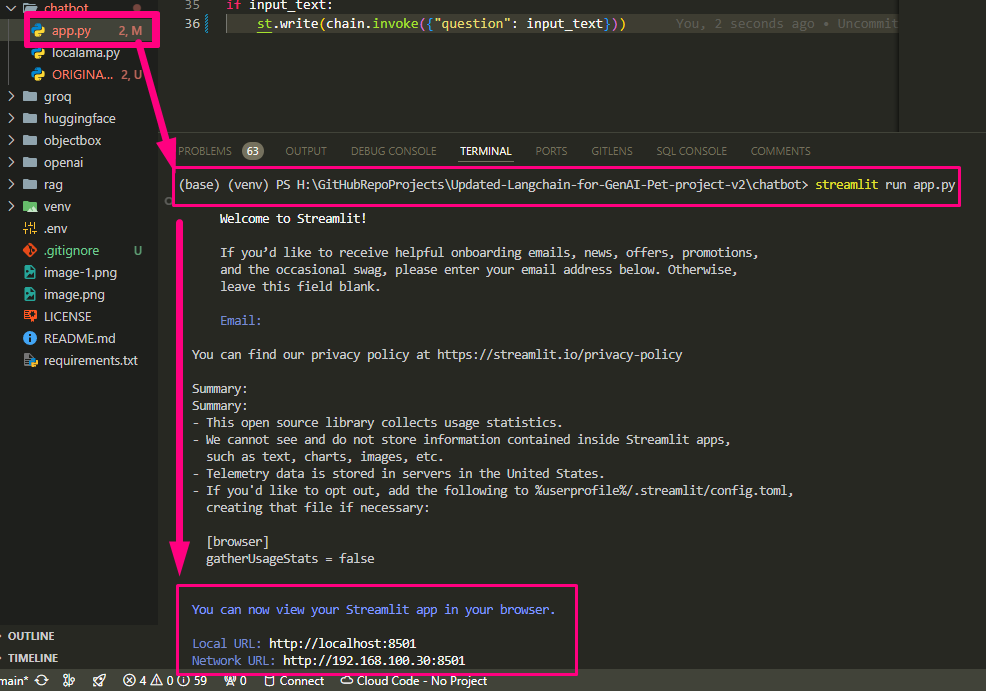

我們完成app.py配置並運行

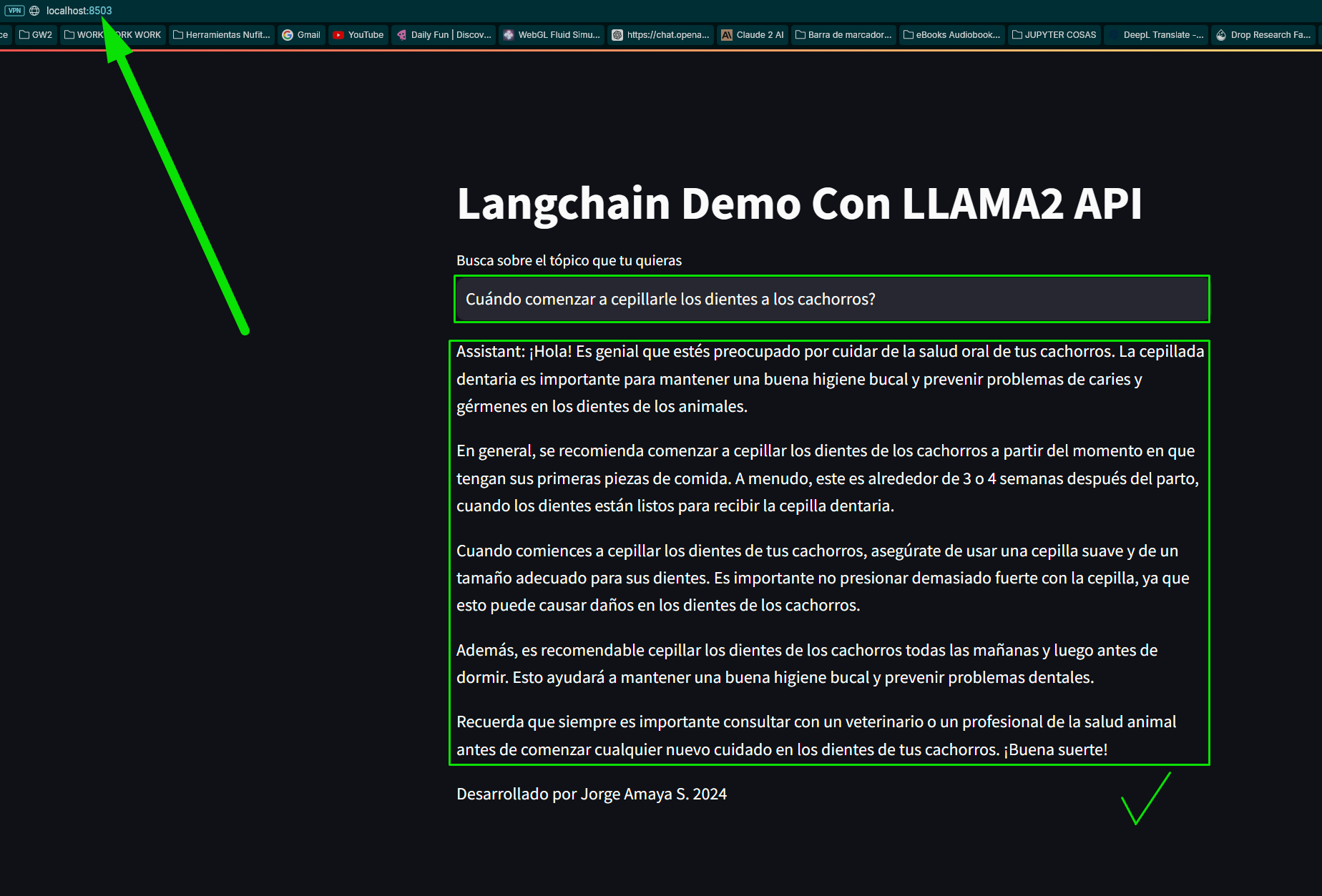

它會返迴路由並在測試瀏覽器中打開主機

Local URL: http://localhost:8502

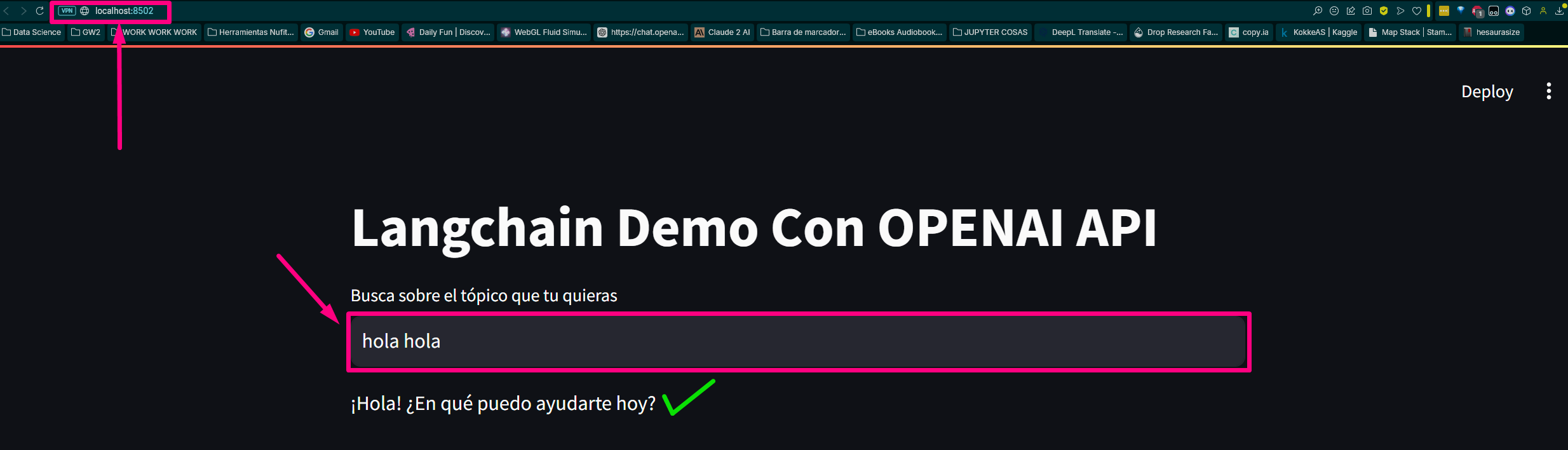

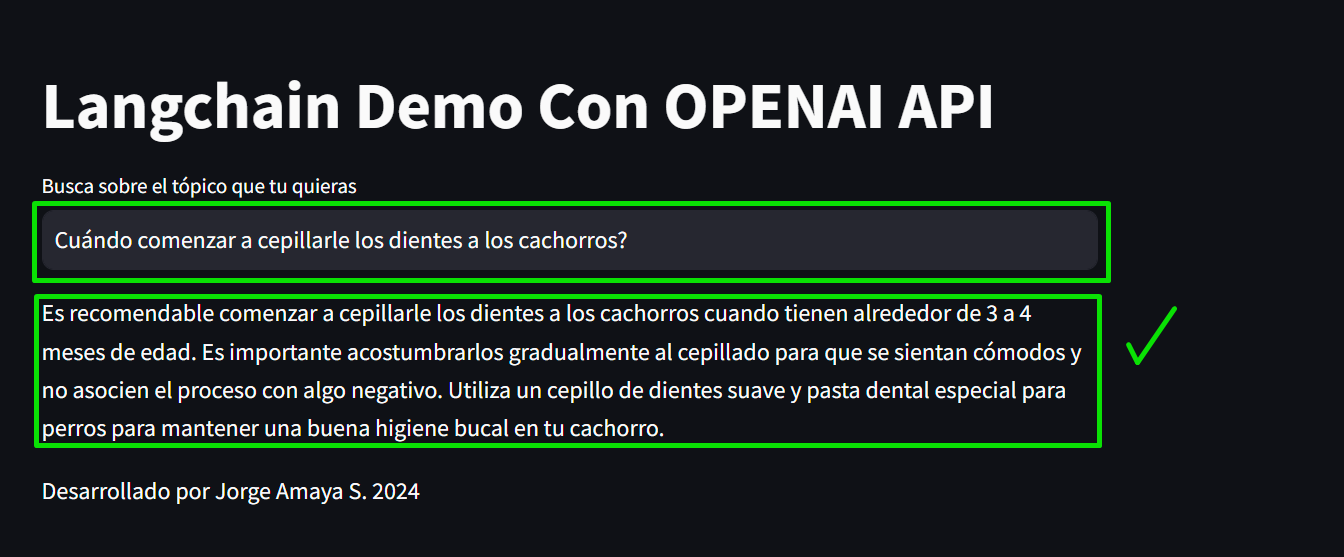

Network URL: http://192.168.100.30:8502我們來檢查一下頁面:

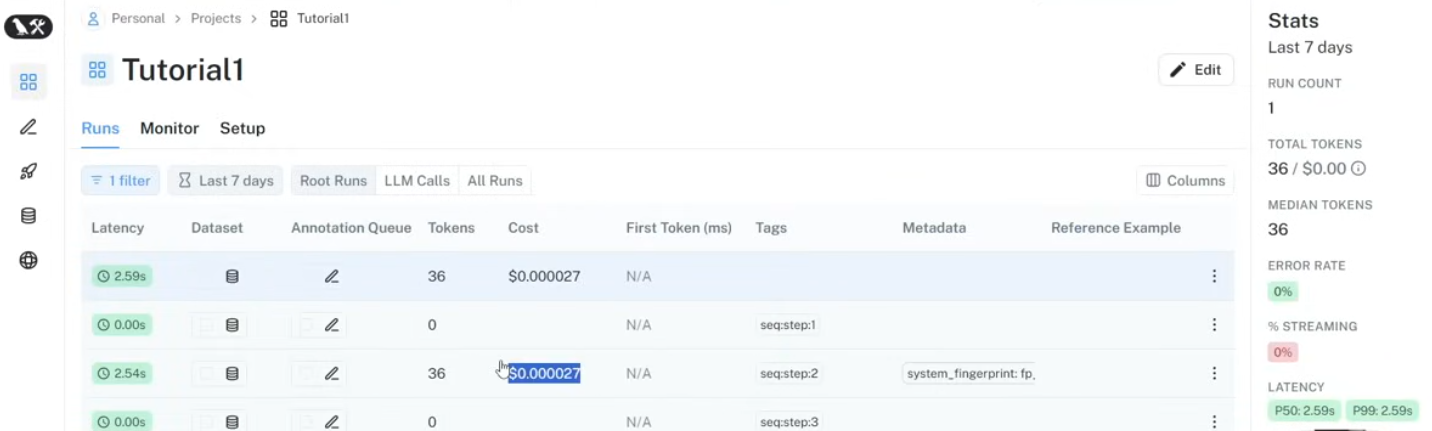

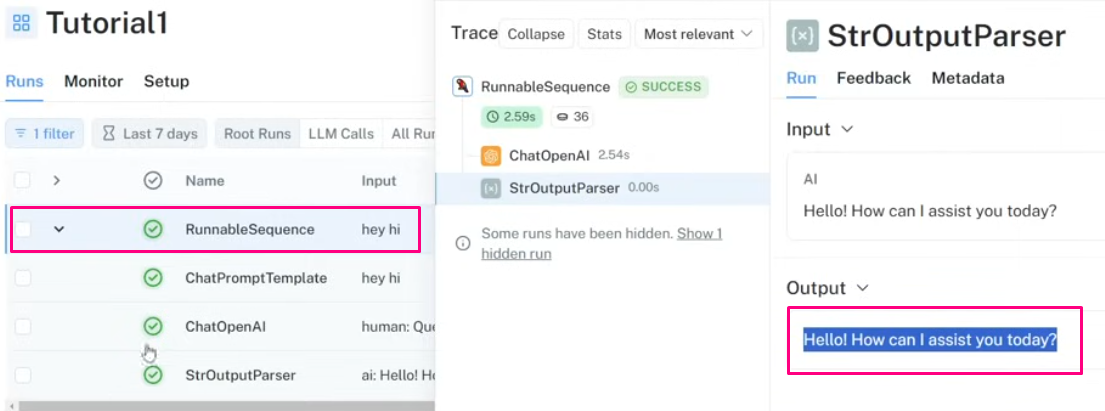

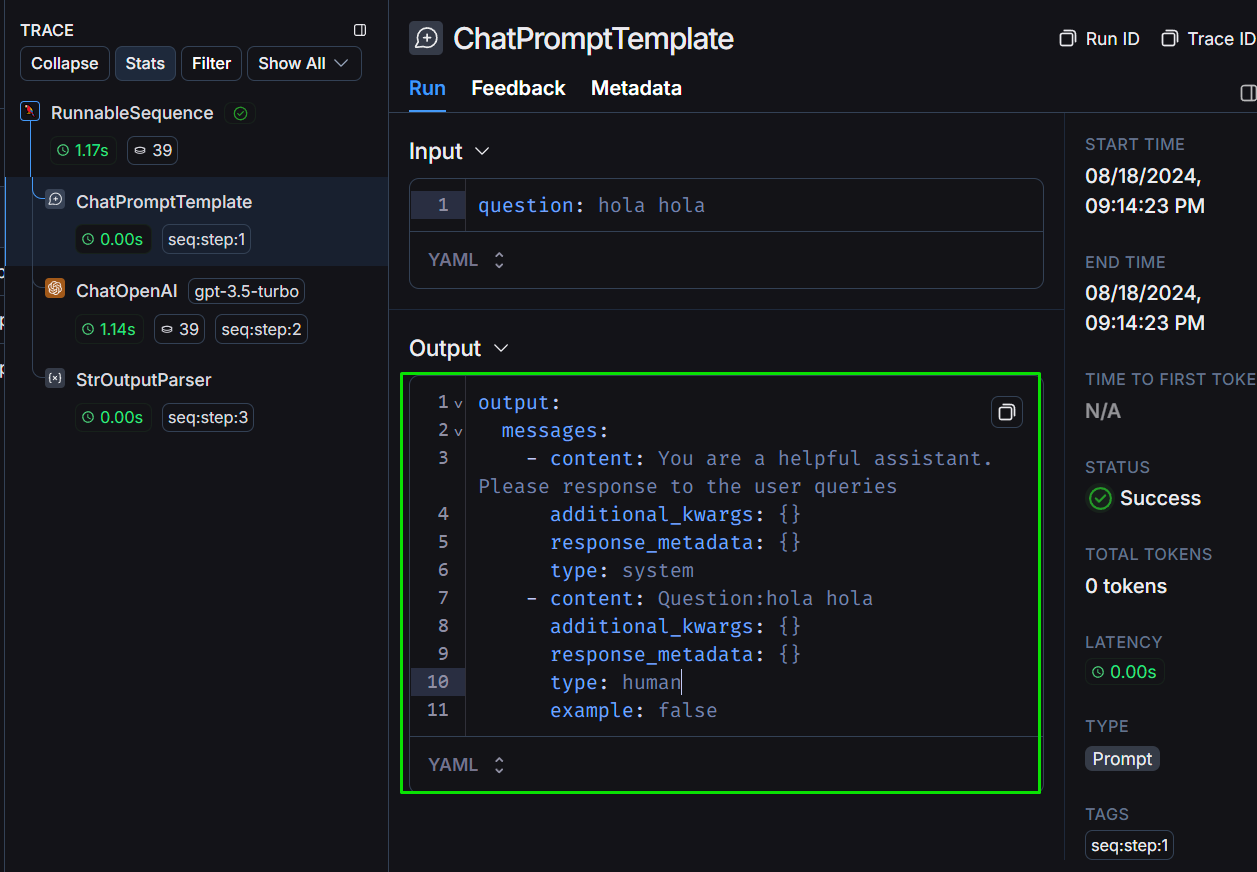

讓我們回顧一下Langchain框架中的項目:

讓我們看看我們定義的輸出結構:

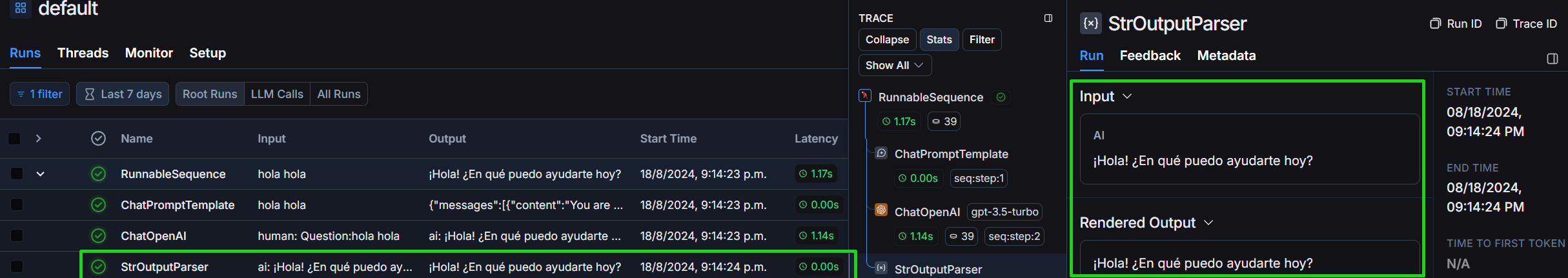

我們詳細看一下StrOutputParser:

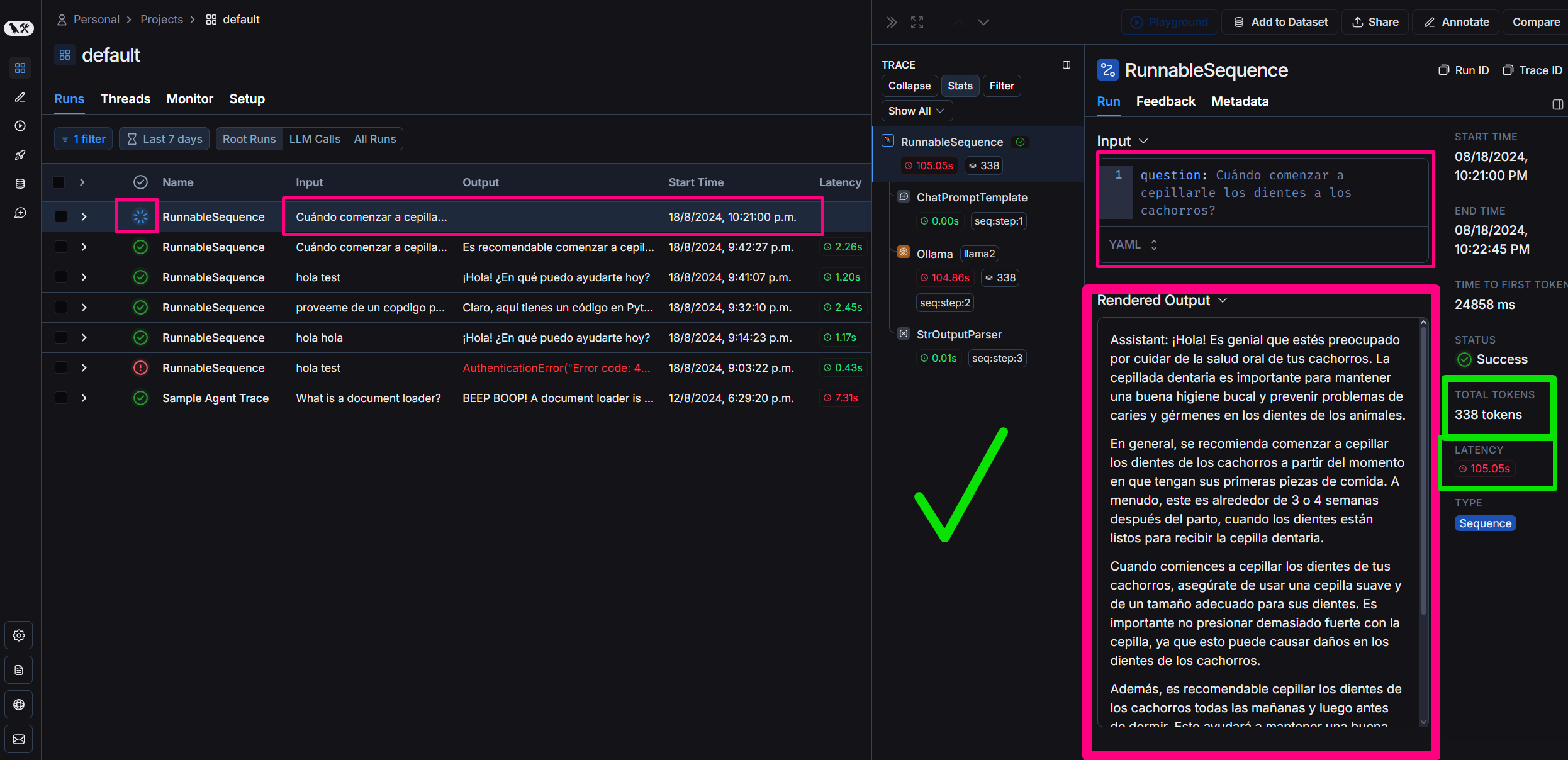

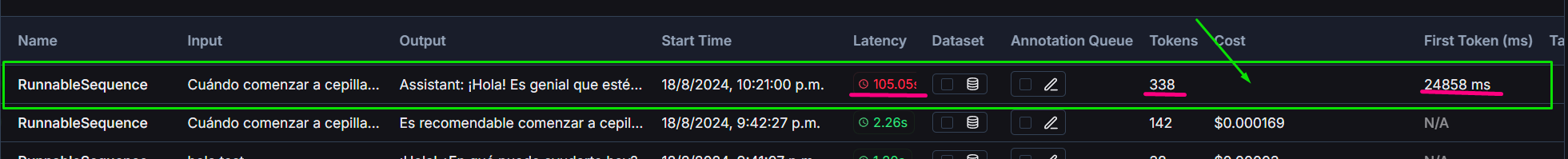

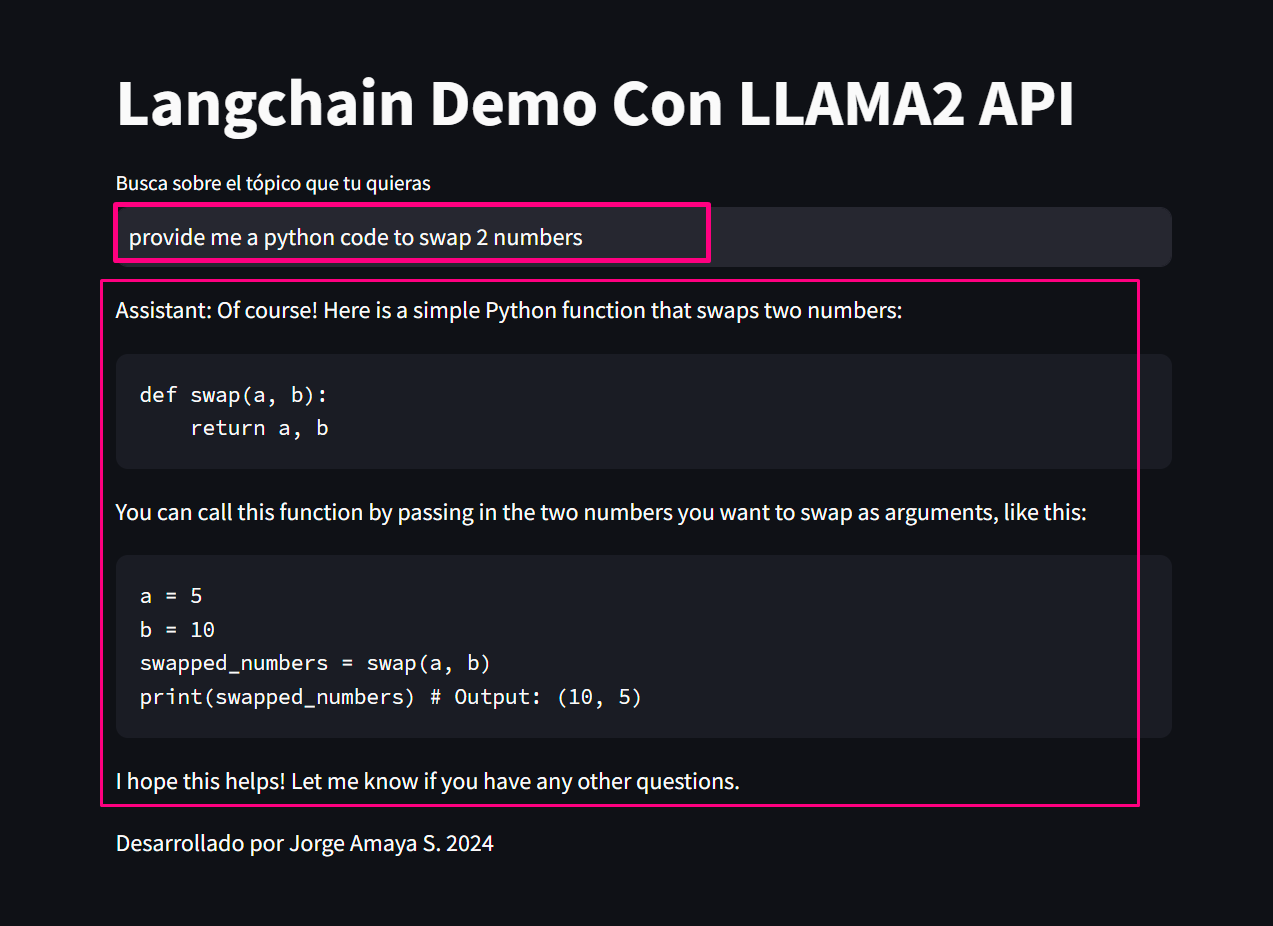

我們將詢問您「提供交換兩個值的Python程式碼」來評估成本、標記化和延遲時間來解決問題:

*proveeme de un código python que swapee 2 valores.*

# Definir los dos valores a intercambiar

a = 5

b = 10

print ( "Valores originales:" )

print ( "a =" , a )

print ( "b =" , b )

# Intercambiar los valores

temp = a

a = b

b = temp

print ( " n Valores intercambiados:" )

print ( "a =" , a )

print ( "b =" , b )最後我們產生一個公共查詢:

“問題”:“什麼時候開始給小狗刷牙?”

我們將透過將 Llama2 下載到我們的電腦上來從我的本地環境中運行它來專門加載 Llamama

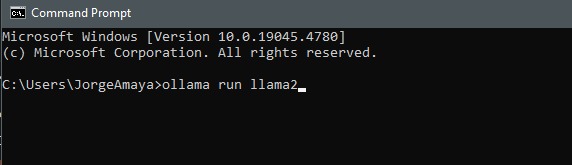

我打開一個cmd

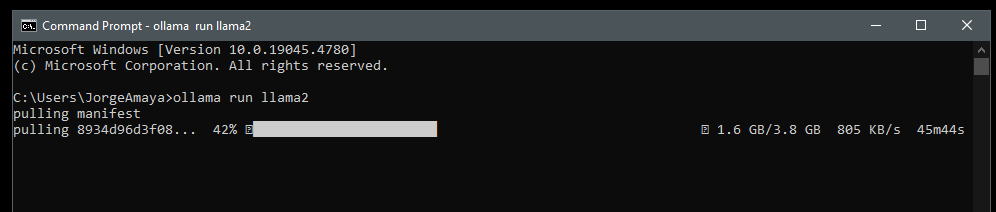

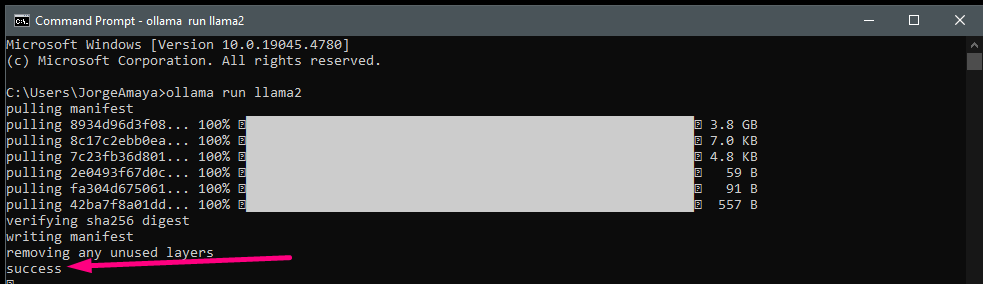

ollama run llama2我們下載llama2

Llama2與gpt3.5 turbo產生的反應水準、連貫性和一致性

該專案包括 OpenAI 的 GPT-3.5-turbo 和本地運行的 Llama2 模型之間的比較:

我們使用Langchain上的Langsmith來監控:

始終歡迎為改進聊天機器人或擴展其功能做出貢獻。請提交拉取請求或未解決的問題以進行任何改進。

####你想學嗎?給我發一條DM!

該專案是開源的,可根據 MIT 許可證使用。