ACM MM'18 最佳學生論文

新加坡國立大學 (NUS) 學習與視覺 (LV) 小組的多人解析計畫旨在推動人群場景中人類細粒度視覺理解的前沿。

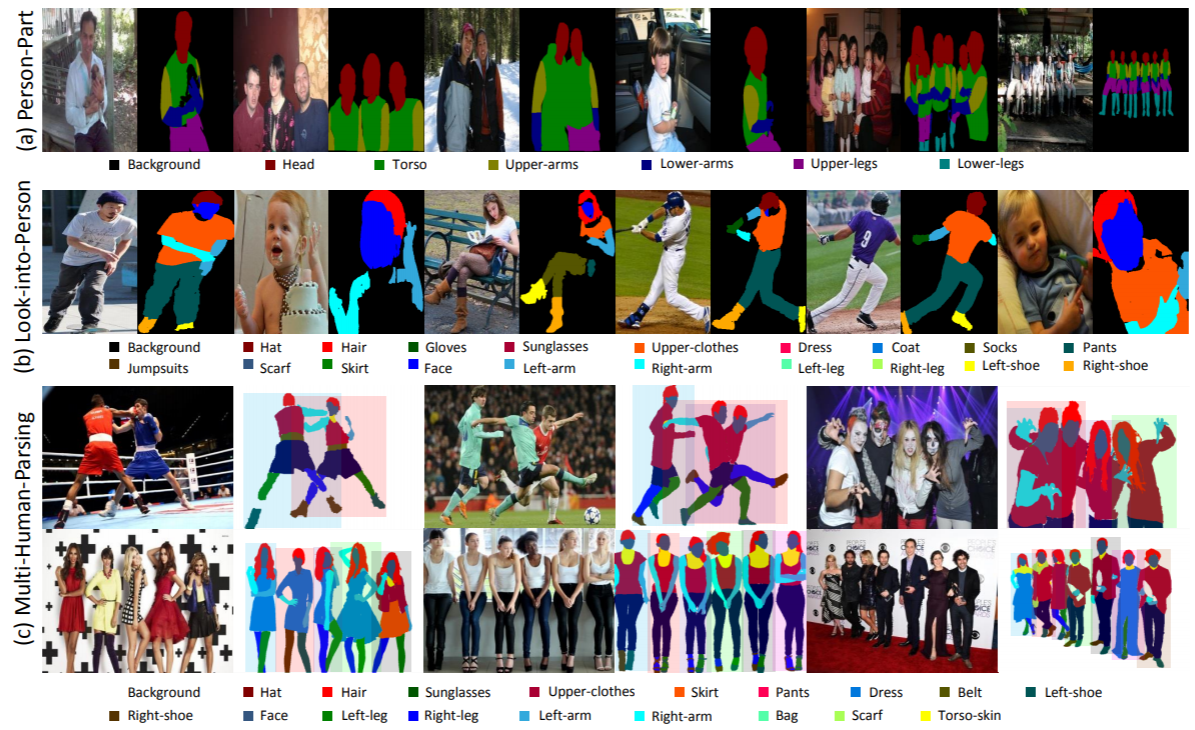

多人解析與傳統的明確定義的物件辨識任務有顯著不同,例如物件偵測,它僅提供物件位置(邊界框)的粗略預測;實例分割,僅預測實例級掩模,沒有任何關於身體部位和時尚類別的詳細資訊;人類解析,它在類別級像素級預測上進行操作,而不區分不同的身份。

在現實世界場景中,多人互動的設定更加真實和常見。因此,非常需要一個任務、相應的資料集和基線方法來考慮每個人的細粒度語義資訊以及整個群體的關係和交互作用。

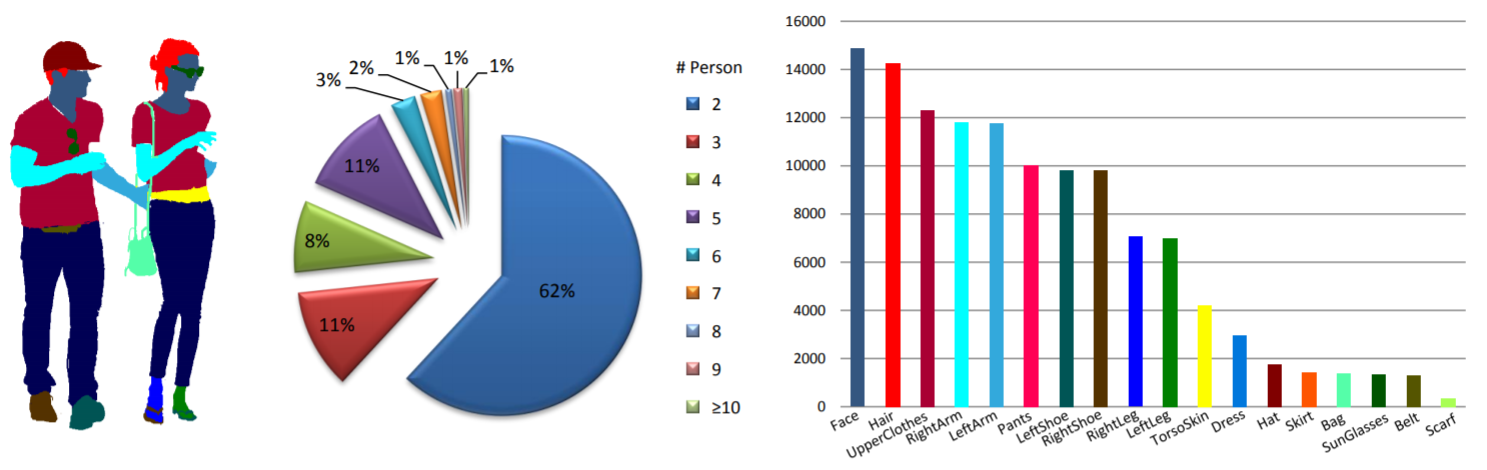

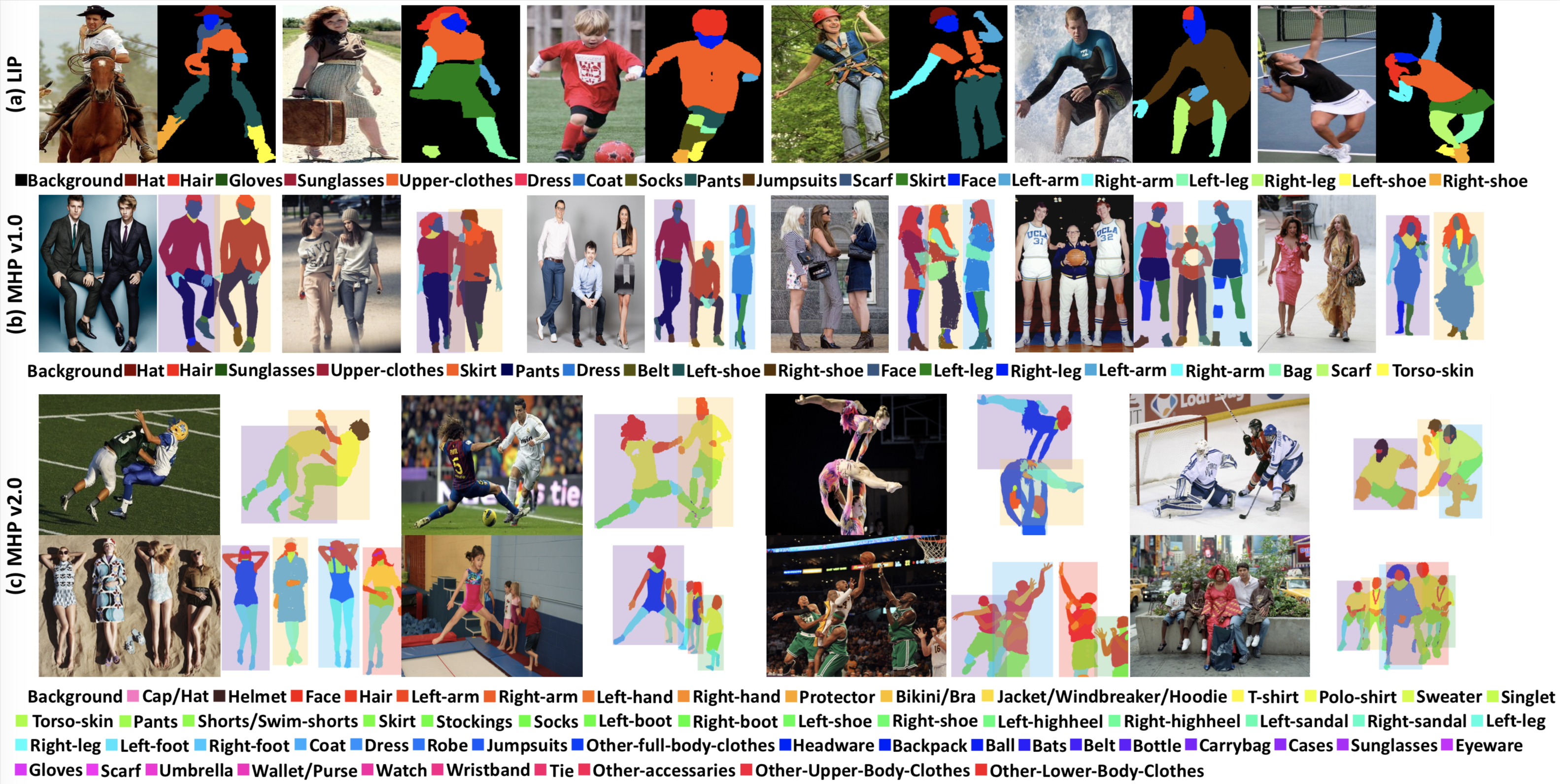

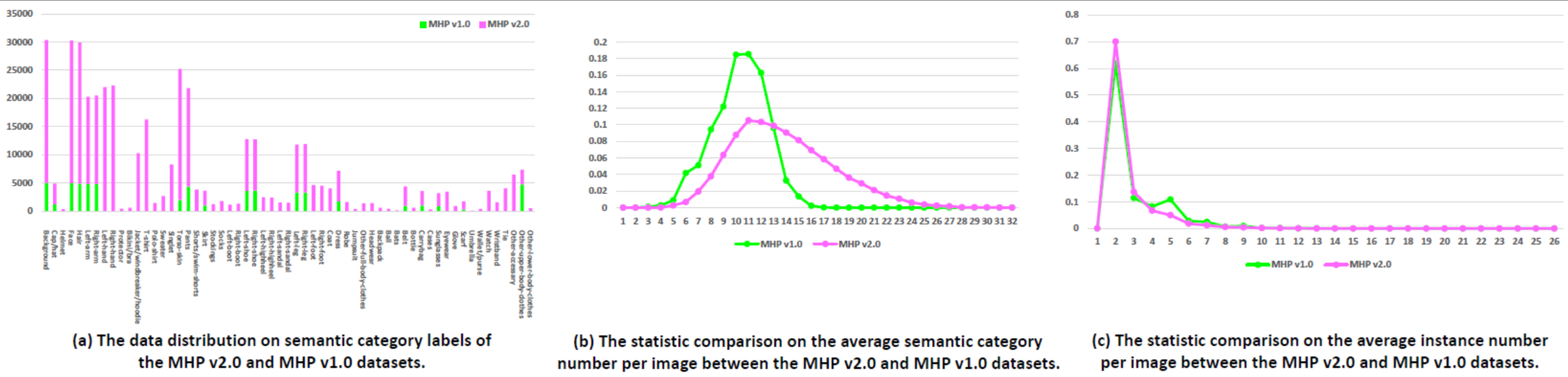

統計數據:MHP v1.0 資料集包含 4,980 張圖像,每張圖像至少有兩個人(平均為 3 個)。我們隨機選擇 980 張圖像及其對應的註釋作為測試集。其餘的形成 3,000 張影像的訓練集和 1,000 張影像的驗證集。對於每個實例,除了“背景”類別之外,定義和註釋了18個語義類別,即“帽子”、“頭髮”、“太陽眼鏡”、“上衣”、“裙子”、“褲子”、“連身裙” 、「皮帶」、「左鞋」、「右鞋」、「臉」、「左腿」、「右腿」、「左臂」、「右臂」、「包包」、「圍巾」和「軀幹皮膚」。每當當前影像中出現相應類別時,每個實例都有一組完整的註釋。

微信新聞。

下載:MHP v1.0資料集可在googledrive和baidudrive下載(密碼:cmtp)。

請參閱我們的 MHP v1.0 論文(提交給 IJCV)以了解更多詳細資訊。

統計:MHP v2.0 資料集包含 25,403 張影像,每張影像至少有兩個人(平均為 3 張)。我們隨機選擇 5,000 張圖像及其對應的註釋作為測試集。其餘的形成 15,403 張圖像的訓練集和 5,000 張圖像的驗證集。對於每個實例,定義和註釋了除“背景”類別之外的 58 個語義類別,即“帽子”、“頭盔”、“臉”、“頭髮”、“左臂”、“右臂”、 “左手」、「右手」、「護具」、「比基尼/胸罩」、「夾克/風衣/連帽衫」、「T卹」、「polo衫」、「毛衣」、「背心」、 “軀幹皮膚” 、「褲子」、「短褲/游泳短褲」、「裙子」、「絲襪」、「襪子」、「左靴」、「右靴」、「左鞋」、「右」 -鞋」、「左高跟」、「右高跟」、「左涼鞋」、「右涼鞋」、「左腿」、「右腿」、「左腳」、「右腳」 」、「外套」、「洋裝」、「長袍」 、「連身衣」、「其他全身衣服」、「頭飾」、「背包」、「球」、「球棒」、「腰帶」、「瓶子」 」、「手提包」、「箱子」、「太陽眼鏡」、「眼鏡」、「手套」、「圍巾」、「雨傘」、「錢包/錢包」、「手錶」、「腕帶」、「領帶」、「其他」 -配件」、「其他上半身衣服」和「其他下半身衣服」。每當當前影像中出現相應類別時,每個實例都有一組完整的註釋。此外,2D人體姿勢具有16個密集關鍵點(“右肩”,“右肘”,“右手腕”,“左肩”,“左肘”,“左手腕”,“右-臀部”、“右膝蓋」、「右腳踝」、「左臀部」、「左膝蓋」、「左腳踝」、「頭部」、「頸部」、「脊椎」和「骨盆」。每個關鍵點都有一個標誌,指示它是否可見(0/遮擋-1/圖像外-2),並且還提供頭部和實例邊界框以促進多人姿勢估計研究。

下載:MHP v2.0資料集可在googledrive和baidudrive下載(密碼:uxrb)。

請參閱我們的 MHP v2.0 論文(ACM MM'18 最佳學生論文)以了解更多詳細資訊。

多人解析:我們使用兩個以人為中心的指標進行多人解析評估,這最初由我們的 MHP v1.0 論文報告。這兩個指標是基於部分的平均精確度 (AP p ) (%) 和正確解析語意部分的百分比 (PCP) (%)。有關評估程式碼,請參閱我們的「Multi-Human-Parsing_MHP」儲存庫下的「Evaluation」資料夾。

多人姿勢估計:遵循 MPII,我們使用 mAP (%) 評估措施。

我們組織了 CVPR 2018 人群場景中人類視覺理解研討會(VUHCS 2018)。該研討會由新加坡國立大學、卡內基美隆大學和中山大學合作舉辦。在VUHCS 2017的基礎上,我們進一步加強了本次Workshop,增加了5個競賽賽道:單人人體解析、多人人體解析、單人姿態估計、多人姿態估計和精細化粒度多人解析。

結果提交和排行榜。

微信新聞。

請查閱並考慮引用以下論文:

@article{zhao2018understanding,

title={Understanding Humans in Crowded Scenes: Deep Nested Adversarial Learning and A New Benchmark for Multi-Human Parsing},

author={Zhao, Jian and Li, Jianshu and Cheng, Yu and Zhou, Li and Sim, Terence and Yan, Shuicheng and Feng, Jiashi},

journal={arXiv preprint arXiv:1804.03287},

year={2018}

}

@article{li2017towards,

title={Multi-Human Parsing in the Wild},

author={Li, Jianshu and Zhao, Jian and Wei, Yunchao and Lang, Congyan and Li, Yidong and Sim, Terence and Yan, Shuicheng and Feng, Jiashi},

journal={arXiv preprint arXiv:1705.07206},

year={2017}

}