CoDA_NeurIPS2023

1.0.0

請給 CoDA 星標並分享。謝謝

[論文] [專案頁]

曹陽、曾一涵、徐航、徐丹

香港科技大學

華為諾亞方舟實驗室

更新

☑ 作為第一個將 3D 高斯分佈引入 3D 物體檢測的作品,3DGS-DET 在這裡發布!

☑ 我們的擴展工作CoDAv2已發布,請在 arXiv 上查看!

☑ 這裡收集了有關開放詞彙感知的最新論文和程式碼。

☑ 所有程式碼、資料和預訓練模型已發布!

☑ 訓練和測試程式碼已發布。

☑ 預訓練模型已發布。

☑ OV設定SUN-RGBD資料集已發布。

☑ OV設定的ScanNet資料集已發布。

☑ 紙本 LaTeX 代碼可在 https://scienhub.com/Yang/CoDA 上取得。

我們的程式碼是基於 PyTorch 1.8.1、torchvision==0.9.1、CUDA 10.1 和 Python 3.7。它可能適用於其他版本。

另請安裝以下 Python 依賴項:

matplotlib

opencv-python

plyfile

'trimesh>=2.35.39,<2.35.40'

'networkx>=2.2,<2.3'

scipy

請透過運行安裝pointnet2層

cd third_party/pointnet2 && python setup.py install

請安裝 gIOU 的 Cythonized 實現以加快訓練速度。

conda install cython

cd utils && python cython_compile.py build_ext --inplace

為了實現OV設置,我們重新組織了原始的ScanNet和SUN RGB-D,並採用了更多類別的標註。請直接下載我們在這裡提供的ov設定資料集:OV SUN RGB-D和OV ScanNet。您也可以透過執行以下命令輕鬆下載它們:

bash data_download.sh

然後運行下載的 *.tar 檔案:

bash data_preparation.sh

在此下載預訓練模型。然後運行:

bash test_release_models.sh

bash scripts/coda_sunrgbd_stage1.sh

bash scripts/coda_sunrgbd_stage2.sh

bash run_samples.sh

如果 CoDA 有幫助,請引用:

@inproceedings{cao2023coda,

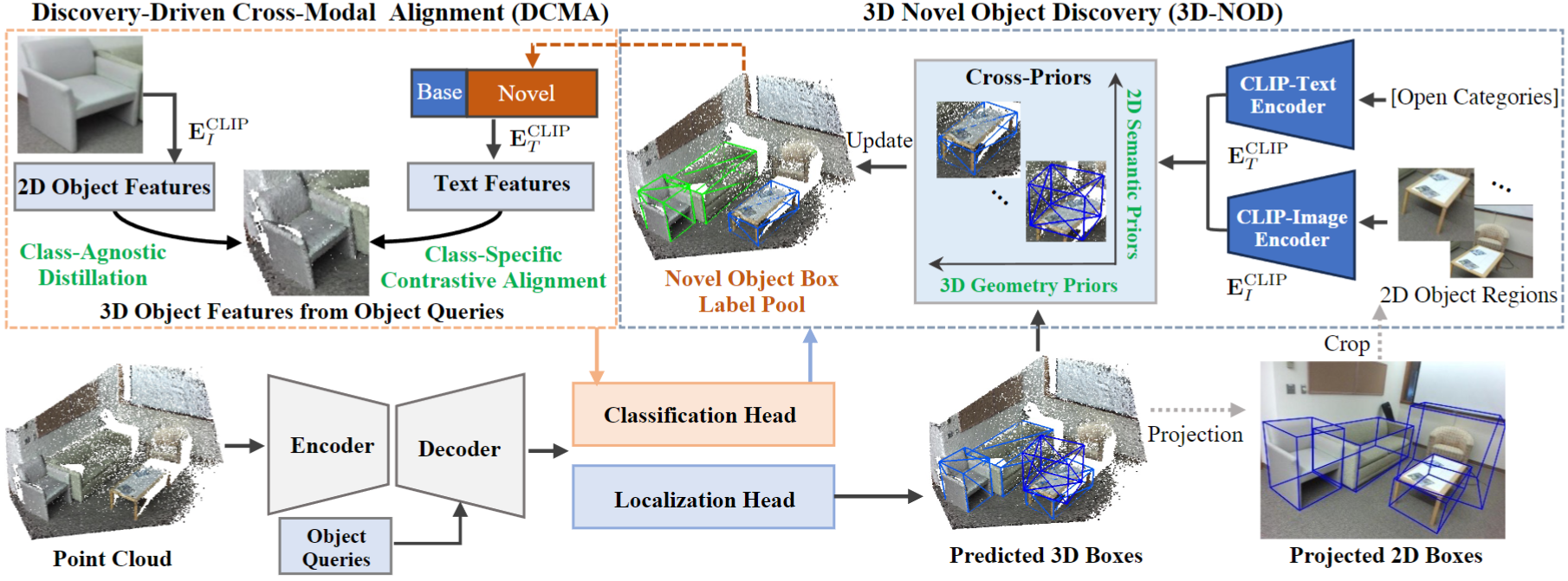

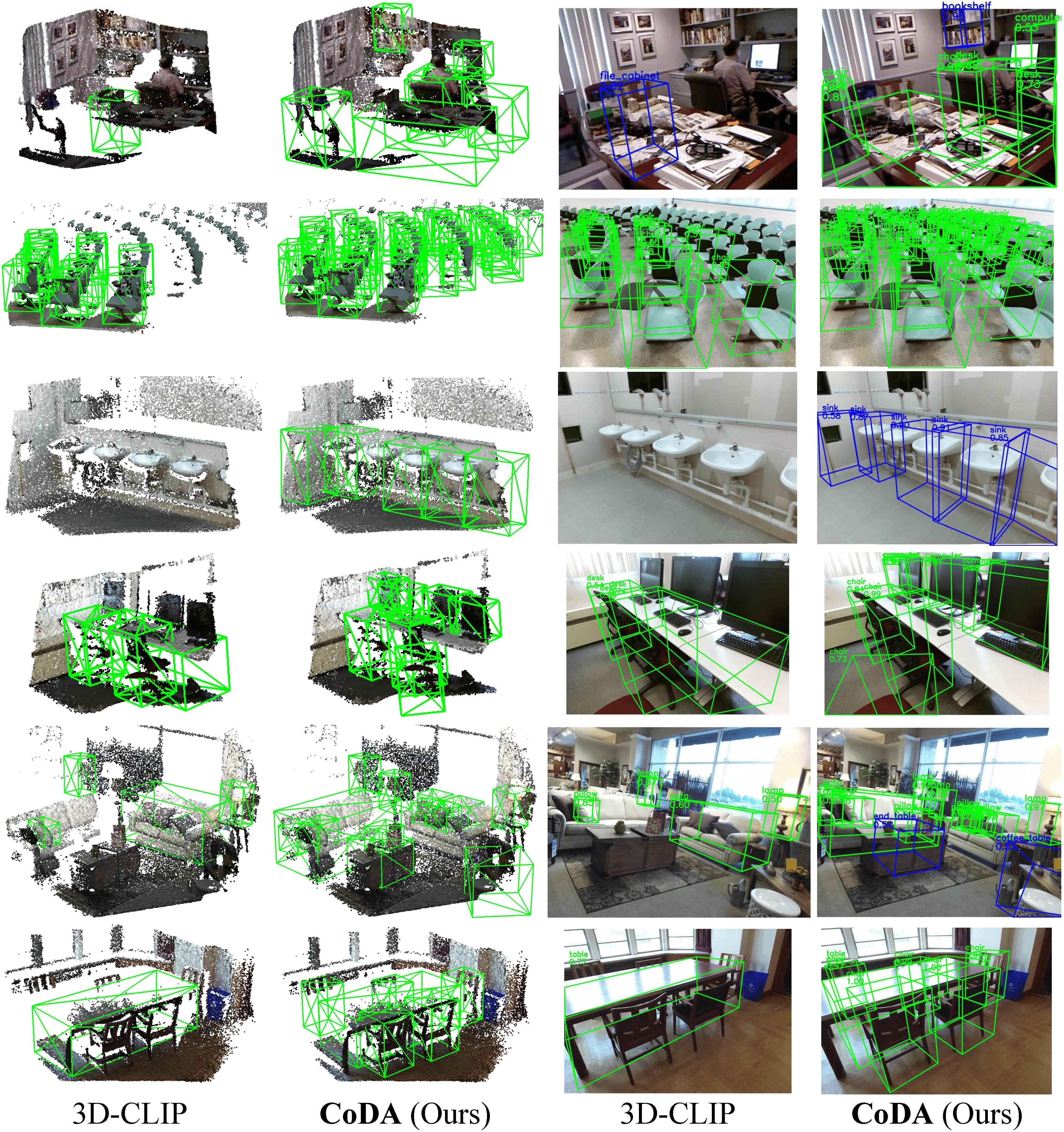

title={CoDA: Collaborative Novel Box Discovery and Cross-modal Alignment for Open-vocabulary 3D Object Detection},

author={Cao, Yang and Zeng, Yihan and Xu, Hang and Xu, Dan},

booktitle={NeurIPS},

year={2023}

}

@misc{cao2024collaborative,

title={Collaborative Novel Object Discovery and Box-Guided Cross-Modal Alignment for Open-Vocabulary 3D Object Detection},

author={Yang Cao and Yihan Zeng and Hang Xu and Dan Xu},

year={2024},

eprint={2406.00830},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2406.00830},

}

如果您有任何疑問或合作需求(研究目的或商業目的),請發送電子郵件[email protected] 。

CoDA 的靈感來自於 CLIP 和 3DETR。我們欣賞他們偉大的代碼。