علم محرر Downcodes أن Ai2، وهي مؤسسة بحثية غير ربحية تعمل في مجال الذكاء الاصطناعي، أصدرت مؤخرًا سلسلة OLMo2 الجديدة من نماذج اللغة، وهي الجيل الثاني من سلسلة "نموذج اللغة المفتوحة" (OLMo). تلتزم OLMo2 بمفهوم التعليمات البرمجية مفتوحة المصدر تمامًا، كما أن بيانات التدريب والأدوات والأكواد الخاصة بها مفتوحة بالكامل. وهذا مهم بشكل خاص في مجال الذكاء الاصطناعي اليوم ويمثل ارتفاعًا جديدًا في تطوير الذكاء الاصطناعي مفتوح المصدر. على عكس النماذج الأخرى التي تدعي أنها "مفتوحة"، تتبع OLMo2 بدقة تعريف مبادرة المصدر المفتوح، وتلبي المعايير الصارمة للذكاء الاصطناعي مفتوح المصدر، وتوفر لمجتمع الذكاء الاصطناعي دعمًا فنيًا قويًا وموارد تعليمية قيمة.

أصدرت Ai2، وهي منظمة بحثية غير ربحية تعمل في مجال الذكاء الاصطناعي، مؤخرًا سلسلة OLMo2 الجديدة، وهي نموذج الجيل الثاني من سلسلة "نموذج اللغة المفتوحة" (OLMo) التي أطلقتها المنظمة. لا يوفر إصدار OLMo2 دعمًا فنيًا قويًا لمجتمع الذكاء الاصطناعي فحسب، بل يمثل أيضًا أحدث تطور للذكاء الاصطناعي مفتوح المصدر بكوده مفتوح المصدر تمامًا.

على عكس نماذج اللغات "المفتوحة" الأخرى الموجودة حاليًا في السوق مثل سلسلة Meta's Llama، فإن OLMo2 يلبي التعريف الصارم لمبادرة المصدر المفتوح، مما يعني أن بيانات التدريب والأدوات والتعليمات البرمجية المستخدمة لتطويره عامة ويمكن لأي شخص الوصول إليها يستخدم. وفقًا لتعريف مبادرة المصدر المفتوح، يلبي OLMo2 متطلبات المنظمة لمعيار "الذكاء الاصطناعي مفتوح المصدر"، والذي تم الانتهاء منه في أكتوبر من هذا العام.

ذكرت Ai2 في مدونتها أنه خلال عملية تطوير OLMo2، كانت جميع بيانات التدريب والرموز وخطط التدريب وطرق التقييم ونقاط التفتيش الوسيطة مفتوحة بالكامل، بهدف تعزيز الابتكار والاكتشاف في مجتمع المصادر المفتوحة من خلال الموارد المشتركة. وقال Ai2: "من خلال المشاركة العلنية لبياناتنا وحلولنا ونتائجنا، نأمل أن نزود مجتمع المصادر المفتوحة بالموارد اللازمة لاكتشاف أساليب جديدة وتقنيات مبتكرة."

تشتمل سلسلة OLMo2 على نسختين: أحدهما هو OLMo7B مع 7 مليار معلمة، والآخر هو OLMo13B مع 13 مليار معلمة. يؤثر عدد المعلمات بشكل مباشر على أداء النموذج، ويمكن للإصدارات التي تحتوي على المزيد من المعلمات عادةً التعامل مع المهام الأكثر تعقيدًا. كان أداء OLMo2 جيدًا في المهام النصية الشائعة، حيث كان قادرًا على إكمال المهام مثل الإجابة على الأسئلة وتلخيص المستندات وكتابة التعليمات البرمجية.

ملاحظة لمصدر الصورة: تم إنشاء الصورة بواسطة الذكاء الاصطناعي، والصورة معتمدة من قبل مزود الخدمة Midjourney

لتدريب OLMo2، استخدم Ai2 مجموعة بيانات تحتوي على خمسة تريليونات من الرموز المميزة. الرمز هو أصغر وحدة في نموذج اللغة، مليون رمز يساوي تقريبًا 750.000 كلمة. تتضمن بيانات التدريب محتوى من مواقع الويب عالية الجودة، والأوراق الأكاديمية، ولوحات مناقشة الأسئلة والأجوبة، ومصنفات الرياضيات الاصطناعية، ويتم اختيارها بعناية لضمان كفاءة النموذج ودقته.

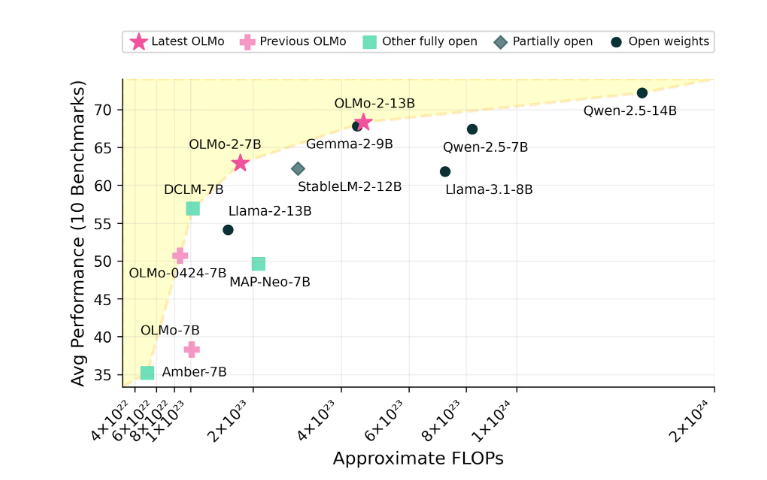

Ai2 واثق من أداء OLMo2، مدعيًا أنه تنافس مع نماذج مفتوحة المصدر مثل Meta’s Llama3.1 في الأداء. وأشار Ai2 إلى أن أداء OLMo27B تجاوز حتى Llama3.18B وأصبح أحد أقوى نماذج اللغات المفتوحة بالكامل حاليًا. يمكن تنزيل جميع نماذج OLMo2 ومكوناتها مجانًا من خلال الموقع الرسمي لـ Ai2 واتباع ترخيص Apache2.0، مما يعني أنه يمكن استخدام هذه النماذج ليس فقط للبحث ولكن أيضًا للتطبيقات التجارية.

إن طبيعة المصدر المفتوح لـ OLMo2 ستعزز بشكل كبير التعاون المفتوح والابتكار في مجال الذكاء الاصطناعي، مما يوفر للباحثين والمطورين مساحة أوسع للتطوير. ونحن نتطلع إلى أن يحقق OLMo2 المزيد من الإنجازات والتطبيقات في المستقبل.