علم محرر Downcodes أن DeepSeek، وهي شركة تابعة لشركة Magic Square Quantitative الصينية العملاقة للأسهم الخاصة، أصدرت مؤخرًا أحدث نموذج لغوي واسع النطاق يركز على الاستدلال R1-Lite-Preview. هذا النموذج مفتوح حاليًا فقط للجمهور من خلال منصة الدردشة على الويب DeepSeek Chat، وقد اجتذب أدائه اهتمامًا واسع النطاق، حتى أنه يقترب أو يتجاوز نموذج المعاينة o1 الذي أصدرته OpenAI مؤخرًا. تشتهر DeepSeek بمساهماتها في النظام البيئي للذكاء الاصطناعي مفتوح المصدر، ويواصل هذا الإطلاق التزامها بإمكانية الوصول والشفافية.

أصدرت DeepSeek، وهي شركة تابعة لشركة Huifang Quantitative الصينية العملاقة للأسهم الخاصة، مؤخرًا أحدث نموذج لغوي واسع النطاق يركز على الاستدلال R1-Lite-Preview. النموذج متاح حاليًا للعامة فقط من خلال DeepSeek Chat، وهي منصة chatbot على الويب.

تشتهر DeepSeek بمساهماتها المبتكرة في النظام البيئي للذكاء الاصطناعي مفتوح المصدر، ويهدف هذا الإصدار الجديد إلى توفير قدرات استدلال عالية المستوى للجمهور مع الحفاظ على الالتزام بإمكانية الوصول والشفافية. على الرغم من أن R1-Lite-Preview متوفر حاليًا فقط في تطبيقات الدردشة، فقد اجتذب اهتمامًا واسع النطاق بأداء قريب أو حتى يتجاوز نموذج o1-preview الذي تم إصداره مؤخرًا من OpenAI.

يستخدم R1-Lite-Preview منطق "التفكير المتسلسل"، والذي يمكنه إظهار عمليات التفكير المختلفة التي يمر بها عند الرد على استعلامات المستخدم.

على الرغم من أن بعض سلاسل التفكير قد تبدو غير منطقية أو خاطئة بالنسبة للبشر، إلا أن إجابات R1-Lite-Preview دقيقة للغاية ويمكنها أيضًا حل "الفخاخ" التي تواجهها بعض نماذج الذكاء الاصطناعي القوية التقليدية مثل أسئلة سلسلة GPT-4o وClaude. مثل كم عدد حروف الراء الموجودة في كلمة "فراولة"؟ "أيهما أكبر، 9.11 أم 9.9؟"

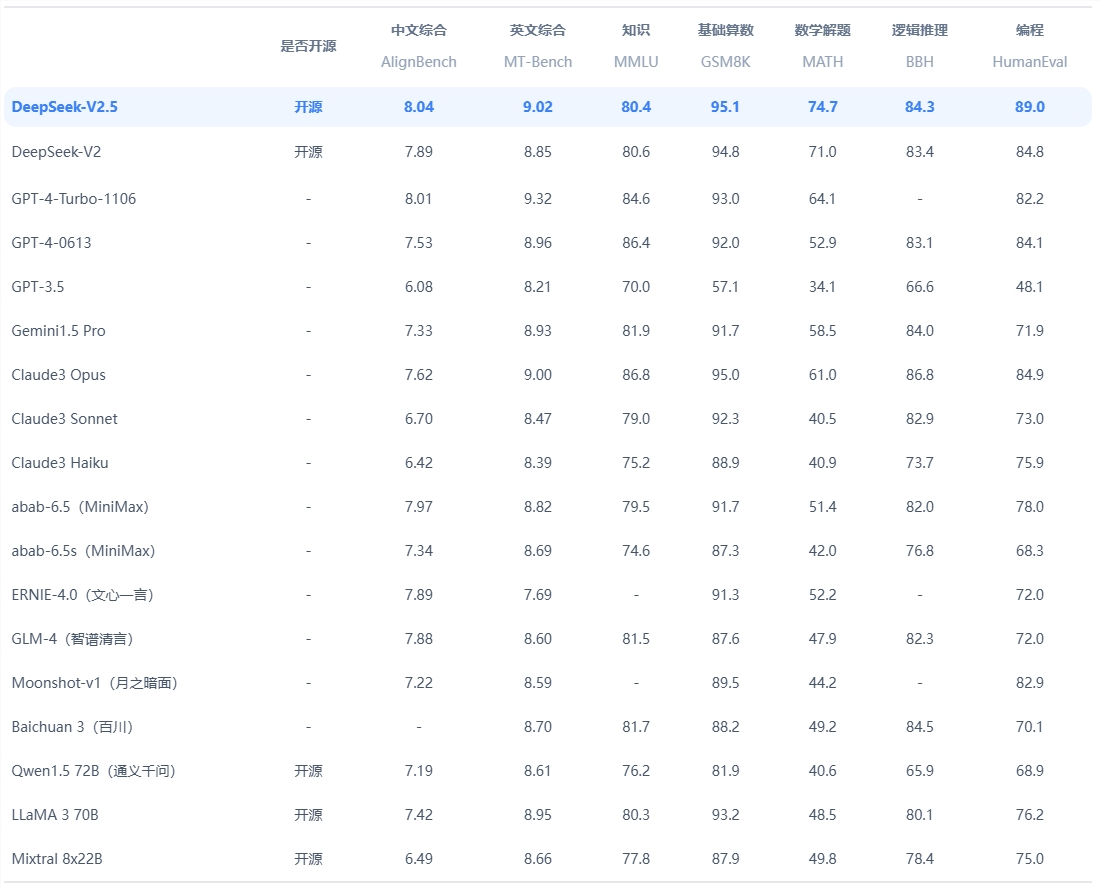

وفقًا لـ DeepSeek، يتفوق النموذج في المهام التي تتطلب التفكير المنطقي والتفكير الرياضي وحل المشكلات في الوقت الفعلي. ويتجاوز أدائه مستوى معاينة OpenAI o1 في المعايير المعمول بها مثل AIME (اختبار الرياضيات الدعوي الأمريكي) وMATH.

بالإضافة إلى ذلك، أصدرت DeepSeek بيانات موسعة عن النموذج، مما يدل على تحسن مطرد في الدقة عندما يتم منح النموذج المزيد من الوقت، أو "رموز التفكير" لحل المشكلة. يسلط الرسم البياني الضوء على أنه مع زيادة عمق التفكير، تتحسن درجة النموذج في المعايير مثل AIME.

يعمل الإصدار الحالي من R1-Lite-Preview بشكل جيد في المعايير الرئيسية، وهو قادر على التعامل مع مجموعة من المهام بدءًا من الرياضيات المعقدة وحتى السيناريوهات المنطقية، مع نتائج مماثلة لأفضل نماذج الاستدلال مثل GPQA وCodeforces. تتيح عملية الاستدلال الشفافة للنموذج للمستخدمين مراقبة خطواته المنطقية في الوقت الفعلي، مما يعزز إحساس النظام بالمسؤولية والمصداقية.

تجدر الإشارة إلى أن DeepSeek لم تصدر الكود الكامل للتحليل أو القياس المستقل لجهة خارجية، ولم توفر واجهة API للاختبار المستقل. ولم تنشر الشركة بعد منشورات مدونة ذات صلة أو مستندات فنية تصف التدريب أو الاختبار هيكل R1-Lite-Preview، مما يجعل الأصل وراءه لا يزال مليئًا بالشكوك.

يتوفر R1-Lite-Preview حاليًا مجانًا من خلال DeepSeek Chat (chat.deepseek.com)، ولكن وضع "التفكير العميق" المتقدم الخاص به يقتصر على 50 رسالة يوميًا، مما يسمح للمستخدمين بتجربة إمكاناته القوية. تخطط DeepSeek لإصدار إصدارات مفتوحة المصدر من نماذج سلسلة R1 وواجهات برمجة التطبيقات ذات الصلة لمزيد من الدعم لتطوير مجتمع الذكاء الاصطناعي مفتوح المصدر.

يستمر DeepSeek في دفع الابتكار في مجال الذكاء الاصطناعي مفتوح المصدر، ويضيف إصدار R1-Lite-Preview بعدًا جديدًا لاستدلاله وقابلية التوسع. وبينما تستكشف الشركات والباحثون تطبيقات الذكاء الاصطناعي المعتمد على الاستدلال المكثف، فإن التزام DeepSeek بالانفتاح سيضمن أن تصبح نماذجها مورداً مهماً للتنمية والابتكار.

المدخل الرسمي: https://www.deepseek.com/

بشكل عام، يوضح R1-Lite-Preview قوة DeepSeek القوية في مجال نماذج اللغات واسعة النطاق، كما أن خطتها مفتوحة المصدر تستحق التطلع إليها أيضًا. ومع ذلك، فإن عدم الكشف عن التعليمات البرمجية والوثائق الفنية يلقي أيضًا طبقة من الغموض على تفاصيله الفنية. سيستمر محرر Downcodes في الاهتمام بالتقدم اللاحق لـ DeepSeek.