علم محرر Downcodes أن معهد Allen للذكاء الاصطناعي (Ai2) أطلق مؤخرًا Molmo، وهي عائلة نماذج ذكاء اصطناعي جديدة متعددة الوسائط ومفتوحة المصدر، وأداؤها مذهل، حتى أنها تتفوق على GPT-4o من OpenAI وAnthropic في اختبارات مرجعية متعددة تابعة لجهات خارجية. Claude3.5Sonnet وGoogle's Gemini1.5. لا يقوم Molmo بتحليل الصور التي يحمّلها المستخدم فحسب، بل يستخدم أيضًا بيانات أقل بمقدار 1000 مرة أثناء التدريب مقارنة بمنافسيه، وذلك بفضل تقنيات التدريب الفريدة الخاصة به. يوضح هذا الإنجاز التزام Ai2 بالأبحاث المفتوحة، مما يجعل النماذج عالية الأداء والأوزان المفتوحة والبيانات متاحة للمجتمع والمؤسسات على نطاق أوسع.

لا يقبل Molmo الصور التي يحمّلها المستخدم للتحليل فحسب، بل يستخدم أيضًا "بيانات أقل بـ 1000 مرة من المنافسين" للتدريب، وذلك بفضل تقنيات التدريب الفريدة الخاصة به.

يوضح هذا الإصدار التزام Ai2 بالبحث المفتوح، وتوفير نماذج عالية الأداء ذات أوزان مفتوحة وبيانات للاستخدام من قبل المجتمع والمؤسسات الأوسع. تضم عائلة Molmo أربعة نماذج رئيسية، وهي Molmo-72B، وMolmo-7B-D، وMolmo-7B-O، وMolmoE-1B هو النموذج الرئيسي، الذي يحتوي على 7.2 مليار معلمة، وأدائه متميز بشكل خاص.

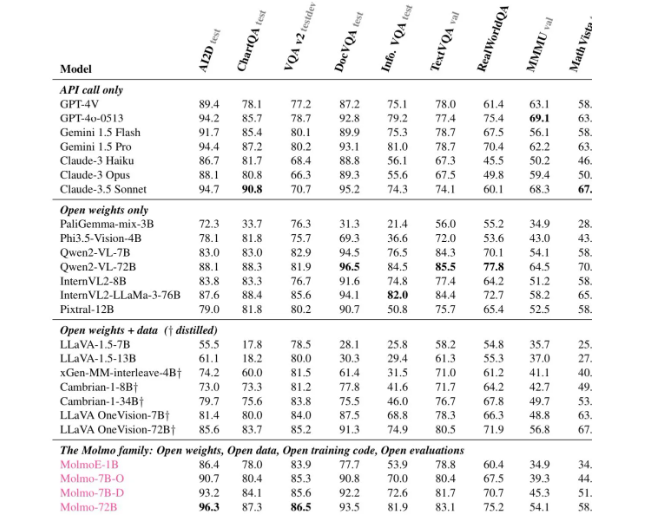

وفقًا لتقييمات مختلفة، حصل Molmo-72B على أعلى الدرجات في 11 معيارًا مهمًا، واحتل المرتبة الثانية بعد -4o من حيث تفضيل المستخدم. أطلقت Ai2 أيضًا نموذج OLMoE، باستخدام نهج "مجموعة النماذج الصغيرة" لتحسين فعالية التكلفة.

لقد تم تصميم بنية Molmo بعناية لتحقيق الكفاءة والأداء المتفوق. تستخدم جميع الطرز نموذج ViT-L/14336px CLIP من OpenAI باعتباره برنامج التشفير المرئي لمعالجة الصور متعددة المقاييس إلى أوامر مرئية. جزء نموذج اللغة هو محول فك التشفير، وهو ذو قدرات وانفتاح مختلفين.

فيما يتعلق بالتدريب، يخضع Mol لمرحلتين من التدريب: الأولى، التدريب المسبق متعدد النماذج، والثانية، الضبط الدقيق تحت الإشراف. على عكس العديد من النماذج الحديثة، لا يعتمد Molmo على التعلم المعزز من خلال ردود الفعل البشرية، ولكنه يقوم بدلاً من ذلك بتحديث معلمات النموذج من خلال عملية تدريب مضبوطة بعناية.

كان أداء Molmo جيدًا في العديد من المعايير، خاصة في المهام المعقدة مثل قراءة المستندات والتفكير البصري، مما يدل على قدراتها القوية. وقد أصدرت Ai2 هذه النماذج ومجموعات البيانات على Hugging Face، وستطلق المزيد من النماذج والتقارير الفنية الموسعة في الأشهر المقبلة لتوفير المزيد من الموارد للباحثين.

إذا كنت تريد التعرف على قدرات Molmo، فالعروض التوضيحية العامة متاحة الآن من خلال موقع Molmo الرسمي (https://molmo.allenai.org/).

تسليط الضوء على:

يتفوق نموذج الذكاء الاصطناعي المشروط مفتوح المصدر من Ai2Molmo على أفضل المنتجات في الصناعة.

أداء Mol-72B جيد في معايير متعددة، في المرتبة الثانية بعد GPT4o.

إنه مفتوح للغاية، ويمكن للباحثين استخدام النماذج ومجموعات البيانات بحرية.

وبشكل عام، يمثل ظهور مولمو تقدمًا كبيرًا في مجال الذكاء الاصطناعي متعدد الوسائط، كما توفر طبيعته مفتوحة المصدر أيضًا موارد قيمة للباحثين في جميع أنحاء العالم. يأمل محرر Downcodes أن يتم استخدام Molmo وتطويره على نطاق أوسع في المستقبل وتعزيز التقدم المستمر لتكنولوجيا الذكاء الاصطناعي.