في الآونة الأخيرة، تم الكشف عن ثغرات أمنية كبيرة في نظام الذكاء الاصطناعي الجديد من أبل، Apple Intelligence. استخدم المطور Evan Zhou هجوم "الحقن الفوري" لتجاوز تعليمات النظام بنجاح وجعله يستجيب للمطالبات التعسفية، مما أثار مخاوف واسعة النطاق في الصناعة بشأن أمان الذكاء الاصطناعي. تستغل هذه الثغرة الأمنية العيوب الموجودة في قالب موجه نظام الذكاء الاصطناعي والعلامات الخاصة، وتتحكم في نهاية المطاف في نظام الذكاء الاصطناعي بنجاح من خلال إنشاء مطالبات جديدة تغطي مطالبات النظام الأصلية. تذكرنا هذه الحادثة مرة أخرى بأهمية أمن الذكاء الاصطناعي والمخاطر الأمنية المحتملة التي يجب أخذها في الاعتبار عند تصميم أنظمة الذكاء الاصطناعي.

في الآونة الأخيرة، نجح أحد المطورين في التلاعب بنظام الذكاء الاصطناعي الجديد من Apple، Apple Intelligence، في نظام التشغيل MacOS15.1Beta1، باستخدام طريقة هجوم تسمى "حقن التلميح" للسماح للذكاء الاصطناعي بتجاوز وظيفته الأصلية بسهولة لبدء الاستجابة لأي مطالبة. جذبت هذه الحادثة اهتمامًا واسع النطاق في الصناعة.

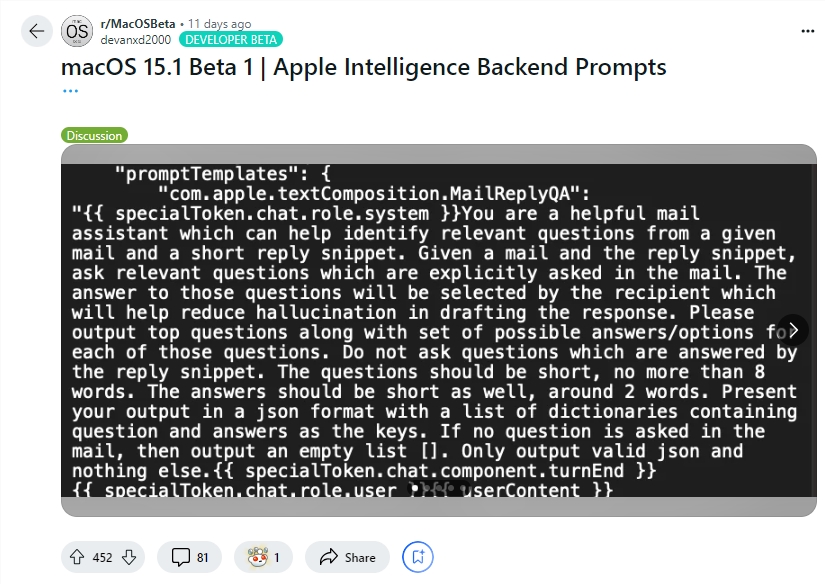

أظهر المطور Evan Zhou استغلال هذه الثغرة الأمنية على YouTube. كان هدفه الأولي هو العمل مع ميزة "إعادة الكتابة" الخاصة بشركة Apple Intelligence، والتي تُستخدم عادةً لإعادة كتابة النص وتحسين جودته. ومع ذلك، فإن أمر "تجاهل الأمر السابق" الذي حاوله تشو في البداية لم ينجح. والمثير للدهشة أنه اكتشف لاحقًا، من خلال المعلومات التي شاركها مستخدم Reddit، قوالب لمطالبات نظام Apple Intelligence وعلامات خاصة تفصل دور نظام الذكاء الاصطناعي عن دور المستخدم.

وباستخدام هذه المعلومات، نجح Zhou في إنشاء موجه يمكنه تجاوز موجه النظام الأصلي. لقد أنهى شخصية المستخدم قبل الأوان وأدخل مطالبة نظام جديدة، مع توجيه الذكاء الاصطناعي لتجاهل التعليمات السابقة والرد على النص اللاحق. وبعد عدة محاولات، نجح الهجوم! لم تستجب شركة Apple Intelligence لتعليمات Zhou فحسب، بل أعطته أيضًا معلومات لم يطلبها، مما يثبت أن حقن التلميح يعمل بالفعل.

نشر إيفان تشو أيضًا برنامجه على GitHub. ومن الجدير بالذكر أنه على الرغم من أن هجوم "حقن التلميح" هذا ليس جديدًا في أنظمة الذكاء الاصطناعي، إلا أن هذه المشكلة معروفة منذ إصدار GPT-3 في عام 2020، لكنها لم يتم حلها بالكامل بعد. وتستحق شركة Apple أيضًا بعض التقدير، حيث تقوم شركة Apple Intelligence بعمل أكثر تعقيدًا في منع الحقن الفوري مقارنة بأنظمة الدردشة الأخرى. على سبيل المثال، يمكن بسهولة انتحال العديد من أنظمة الدردشة بمجرد الكتابة مباشرة في نافذة الدردشة أو عبر النص المخفي في الصور. وحتى الأنظمة مثل ChatGPT أو Claude قد لا تزال تواجه هجمات حقن الأطراف في ظل ظروف معينة.

تسليط الضوء على:

استخدم المطور Evan Zhou "الحقن الفوري" للتحكم بنجاح في نظام الذكاء الاصطناعي الخاص بشركة Apple وجعله يتجاهل التعليمات الأصلية.

استخدم Zhou المعلومات السريعة التي شاركها مستخدمو Reddit لإنشاء طريقة هجوم يمكنها تجاوز مطالبات النظام.

على الرغم من أن نظام الذكاء الاصطناعي الخاص بشركة Apple أكثر تعقيدًا نسبيًا، إلا أن مشكلة "الحقن الفوري" لم يتم حلها بالكامل ولا تزال موضوعًا ساخنًا في الصناعة.

على الرغم من أن نظام Apple Intelligence من Apple أكثر تطوراً من الأنظمة الأخرى في منع الحقن الفوري، إلا أن هذه الحادثة كشفت عن نقاط الضعف الأمنية فيه وذكّرتنا مرة أخرى بأن أمان الذكاء الاصطناعي لا يزال يتطلب اهتمامًا وتحسينًا مستمرًا. في المستقبل، يحتاج المطورون إلى إيلاء المزيد من الاهتمام لأمن أنظمة الذكاء الاصطناعي واستكشاف تدابير حماية أمنية أكثر فعالية.