أثارت شركة Adobe، باعتبارها عملاقًا في مجال البرمجيات الإبداعية، جدلاً كبيرًا من خلال تحديث شروط الخدمة الخاصة بها. يسمح هذا التحديث لشركة Adobe بالوصول إلى أعمال المستخدم لتحسين نموذج الذكاء الاصطناعي الخاص بها Firefly، وهي خطوة تم انتقادها على نطاق واسع باعتبارها "شرطًا أعلى" ينتهك حقوق الطبع والنشر والخصوصية للمستخدمين. ستقدم هذه المقالة تحليلًا متعمقًا للجدل الناجم عن تحديث شروط خدمة Adobe، واستكشاف الأسباب الكامنة وراء ذلك، والعلاقة المتوترة بشكل متزايد بين شركات التكنولوجيا والمستخدمين.

يُعرف Adobe، وهو اسم معروف في الصناعات الإبداعية، باسم "حارس حقوق الطبع والنشر" لموقفه بشأن حماية حقوق الطبع والنشر. لكن في الآونة الأخيرة، وقعت الشركة في دوامة الرأي العام بسبب شروط الخدمة المحدثة بهدوء.

في فبراير من هذا العام، قامت شركة Adobe بهدوء بتحديث شروط خدمة منتجها، مضيفة إضافة ملفتة للنظر: يجب أن يوافق المستخدمون على أن Adobe يمكنها الوصول إلى أعمالهم من خلال الوسائل الآلية واليدوية، بما في ذلك تلك المحمية بموجب اتفاقيات عدم الإفصاح. ستستخدم Adobe هذه الأعمال لتحسين خدماتها وبرامجها من خلال تقنيات مثل التعلم الآلي. إذا لم يوافق المستخدمون على هذه الشروط الجديدة، فلن يتمكنوا من استخدام برامج Adobe.

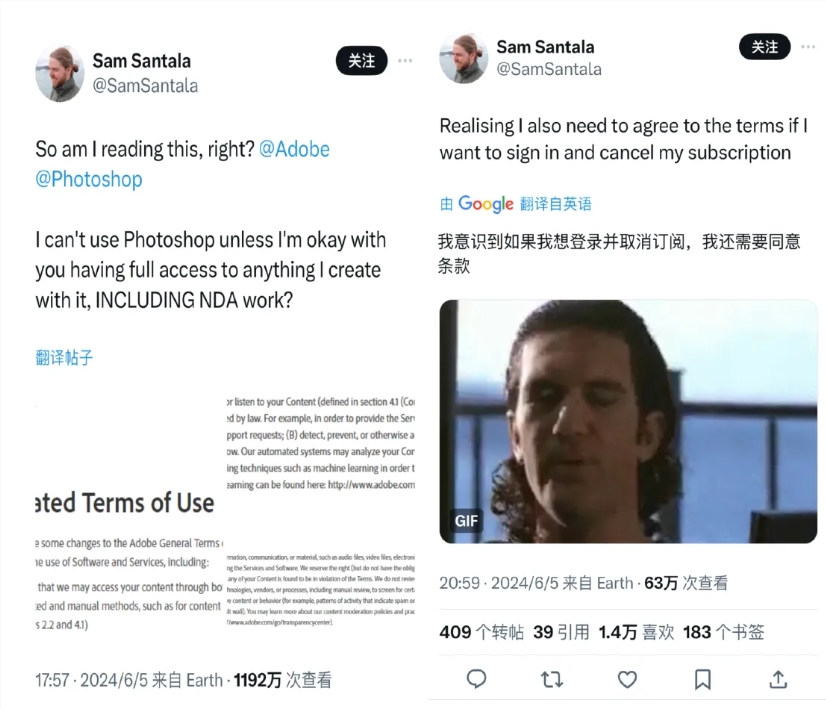

تم الكشف عن التغيير مؤخرًا، مما أثار رد فعل عنيفًا من مستخدمي Adobe الأساسيين بما في ذلك المبدعين والفنانين الرقميين والمصممين. إنهم يعتقدون أن هذا ترخيص إلزامي، وهو في الأساس "شرط أفرلورد"، والغرض الحقيقي منه هو تدريب نموذج الذكاء الاصطناعي التوليدي من Adobe "Firefly". وقد شكك أحد المدونين ويدعى سام سانتالا في هذا الحكم على موقع تويتر، وحظيت تغريدته بعشرات الملايين من المشاهدات.

أعرب العديد من المستخدمين عن مخاوفهم بشأن خصوصيتهم وحقوق الطبع والنشر واختاروا التوقف عن استخدام منتجات Adobe. وفي الوقت نفسه، اتخذت شركة Meta تدابير مماثلة وقامت بتحديث سياسة الخصوصية الخاصة بها للسماح باستخدام المعلومات التي يشاركها المستخدمون على منتجات وخدمات Meta لتدريب الذكاء الاصطناعي. إذا لم يوافق المستخدمون على سياسة الخصوصية الجديدة، فيجب عليهم التفكير في التوقف عن استخدام منتجات الوسائط الاجتماعية مثل Facebook وInstagram.

مع التطور السريع لتكنولوجيا الذكاء الاصطناعي، أصبحت المعركة بين شركات التكنولوجيا والمستخدمين حول خصوصية البيانات وملكية المحتوى والتحكم فيه شرسة بشكل متزايد. تدعي شركة Adobe أن بيانات التدريب الخاصة بنموذج Firefly الخاص بها تأتي من مئات الملايين من الصور الموجودة في مكتبة صور Adobe، وبعض الصور المرخصة بشكل عام، والصور العامة التي انتهت صلاحية حماية حقوق النشر الخاصة بها. ومع ذلك، فإن أدوات إنشاء صور الذكاء الاصطناعي الأخرى، مثل Stable Diffusion وDall-E2 وMidjourney من OpenAI، كانت مثيرة للجدل بسبب قضايا حقوق النشر.

تحاول شركة Adobe تبني موقع سوقي متباين في هذا المجال وتصبح "الفارس الأبيض" في سباق التسلح للذكاء الاصطناعي، مع التأكيد على شرعية بيانات التدريب النموذجية الخاصة بها، ووعدت بدفع المطالبات في نزاعات حقوق الطبع والنشر الناجمة عن استخدام الصور التي تم إنشاؤها بواسطة أدوبي اليراع. لكن الاستراتيجية لم تهدئ مخاوف جميع المستخدمين. بعض المستخدمين، مثل كبير المصممين Ajie، يطلقون على أنفسهم مازحين اسم "ضحايا Adobe الحقيقيين" ويعتقدون أن Adobe تستخدم نظامها البيئي الإبداعي الضخم لتدريب الذكاء الاصطناعي، على الرغم من أنها استراتيجية عمل ذكية، إلا أن النظام الأساسي وإنشاء توزيع الاهتمامات بين المستخدمين المستخدمين وحق المستخدم في المعرفة مفقود.

بالإضافة إلى ذلك، تم الكشف عن نزاعات حقوق الطبع والنشر مع Adobe بشكل متكرر في الخارج، مما دفع المستخدمين إلى التساؤل عما إذا كانت Adobe تحترم حقًا حقوق الطبع والنشر للمبدعين. على سبيل المثال، اكتشف الفنان بريان كيسنجر أن الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي والمشابهة لعمله تم بيعها باسمه في مكتبة صور Adobe دون موافقته. كما اتهمت ملكية المصور أنسل آدامز شركة Adobe علنًا ببيع نسخ طبق الأصل من الذكاء الاصطناعي لأعمال المصور الراحل.

وتحت ضغط من الرأي العام، قامت شركة Adobe بمراجعة شروط الخدمة الخاصة بها في 19 يونيو، موضحة أنها لن تستخدم محتوى المستخدم المخزن محليًا أو في السحابة لتدريب نماذج الذكاء الاصطناعي. لكن التوضيح لم يهدئ مخاوف المبدعين تمامًا. أشار بعض المدونين المشهورين في دائرة الذكاء الاصطناعي في الخارج إلى أن شروط خدمة Adobe المنقحة لا تزال تسمح باستخدام البيانات السحابية الخاصة للمستخدمين لتدريب نماذج التعلم الآلي لأدوات الذكاء الاصطناعي غير التوليدية. على الرغم من أنه يمكن للمستخدمين إلغاء الاشتراك في "تحليل المحتوى"، إلا أن عملية الإلغاء المعقدة غالبًا ما تؤدي إلى إبعاد العديد من المستخدمين.

لدى البلدان والمناطق المختلفة لوائح مختلفة بشأن حماية بيانات المستخدم، مما يؤثر أيضًا على استراتيجيات منصات الوسائط الاجتماعية عند صياغة شروط خدمة المستخدم. على سبيل المثال، بموجب اللائحة العامة لحماية البيانات (GDPR)، يتمتع المستخدمون في المملكة المتحدة والاتحاد الأوروبي "بالحق في الاعتراض" ويمكنهم اختيار صراحة عدم استخدام بياناتهم الشخصية لتدريب نماذج الذكاء الاصطناعي الخاصة بشركة Meta. ومع ذلك، ليس لدى المستخدمين الأمريكيين نفس الحق في المعرفة، وفقًا لسياسة مشاركة البيانات الحالية في Meta، ربما تم استخدام المحتوى الذي نشره المستخدمون الأمريكيون على منتجات الوسائط الاجتماعية الخاصة بـ Meta لتدريب الذكاء الاصطناعي دون موافقة صريحة.

لقد تم الترحيب بالبيانات باعتبارها "النفط الجديد" في عصر الذكاء الاصطناعي، ولكن لا تزال هناك العديد من المناطق الرمادية في "استغلال" الموارد. تبنت بعض شركات التكنولوجيا نهجًا غامضًا في الحصول على بيانات المستخدم، مما أدى إلى معضلة مزدوجة فيما يتعلق بحقوق المعلومات الشخصية للمستخدمين: ملكية حقوق الطبع والنشر الرقمية وقضايا خصوصية البيانات، مما ألحق ضررًا خطيرًا بثقة المستخدمين في النظام الأساسي.

في الوقت الحاضر، لا تزال المنصة تعاني من أوجه قصور كبيرة في ضمان عدم انتهاك الذكاء الاصطناعي التوليدي لحقوق المبدعين، كما أنها تفتقر أيضًا إلى الإشراف المناسب. اتخذ بعض المطورين والمبدعين إجراءات وأطلقوا سلسلة من أدوات "مكافحة الذكاء الاصطناعي"، بدءًا من أداة حماية العمل Glaze إلى أداة تسميم بيانات الذكاء الاصطناعي Nightshade، إلى مجتمع مكافحة الذكاء الاصطناعي Cara، الذي أصبح شائعًا في مواجهة الاستخدام غير المصرح به من قبل شركات التكنولوجيا للمستخدمين / المبدعين، بموافقة المؤلف، يتم التقاط البيانات ذات الصلة لتدريب نموذج الذكاء الاصطناعي، واشتداد غضب الناس.

اليوم، مع التطور السريع لتكنولوجيا الذكاء الاصطناعي، لا تزال كيفية تحقيق التوازن بين الابتكار التكنولوجي وأمن خصوصية المستخدم وحماية حقوق ومصالح المبدعين تتطلب مزيدًا من تطوير الصناعة والتحسين المستمر للتدابير التنظيمية القانونية. وفي الوقت نفسه، يحتاج المستخدمون إلى أن يكونوا أكثر يقظة، وأن يفهموا حقوق بياناتهم، وأن يتخذوا الإجراءات عند الضرورة لحماية إبداعاتهم وخصوصيتهم.

وما حادثة أدوبي إلا غيض من فيض من قضايا مقايضة البيانات في عصر الذكاء الاصطناعي. وفي المستقبل، ستصبح كيفية إيجاد توازن بين التقدم التكنولوجي وحقوق المستخدم قضية مهمة لجميع شركات التكنولوجيا والهيئات التنظيمية . ولن نتمكن من بناء بيئة بيئية صحية وأكثر استدامة للذكاء الاصطناعي إلا من خلال تعزيز الإشراف وتوضيح قواعد استخدام البيانات.