أصدرت Meta مؤخرًا ستة نتائج بحثية رئيسية في مجال الذكاء الاصطناعي، تغطي مجالات متعددة مثل النماذج متعددة الوسائط، والموسيقى المولدة للنصوص، وتكنولوجيا العلامات المائية الصوتية، ومجموعات البيانات، مما يدل على ابتكارها المستمر وقوتها التقنية في مجال الذكاء الاصطناعي. لا توفر نتائج البحث هذه إمكانيات جديدة للتطبيقات في مجال الذكاء الاصطناعي فحسب، بل توفر أيضًا مرجعًا قيمًا لاتجاهات التطوير التكنولوجي المستقبلية. يتم وصف هذه النتائج البحثية المثيرة للإعجاب بالتفصيل أدناه.

في الآونة الأخيرة، أصدرت شركة ميتا بهدوء ستة نتائج بحثية، جلبت معها تطبيقات جديدة واختراقات تكنولوجية في مجال الذكاء الاصطناعي. وتشمل هذه النماذج متعددة الوسائط، ونماذج الموسيقى المولدة بالنص، وتكنولوجيا العلامات المائية الصوتية، ومجموعات البيانات والمشاريع الأخرى. دعونا نلقي نظرة على النتائج المحددة لهذه الدراسات.

ميتا كاميليون (نموذج الحرباء)

بادئ ذي بدء، يمكن للنموذج متعدد الوسائط "Chameleon" الذي تم إصداره معالجة النصوص والصور في نفس الوقت، ويدعم نص الإدخال والإخراج المختلط، ويوفر حلاً جديدًا لمعالجة البيانات متعددة الوسائط.

في حين أن معظم نماذج الدمج الحالية تستخدم التعلم القائم على الانتشار، فإن Meta Chameleon تستخدم الترميز للنصوص والصور. يتيح ذلك اتباع نهج أكثر توحيدًا ويجعل النماذج أسهل في التصميم والصيانة والتوسيع.

أمثلة الفيديو: قم بإنشاء عناوين إبداعية من الصور أو استخدم مزيجًا من المطالبات النصية والصور لإنشاء مشهد جديد تمامًا

ستقوم Meta الآن بإصدار المكونات الرئيسية لنماذج Chameleon7B و34B علنًا بموجب ترخيص بحثي. تم ضبط النموذج الذي تم إصداره حاليًا بشكل آمن، ويدعم إدخال الوضع المختلط وإخراج النص العادي، ويمكن استخدامه لأغراض البحث. وأكد المسؤول أن نموذج توليد الصور الحرباء لن يتم إصداره.

مدخل المنتج: https://top.aibase.com/tool/meta-chameleon

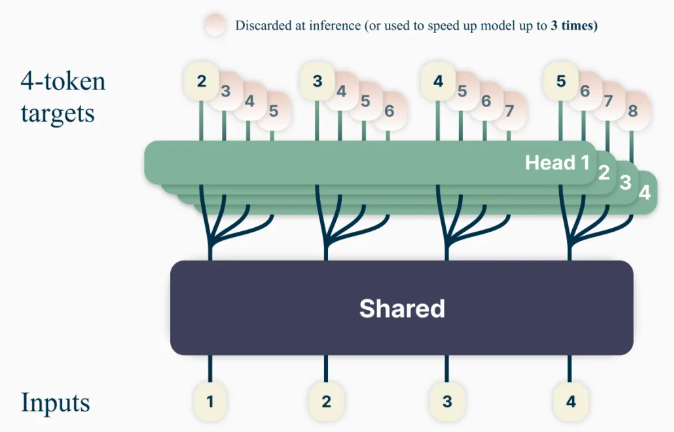

التنبؤ متعدد الرموز

تهدف طريقة تدريب نموذج اللغة الجديدة "التنبؤ متعدد الرموز" إلى تحسين قدرات النموذج وكفاءة التدريب، فهي تدرب النموذج على التنبؤ بكلمات متعددة في وقت واحد، مما يحسن دقة التنبؤ للنموذج.

باستخدام هذا النهج، يمكن تدريب النماذج اللغوية على التنبؤ بكلمات مستقبلية متعددة في وقت واحد، بدلاً من الطريقة السابقة للتنبؤ بكلمة واحدة في كل مرة. يؤدي ذلك إلى تحسين قدرات النموذج وكفاءة التدريب مع زيادة السرعة. انطلاقًا من روح العلم المفتوح المسؤول، سيتم إصدار نماذج مدربة مسبقًا لإكمال التعليمات البرمجية بموجب ترخيص غير تجاري/بحثي فقط.

مدخل المنتج: https://top.aibase.com/tool/multi-token-prediction

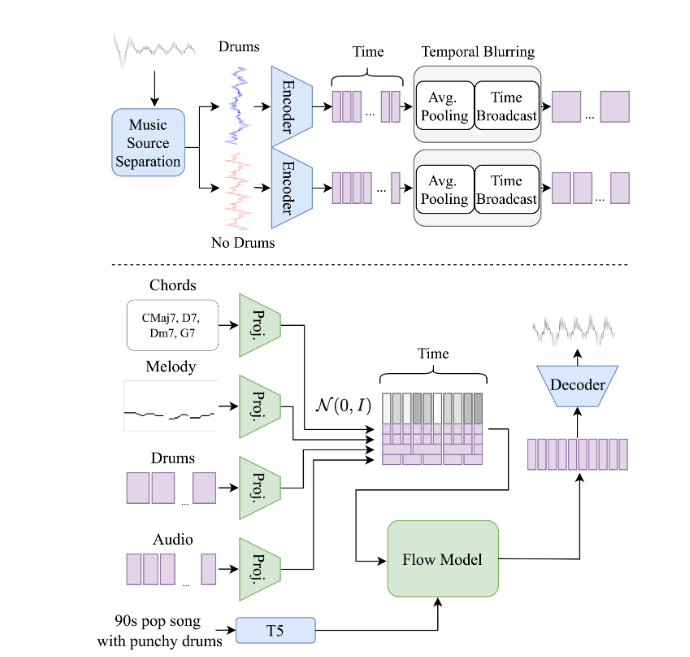

نموذج موسيقى توليد النص "JASCO"

في حين أن نماذج تحويل النص إلى موسيقى الحالية مثل MusicGen تعتمد بشكل أساسي على إدخال النص لإنشاء الموسيقى، فإن نموذج Meta الجديد، Meta-Joint Audio and Code Conditioning for Temporally Controlled Text to Music Generation (JASCO)، قادر على قبول مجموعة متنوعة من الموسيقى. مدخلات الشروط، مثل الأوتار أو النغمات المحددة، لتحسين التحكم في الإخراج الموسيقي الناتج. على وجه التحديد، يمكن استخدام طبقة اختناق المعلومات جنبًا إلى جنب مع الغموض الزمني لاستخراج المعلومات ذات الصلة بضوابط محددة. يتيح ذلك الجمع بين الشروط الرمزية والصوتية في وقت واحد في نفس النموذج التوليدي لتحويل النص إلى موسيقى.

JASCO مشابه لخط الأساس للتقييم من حيث جودة التوليد مع السماح بتحكم أفضل وأكثر مرونة في الموسيقى التي تم إنشاؤها. سينشر المسؤولون أوراق بحث وصفحات أمثلة، وفي وقت لاحق من هذا الشهر، سيتم إصدار رمز الاستدلال كجزء من مستودع AudioCraft بموجب ترخيص MIT، وسيتم إصدار النموذج المُدرب مسبقًا بموجب CC-BY-NC.

مدخل الكود: https://top.aibase.com/tool/audiocraft

تقنية العلامة المائية الصوتية "AudioSeal"

هذه هي أول تقنية للعلامة المائية الصوتية مصممة خصيصًا للكشف المحلي عن الكلام الناتج عن الذكاء الاصطناعي، مما يتيح الترجمة الدقيقة للمقاطع التي يولدها الذكاء الاصطناعي ضمن مقاطع صوتية أطول. يعمل AudioSeal على تحسين العلامات المائية الصوتية التقليدية من خلال التركيز على اكتشاف المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي بدلاً من إخفاء المعلومات.

على عكس الطرق التقليدية التي تعتمد على خوارزميات فك التشفير المعقدة، يتيح نهج الكشف المحلي الخاص بـ AudioSeal اكتشافًا أسرع وأكثر كفاءة. يعمل هذا التصميم على تحسين سرعة الكشف بمقدار 485 مرة مقارنة بالطرق السابقة، مما يجعله مثاليًا للتطبيقات واسعة النطاق وفي الوقت الفعلي. تحقق طريقتنا أداءً متطورًا من حيث المتانة وعدم إمكانية إدراك العلامات المائية الصوتية.

يتم إصدار AudioSeal بموجب ترخيص تجاري.

مدخل المنتج: https://top.aibase.com/tool/audioseal

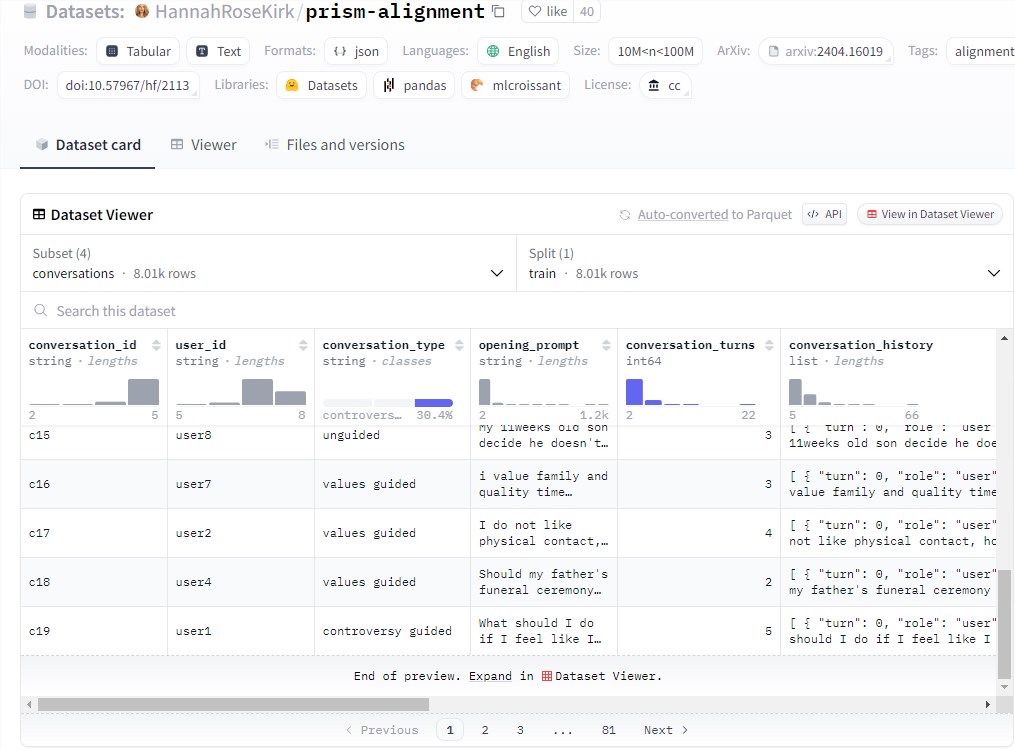

مجموعة بيانات بريزم

في الوقت نفسه، أصدرت Meta أيضًا مجموعة بيانات PRISM بالتعاون مع شركاء خارجيين، والتي تحتوي على بيانات الحوار وتفضيلات 1500 مشارك حول العالم، ويتم استخدامها لتحسين نماذج اللغة واسعة النطاق، وبالتالي تحسين تنوع الحوار وتفضيلاته التنوع والفوائد الاجتماعية للنموذج.

تحدد مجموعة البيانات هذه تفضيلات كل شخص وتعليقاته الدقيقة على 8011 محادثة في الوقت الفعلي مع 21 ماجستيرًا في إدارة الأعمال (LLM) مختلفًا.

مدخل مجموعة البيانات: https://huggingface.co/datasets/HannahRoseKirk/prism-alignment

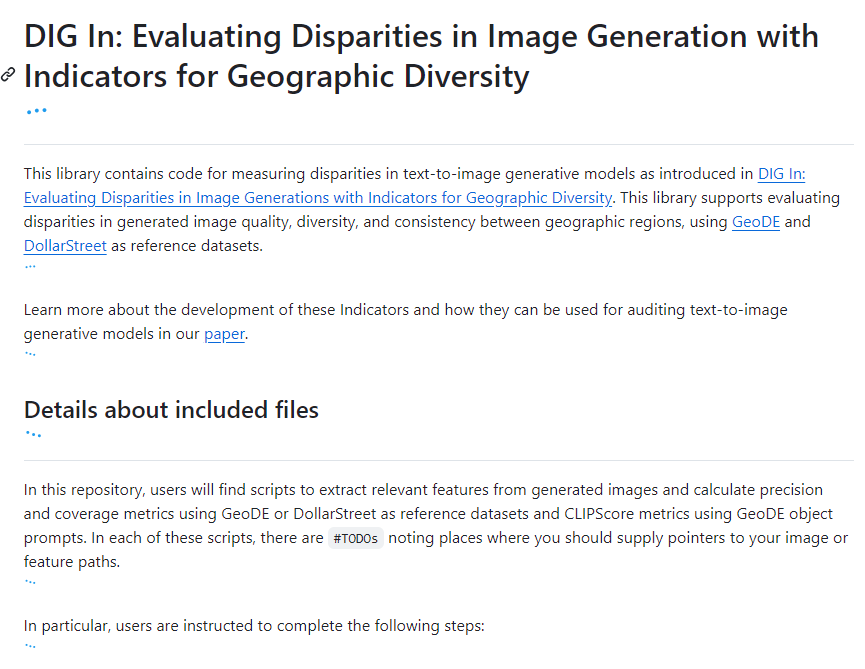

مؤشر "الحفر".

يستخدم لتقييم الاختلافات الجغرافية في نماذج صور إنشاء النص، مما يوفر المزيد من البيانات المرجعية لتحسين النموذج. لفهم كيف ينظر الناس في المناطق المختلفة إلى التمثيل الجغرافي بشكل مختلف، أجرت ميتا دراسة توضيحية واسعة النطاق. لقد جمعنا أكثر من 65000 تعليقًا توضيحيًا وأكثر من 20 ردًا على الاستطلاع لكل مثال، بما في ذلك عوامل الجذب والتشابه والاتساق والتوصيات المشتركة لتحسين التقييم التلقائي والبشري لنماذج تحويل النص إلى صورة.

إدخال الكود: https://top.aibase.com/tool/dig-in

وقد أدى إطلاق هذه المشاريع إلى تحقيق اختراقات تكنولوجية جديدة وآفاق تطبيقية في مجال الذكاء الاصطناعي، وله أهمية كبيرة في تعزيز تطوير وتطبيق تكنولوجيا الذكاء الاصطناعي.

بشكل عام، تُظهر نتائج أبحاث الذكاء الاصطناعي الستة التي أصدرتها Meta هذه المرة تقنيتها الرائدة وتخطيطها التطلعي في الوسائط المتعددة، وتوليد النص، ومعالجة الصوت، وبناء مجموعة البيانات. سيؤدي التقدم في هذه التقنيات إلى تعزيز المزيد من التطوير في مجال الذكاء الاصطناعي وتوفير المزيد من الإمكانيات للتطبيقات المستقبلية.