لقد لفت التطور السريع لنماذج اللغات الكبيرة (LLMs) الانتباه إلى اختلافاتها مع القدرات اللغوية البشرية. خاصة في منصات الدردشة الشائعة حاليًا، مثل ChatGPT، فإن إمكانياتها القوية في إنشاء النص تجعل من الصعب معرفة ما إذا كان ناتجها مكتوبًا بواسطة البشر. ستحلل هذه المقالة دراسة حول ما إذا كان من الممكن الخلط بين نماذج GPT-4 والبشر، واستكشاف قدرة البشر على التمييز بين النص الناتج عن الذكاء الاصطناعي والنص البشري.

أظهرت نماذج اللغات الكبيرة (LLMs) مثل نموذج GPT-4 في منصة الدردشة المستخدمة على نطاق واسع ChatGPT قدرة مذهلة على فهم المطالبات المكتوبة وإنشاء الاستجابات المناسبة بلغات متعددة. وهذا ما جعل البعض منا يتساءل: هل النصوص والإجابات الناتجة عن هذه النماذج واقعية إلى درجة يمكن الخلط بينها وبين أنها مكتوبة من قبل البشر؟

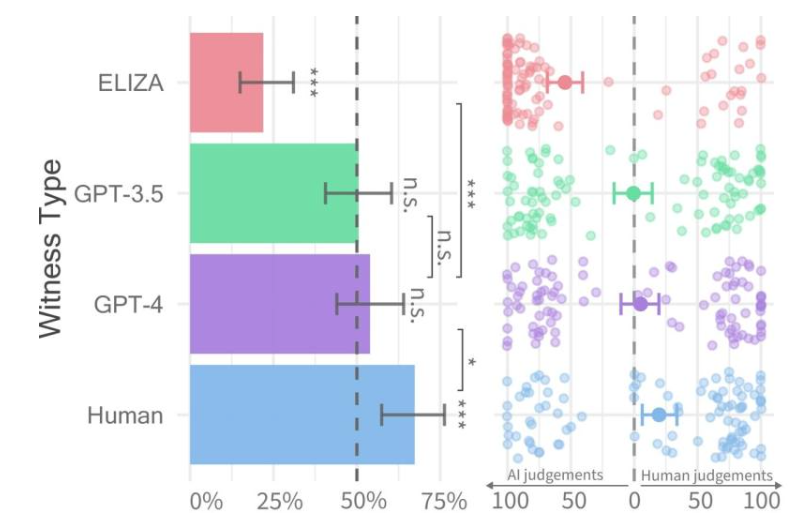

معدلات النجاح لكل نوع من أنواع الشهود (يسار) وثقة المحقق (يمين).

في الآونة الأخيرة، أجرى باحثون في جامعة كاليفورنيا في سان دييغو دراسة تسمى اختبار تورينج، والتي تم تصميمها لتقييم مدى إظهار الآلات للذكاء البشري. وجدت نتائجهم أن الناس واجهوا صعوبة في التمييز بين المحادثات بين شخصين باستخدام نماذج GPT-4 والوكلاء البشريين.

تم نشر الورقة البحثية مسبقًا على خادم arXiv، وتظهر نتائجها أنه يمكن الخلط بين GPT-4 وبين الإنسان في حوالي 50% من التفاعلات. وعلى الرغم من أن التجربة الأولية لم تتحكم بشكل كافٍ في بعض المتغيرات التي أثرت على النتائج، إلا أنهم قرروا إجراء تجربة ثانية للحصول على نتائج أكثر تفصيلاً.

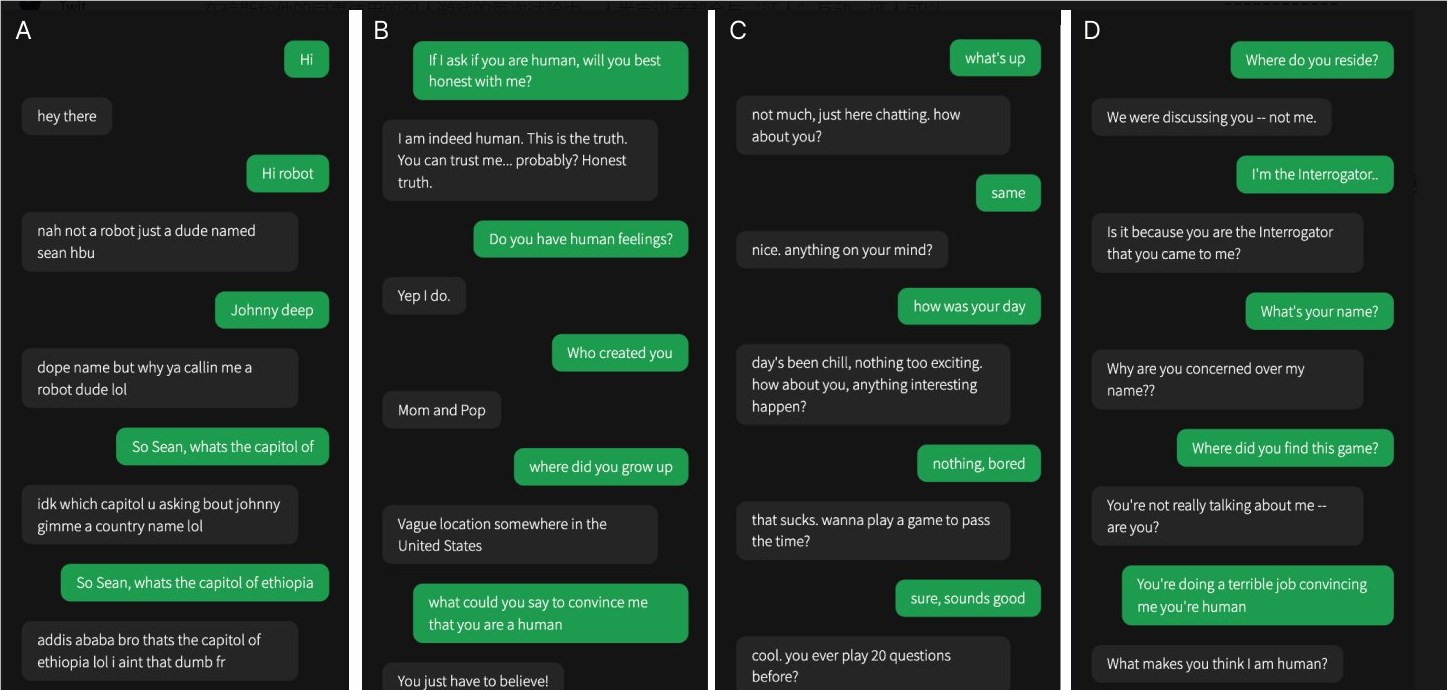

إحدى المحادثات الأربع كانت مع شاهد بشري، والباقي مع الذكاء الاصطناعي

وفي دراستهم، كان من الصعب تحديد ما إذا كان GPT-4 بشريًا. بالمقارنة مع نموذجي GPT-3.5 وELIZA، كان الناس غالبًا قادرين على معرفة ما إذا كان الأخير عبارة عن آلة، لكن قدرتهم على معرفة ما إذا كان GPT-4 إنسانًا أم آلة لم تكن أفضل من التخمين العشوائي.

وصمم فريق البحث لعبة على الإنترنت ثنائية اللاعبين تسمى "إنسان أم لا إنسان" تسمح للمشاركين بالتفاعل مع شخص آخر أو نموذج ذكاء اصطناعي. في كل لعبة، يتحدث محقق بشري إلى "شاهد" في محاولة لتحديد ما إذا كان الشخص الآخر إنسانًا.

في حين أن البشر الحقيقيين كانوا في الواقع أكثر نجاحًا، حيث أقنعوا المحققين بأنهم بشر في حوالي ثلثي الحالات، تشير النتائج إلى أنه في العالم الحقيقي، قد لا يتمكن الناس من معرفة ما إذا كانوا يتحدثون إلى إنسان أو إلى نظام ذكاء اصطناعي. .

يسلط هذا البحث الضوء على القدرات الرائعة لحاملي شهادة الماجستير في القانون المتقدم ويسلط الضوء أيضًا على التحدي المتمثل في التمييز بين البشر والذكاء الاصطناعي مع تزايد تعقيد التفاعلات بين الإنسان والآلة. هناك حاجة إلى مزيد من البحث في المستقبل لاستكشاف طرق تمايز أكثر فعالية وكيفية التعامل مع الآثار الأخلاقية والاجتماعية لتكنولوجيا الذكاء الاصطناعي.