في السنوات الأخيرة، كان هناك طلب متزايد على نماذج الذكاء الاصطناعي خفيفة الوزن، وخاصة على المنصات المحدودة الموارد مثل الأجهزة المحمولة وأجهزة الكمبيوتر الشخصية. أصبحت كيفية تقليل حجم النموذج والتكلفة الحسابية مع ضمان الأداء اتجاهًا بحثيًا مهمًا. ستقدم هذه المقالة SmolVLM الذي أصدرته Hugging Face مؤخرًا، وهو نموذج لغة مرئية بمعلمة 2B مصمم خصيصًا للاستدلال من جانب الجهاز. لقد حقق اختراقات كبيرة في السرعة والكفاءة، ويوفر حلولاً لتطبيق مهام اللغة المرئية على الموارد المنخفضة إمكانيات جديدة.

في السنوات الأخيرة، كان هناك طلب متزايد على تطبيق نماذج التعلم الآلي في مهام الرؤية واللغة، ولكن معظم النماذج تتطلب موارد حاسوبية ضخمة ولا يمكن تشغيلها بكفاءة على الأجهزة الشخصية. تواجه الأجهزة الصغيرة بشكل خاص مثل أجهزة الكمبيوتر المحمولة ووحدات معالجة الرسومات الاستهلاكية والأجهزة المحمولة تحديات كبيرة عند معالجة مهام اللغة المرئية.

لنأخذ Qwen2-VL كمثال، على الرغم من أنه يتمتع بأداء ممتاز، إلا أنه يتطلب متطلبات عالية للأجهزة، مما يحد من سهولة استخدامه في التطبيقات في الوقت الفعلي. لذلك، أصبح تطوير نماذج خفيفة الوزن لتعمل بموارد أقل حاجة مهمة.

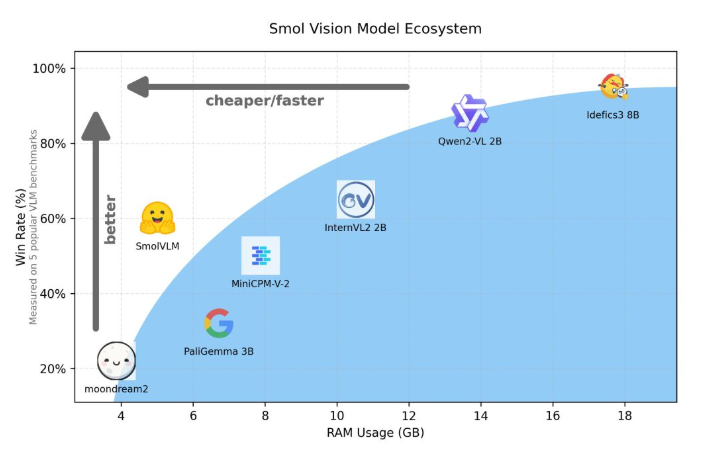

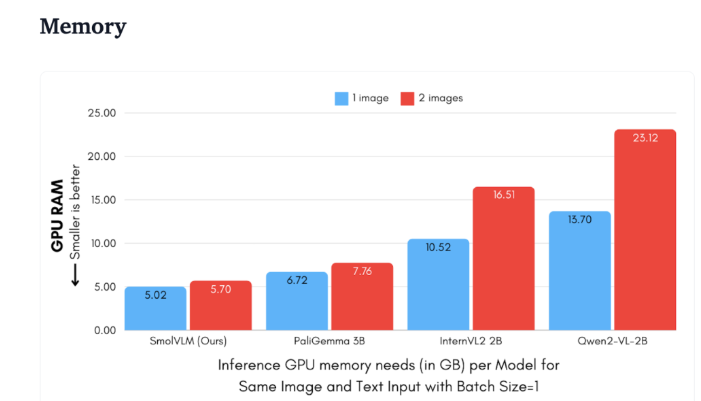

أصدرت Hugging Face مؤخرًا SmolVLM، وهو نموذج لغة مرئية بمعلمة 2B مصمم خصيصًا للاستدلال من جانب الجهاز. يتفوق SmolVLM على النماذج المماثلة الأخرى من حيث استخدام ذاكرة وحدة معالجة الرسومات وسرعة إنشاء الرمز المميز. وتتمثل الميزة الرئيسية له في القدرة على العمل بكفاءة على الأجهزة الأصغر حجمًا، مثل أجهزة الكمبيوتر المحمولة أو وحدات معالجة الرسومات المخصصة للمستهلك، دون التضحية بالأداء. يجد SmolVLM توازنًا مثاليًا بين الأداء والكفاءة، وحل المشكلات التي كان من الصعب التغلب عليها في النماذج المماثلة السابقة.

بالمقارنة مع Qwen2-VL2B، يقوم SmolVLM بإنشاء الرموز المميزة بمعدل 7.5 إلى 16 مرة أسرع، وذلك بفضل بنيته المحسنة، مما يجعل الاستدلال خفيف الوزن ممكنًا. لا تجلب هذه الكفاءة فوائد عملية للمستخدمين النهائيين فحسب، بل تعمل أيضًا على تحسين تجربة المستخدم بشكل كبير.

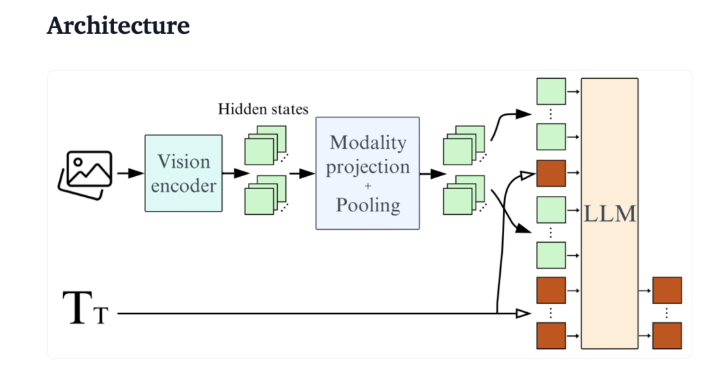

من منظور تقني، يتمتع SmolVLM ببنية محسنة تدعم الاستدلال الفعال من جانب الجهاز. ويمكن للمستخدمين أيضًا إجراء الضبط الدقيق على Google Colab بسهولة، مما يخفض حد التجريب والتطوير بشكل كبير.

نظرًا لصغر حجم الذاكرة، فإن SmolVLM قادر على العمل بسلاسة على الأجهزة التي لم تكن قادرة في السابق على استضافة نماذج مماثلة. عند اختبار مقطع فيديو من 50 إطارًا على YouTube، كان أداء SmolVLM جيدًا، حيث سجل 27.14%، وتفوق على النموذجين الأكثر استهلاكًا للموارد من حيث استهلاك الموارد، مما يدل على قدرته القوية على التكيف والمرونة.

يعد SmolVLM علامة فارقة مهمة في مجال نماذج اللغة المرئية. يتيح إطلاقه إمكانية تشغيل مهام اللغة المرئية المعقدة على الأجهزة اليومية، مما يسد فجوة مهمة في أدوات الذكاء الاصطناعي الحالية.

لا يتفوق SmolVLM في السرعة والكفاءة فحسب، بل يوفر أيضًا للمطورين والباحثين أداة قوية لتسهيل معالجة اللغة المرئية دون نفقات الأجهزة باهظة الثمن. مع استمرار تزايد شعبية تقنية الذكاء الاصطناعي، فإن نماذج مثل SmolVLM ستجعل إمكانيات التعلم الآلي القوية أكثر سهولة.

العرض التوضيحي: https://huggingface.co/spaces/HuggingFaceTB/SmolVLM

https://huggingface.co/spaces/HuggingFaceTB/SmolVLM

تسليط الضوء على:

SmolVLM هو نموذج لغة مرئية بمعلمة 2B تم إطلاقه بواسطة Hugging Face، وهو مصمم خصيصًا للاستدلال من جانب الجهاز، وهو يعمل بكفاءة ولا يتطلب أجهزة متطورة.

وتبلغ سرعة توليد الرموز المميزة لها ما بين 7.5 إلى 16 مرة مقارنة بالنماذج المماثلة، مما يؤدي إلى تحسين تجربة المستخدم وكفاءة التطبيق بشكل كبير.

في الاختبار، أظهر SmolVLM قدرة قوية على التكيف وكان قادرًا على تحقيق درجات جيدة حتى بدون التدريب على بيانات الفيديو.

يمثل ظهور SmolVLM إنجازًا مهمًا في التطوير الخفيف لنماذج اللغة المرئية، فهو لا يحسن تجربة المستخدم فحسب، بل يوفر أيضًا للمطورين والباحثين أدوات أكثر ملاءمة. في المستقبل، ستلعب النماذج الفعالة وخفيفة الوزن مثل SmolVLM دورًا في المزيد من السيناريوهات وتعزيز التطبيق الأوسع لتكنولوجيا الذكاء الاصطناعي.