أطلقت Google Gemini AI Chat Robot مؤخرًا وظيفة "الذاكرة" المتوقعة للغاية. ولكن هذه الميزة تقتصر حاليًا على المشتركين في Google One AI (20 دولارًا في الشهر) ، ويدعم فقط صفحات الويب والمدخلات الإنجليزية. على الرغم من أنها قوية ، إلا أنها أثارت مخاوف بشأن أمان البيانات وحماية الخصوصية.

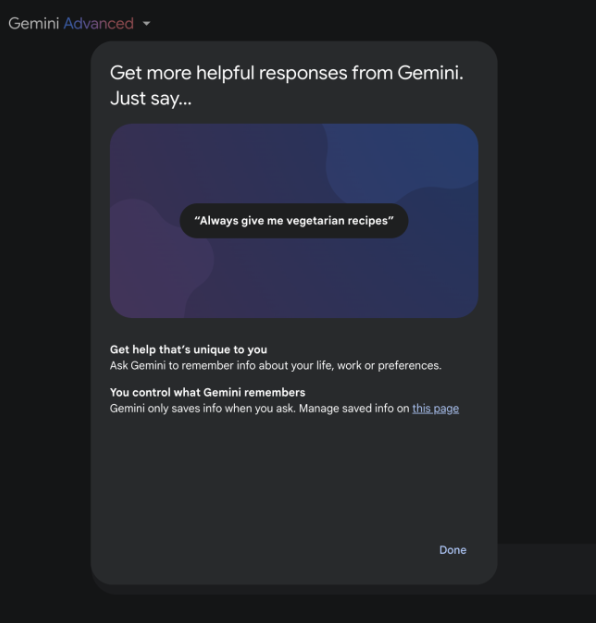

أطلقت Robot Robot Gemini من AI من Google مؤخراً وظيفة "ذاكرة" مهمة ، مما يسمح للمساعدين من الذكاء الاصطناعى بتذكر معلومات حياة المستخدمين ومحتوى العمل وتفضيلات الشخصية ، وبالتالي توفير تجربة خدمة أكثر تخصيصًا.

هذه الميزة الجديدة مفتوحة للمستخدمين الذين يشتركون في برنامج Google One Premium بقيمة 20 دولارًا ، ويدعمهم مؤقتًا فقط على صفحة الويب. تجدر الإشارة إلى أن المدخلات الإنجليزية فقط مدعومة حاليًا.

على وجه التحديد ، يمكن أن تساعد وظيفة ذاكرة Gemini المستخدمين على تحقيق مجموعة متنوعة من السيناريوهات العملية. على سبيل المثال ، عندما يخبر المستخدم طعام Gemini المفضل ، عند طلب توصية المطعم في المرة القادمة ، يمكن لـ AI تقديم المزيد من الاقتراحات المستهدفة وفقًا لتفضيلات ذوق المستخدم. تعرض Google أيضًا أمثلة عملية أخرى في الواجهة ، مثل "استخدام لغة بسيطة لتجنب المصطلحات المهنية" ، "سأقوم فقط برمجة JavaScript" ، و "تخطيط السفر سيتضمن الرسوم اليومية".

تؤكد Google على أنه يمكن للمستخدمين إيقاف تشغيل وظيفة الذاكرة في أي وقت ، ولكن يجب حذف محتوى الذاكرة المخزن يدويًا ليختفي. والأهم من ذلك ، ذكر المتحدث باسم Google بوضوح أن معلومات الذاكرة هذه لن يتم استخدامها للتدريب على النماذج ولن تتم مشاركتها مع الآخرين.

ومع ذلك ، فإن أمان وظائف الذاكرة هذه يستحق الاهتمام. في وقت سابق من هذا العام ، وجد باحث أمني أن المتسللين قد يزرعون الذاكرة "False" في ChatGPT ، وبالتالي سرقة بيانات المستخدم باستمرار. يذكرنا هذا الاكتشاف بأن وظيفة الذاكرة لنظام الذكاء الاصطناعى تتطلب تدابير حماية أمان أكثر صرامة.

يعكس إطلاق هذه الميزة اتجاه تطوير مساعدي الذكاء الاصطناعى نحو اتجاه أكثر تخصيصًا وذكيًا ، لكنه أثار أيضًا تفكير حماية خصوصية المستخدم وأمن البيانات. سيكون كيفية ضمان أمان بيانات المستخدم مع توفير الراحة مشكلة مهمة يحتاجها مقدمو خدمات الذكاء الاصطناعي إلى الانتباه إليها.

لا شك أن وظيفة "الذاكرة" في Gemini تعمل على تحسين تجربة المستخدم ، ولكن لا تزال هناك حاجة إلى تحسين مشكلات حماية الأمان والخصوصية ، وهو التحدي الذي تواجهه Google وحتى صناعة الذكاء الاصطناعي بأكملها. فقط تحت فرضية ضمان الأمن يمكن أن تخدم منظمة العفو الدولية البشر بشكل أفضل.