أصدرت DeepSeek أول نموذج استدلالي لها، DeepSeek-R1 استنادًا إلى التدريب على التعلم المعزز في 20 يناير 2025. وأظهر النموذج أداءً مشابهًا أو حتى أفضل من OpenAI-o1-1217 في اختبارات قياس الأداء المتعددة. لا يتم تدريب DeepSeek-R1 بشكل مباشر، ولكن من خلال التدريب متعدد المراحل وبيانات البداية الباردة، استنادًا إلى نموذج DeepSeek-V3-Base، فإنه يتغلب على المشكلات الناجمة عن استخدام نموذج التدريب على التعلم المعزز فقط (DeepSeek-R1-Zero). أدت مشكلات مثل ضعف إمكانية القراءة واللغات المختلطة في النهاية إلى تحسينات كبيرة في الأداء. النموذج مفتوح المصدر ويقدم أسعارًا تنافسية للوصول إلى واجهة برمجة التطبيقات (API)، مما يوفر للمستخدمين خيارًا أكثر ملاءمة واقتصادية.

في 20 يناير 2025، أعلنت DeepSeek عن إطلاق أول نموذج استدلالي لها، DeepSeek-R1 تم تدريبه من خلال التعلم المعزز (RL)، والذي حقق أداءً مشابهًا لـ OpenAI-o1-1217 في معايير الاستدلال المتعددة. يعتمد DeepSeek-R1 على نموذج DeepSeek-V3-Base ويستخدم تدريبًا متعدد المراحل وبيانات البدء البارد لتحسين قدرات الاستدلال.

قام باحثو DeepSeek أولاً بتطوير DeepSeek-R1-Zero، وهو نموذج تم تدريبه بالكامل من خلال التعلم المعزز على نطاق واسع دون أي خطوات تحضيرية للضبط الدقيق الخاضع للإشراف. لقد أظهر DeepSeek-R1-Zero أداءً ممتازًا في معايير الاستدلال، على سبيل المثال، في اختبار AIME2024، زادت درجة pass@1 من 15.6% إلى 71.0%. ومع ذلك، يعاني DeepSeek-R1-Zero أيضًا من بعض المشكلات، مثل ضعف إمكانية القراءة واللغات المختلطة.

من أجل حل هذه المشاكل ومواصلة تحسين أداء الاستدلال، قام فريق DeepSeek بتطوير DeepSeek-R1. يقدم DeepSeek-R1 تدريبًا متعدد المراحل وبيانات البداية الباردة قبل التعلم المعزز. على وجه التحديد، قام الباحثون أولاً بجمع الآلاف من بيانات البداية الباردة لضبط نموذج DeepSeek-V3-Base. بعد ذلك، قاموا بإجراء التعلم المعزز الموجه نحو الاستدلال أثناء تدريبهم على DeepSeek-R1-Zero. عندما كانت عملية التعلم المعزز قريبة من التقارب، قاموا بإنشاء بيانات ضبط دقيقة جديدة خاضعة للإشراف عن طريق أخذ عينات الرفض من نقاط تفتيش التعلم المعزز، جنبًا إلى جنب مع بيانات DeepSeek-V3 الخاضعة للإشراف في مجالات مثل الكتابة والإجابة على الحقائق والوعي الذاتي، ثم أعيد تدريبهم نموذج DeepSeek-V3-Base. وأخيرًا، يتم تنفيذ التعلم المعزز الإضافي على نقاط التفتيش المضبوطة باستخدام إشارات من جميع السيناريوهات.

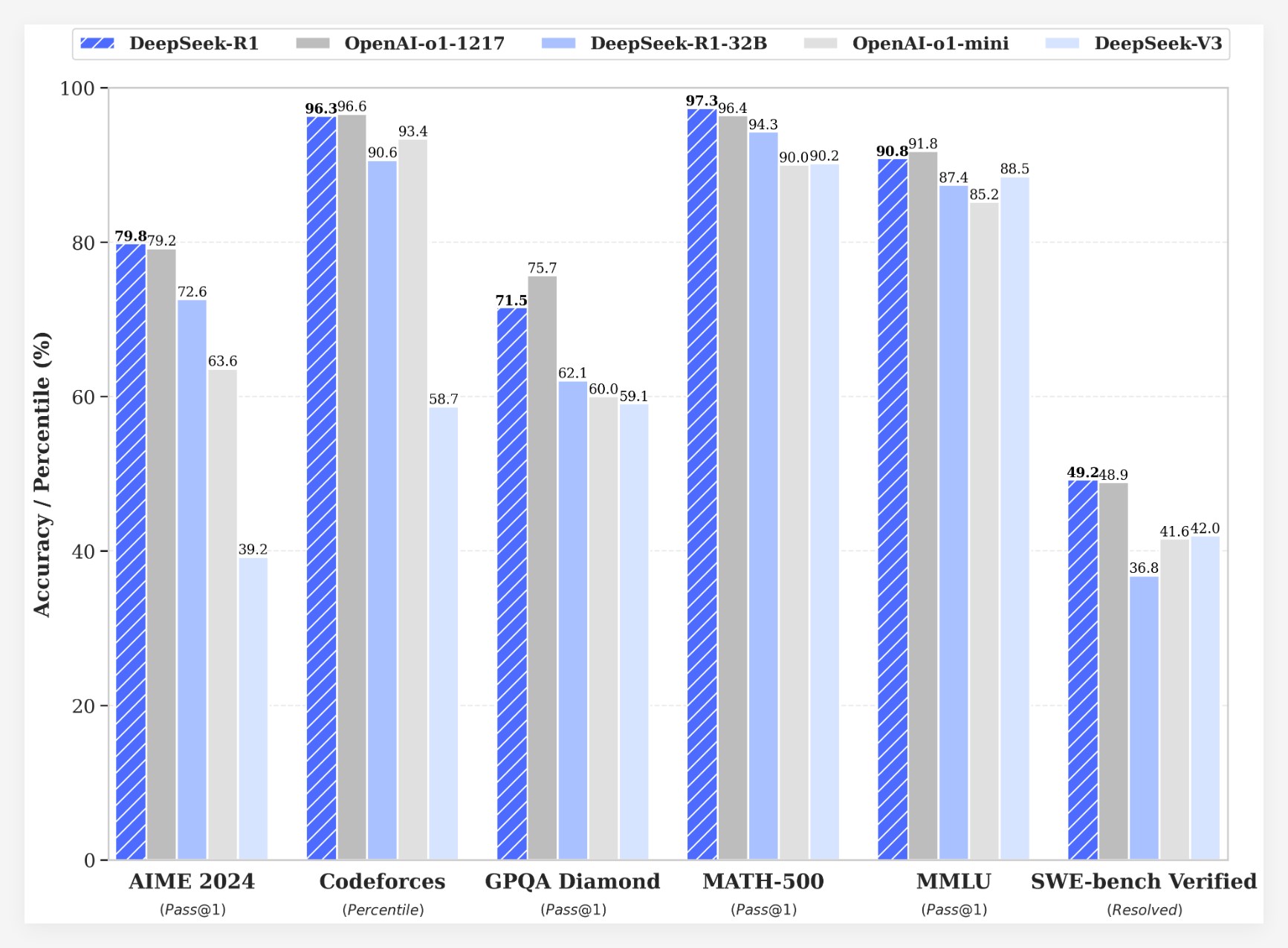

يحقق DeepSeek-R1 نتائج مبهرة وفقًا لمعايير متعددة:

•في اختبار AIME2024، وصلت درجة pass@1 لـ DeepSeek-R1 إلى 79.8%، وهي أعلى قليلاً من OpenAI-o1-1217.

•في اختبار MATH-500، وصلت درجة pass@1 لـ DeepSeek-R1 إلى 97.3%، وهي نفس درجة OpenAI-o1-1217.

•في مهمة مسابقة التعليمات البرمجية، حقق DeepSeek-R1 تصنيف Elo لعام 2029 على Codeforces، متجاوزًا 96.3% من المشاركين البشريين.

•في معايير المعرفة مثل MMLU وMMLU-Pro وGPQA Diamond، سجل DeepSeek-R1 90.8% و84.0% و71.5% على التوالي، وهو أفضل بكثير من DeepSeek-V3.

•يؤدي DeepSeek-R1 أيضًا أداءً جيدًا في مهام أخرى مثل الكتابة الإبداعية، والأسئلة والأجوبة العامة، والتحرير، والتلخيص، وما إلى ذلك.

بالإضافة إلى ذلك، يستكشف DeepSeek أيضًا استخلاص إمكانيات الاستدلال الخاصة بـ DeepSeek-R1 إلى نماذج أصغر. لقد وجد أن التقطير المباشر من DeepSeek-R1 كان أداؤه أفضل من تطبيق التعلم المعزز على نموذج صغير. يشير هذا إلى أن أنماط الاستدلال التي اكتشفتها النماذج الأساسية الكبيرة تعتبر ضرورية لتحسين قدرات الاستدلال. يحتوي DeepSeek على DeepSeek-R1-Zero وDeepSeek-R1 مفتوح المصدر وستة نماذج كثيفة (1.5B، 7B، 8B، 14B، 32B، 70B) مقطر من DeepSeek-R1 استنادًا إلى Qwen وLlama. يمثل إطلاق DeepSeek-R1 تقدمًا كبيرًا في التعلم المعزز لتحسين قدرات التفكير لنماذج اللغات الكبيرة.

ميزة التكلفةمن حيث التكلفة، يقدم DeepSeek-R1 استراتيجية تسعير تنافسية للغاية. يبلغ سعر الوصول إلى واجهة برمجة التطبيقات (API) 0.14 دولارًا أمريكيًا (نتيجة ذاكرة التخزين المؤقت) و0.55 دولارًا أمريكيًا (فشل ذاكرة التخزين المؤقت) لكل مليون رمز مميز للإدخال، و2.19 دولارًا أمريكيًا لكل مليون رمز مميز للمخرجات. تعد إستراتيجية الأسعار هذه أكثر جاذبية من المنتجات المماثلة الأخرى وقد وصفها المستخدمون بأنها "تغير قواعد اللعبة". الموقع الرسمي وواجهة برمجة التطبيقات (API) متاحة الآن على الإنترنت! تفضل بزيارة https://chat.deepseek.com لتجربة DeepThink!

أثار إصدار DeepSeek-R1 مناقشات ساخنة في المجتمع. يقدر العديد من المستخدمين طبيعة المصدر المفتوح ومزايا التكلفة للنموذج، معتقدين أنه يوفر للمطورين المزيد من الخيارات والحرية. ومع ذلك، أثار بعض المستخدمين تساؤلات حول حجم نافذة السياق للنموذج ويأملون في إمكانية تحسين الإصدارات المستقبلية بشكل أكبر.

صرح فريق DeepSeek أنهم سيواصلون العمل على تحسين الأداء وتجربة المستخدم للنموذج، ويخططون لإطلاق المزيد من الميزات في المستقبل، بما في ذلك تحليل البيانات المتقدمة، لتلبية توقعات المستخدم لـ AGI (الذكاء العام الاصطناعي).

لا يُظهر إطلاق DeepSeek-R1 الإمكانات الكبيرة للتعلم المعزز في تحسين قدرات التفكير لنماذج اللغات الكبيرة فحسب، بل يجلب أيضًا اتجاهات وإمكانيات جديدة لتطوير مجال الذكاء الاصطناعي. وستعمل ميزاتها مفتوحة المصدر واستراتيجية التسعير التنافسية على تعزيز تعميم وتطبيق تكنولوجيا الذكاء الاصطناعي.