أصدر فريق أبحاث Salesforce AI أحدث نموذج لغوي متعدد الوسائط ، BLIP-3-Video ، بهدف معالجة بيانات الفيديو بشكل فعال. نموذج فهم الفيديو التقليدي غير فعال. تحل هذه الخطوة مشكلة التعامل مع مقاطع الفيديو الطويلة وتوفر إمكانيات أقوى لفهم الفيديو للصناعات مثل القيادة المستقلة والترفيه.

في الآونة الأخيرة ، أطلق فريق Salesforce AI Research نموذجًا جديدًا لغويًا متعدد الوسائط-BLIP-3-Video. مع الزيادة السريعة في محتوى الفيديو ، أصبحت كيفية معالجة بيانات الفيديو بكفاءة مشكلة ملحة. تم تصميم ظهور هذا النموذج لتحسين كفاءة وفعالية فهم الفيديو وهو مناسب للصناعات من القيادة المستقلة إلى الترفيه.

غالبًا ما تقوم نماذج فهم الفيديو التقليدية بمعالجة إطار الفيديو حسب الإطار ، مما يولد كمية كبيرة من المعلومات المرئية. لا تستهلك هذه العملية الكثير من موارد الحوسبة فحسب ، بل تحد بشكل كبير من القدرة على معالجة مقاطع الفيديو الطويلة. مع استمرار نمو كمية بيانات الفيديو ، يصبح هذا النهج غير فعال بشكل متزايد ، لذلك من الأهمية بمكان العثور على حل يلتقط المعلومات الهامة للفيديو مع تقليل عبء الحوسبة.

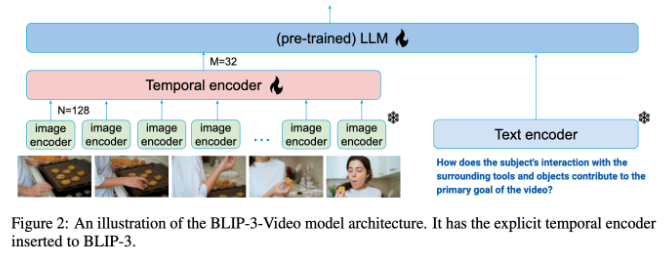

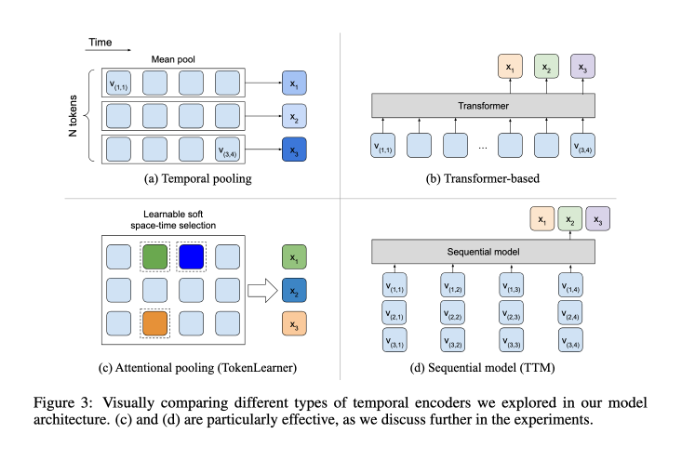

في هذا الصدد ، كان أداء BLIP-3-Video جيدًا. من خلال تقديم "تشفير تسلسل الوقت" ، قام النموذج بنجاح بتقليل كمية المعلومات المرئية المطلوبة في الفيديو إلى 16 إلى 32 علامة مرئية. يعمل هذا التصميم المبتكر على تحسين كفاءة الحوسبة بشكل كبير ، مما يسمح للمواد بإكمال مهام الفيديو المعقدة بتكلفة أقل. يستخدم تشفير التوقيت هذا آلية لتجميع الاهتمام المكاني القابلة للتعلم التي تستخرج أهم المعلومات من كل إطار ودمجها في مجموعة مضغوطة من العلامات البصرية.

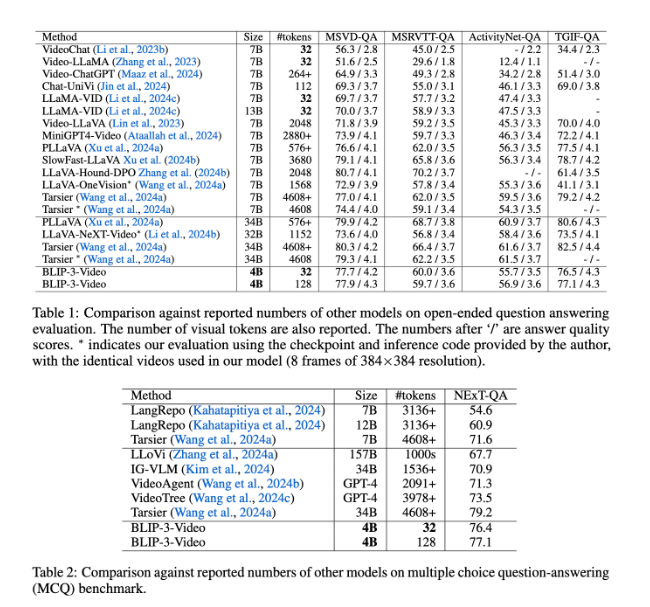

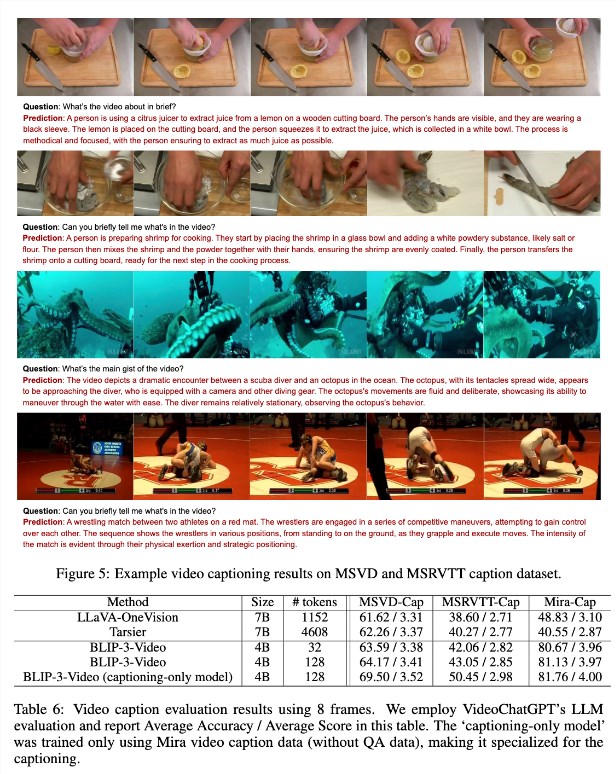

أداء بليب-3-أيضا أداء جيدا جدا. من خلال المقارنة مع النماذج الكبيرة الأخرى ، وجدت الدراسة أن النموذج لديه معدل دقة من النماذج العليا المماثلة في مهام أسئلة وأجوبة بالفيديو. على سبيل المثال ، يتطلب طراز Tarsier-34B 4608 علامة لمعالجة 8 إطارات من الفيديو ، في حين أن BLIP-3-Video يحتاج فقط إلى 32 علامة لتحقيق 77.7 ٪ MSVD-QA. هذا يدل على أن BLIP-3-Video يقلل بشكل كبير من استهلاك الموارد مع الحفاظ على الأداء العالي.

بالإضافة إلى ذلك ، لا ينبغي التقليل من أداء أداء BLIP-3-Video في مهام الأسئلة والأجوبة متعددة الخيارات. في مجموعة بيانات QA التالية ، حقق النموذج درجة عالية قدرها 77.1 ٪ ، بينما في مجموعة بيانات TGIF-QA ، حقق أيضًا معدل دقة قدره 77.1 ٪. تشير كل هذه البيانات إلى كفاءة BLIP-3-Video عند التعامل مع مشاكل الفيديو المعقدة.

يفتح BLIP-3-Video إمكانيات جديدة في مجال معالجة الفيديو من خلال ترميزات التوقيت المبتكرة. إن إطلاق هذا النموذج لا يحسن كفاءة فهم الفيديو فحسب ، بل يوفر أيضًا المزيد من الاحتمالات لتطبيقات الفيديو المستقبلية.

مدخل المشروع: https://www.salesforceaires.com/opensource/xgen-mm-vid/index.html

النقاط الرئيسية:

-** إصدار نموذج جديد **: يطلق Salesforce AI Research Blip-3-Video ، وهو نموذج لغة متعددة الوسائط ، يركز على معالجة الفيديو.

- ** المعالجة الفعالة **: إن استخدام تشفير التوقيت يقلل بشكل كبير من عدد العلامات المرئية المطلوبة ويحسن كفاءة الحوسبة بشكل كبير.

- ** الأداء الفائق **: أداء ممتاز في مهام الأسئلة والأجوبة في الفيديو ، الحفاظ على دقة عالية مع تقليل استهلاك الموارد.

باختصار ، أحرزت BLIP-3-Video تقدمًا كبيرًا إلى مجال فهم الفيديو مع قدرات المعالجة الفعالة والأداء الممتاز ، وآفاق تطبيقها واسعة. يوفر المصدر المفتوح لهذا النموذج أيضًا أساسًا جيدًا لمزيد من البحث والتطبيق.