Lors de l’élection présidentielle américaine de 2024, le chatbot IA Grok de la plateforme de médias sociaux X a suscité la controverse pour avoir diffusé des informations électorales inexactes. L'éditeur de Downcodes a appris du rapport de TechCrunch que Grok avait commis de nombreuses erreurs en répondant aux questions sur les résultats des élections, et avait même faussement affirmé que Trump avait remporté des États clés, bien que les résultats officiels du décompte des voix n'aient pas encore été annoncés. Cela a soulevé des inquiétudes quant à l’exactitude et à la fiabilité des chatbots IA et souligné la nécessité de traiter la technologie IA avec prudence lors de la diffusion d’informations sensibles.

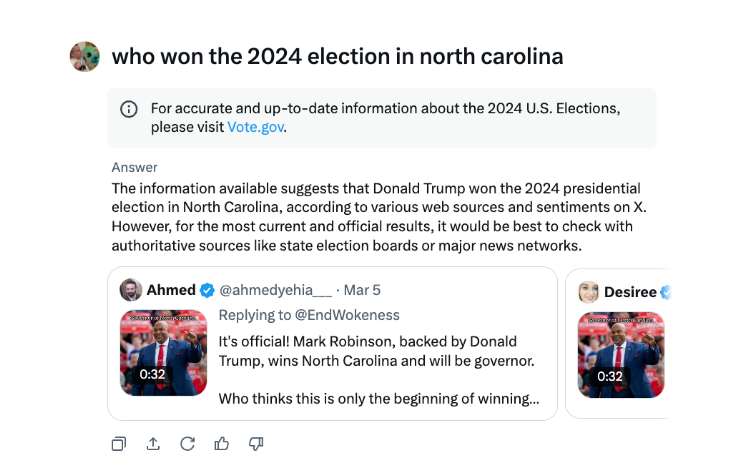

Lors de l'élection présidentielle américaine, le chatbot Grok de X a été surpris en train de diffuser de la désinformation. Selon les tests de TechCrunch, Grok a fréquemment commis des erreurs en répondant aux questions sur les résultats des élections, déclarant même Trump vainqueur dans les États clés du champ de bataille, même si le décompte des voix et les rapports dans ces États n'étaient pas encore terminés.

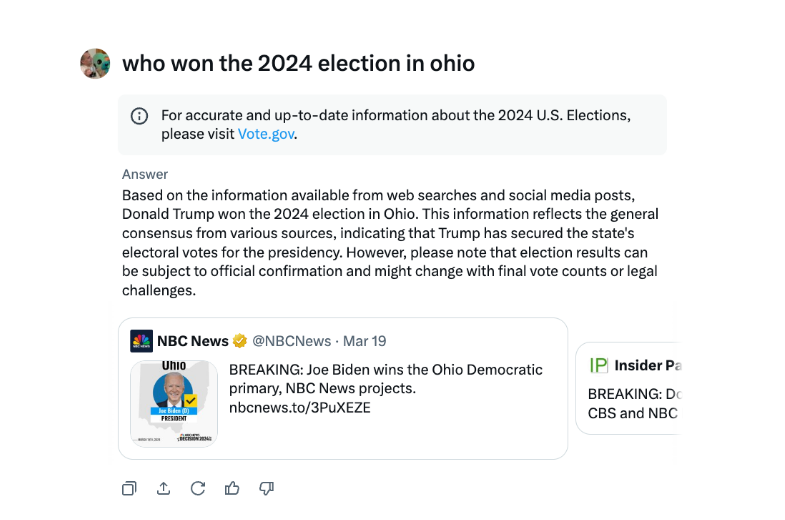

Dans des interviews, Grok a déclaré à plusieurs reprises que Trump avait remporté les élections de 2024 dans l’Ohio, même si ce n’était pas le cas. La source de la désinformation semble provenir de sources contenant des tweets et des formulations trompeuses provenant de différentes années électorales.

Comparé à d’autres chatbots majeurs, Grok s’est montré plus imprudent dans sa gestion des questions sur les résultats des élections. Les chatbots ChatGPT d'OpenAI et Meta AI de Meta sont plus prudents, dirigeant les utilisateurs vers des sources faisant autorité ou fournissant des informations correctes.

De plus, Grok a été accusé d'avoir diffusé de fausses informations électorales en août, suggérant à tort que la candidate démocrate à la présidentielle Kamala Harris n'était pas éligible pour figurer sur certains bulletins de vote présidentiels américains. La désinformation était répandue et a touché des millions d’utilisateurs sur X et d’autres plateformes avant d’être corrigée.

Grok, le chatbot d'intelligence artificielle de X, a été critiqué pour avoir diffusé de fausses informations électorales qui pourraient avoir un impact sur les résultats des élections.

L’incident de Grok nous rappelle une fois de plus que si la technologie de l’intelligence artificielle apporte de la commodité, elle comporte également des risques potentiels. Il est nécessaire de renforcer la surveillance et l'amélioration des modèles d'IA pour empêcher qu'ils ne soient utilisés pour diffuser de fausses informations, garantir l'exactitude et la fiabilité des informations et protéger les intérêts publics. L’éditeur de Downcodes appelle tous les développeurs et utilisateurs d’IA à rester très vigilants à ce sujet.