L'équipe Meta FAIR a publié un nouveau modèle Transformer, Dualformer, qui simule les systèmes cognitifs humains doubles (Système 1 et Système 2) et permet d'améliorer considérablement les capacités de raisonnement et l'efficacité informatique. Contrairement aux modèles Transformer traditionnels qui simulent uniquement le système 1 ou le système 2, Dualformer peut basculer de manière flexible entre les modes de raisonnement rapide et lent pour s'adapter à la complexité des différentes tâches. Cette innovation découle de sa méthode d'entraînement unique : utiliser des trajectoires de raisonnement aléatoires pour l'entraînement et rejeter au hasard différentes parties des trajectoires pour simuler des raccourcis dans le processus de pensée humaine.

L'équipe FAIR de Meta a récemment lancé un nouveau modèle Transformer appelé Dualformer, qui imite le double système cognitif humain et peut intégrer de manière transparente des modes de raisonnement rapides et lents, réalisant ainsi des avancées significatives en matière de capacités de raisonnement et d'efficacité informatique.

On pense généralement que les processus de pensée humaine sont contrôlés par deux systèmes : le système 1, qui est rapide et intuitif, et le système 2, qui est plus lent et plus logique.

Les modèles de transformateur traditionnels ne simulent généralement que l'un des systèmes 1 ou 2, ce qui donne un modèle soit rapide mais doté de faibles capacités de raisonnement, soit doté de fortes capacités de raisonnement mais lent et présentant des coûts de calcul élevés.

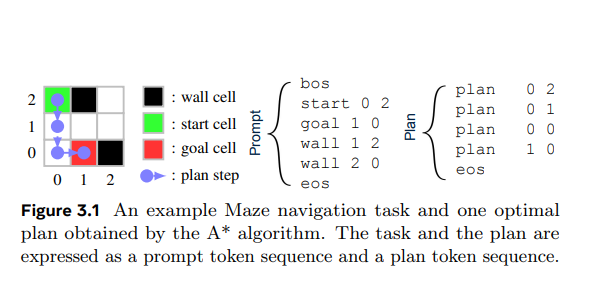

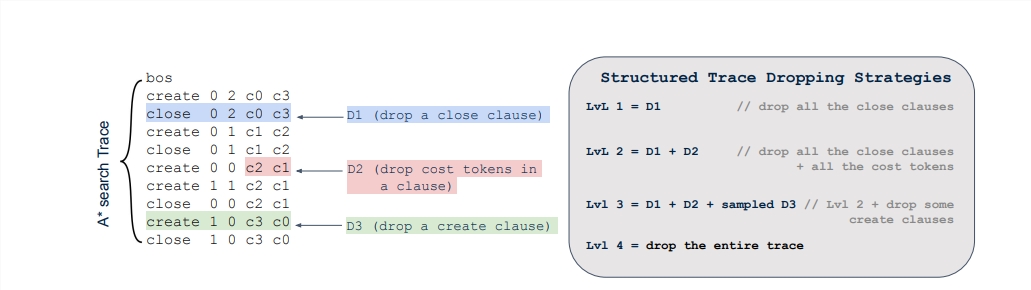

Ce qui est innovant avec le Dualformer, c'est la façon dont il est entraîné. Les chercheurs ont entraîné le modèle en utilisant des trajectoires d'inférence aléatoires, en supprimant au hasard différentes parties des trajectoires pendant l'entraînement, de la même manière qu'ils analysaient les processus de pensée humaine et créaient des raccourcis. Cette stratégie de formation permet à Dualformer de basculer de manière flexible entre différents modes pendant l'inférence :

Mode rapide : Dualformer génère uniquement la solution finale, ce qui est extrêmement rapide.

Mode lent : Dualformer produira une chaîne de raisonnement complète et une solution finale, avec des capacités de raisonnement plus fortes.

Mode automatique : Dualformer peut sélectionner automatiquement le mode approprié en fonction de la complexité de la tâche.

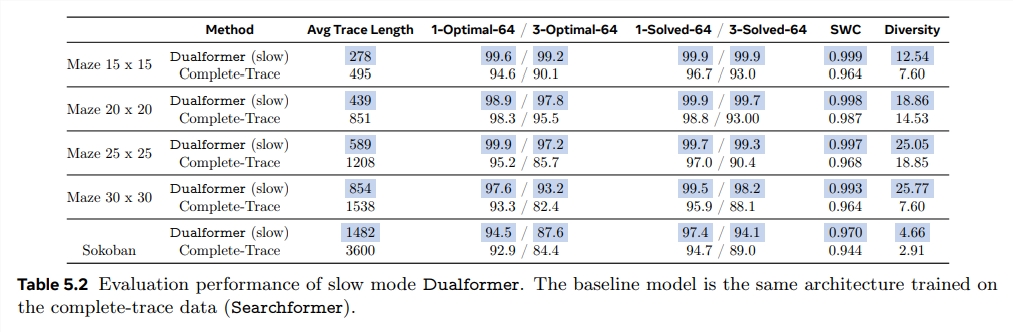

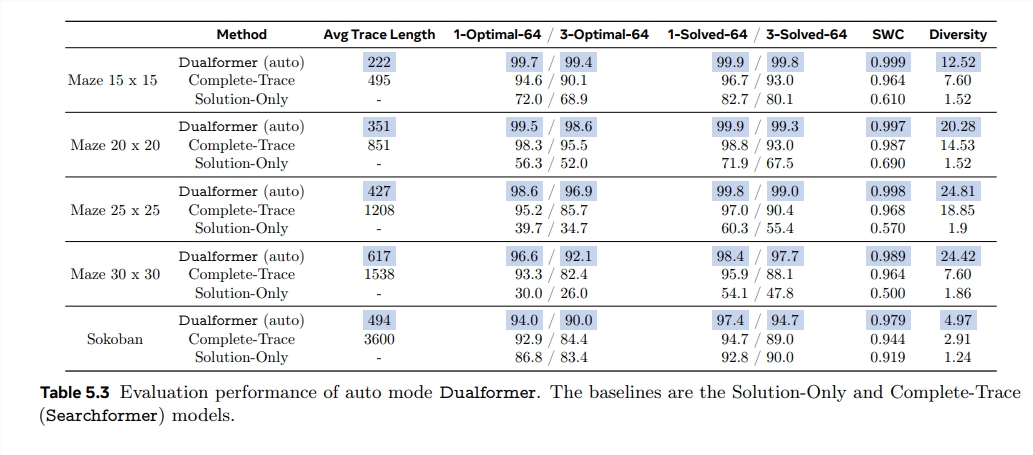

Les résultats expérimentaux montrent que Dualformer fonctionne bien dans des tâches telles que la navigation dans des labyrinthes et la résolution de problèmes mathématiques. En mode lent, Dualformer peut résoudre la tâche de navigation dans un labyrinthe 30x30 avec un taux de réussite de 97,6 %, surpassant le modèle Searchformer formé en utilisant uniquement des trajectoires d'inférence complètes, tout en réduisant les étapes d'inférence de 45,5 %.

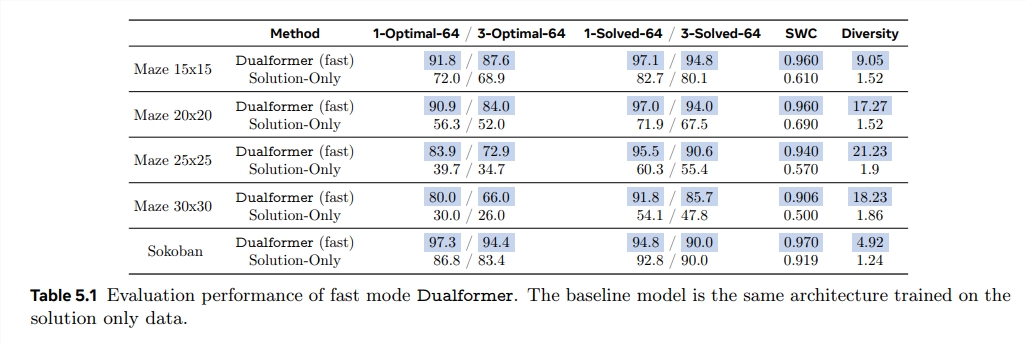

En mode rapide, le taux de réussite de Dualformer atteint également 80 %, ce qui est beaucoup plus élevé que le modèle Solution-Only formé en utilisant uniquement la solution finale. En mode automatique, Dualformer peut réduire considérablement les étapes d'inférence tout en conservant un taux de réussite élevé.

Le succès de Dualformer montre que l’application de la théorie cognitive humaine à la conception de modèles d’intelligence artificielle peut améliorer efficacement les performances des modèles. Ce modèle d'intégration de la pensée rapide et lente fournit de nouvelles idées pour créer des systèmes d'IA plus puissants et plus efficaces.

Adresse papier : https://arxiv.org/pdf/2410.09918

L'éditeur de Downcodes a conclu : L'émergence de Dualformer marque un grand pas en avant dans la conception de modèles d'intelligence artificielle plus proches des modèles de pensée humaine. Ses avancées en matière d'efficacité et de précision du raisonnement ouvrent de nouvelles orientations et un développement futur de la technologie de l'IA.