L'éditeur de Downcodes vous fera découvrir les dernières avancées des méta-chercheurs ! Ils ont utilisé le modèle Transformer pour résoudre un problème non résolu de longue date dans le domaine des systèmes dynamiques : trouver la fonction globale de Lyapunov. Cette recherche démontre non seulement les puissantes capacités des modèles de langage à grande échelle dans le raisonnement mathématique complexe, mais plus important encore, elle propose une méthode innovante de « génération inverse » qui résout efficacement le problème de l'insuffisance des données de formation et ouvre la voie à l'IA dans la découverte scientifique. Les applications y ont ouvert de nouvelles voies. Les résultats de la recherche ont été publiés sur arXiv et l'adresse papier a été fournie.

Les grands modèles de langage fonctionnent bien dans de nombreuses tâches, mais leurs capacités de raisonnement sont controversées. Des chercheurs de Meta ont récemment publié un article montrant comment ils utilisent le modèle Transformer pour résoudre un problème de longue date en mathématiques : la découverte de la fonction globale de Lyapunov d'un système dynamique.

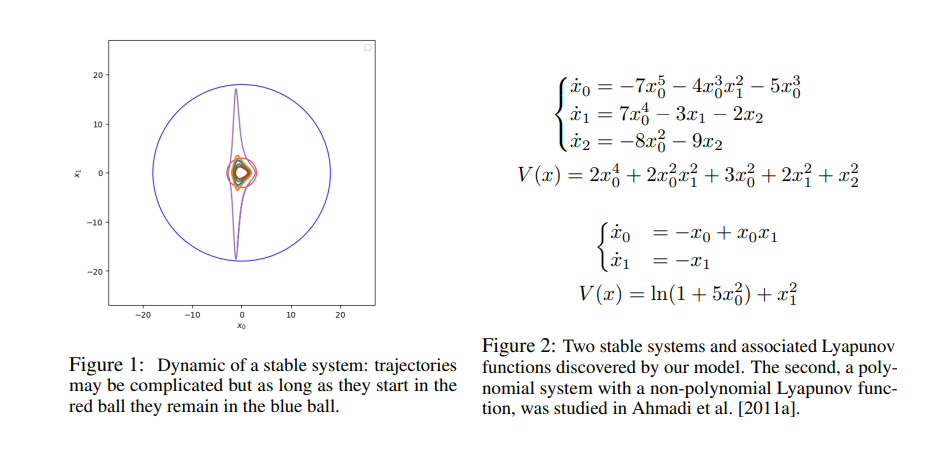

La fonction de Lyapunov peut déterminer si un système dynamique est stable. Par exemple, elle peut être utilisée pour prédire la stabilité à long terme du problème à trois corps, c'est-à-dire la trajectoire à long terme de trois corps célestes sous l'influence de la gravité. . Cependant, aucune méthode générale n'a encore été trouvée pour dériver la fonction de Lyapunov, et sa fonction correspondante n'est connue que pour quelques systèmes.

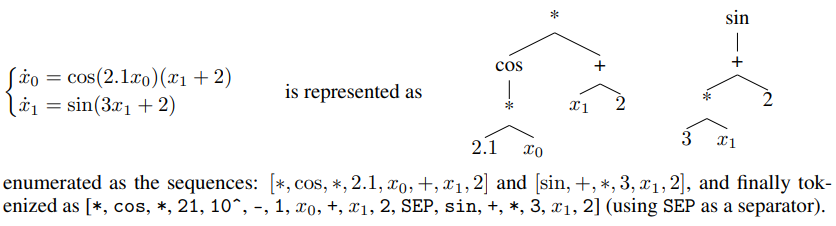

Pour résoudre ce problème, les chercheurs de Meta ont formé un modèle de transformateur séquence à séquence pour prédire la fonction de Lyapunov d'un système donné. Ils ont utilisé de manière innovante une approche de « génération inverse » pour créer un vaste ensemble de données de formation contenant des systèmes dynamiques stables et leurs fonctions de Lyapunov correspondantes.

La méthode traditionnelle de « génération directe » part d'un système généré aléatoirement et tente de calculer sa fonction de Lyapunov. Cette méthode est inefficace et ne peut gérer que certains types de systèmes simples. La méthode de « génération inverse » génère d'abord de manière aléatoire des fonctions de Lyapunov, puis construit un système stable qui leur correspond, contournant ainsi le problème du calcul des fonctions de Lyapunov et générant des données d'entraînement plus diverses.

Les chercheurs ont constaté que le modèle Transformer formé sur l'ensemble de données de « génération inverse » atteignait une précision presque parfaite sur l'ensemble de test (99 %) et fonctionnait également bien sur l'ensemble de test hors distribution (73 %). Ce qui est encore plus surprenant est qu'en ajoutant un petit nombre (300) d'exemples simples de « génération directe » à l'ensemble d'apprentissage, la précision du modèle peut être encore améliorée jusqu'à 84 %, ce qui montre que même un petit nombre de solutions connues peuvent Améliorer considérablement la précision du modèle.

Pour tester la capacité du modèle à découvrir de nouvelles fonctions de Lyapunov, les chercheurs ont généré des dizaines de milliers de systèmes aléatoires et ont utilisé le modèle pour faire des prédictions. Les résultats montrent que le modèle réussit dix fois plus à trouver des fonctions de Lyapunov sur des systèmes polynomiaux que les méthodes de pointe, et qu'il peut également trouver des fonctions de Lyapunov sur des systèmes non polynomiaux, ce qu'aucun algorithme actuel ne peut faire. petit.

Les chercheurs ont également comparé le modèle avec des mathématiciens humains. Ils ont invité 25 étudiants en maîtrise de mathématiques à effectuer un test, et les résultats ont montré que la précision du modèle était bien supérieure à celle des humains.

Cette recherche montre que les modèles Transformer peuvent être formés pour résoudre des problèmes de raisonnement mathématique complexes et que les méthodes de « génération inverse » peuvent créer efficacement des ensembles de données de formation qui surmontent les limites des méthodes traditionnelles. À l’avenir, les chercheurs prévoient d’appliquer cette méthode à d’autres problèmes mathématiques et d’explorer davantage de possibilités de l’IA dans la découverte scientifique.

Adresse papier : https://arxiv.org/pdf/2410.08304

Dans l’ensemble, les recherches de Meta fournissent de nouvelles idées et méthodes permettant à l’IA de résoudre des problèmes scientifiques complexes, et indiquent également que l’IA jouera un rôle de plus en plus important dans le domaine de la recherche scientifique. L'éditeur de Downcodes continuera de prêter attention aux derniers développements dans le domaine de l'IA et de proposer des rapports plus passionnants aux lecteurs !