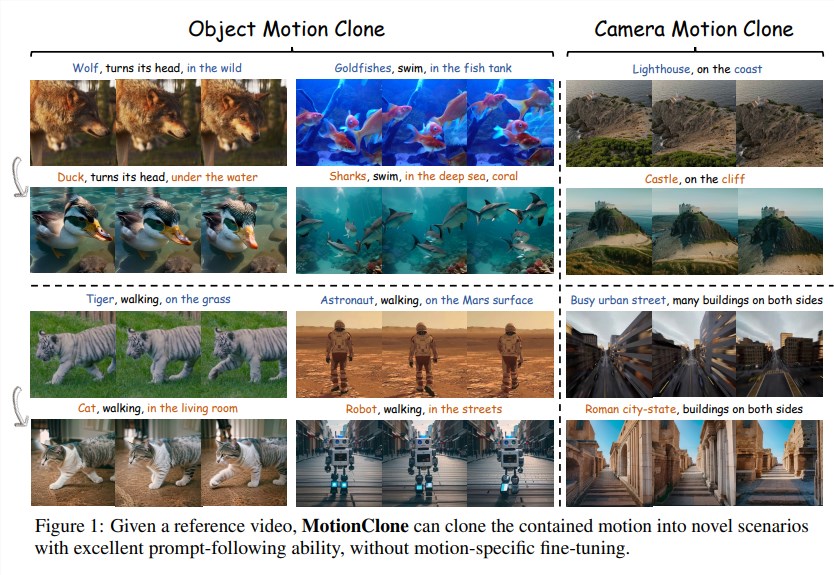

L'éditeur de Downcodes vous fera découvrir MotionClone, une technologie qui bouleverse la création vidéo ! Avec la vague de l’IA qui déferle sur le monde, les vidéos générées par texte ne sont plus un rêve lointain. Cependant, la manière de capturer et de reproduire avec précision le mouvement a toujours constitué un goulot d'étranglement technique dans ce domaine. MotionClone voit le jour, qui utilise intelligemment la vidéo de référence pour cloner le mouvement et l'applique de manière transparente à de nouvelles descriptions textuelles pour générer un contenu vidéo époustouflant. Cette technologie dépasse les limites des méthodes traditionnelles et apporte des changements révolutionnaires à la création vidéo. Explorons les mystères techniques qui se cachent derrière elle.

Dans le domaine de la création de contenu numérique, la technologie permettant de générer des vidéos basées sur des descriptions textuelles a toujours été un sujet de recherche brûlant. Ce serait vraiment excitant si nous pouvions cloner le mouvement d'une vidéo de référence, puis l'appliquer de manière transparente à de nouvelles descriptions textuelles pour créer un tout nouveau contenu vidéo. C'est le miracle que réalise la technologie MotionClone !

Bien que les modèles de génération texte-vidéo (T2V) existants aient fait certains progrès, ils sont encore confrontés à des défis en matière de synthèse d'action. Les méthodes traditionnelles nécessitent souvent une formation ou un réglage fin des modèles pour coder les signaux d'action, mais ces méthodes fonctionnent souvent mal lorsqu'il s'agit de types d'action invisibles.

MotionClone propose un framework sans formation qui clone les actions directement à partir de vidéos de référence pour contrôler la génération de texte en vidéo. Ce cadre utilise un mécanisme d'attention temporelle pour capturer les actions dans des vidéos de référence et introduit un guidage d'attention temporelle primaire pour réduire l'impact du bruit ou des petits mouvements sur les poids d'attention. De plus, afin d'aider le modèle génératif à synthétiser des relations spatiales raisonnables et à améliorer sa capacité à suivre des signaux, les chercheurs ont proposé un mécanisme de guidage sémantique sensible à la position.

Points forts techniques :

Mécanisme d'attention temporelle : représentation d'actions dans des vidéos de référence par inversion vidéo.

Guidage d'attention temporelle principale : seuls les composants principaux du poids d'attention temporelle sont utilisés pour la génération vidéo guidée par l'action.

Guidage sémantique sensible à la position : tirer parti des emplacements approximatifs du premier plan dans les vidéos de référence et des fonctionnalités guidées brutes sans classificateur pour guider la génération de vidéos.

Grâce à des expériences approfondies, MotionClone a démontré d'excellentes capacités en matière de mouvement global de la caméra et de mouvement d'objet local, avec des avantages significatifs en termes de fidélité du mouvement, d'alignement du texte et de cohérence temporelle.

L'avènement de la technologie MotionClone a apporté des changements révolutionnaires dans le domaine de la création vidéo. Cela peut non seulement améliorer la qualité de la génération de contenu vidéo, mais également améliorer considérablement l'efficacité de la création. À mesure que cette technologie continue de se développer et de s'améliorer, nous avons des raisons de croire que la création vidéo future sera plus intelligente et personnalisée, et sera même capable de réaliser la vision créative du « ce que vous voulez est ce que vous obtenez ».

Adresse du projet : https://top.aibase.com/tool/motionclone

Avec ses avantages techniques uniques, MotionClone apporte de nouvelles possibilités à la création vidéo. Ses fonctionnalités efficaces et pratiques amélioreront considérablement l'efficacité de la création de contenu. Il vaut la peine d'attendre avec impatience son développement et ses applications futurs !