Un récent rapport de recherche publié par Google prévient que l'intelligence artificielle générative (GenAI) pollue Internet avec de faux contenus. Le rapport souligne qu'il existe d'innombrables cas d'abus de GenAI, allant de la falsification de portraits à la fabrication de preuves, principalement dans le but d'influencer l'opinion publique, de frauder ou de réaliser des profits. Google lui-même est également devenu un créateur de désinformation en raison de ses produits d’IA qui ont donné des suggestions ridicules, ce qui rend ses avertissements encore plus alarmants et incite les gens à réfléchir profondément aux risques potentiels de GenAI.

Récemment, des chercheurs de Google ont averti que l’intelligence artificielle générative (GenAI) détruisait Internet avec de faux contenus. Ce n’est pas seulement un avertissement, mais aussi un moment d’introspection.

Ironiquement, Google joue un double rôle dans cette « guerre entre la vérité et le mensonge ». D’une part, elle est un important promoteur de l’IA générative et, d’autre part, elle est également productrice de désinformation. La fonction de présentation de l'IA de Google contenait des suggestions ridicules telles que « mettre de la colle sur la pizza » et « manger des pierres », et ces messages erronés ont finalement dû être supprimés manuellement.

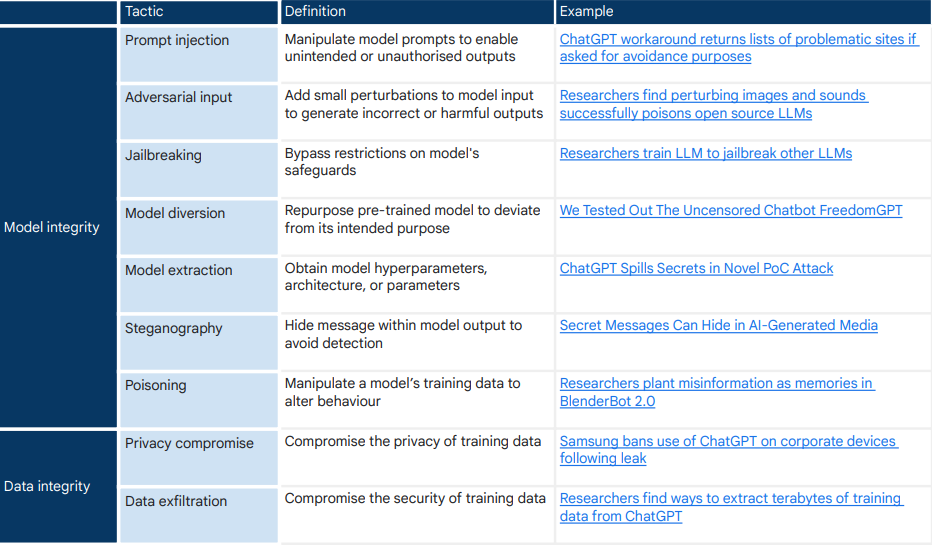

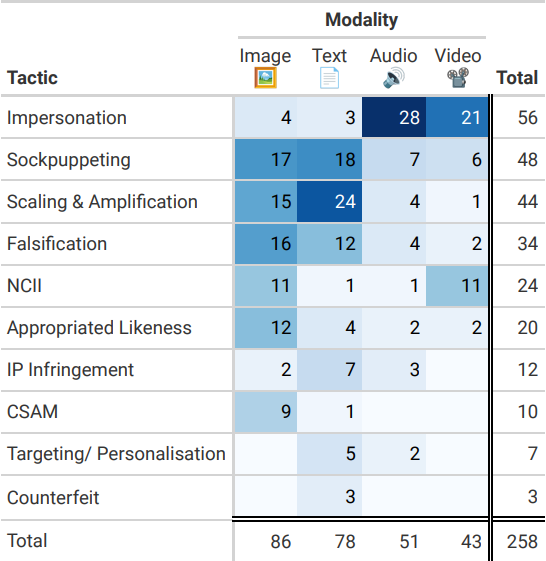

L'équipe de recherche de Google a mené une enquête approfondie sur 200 reportages sur les abus liés à l'IA générative et a découvert que la falsification de portraits humains et la fabrication de preuves étaient les méthodes d'abus les plus courantes. Le but de ces actions n’est rien d’autre que d’influencer l’opinion publique, de frauder ou de réaliser un profit. Même si les risques liés à l’IA générative n’ont pas encore atteint le niveau de « menace existentielle », ils existent déjà et pourraient s’aggraver à l’avenir.

Les chercheurs ont découvert que la plupart des cas d'abus de GenAI concernaient une utilisation normale du système et n'impliquaient pas de comportement de « jailbreak ». Ce type d'« opération de routine » représente 90 %. La disponibilité généralisée, l’accessibilité et l’hyperréalisme de GenAI permettent des formes infinies d’abus de niveau inférieur. Le coût de la génération de fausses informations est trop faible !

Les documents de recherche de Google proviennent en grande partie de rapports médiatiques. Cela signifie-t-il que les conclusions de la recherche sont biaisées par les médias ? Les médias sont plus enclins à rapporter des événements sensationnels, ce qui peut entraîner un biais en faveur de types spécifiques d'abus ? 404Media souligne qu’il existe de nombreux abus non signalés en matière d’IA générative dont nous n’avons pas encore connaissance.

Les « barrières » des outils d’IA peuvent être intelligemment contournées grâce à quelques astuces. Par exemple, l’outil de clonage vocal d’ElevenLabs peut imiter les voix de collègues ou de célébrités avec un haut degré de fidélité. Les utilisateurs de Civitai peuvent créer des images de célébrités générées par l'IA, et bien que la plate-forme ait une politique contre les NCII (images intimes sans consentement), rien n'empêche les utilisateurs d'utiliser des outils open source pour générer des NCII sur leurs propres machines.

Lorsque de fausses informations se répandent, le chaos sur Internet mettra à rude épreuve la capacité des gens à distinguer la vérité du mensonge. Nous serons piégés dans un état de doute constant : « Est-ce réel ? » Si rien n’est fait, la contamination des données publiques par le contenu généré par l’IA peut également entraver la recherche d’informations et fausser les perceptions collectives de la réalité sociopolitique ou du consensus scientifique.

Google a contribué à la prolifération de faux contenus provoqués par l'IA générative. La balle tirée il y a de nombreuses années l'a finalement touché aujourd'hui entre les sourcils. Les recherches de Google pourraient être le début d’un salut personnel et un signal d’alarme pour l’ensemble de la société Internet.

Adresse papier : https://arxiv.org/pdf/2406.13843

Ce rapport de Google constitue sans aucun doute un avertissement pour le développement futur de GenAI. Comment équilibrer le développement technologique et le contrôle des risques, et comment répondre efficacement à la prolifération de fausses informations apportées par GenAI, sont des défis communs auxquels sont confrontées la communauté technologique et la société mondiales. Nous attendons avec impatience davantage de recherches et d’actions pour maintenir conjointement l’authenticité et la pureté d’Internet.