Imaginez pouvoir générer de la musique ou des effets sonores de haute qualité avec seulement quelques bourdonnements ou battements. Ce n'est plus un rêve lointain. Sketch2Sound, résultat d'une recherche révolutionnaire en matière d'IA, permet une génération audio de haute qualité en combinant imitation sonore et invites textuelles. Il utilise intelligemment les trois signaux de contrôle clés que sont le volume, la luminosité et la hauteur extraits de l'imitation sonore, et les intègre dans le modèle potentiel de diffusion du texte en audio, guidant ainsi l'IA pour générer des sons qui répondent à des exigences spécifiques, apportant de grands avantages au domaine de création sonore.

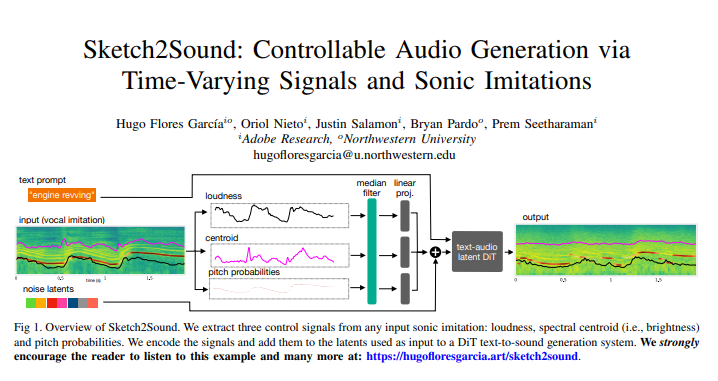

La technologie de base de Sketch2Sound est sa capacité à extraire trois signaux de contrôle clés, variables dans le temps, à partir de toute imitation sonore (telle qu'une imitation vocale ou un son de référence) : le volume, la luminosité (centre de gravité spectral) et la hauteur. Une fois ces signaux de contrôle codés, ils sont ajoutés au modèle de diffusion sous-jacent utilisé pour la génération texte-son, guidant ainsi l'IA pour générer des sons répondant à des exigences spécifiques.

Ce qui impressionne le plus dans cette technologie, c’est sa légèreté et son efficacité. Sketch2Sound est construit sur le modèle de diffusion latente texte-audio existant, ne nécessitant que 40 000 étapes de réglage fin et une seule couche linéaire pour chaque signal de contrôle, ce qui le rend plus concis et efficace que d'autres méthodes (telles que ControlNet). Pour permettre au modèle de synthétiser à partir d'imitations sonores de type « esquisse », les chercheurs ont également appliqué un filtre médian stochastique au signal de contrôle pendant l'entraînement, lui permettant de s'adapter aux signaux de contrôle dotés de caractéristiques temporelles flexibles. Les résultats expérimentaux montrent que Sketch2Sound peut non seulement synthétiser des sons conformes au signal de contrôle d'entrée, mais également maintenir la conformité aux invites textuelles et atteindre une qualité audio comparable à la ligne de base du texte brut.

Sketch2Sound offre aux artistes sonores une nouvelle façon de créer. Ils peuvent exploiter la flexibilité sémantique des invites textuelles, combinée à l’expressivité et à la précision des gestes vocaux ou des imitations, pour créer des compositions sonores sans précédent. Ceci est similaire aux artistes Foley traditionnels qui créent des effets sonores en manipulant des objets, tandis que Sketch2Sound guide la génération sonore par l'imitation sonore, apportant une touche « humanisée » à la création sonore et améliorant la valeur artistique des œuvres sonores.

Sketch2Sound est capable de surmonter ses limites par rapport aux méthodes traditionnelles d'interaction texte-audio. Dans le passé, les concepteurs sonores devaient passer beaucoup de temps à ajuster les caractéristiques temporelles des sons générés pour les synchroniser avec les effets visuels. Sketch2Sound peut naturellement réaliser cette synchronisation grâce à l'imitation sonore, et ne se limite pas à l'imitation de la voix humaine, quel que soit le type de son. l’imitation peut être utilisée pour piloter ce modèle génératif.

Les chercheurs ont également développé une technique pour ajuster les détails temporels du signal de contrôle en appliquant des filtres médians de différentes tailles de fenêtre pendant l'entraînement. Cela permet aux artistes sonores de contrôler dans quelle mesure le modèle génératif adhère à la précision temporelle du signal de contrôle, améliorant ainsi la qualité des sons difficiles à imiter parfaitement. Dans les applications pratiques, les utilisateurs peuvent trouver un équilibre entre le strict respect de l'imitation sonore et la garantie de la qualité audio en ajustant la taille du filtre médian.

Le principe de fonctionnement de Sketch2Sound consiste à extraire d'abord trois signaux de contrôle du volume, du centre de gravité du spectre et de la hauteur du signal audio d'entrée. Ces signaux de contrôle sont ensuite alignés avec les signaux latents dans le modèle texte-son, et le modèle de diffusion latente est ajusté via une simple couche de projection linéaire pour finalement générer le son souhaité. Les résultats expérimentaux montrent que le conditionnement du modèle via un contrôle variable dans le temps du signal peut améliorer considérablement la conformité avec ce signal, tout en ayant un impact minimal sur la qualité audio et la conformité du texte.

Les chercheurs ont notamment découvert que les signaux de contrôle peuvent manipuler la sémantique des signaux générés. Par exemple, lors de l'utilisation de l'invite textuelle « ambiance forestière », si des salves d'intensité sonore aléatoires sont ajoutées à l'imitation sonore, le modèle peut synthétiser les cris d'oiseaux dans ces salves d'intensité sonore sans l'invite supplémentaire « oiseaux », indiquant que le modèle a appris la corrélation entre éclats de volume et présence d’oiseaux.

Bien sûr, Sketch2Sound présente certaines limites, comme le fait que le contrôle du centre de masse peut incorporer les tonalités de la pièce modélisées par les sons d'entrée dans l'audio généré, peut-être parce que les tonalités de la pièce sont codées par le centre de masse lorsqu'il y a aucun événement sonore dans l’audio d’entrée.

Dans l'ensemble, Sketch2Sound est un puissant modèle sonore génératif qui peut générer des sons via des invites textuelles et des commandes variables dans le temps (intensité, luminosité, hauteur). Il peut générer des sons via des imitations sonores et des courbes de contrôle « esquisses », et est léger et efficace. Il fournit aux artistes sonores un outil contrôlable, basé sur les gestes et expressif, capable de générer des sons avec un timing flexible. Tout son ayant des caractéristiques uniques aura une large portée. perspectives d'application dans les domaines de la création musicale et de la conception sonore de jeux à l'avenir.

Adresse papier : https://arxiv.org/pdf/2412.08550

L'émergence de Sketch2Sound annonce une nouvelle ère dans le domaine de la création sonore. Il offre aux artistes une liberté et des possibilités créatives sans précédent, et apporte également un espace d'imagination illimité à la musique, aux jeux, aux films et à d'autres domaines. Je pense que dans un avenir proche, cette technologie sera plus largement utilisée et nous apportera un monde sonore plus coloré.