Les deepfakes, en tant qu’intelligence artificielle contradictoire en développement rapide, constituent une menace de plus en plus grave pour l’économie et la sécurité mondiales. Les dommages économiques qui en résulteront devraient s’aggraver considérablement, le secteur des services bancaires et financiers étant une cible majeure. Cet article analysera la tendance au développement rapide de la technologie deepfake, les risques et les défis qu'elle pose aux entreprises et aux particuliers, et explorera les dilemmes auxquels les entreprises sont confrontées lorsqu'elles font face à cette menace émergente.

En tant que forme d’intelligence artificielle adverse qui connaît la croissance la plus rapide, les pertes liées aux deepfakes devraient passer de 12,3 milliards de dollars américains en 2023 à 40 milliards de dollars américains en 2027, soit un taux de croissance annuel composé de 32 %. Deloitte s’attend à ce que les deepfakes prolifèrent dans les années à venir, les banques et les services financiers étant des cibles privilégiées.

Les deepfakes sont à l’avant-garde des attaques adverses d’IA, avec une croissance de 3 000 % au cours de la seule année dernière. Les deepfakes devraient augmenter de 50 à 60 % d’ici 2024, avec 140 000 à 150 000 incidents de ce type attendus dans le monde cette année.

La dernière génération d’applications, d’outils et de plateformes d’IA générative offre aux attaquants tout ce dont ils ont besoin pour créer des vidéos deepfake, des voix usurpées et des documents frauduleux rapidement et à moindre coût. Le rapport 2024 Speech Intelligence and Security de Pindrops estime que la fraude deepfake ciblant les centres de contact coûte environ 5 milliards de dollars par an. Leur rapport souligne la grave menace que représentent les deepfakes pour les services bancaires et financiers.

Bloomberg a rapporté l’année dernière qu’« une industrie artisanale entière a émergé sur le dark web vendant des fraudeurs à des prix allant de 20 $ à des milliers de dollars ». .

Un tiers des entreprises ne disposent d’aucune stratégie pour faire face au risque d’attaques adverses par l’IA, qui commenceront très probablement par des deepfakes de leurs principaux dirigeants. Une nouvelle étude d'Ivanti révèle que 30 % des entreprises n'ont aucun plan pour identifier et se défendre contre les attaques adverses d'IA.

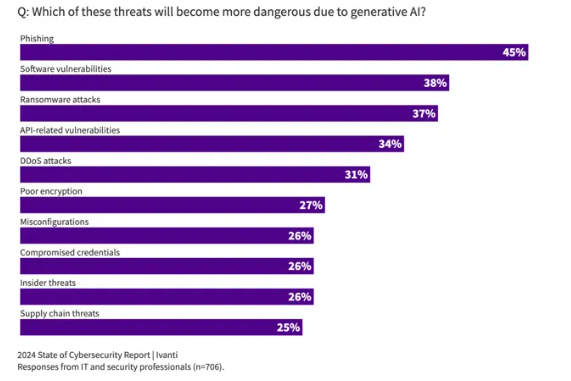

Le rapport Ivanti sur l'état de la cybersécurité 2024 révèle que 74 % des entreprises interrogées ont constaté des preuves de menaces liées à l'IA. Une écrasante majorité (89 %) pense que la menace de l’IA ne fait que commencer. Parmi la majorité des RSSI, DSI et responsables informatiques interrogés par Ivanti, 60 % s'inquiétaient du fait que leur organisation n'était pas préparée à se défendre contre les menaces et les attaques de l'IA. L'utilisation de deepfakes dans le cadre de stratégies orchestrées comprenant le phishing, les exploits logiciels, les ransomwares et les vulnérabilités liées aux API est de plus en plus courante. Cela est cohérent avec les menaces qui, selon les professionnels de la sécurité, vont devenir plus dangereuses en raison de la nouvelle génération d’intelligence artificielle.

Face au développement rapide de la technologie de contrefaçon profonde et aux risques énormes qu'elle entraîne, les entreprises doivent activement prendre des contre-mesures, renforcer la protection de la sécurité et améliorer la sensibilisation aux risques des employés afin de réduire efficacement les pertes et d'assurer leur propre sécurité. Les progrès technologiques doivent également être développés simultanément avec l’amélioration des mesures de sécurité pour empêcher les abus technologiques.