Adobe, en tant que géant dans le domaine des logiciels de création, a suscité une énorme controverse en mettant à jour ses conditions d'utilisation. Cette mise à jour permet à Adobe d'accéder aux travaux des utilisateurs pour améliorer son modèle d'IA Firefly, une décision qui a été largement critiquée comme une « clause dominante » qui viole les droits d'auteur et la vie privée des utilisateurs. Cet article fournira une analyse approfondie de la controverse provoquée par la mise à jour des conditions de service d'Adobe, explorera les raisons qui la sous-tendent et la relation de plus en plus tendue entre les entreprises technologiques et les utilisateurs.

Adobe, un nom bien connu dans les industries créatives, est connu sous le nom de « Copyright Guardian » pour sa position en matière de protection des droits d'auteur. Mais récemment, l'entreprise a été prise dans le vortex de l'opinion publique en raison de conditions d'utilisation discrètement mises à jour.

En février de cette année, Adobe a discrètement mis à jour les conditions de service de ses produits, en ajoutant un ajout accrocheur : les utilisateurs doivent accepter qu'Adobe puisse accéder à leurs œuvres par des moyens automatisés et manuels, y compris ceux protégés par des accords de non-divulgation. Adobe utilisera ces travaux pour améliorer ses services et logiciels grâce à des technologies telles que l'apprentissage automatique. Si les utilisateurs n'acceptent pas ces nouvelles conditions, ils ne pourront pas utiliser le logiciel Adobe.

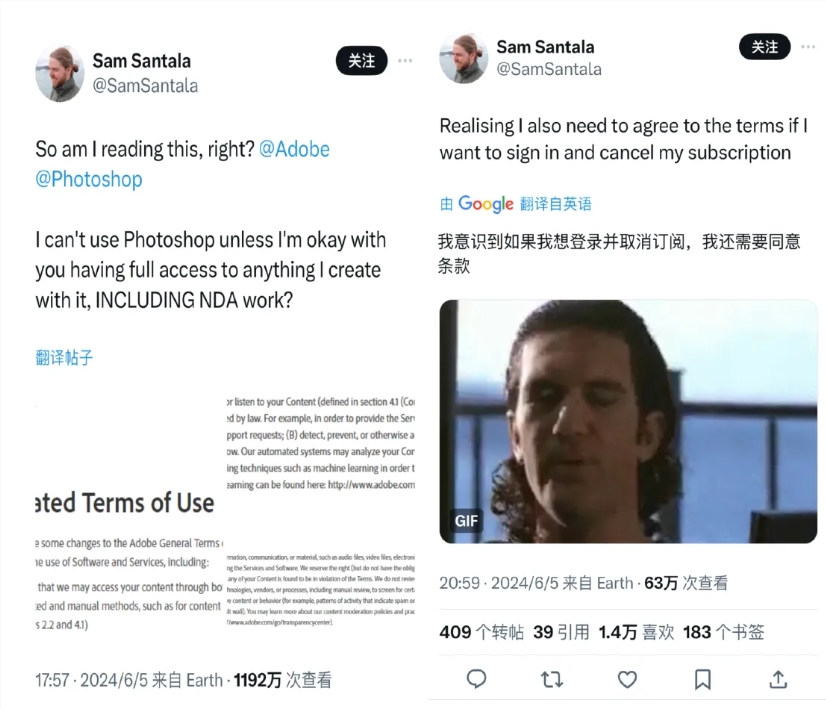

Le changement a été récemment révélé, déclenchant une réaction négative de la part des principaux utilisateurs d'Adobe, notamment des créatifs, des artistes numériques et des designers. Ils estiment qu'il s'agit d'une autorisation obligatoire, essentiellement une « clause de suzerain », et que son véritable objectif est de former le modèle d'IA générative d'Adobe « Firefly ». Un blogueur nommé Sam Santala a remis en question cette disposition sur Twitter, et son tweet a été vu des dizaines de millions de fois.

De nombreux utilisateurs ont exprimé leurs inquiétudes concernant leur vie privée et leurs droits d'auteur et ont choisi de cesser d'utiliser les produits Adobe. Dans le même temps, Meta a pris des mesures similaires et a mis à jour sa politique de confidentialité pour permettre l'utilisation des informations partagées par les utilisateurs sur les produits et services Meta pour former l'IA. Si les utilisateurs n'acceptent pas la nouvelle politique de confidentialité, ils devraient envisager de cesser d'utiliser les produits de médias sociaux tels que Facebook et Instagram.

Avec le développement rapide de la technologie de l’IA, la bataille entre les entreprises technologiques et les utilisateurs sur la confidentialité des données, la propriété et le contrôle du contenu est devenue de plus en plus féroce. Adobe affirme que les données de formation pour son modèle Firefly proviennent de centaines de millions d'images dans la bibliothèque d'images Adobe, de certaines images sous licence publique et d'images publiques dont la protection des droits d'auteur a expiré. Cependant, d'autres outils de génération d'images d'IA, tels que Stable Diffusion de Stability AI, Dall-E2 d'OpenAI et Midjourney, ont été controversés en raison de problèmes de droits d'auteur.

Adobe tente d'adopter un positionnement différencié sur le marché dans ce domaine et de devenir un « chevalier blanc » dans la course aux armements de l'IA, en soulignant la légitimité de ses données de formation de modèles et en promettant de payer les réclamations dans les litiges en matière de droits d'auteur causés par l'utilisation des images générées. par Adobe Firefly. Mais cette stratégie n'a pas apaisé les inquiétudes de tous les utilisateurs. Certains utilisateurs, comme le designer senior Ajie, se qualifient en plaisantant de « véritables victimes d'Adobe » et pensent qu'Adobe utilise son vaste écosystème créatif pour former l'IA, bien qu'il s'agisse d'une stratégie commerciale intelligente, pour les utilisateurs, la plate-forme et la création. les utilisateurs et le droit de l'utilisateur à savoir font défaut.

En outre, des différends en matière de droits d'auteur avec Adobe ont été révélés à plusieurs reprises à l'étranger, amenant les utilisateurs à se demander si Adobe respecte réellement les droits d'auteur des créateurs. Par exemple, l’artiste Brian Kesinger a découvert que des images générées par l’IA, similaires à son travail, étaient vendues sous son nom dans la bibliothèque d’images Adobe sans son consentement. La succession du photographe Ansel Adams a également publiquement accusé Adobe d'avoir prétendument vendu des répliques génératives d'IA du travail du défunt photographe.

Sous la pression de l'opinion publique, Adobe a révisé ses conditions de service le 19 juin, précisant qu'il n'utiliserait pas le contenu des utilisateurs stocké localement ou dans le cloud pour entraîner des modèles d'IA. Mais cette clarification n’a pas entièrement apaisé les inquiétudes des créateurs. Certains blogueurs bien connus du cercle de l'IA à l'étranger ont souligné que les conditions d'utilisation révisées d'Adobe autorisent toujours l'utilisation des données du cloud privé des utilisateurs pour former des modèles d'apprentissage automatique d'outils d'IA non génératifs. Bien que les utilisateurs puissent se désinscrire de « l’analyse de contenu », l’opération compliquée d’annulation rebute souvent de nombreux utilisateurs.

Différents pays et régions ont des réglementations différentes en matière de protection des données des utilisateurs, ce qui affecte également les stratégies des plateformes de médias sociaux lors de la formulation des conditions d'utilisation des utilisateurs. Par exemple, en vertu du Règlement général sur la protection des données (RGPD), les utilisateurs du Royaume-Uni et de l’UE ont un « droit d’opposition » et peuvent explicitement refuser que leurs données personnelles soient utilisées pour entraîner les modèles d’intelligence artificielle de Meta. Cependant, les utilisateurs américains n'ont pas le même droit de savoir. Selon la politique de partage de données existante de Meta, le contenu publié par les utilisateurs américains sur les produits de médias sociaux de Meta peut avoir été utilisé pour entraîner l'IA sans consentement explicite.

Les données ont été saluées comme le « nouveau pétrole » à l’ère de l’IA, mais il existe encore de nombreuses zones d’ombre dans « l’exploitation » des ressources. Certaines entreprises technologiques ont adopté une approche vague pour obtenir les données des utilisateurs, ce qui a déclenché un double dilemme concernant les droits des utilisateurs en matière d'informations personnelles : la propriété des droits d'auteur numériques et les problèmes de confidentialité des données, nuisant gravement à la confiance des utilisateurs dans la plateforme.

À l’heure actuelle, la plateforme présente encore des lacunes majeures pour garantir que l’IA générative ne porte pas atteinte aux droits des créateurs, et elle manque également d’un contrôle adéquat. Certains développeurs et créateurs ont pris des mesures et ont lancé une série d'outils « anti-IA », de l'outil de protection du travail Glaze à l'outil d'empoisonnement des données d'IA Nightshade, en passant par la communauté anti-IA Cara, devenue populaire face à Utilisation non autorisée des utilisateurs/créateurs par les entreprises technologiques. Avec le consentement de l'auteur, les données pertinentes sont capturées pour entraîner le modèle d'IA, et la colère des gens s'est intensifiée.

Aujourd'hui, avec le développement rapide de la technologie de l'IA, la manière d'équilibrer l'innovation technologique et la sécurité de la vie privée des utilisateurs et de protéger les droits et les intérêts des créateurs nécessite encore un développement plus poussé de l'industrie et une amélioration continue des mesures réglementaires juridiques. Dans le même temps, les utilisateurs doivent être plus vigilants, comprendre leurs droits en matière de données et prendre les mesures nécessaires pour protéger leurs créations et leur vie privée.

L'incident d'Adobe n'est que la pointe de l'iceberg des problèmes de compromis en matière de données à l'ère de l'IA. À l'avenir, trouver un équilibre entre le progrès technologique et les droits des utilisateurs deviendra une question importante pour toutes les entreprises technologiques et les agences de réglementation. . Ce n’est qu’en renforçant la supervision et en clarifiant les règles d’utilisation des données que nous pourrons construire un environnement écologique d’IA plus sain et plus durable.