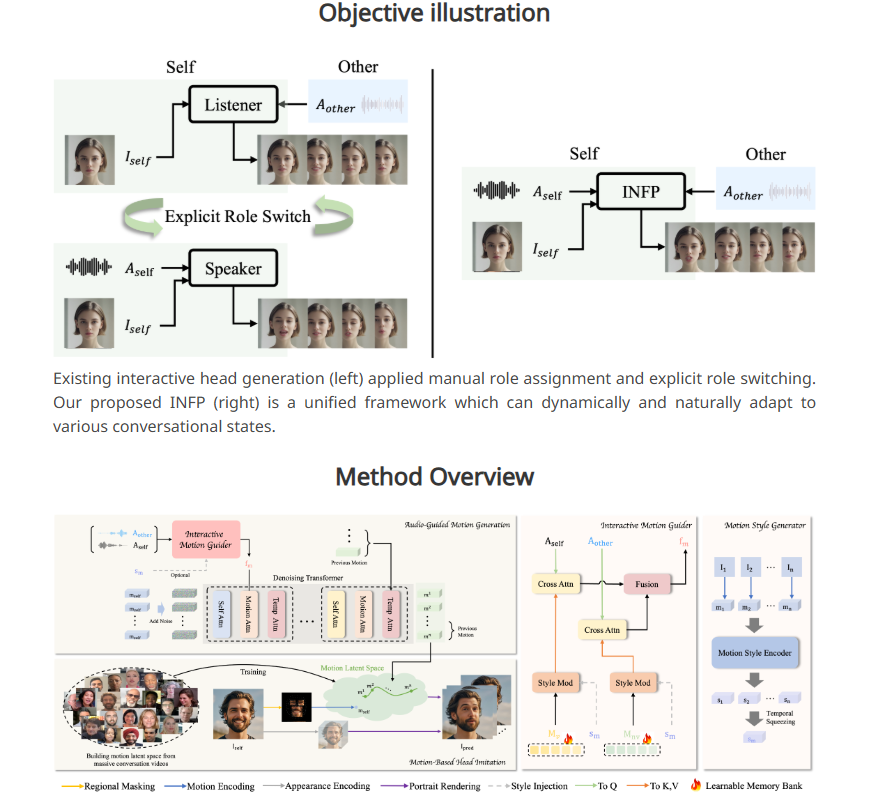

ByteDance a lancé un nouveau système d'IA, INFP, qui permet aux portraits statiques de « parler » et de réagir via une entrée audio. Contrairement à la technologie traditionnelle, INFP n'a pas besoin de spécifier manuellement les rôles. Le système peut automatiquement juger en fonction de la conversation, ce qui améliore considérablement l'efficacité et la commodité. Sa technologie de base réside dans les deux étapes de « l'imitation de la tête basée sur le mouvement » et de la « génération de mouvements audio-guidées ». En analysant les expressions faciales, les mouvements de la tête et les entrées audio dans les conversations, il génère des modèles de mouvements naturels et fluides pour faire apparaître des images statiques. à la vie. Afin de former INFP, ByteDance a également construit un ensemble de données DyConv contenant plus de 200 heures de vidéos de conversation réelles pour garantir une sortie de haute qualité du système.

Le flux de travail de l'INFP comporte deux étapes principales. Dans la première étape, appelée « mimétisme de la tête basé sur le mouvement », le système extrait les détails de la vidéo en analysant les expressions faciales et les mouvements de la tête des personnes pendant les conversations. Ces données de mouvement sont converties dans un format qui peut être utilisé dans des animations ultérieures, permettant aux photos de correspondre au mouvement du personnage d'origine.

La deuxième étape est la « génération de mouvements audio-guidés », où le système génère des modèles de mouvements naturels basés sur l'entrée audio. L'équipe de recherche a développé un « guide de mouvement » qui analyse l'audio des deux parties dans une conversation afin de créer des schémas de mouvement pour parler et écouter. Un composant d’IA appelé Diffusion Transformer optimise ensuite progressivement ces modèles, résultant en un mouvement fluide et réaliste qui correspond parfaitement au contenu audio.

Afin de former efficacement le système, l'équipe de recherche a également établi un ensemble de données de dialogue appelé DyConv, qui collecte plus de 200 heures de vidéos de dialogue réel. Par rapport aux bases de données de conversations existantes telles que ViCo et RealTalk, DyConv présente des avantages uniques en termes d'expression émotionnelle et de qualité vidéo.

ByteDance affirme qu'INFP surpasse les outils existants dans plusieurs domaines clés, notamment en faisant correspondre les mouvements des lèvres à la parole, en préservant les traits individuels du visage et en créant divers mouvements naturels. De plus, le système a tout aussi bien fonctionné lors de la génération de vidéos dans lesquelles seul l’interlocuteur était entendu.

Bien qu'INFP ne prenne actuellement en charge que l'entrée audio, l'équipe de recherche explore la possibilité d'étendre le système aux images et au texte. L'objectif futur est de pouvoir créer des animations réalistes du corps entier du personnage. Cependant, étant donné que ce type de technologie pourrait être utilisé pour créer de fausses vidéos et diffuser des informations erronées, l'équipe de recherche prévoit de limiter l'utilisation de la technologie de base aux instituts de recherche, à l'instar de la gestion par Microsoft de son système avancé de clonage vocal.

Cette technologie fait partie de la stratégie plus large d'IA de ByteDance. S'appuyant sur ses applications populaires TikTok et CapCut, ByteDance dispose d'une vaste plateforme d'applications innovantes en matière d'IA.

Entrée du projet : https://grisoon.github.io/INFP/

Points forts:

INFP peut permettre aux portraits statiques de « parler » via l'audio et de déterminer automatiquement le rôle de dialogue.

Le système fonctionne en deux étapes : premièrement, il extrait les détails des mouvements dans les conversations humaines, et deuxièmement, il convertit l'audio en modèles de mouvements naturels.

L'ensemble de données DyConv de ByteDance contient plus de 200 heures de vidéos de conversation de haute qualité pour aider à améliorer les performances du système.

Le lancement du système INFP démontre la force d'innovation de ByteDance dans le domaine de l'intelligence artificielle. Son potentiel de développement futur est énorme, mais les risques éthiques potentiels doivent également être traités avec prudence. Le progrès technologique doit toujours être orienté vers les intérêts sociaux et garantir qu’il soit utilisé au profit de l’humanité.