L'intelligence artificielle a fait de grands progrès dans le traitement multi-modes, mais les modèles à haute performance nécessitent souvent d'énormes ressources informatiques, ce qui limite son application sur l'équipement de bord. En réponse à ce défi, OpenBMB a lancé un modèle multimodal efficace MINICPM-O2.6, qui vise à combler l'écart entre la technologie AI avancée et l'équipement restreint des ressources. MINICPM-O 2,66 a 8 milliards de paramètres, intégrant les modules de traitement visuel, vocal et linguistique, et est optimisé.

Ces dernières années, la technologie de l'intelligence artificielle a fait des progrès significatifs, mais il y a encore des défis entre l'efficacité informatique et la multifonctionnalité. De nombreux modèles multimode avancés, tels que GPT-4, nécessitent généralement un grand nombre de ressources informatiques, ce qui limite leur utilisation sur des serveurs haut de gamme, ce qui entraîne une utilisation efficace sur des périphériques de bord tels que les smartphones et les tablettes. De plus, les tâches telles que l'analyse vidéo ou le texte de transfert de voix en temps réel sont toujours confrontées à des obstacles techniques, mettant en évidence la demande de modèles d'IA à haute efficacité et flexibles, afin d'obtenir un fonctionnement transparent dans des conditions matérielles limitées.

Afin de résoudre ces problèmes, OpenBMB a récemment lancé MINICPM-O 2.6, ce modèle avec une architecture de paramètres de 8 milliards pour prendre en charge le traitement de la vision, de la voix et du langage, et peut efficacement sur des appareils marginaux tels que les smartphones, les tablettes et les iPad. MINICPM-O2.6 utilise une conception modulaire et intègre un certain nombre de composants puissants:

-Siglip-400m pour une compréhension visuelle.

-Whisper-300M implémente le traitement vocal multi-langues.

-Chattts-200M offre une capacité de dialogue.

-Qwen2.5-7b est utilisé pour une compréhension avancée du texte.

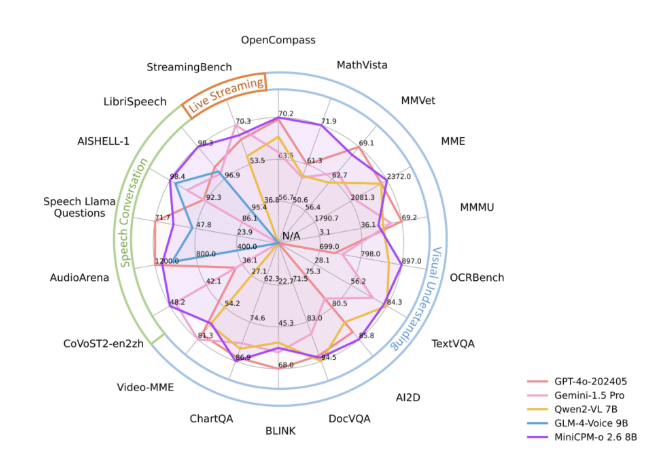

Ce modèle a obtenu un score moyen de 70,2 dans le test de référence OpenCompass, dépassant le GPT-4V dans les tâches visuelles. Son support multi-langue et son fonctionnement efficace sur l'équipement de niveau consommateur le rendent pratique dans divers scénarios d'application.

MINICPM-O2.6 obtient de solides performances grâce aux détails techniques suivants:

-L'optimisation des paramètres: bien que l'échelle soit grande, elle est optimisée à travers des cadres tels que Llama.cpp et Vllm pour maintenir la précision et réduire la demande de ressources.

-Comètre de mylocrey: prend en charge le traitement d'image jusqu'à 1344 × 1344 résolution, et a une fonction OCR, excellentes performances.

-Cure support médiatique: Prise en charge du traitement vidéo et audio continu afin qu'il puisse être appliqué à des scènes de surveillance et de diffusion en direct réels.

- Caractéristiques de la personne: Fournir une compréhension à double voix, un clonage vocal et un contrôle émotionnel pour promouvoir l'interaction réelle de la nature.

-Il est facile à intégrer: compatible avec des plates-formes telles que Gradio, simplifiant le processus de déploiement, adapté aux applications commerciales avec moins d'un million d'utilisateurs actifs quotidiens.

Ces caractéristiques donnent MINICPM-O2.6 pour les développeurs et les entreprises, offrant la possibilité de déployer des solutions d'IA complexes sans compter sur d'énormes infrastructures.

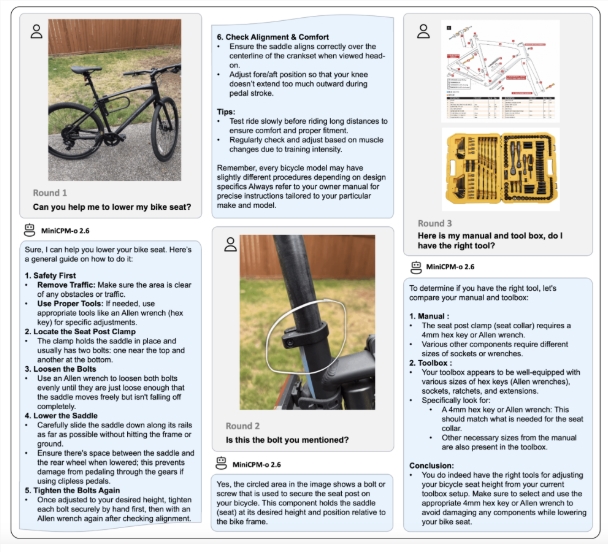

MINICPM-O2.6 a bien fonctionné dans divers domaines. Il dépasse le GPT-4V dans les tâches visuelles et réalise le dialogue chinois et anglais en temps réel, le contrôle émotionnel et le clonage vocal en termes de traitement vocal, et a une excellente interaction en langage naturel. Dans le même temps, le traitement vidéo et audio continu le rend adapté à des outils de traduction en temps réel et d'interactive pour garantir une grande précision dans les tâches OCR numériques telles que la documentation.

Le lancement de MINICPM-O 2.6 représente un développement important de la technologie de l'intelligence artificielle et résout avec succès le défi à long terme entre les modèles à forte intensité de ressources et l'équipement de bord. En combinant des capacités avancées multi-modes avec un équipement de bord efficace, OpenBMB crée un modèle puissant et facile à obtenir. Avec l'intelligence artificielle de plus en plus importante dans la vie quotidienne, MINICPM-O2.6 montre l'écart entre la façon dont l'innovation réduit les performances et la praticité, qui offre une utilisation possible de technologies de pointe chez les développeurs et les utilisateurs dans diverses industries.

Modèle: https://huggingface.co/openbmb/minicpm-56

Points:

MINICPM-O2.6 est un modèle multimodal avec 8 milliards de paramètres qui peuvent fonctionner efficacement sur l'équipement de bord et prendre en charge le traitement visuel, vocal et linguistique.

Ce modèle fonctionne excellent dans le test de référence OpenCompass, les scores de tâches visuels dépassent GPT-4V et ont des capacités de traitement multi-langues.

MINICPM-O2.6 a des fonctions telles que le traitement en temps réel, le clonage vocal et le contrôle émotionnel, qui convient aux applications innovantes dans de nombreuses industries telles que l'éducation et les soins médicaux.

Dans l'ensemble, l'émergence de MINICPM-O 2,6 marque une percée majeure dans les applications technologiques de l'IA. . A une valeur d'application élevée et des perspectives de développement.