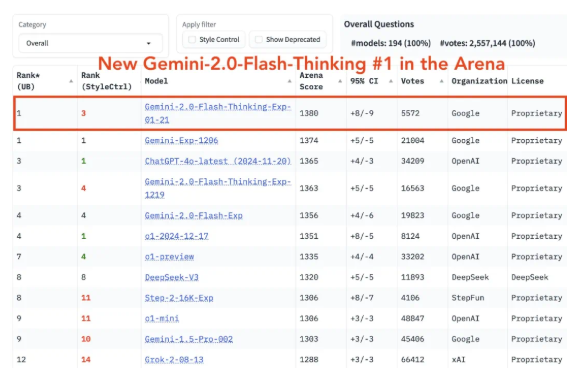

Google a publié la version améliorée du modèle de raisonnement Gemini 2.0 Flash Thinking le 22 janvier 2025, qui a repris la première position dans Chatbot Arena. Le cœur de cette mise à niveau est d'améliorer considérablement la capacité de traitement de contexte à long terme et de soutenir l'entrée de jeton jusqu'à 1 m, afin d'analyser plus profondément le texte long. Gemini 2.0 Flash Thinking conserve non seulement les avantages de la version originale, mais ajoute également des capacités de raisonnement améliorées basées sur la réflexion et se concentre sur l'amélioration de la fiabilité et de la cohérence du modèle, réduisant la contradiction entre la pensée et la réponse finale.

Google a officiellement publié son modèle de raisonnement Gemini2.0Flash le 22 janvier 2025 et a recapturé le haut de l'arène du chatbot. La mise à niveau de cette version est principalement concentrée dans les capacités de traitement à long terme, qui peuvent prendre en charge les entrées jusqu'à 1 m de jeton, et fournit aux utilisateurs des capacités d'analyse plus profondes lors du traitement des textes longs.

Lors de la conférence de presse, Jeff Dean, le chef de Google AI, a déclaré que la mise à jour expérimentale vise à améliorer la fiabilité du modèle et à réduire la contradiction entre la pensée de la génération de modèles et la réponse finale. Gemini2.0flash Thinking continue non seulement les avantages de la version originale, mais ajoute également une nouvelle fonction pour améliorer les capacités de raisonnement basées sur les pensées.

Au niveau technique, la pensée GEMINI2.0Flash a réalisé deux percées majeures: d'abord, il peut gérer le contexte à long et à baisse avec un jeton jusqu'à 1 m, ce qui est important pour le dialogue multiple complexe et le processus de raisonnement; Une information cohérente et flexible dans le dialogue. Cela signifie que les utilisateurs peuvent subir un processus de dialogue plus naturel et cohérent lors de l'interaction avec le modèle.

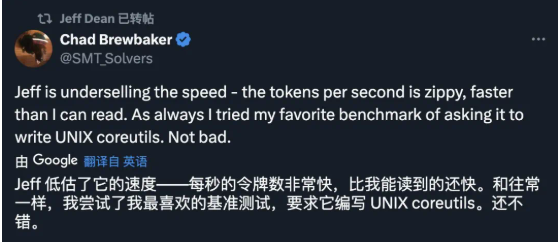

Dans une démonstration, Jeff Dean a montré comment le modèle résout les problèmes physiques et explique le processus de raisonnement, ce qui est impressionnant. De plus, les commentaires des participants ont déclaré que l'expérience réelle de ce dernier modèle était encore plus rapide que dans la démonstration.

En plus des capacités de traitement contextuel à long terme, la pensée Gemini2.0flash s'est également considérablement améliorée en termes de tests de capacité mathématique, de tests de capacité scientifique et de capacités de raisonnement multi-modes, en particulier dans les résultats mathématiques de 54%. Cette série d'excellentes performances fait attendre les gens de l'avenir du modèle.

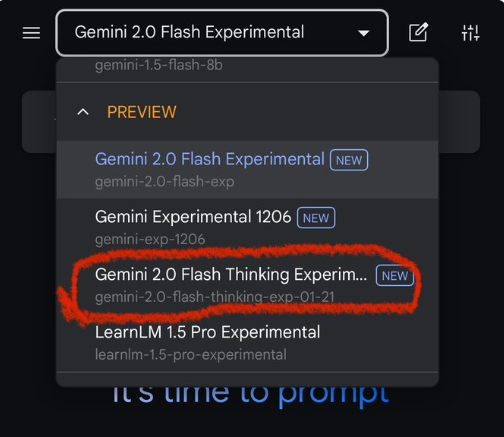

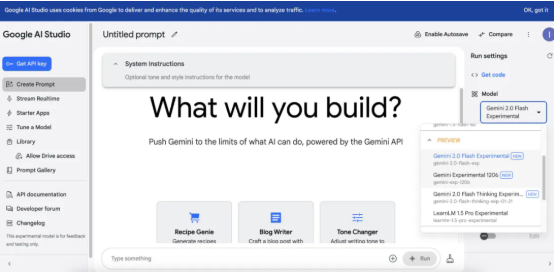

En entrant dans l'interface interactive, les utilisateurs peuvent obtenir une fonction de modèle complète sur la plate-forme "Google AI Studio", y compris la création de mots rapides, le dialogue en temps réel et le développement d'applications. Bien que la fonction de l'interface actuelle soit relativement dispersée, une fois le modèle officiellement publié, Google fournit des rapports techniques plus détaillés et des directives utilisateur pour améliorer l'expérience utilisateur.

Dans l'attente de l'avenir, l'équipe de développement de Google explore activement les capacités de traitement des données 3D, montrant leur ferme croyance en innovation continue. Il est prévisible que la prochaine percée de Google dans le champ d'IA soit digne de notre attention continue.

Lien d'essai: https://aistudio.google.com/prompts/new_chat

Dans l'ensemble, les mises à niveau Gemini 2.0 Flash Thinking se sont considérablement améliorées en termes de traitement long du texte, de capacité de raisonnement et de fiabilité, montrant la percée technologique continue de Google dans le domaine des modèles de grands langues. Son excellente performance et son orientation future du développement valent la peine d'être attendues, et il apporte également de nouvelles possibilités au développement futur du domaine de l'IA.