Os pesquisadores da Meta AI propuseram um método sem treinamento chamado AdaCache, projetado para acelerar a velocidade de inferência de modelos de transformadores de difusão de vídeo (DiTs). DiTs tem um bom desempenho na área de geração de vídeo, mas seu grande tamanho de modelo e mecanismo de atenção complexo levam a uma velocidade de inferência lenta, limitando sua aplicação. O AdaCache aproveita habilmente o fato de que "nem todos os vídeos são iguais", armazenando em cache os resultados dos cálculos e personalizando a estratégia de cache para cada vídeo, melhorando significativamente a eficiência da inferência e garantindo a qualidade da geração. O editor de Downcodes explicará detalhadamente essa tecnologia para você.

A geração de vídeos contínuos de alta qualidade requer recursos computacionais significativos, especialmente para períodos de tempo mais longos. Embora os mais recentes modelos de Transformadores de Difusão (DiTs) tenham feito progressos significativos na geração de vídeo, este desafio é exacerbado pela inferência mais lenta devido à sua dependência de modelos maiores e mecanismos de atenção mais complexos. Para resolver esse problema, pesquisadores da Meta AI propuseram um método sem treinamento chamado AdaCache para acelerar DiTs de vídeo.

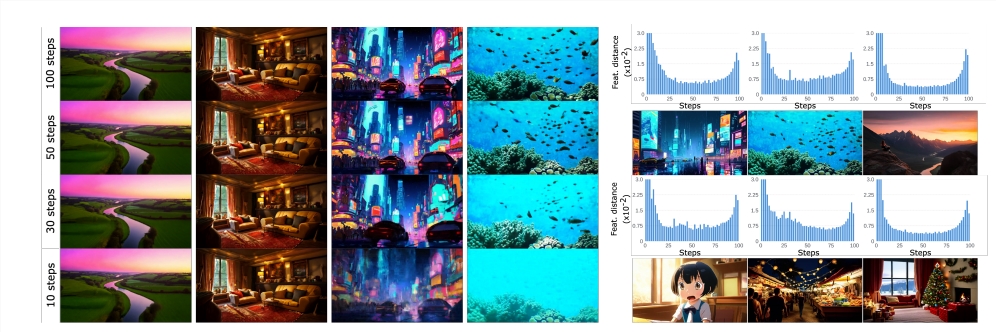

A ideia central do AdaCache é baseada no fato de que “nem todos os vídeos são iguais”, o que significa que alguns vídeos requerem menos etapas de remoção de ruído do que outros para atingir uma qualidade razoável. Com base nisso, este método não apenas armazena em cache os resultados do cálculo durante o processo de difusão, mas também projeta uma estratégia de cache personalizada para cada geração de vídeo, maximizando assim o compromisso entre qualidade e latência.

Os pesquisadores introduziram ainda um esquema de regularização de movimento (MoReg), que usa informações de vídeo no AdaCache para controlar a alocação de recursos computacionais de acordo com o conteúdo do movimento. Como as sequências de vídeo contendo texturas de alta frequência e grandes quantidades de conteúdo de movimento requerem mais etapas de difusão para atingir uma qualidade razoável, o MoReg pode alocar melhor os recursos computacionais.

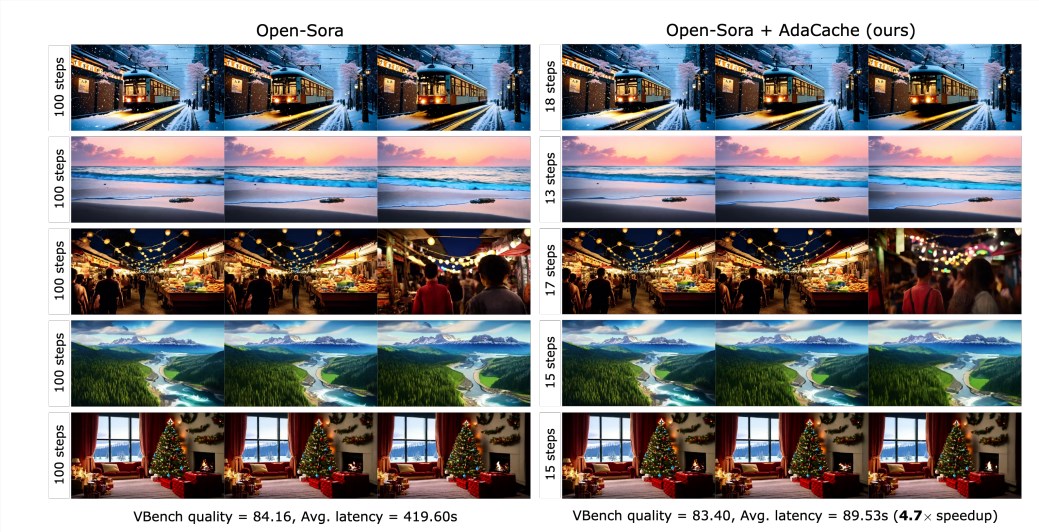

Resultados experimentais mostram que o AdaCache pode melhorar significativamente a velocidade de inferência (por exemplo, aceleração de até 4,7x na geração de vídeo Open-Sora720p-2s) sem sacrificar a qualidade da geração. Além disso, o AdaCache também possui boa capacidade de generalização e pode ser aplicado a diferentes modelos de vídeo DiT, como Open-Sora, Open-Sora-Plan e Latte. AdaCache oferece vantagens significativas em velocidade e qualidade em comparação com outros métodos de aceleração sem treinamento, como Δ-DiT, T-GATE e PAB.

Estudos de usuários mostram que os usuários preferem vídeos gerados pelo AdaCache a outros métodos e consideram sua qualidade comparável aos modelos básicos. Este estudo confirma a eficácia do AdaCache e dá uma importante contribuição no campo da geração eficiente de vídeo. A Meta AI acredita que o AdaCache pode ser amplamente utilizado e promover a popularização da geração de vídeos longos de alta fidelidade.

Artigo: https://arxiv.org/abs/2411.02397

Página inicial do projeto:

https://adacache-dit.github.io/

Github:

https://github.com/AdaCache-DiT/AdaCache

Resumindo, o AdaCache fornece um método novo e eficaz para geração eficiente de vídeo, e sua melhoria significativa de desempenho e boa experiência do usuário o tornam altamente potencial para aplicações futuras. O editor do Downcodes acredita que o surgimento do AdaCache promoverá o desenvolvimento da geração de vídeos longos de alta fidelidade.